揭秘YOLOv5目标检测算法:从小白到大师的进阶指南

发布时间: 2024-08-15 23:52:11 阅读量: 22 订阅数: 21

yolov5 目标检测算法使用教程

# 1. YOLOv5算法概述**

YOLOv5是目前最先进的实时目标检测算法之一,它以其速度和精度而闻名。YOLOv5算法的核心思想是将目标检测问题转化为回归问题,通过预测目标的边界框和类别概率来直接预测目标。这种方法消除了传统目标检测算法中繁琐的区域建议和特征提取步骤,从而大大提高了检测速度。

YOLOv5算法的网络结构包括一个骨干网络(Backbone)、一个颈部网络(Neck)和一个头部网络(Head)。骨干网络负责提取图像特征,颈部网络负责融合不同尺度的特征,头部网络负责预测目标的边界框和类别概率。YOLOv5算法的训练过程采用端到端的方式,通过反向传播算法优化损失函数来更新网络参数。

# 2. YOLOv5理论基础

### 2.1 卷积神经网络(CNN)

卷积神经网络(CNN)是一种深度学习模型,专门用于处理具有网格状结构的数据,例如图像。CNN由一系列卷积层组成,每个卷积层都包含一个可学习的滤波器(内核)。

**卷积操作:**卷积操作涉及将滤波器滑动到输入数据上,并计算滤波器权重与输入数据元素的逐元素乘积之和。这种操作可以提取输入数据的特征,例如边缘、纹理和形状。

**池化操作:**池化操作是一种降采样技术,用于减少卷积层输出的特征图大小。最常见的池化操作是最大池化和平均池化。

### 2.2 目标检测算法

目标检测算法旨在从图像中识别和定位对象。这些算法通常分为两类:

#### 2.2.1 回归与分类

**回归:**回归任务涉及预测目标的边界框坐标(x、y、宽、高)。

**分类:**分类任务涉及预测目标的类别(例如,人、汽车、动物)。

#### 2.2.2 非极大值抑制(NMS)

非极大值抑制(NMS)是一种后处理技术,用于从重叠的边界框中选择最具代表性的边界框。NMS通过计算边界框之间的重叠度,并抑制重叠度超过阈值的边界框来实现。

### 2.3 YOLOv5网络结构

YOLOv5网络结构是一个单阶段目标检测器,这意味着它在一个单一的向前传播中执行目标检测。YOLOv5网络由以下三个主要组件组成:

#### 2.3.1 Backbone

Backbone是YOLOv5网络的特征提取器。它通常由一系列卷积层组成,用于从输入图像中提取特征。YOLOv5使用Cross-Stage Partial Connections (CSP)Darknet53作为其Backbone。

#### 2.3.2 Neck

Neck是Backbone和Head之间的桥梁。它的作用是将不同尺度的特征图融合起来,为Head提供更丰富的特征表示。YOLOv5使用Path Aggregation Network (PAN)作为其Neck。

#### 2.3.3 Head

Head是YOLOv5网络的预测器。它负责生成边界框预测和类别概率。YOLOv5使用YOLO Head作为其Head。

```python

import torch

import torch.nn as nn

import torch.nn.functional as F

class YOLOv5Head(nn.Module):

def __init__(self, num_classes, anchors):

super(YOLOv5Head, self).__init__()

self.num_classes = num_classes

self.anchors = anchors

# Conv layers

self.conv1 = nn.Conv2d(1024, 512, 1)

self.conv2 = nn.Conv2d(512, 256, 3, padding=1)

self.conv3 = nn.Conv2d(256, 256, 1)

# Prediction layers

self.pred_cls = nn.Conv2d(256, num_classes * anchors, 1)

self.pred_bbox = nn.Conv2d(256, 4 * anchors, 1)

def forward(self, x):

# Conv layers

x = F.relu(self.conv1(x))

x = F.relu(self.conv2(x))

x = F.relu(self.conv3(x))

# Prediction layers

cls_pred = self.pred_cls(x)

bbox_pred = self.pred_bbox(x)

return cls_pred, bbox_pred

```

**逻辑分析:**

这个代码块实现了YOLOv5网络的Head部分。Head负责生成边界框预测和类别概率。它包含三个卷积层,用于提取特征,以及两个预测层,用于生成预测。

**参数说明:**

* `num_classes`:目标类别数。

* `anchors`:每个网格单元的锚点数量。

# 3.1 数据集准备

YOLOv5算法对数据集的要求较高,需要包含大量高质量的图像和标注信息。常用的数据集包括:

| 数据集 | 图像数量 | 标注数量 | 类别数量 |

|---|---|---|---|

| COCO | 120K | 80 | 80 |

| VOC | 16K | 20 | 20 |

| ImageNet | 1.2M | 1000 | 1000 |

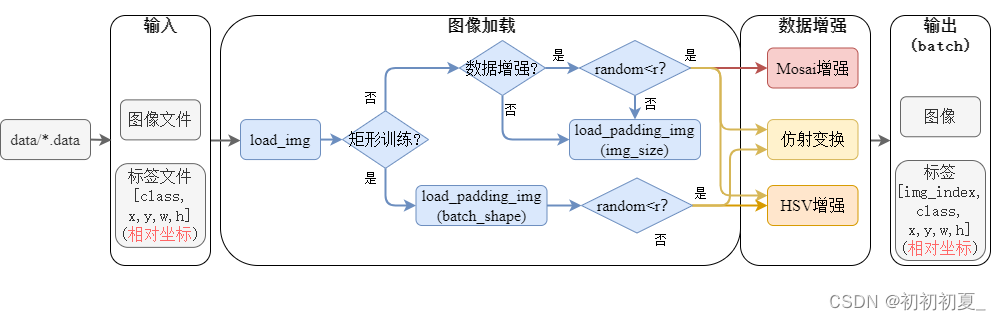

**数据预处理**

在训练YOLOv5模型之前,需要对数据集进行预处理,包括:

- **图像调整:**将图像调整为统一的大小,如416x416或640x640。

- **数据增强:**对图像进行随机裁剪、翻转、旋转等操作,以增加数据集的多样性。

- **标注转换:**将标注信息转换为YOLOv5模型所需的格式,如`.txt`或`.json`文件。

### 3.2 模型训练

**训练参数设置**

YOLOv5模型训练需要设置以下参数:

| 参数 | 说明 |

|---|---|

| epochs | 训练轮数 |

| batch_size | 每个批次训练的图像数量 |

| learning_rate | 学习率 |

| optimizer | 优化器 |

| loss_function | 损失函数 |

**训练过程监控**

在训练过程中,需要监控以下指标:

- **训练损失:**衡量模型在训练集上的性能。

- **验证损失:**衡量模型在验证集上的性能。

- **训练精度:**衡量模型在训练集上的分类准确率。

- **验证精度:**衡量模型在验证集上的分类准确率。

**代码块:**

```python

import torch

import torchvision.transforms as transforms

# 数据集预处理

transform = transforms.Compose([

transforms.Resize((416, 416)),

transforms.RandomCrop((416, 416)),

transforms.RandomHorizontalFlip(),

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225])

])

# 数据集加载

train_dataset = torchvision.datasets.CocoDetection(root='./data/coco', annFile='./data/coco/annotations/instances_train2017.json', transform=transform)

train_loader = torch.utils.data.DataLoader(train_dataset, batch_size=16, shuffle=True)

# 模型训练

model = torchvision.models.detection.yolov5(pretrained=True)

optimizer = torch.optim.Adam(model.parameters(), lr=0.001)

loss_function = torch.nn.MSELoss()

for epoch in range(100):

for images, targets in train_loader:

# 前向传播

outputs = model(images)

# 计算损失

loss = loss_function(outputs, targets)

# 反向传播

loss.backward()

# 更新权重

optimizer.step()

```

**逻辑分析:**

该代码段演示了YOLOv5模型的训练过程。首先,对数据集进行预处理,然后加载到数据加载器中。接着,实例化YOLOv5模型,并使用Adam优化器和均方差损失函数进行训练。在每个训练轮次中,代码段会遍历数据加载器中的批次,进行前向传播、损失计算、反向传播和权重更新。

### 3.3 模型评估

**精度指标**

YOLOv5模型的精度通常使用以下指标衡量:

- **平均精度(mAP):**衡量模型在不同IOU阈值下的平均检测精度。

- **召回率:**衡量模型检测出所有真实目标的能力。

- **准确率:**衡量模型预测的边界框与真实边界框的重叠程度。

**速度优化**

为了提高YOLOv5模型的推理速度,可以采用以下优化措施:

- **量化:**将模型中的浮点运算转换为整数运算。

- **剪枝:**移除模型中不重要的连接和权重。

- **并行计算:**利用多核CPU或GPU进行并行推理。

# 4. YOLOv5进阶应用

### 4.1 自定义数据集

#### 4.1.1 数据收集和标注

自定义数据集是为特定任务或场景定制YOLOv5模型的关键。数据收集和标注是创建自定义数据集的第一步。

* **数据收集:**收集与目标任务相关的图像或视频数据。确保数据具有多样性,包括各种对象、背景和照明条件。

* **数据标注:**使用标注工具(如LabelImg或CVAT)对数据中的对象进行标注。标注包括对象的边界框和类别标签。

### 4.2 模型微调

#### 4.2.1 预训练模型的使用

微调是使用预训练的YOLOv5模型在自定义数据集上进行训练的过程。预训练模型提供了基础知识,可以减少训练时间并提高模型性能。

```python

import torch

from yolov5 import load_model

# 加载预训练模型

model = load_model("yolov5s.pt")

# 冻结预训练模型参数

for param in model.parameters():

param.requires_grad = False

# 添加新的自定义层

model.add_module("custom_layer", torch.nn.Linear(1024, num_classes))

```

#### 4.2.2 数据增强技术

数据增强技术可以增加训练数据的多样性,防止模型过拟合。YOLOv5支持多种数据增强技术,包括:

* **随机裁剪:**随机裁剪图像,改变对象的位置和大小。

* **随机翻转:**水平或垂直翻转图像,增加对象的视角。

* **颜色抖动:**随机调整图像的亮度、对比度和饱和度。

### 4.3 部署和推理

#### 4.3.1 云端部署

云端部署涉及将训练好的YOLOv5模型部署到云平台,如AWS或Azure。云端部署提供了可扩展性和易于管理的优势。

```python

import boto3

# 创建Amazon SageMaker端点

endpoint = boto3.client("sagemaker").create_endpoint(

EndpointName="yolov5-endpoint",

ModelName="yolov5-model",

ProductionVariant={

"InstanceType": "ml.p2.xlarge",

"InitialInstanceCount": 1,

},

)

```

#### 4.3.2 边缘设备部署

边缘设备部署将YOLOv5模型部署到边缘设备,如Raspberry Pi或NVIDIA Jetson Nano。边缘设备部署提供了低延迟和本地处理的能力。

```python

import tensorflow.lite as tflite

# 将YOLOv5模型转换为TensorFlow Lite模型

converter = tflite.TFLiteConverter.from_saved_model("yolov5-model")

tflite_model = converter.convert()

# 将TensorFlow Lite模型部署到边缘设备

interpreter = tflite.Interpreter(tflite_model)

```

# 5. YOLOv5算法优化

### 5.1 算法加速

#### 5.1.1 轻量级网络结构

**MobileNetV3**

MobileNetV3是一种轻量级网络结构,旨在在移动设备上实现高效的目标检测。它采用深度可分离卷积和线性瓶颈结构,可以大幅减少计算量和模型大小,同时保持较高的精度。

**ShuffleNetV2**

ShuffleNetV2也是一种轻量级网络结构,它使用通道混洗操作来减少计算量。通过将通道分组并重新排列,ShuffleNetV2可以降低内存访问成本,提高推理速度。

**GhostNet**

GhostNet是一种基于Ghost模块的轻量级网络结构。Ghost模块使用cheap operations(廉价操作)来模拟昂贵的卷积操作,从而降低计算量。GhostNet在保持精度的情况下,可以大幅缩小模型大小。

#### 5.1.2 模型剪枝

**剪枝算法**

剪枝算法可以从模型中移除冗余的权重和节点,从而减小模型大小和计算量。常用的剪枝算法包括:

* **L1正则化:**向损失函数中添加L1正则化项,鼓励权重值接近0,从而实现剪枝。

* **权重修剪:**直接将绝对值较小的权重设置为0,从而移除冗余的连接。

* **结构化剪枝:**移除整个卷积层或通道,从而实现更激进的剪枝。

**剪枝策略**

剪枝策略决定了如何选择要移除的权重和节点。常用的剪枝策略包括:

* **基于重要性的剪枝:**根据权重或节点的重要性,移除不重要的部分。

* **基于梯度的剪枝:**根据梯度的稀疏性,移除梯度较小的部分。

* **基于稀疏性的剪枝:**移除稀疏的连接或节点。

### 5.2 性能提升

#### 5.2.1 数据增强策略

**图像增强**

图像增强技术可以丰富训练数据集,防止过拟合,提高模型泛化能力。常用的图像增强技术包括:

* **随机裁剪:**从图像中随机裁剪不同大小和形状的区域。

* **随机翻转:**沿水平或垂直轴随机翻转图像。

* **颜色抖动:**随机改变图像的亮度、对比度、饱和度和色相。

**标签增强**

标签增强技术可以丰富标签信息,提高模型对目标的理解能力。常用的标签增强技术包括:

* **边界框抖动:**随机平移、缩放或旋转边界框。

* **遮挡增强:**在图像中添加遮挡物,模拟真实场景中的遮挡情况。

* **目标变形:**随机变形目标形状,增强模型对目标变形的不变性。

#### 5.2.2 损失函数改进

**Focal Loss**

Focal Loss是一种用于目标检测的损失函数,它可以抑制容易分类的负样本,专注于困难分类的正样本。Focal Loss的公式为:

```

FL(p_t) = -(1 - p_t)^\gamma log(p_t)

```

其中:

* p_t表示样本的预测概率

* γ是一个超参数,控制难易样本的权重

**GIOU Loss**

GIOU Loss是一种用于目标检测的损失函数,它考虑了边界框的重叠面积和联合面积。GIOU Loss的公式为:

```

GIOU = IoU - (C - A_u) / C

```

其中:

* IoU表示边界框的交并比

* C表示边界框的联合面积

* A_u表示边界框的并集面积

# 6. YOLOv5未来发展趋势**

**6.1 算法创新**

YOLOv5算法的发展趋势主要集中在以下几个方面:

* **轻量化和高效化:**随着边缘设备的普及,对目标检测算法的轻量化和高效化提出了更高的要求。研究人员正在探索轻量级网络结构、模型剪枝和量化等技术,以降低算法的计算成本和能耗。

* **精度提升:**提高算法的精度是永恒的追求。研究人员正在探索新的网络架构、损失函数和数据增强策略,以进一步提升算法的检测精度。

* **泛化能力增强:**YOLOv5算法需要能够适应不同的数据集和应用场景。研究人员正在探索域适应和迁移学习技术,以增强算法的泛化能力,使其能够在各种场景下表现出色。

**6.2 应用拓展**

除了传统的目标检测任务外,YOLOv5算法在其他领域也展现出巨大的应用潜力:

**6.2.1 医疗影像**

YOLOv5算法在医疗影像领域具有广阔的应用前景,例如:

* **医学图像分割:**将医学图像中的不同组织或器官分割出来,辅助医生诊断和治疗。

* **疾病检测:**从医学图像中检测疾病,例如癌症或肺炎,辅助医生早期诊断。

* **手术导航:**在手术过程中提供实时目标检测,帮助医生定位目标组织或器官。

**6.2.2 自动驾驶**

YOLOv5算法在自动驾驶领域也发挥着重要作用,例如:

* **行人检测:**检测道路上的行人,避免碰撞事故。

* **车辆检测:**检测道路上的其他车辆,实现车道保持和自适应巡航等功能。

* **交通标志识别:**识别交通标志,辅助驾驶员遵守交通规则。

0

0