【Hadoop高可用性配置】:在完全分布式模式中打造HA的终极指南

发布时间: 2024-10-27 13:08:29 阅读量: 38 订阅数: 41

# 1. Hadoop高可用性架构概述

在分布式计算领域,Hadoop作为大数据处理的基石,其高可用性架构确保了大规模数据存储和处理的连续性和稳定性。Hadoop高可用性架构不仅仅是一个技术实现,它更是一种设计理念,旨在通过冗余和故障转移机制来防止单点故障,从而实现系统不间断运行的目标。

## 1.1 Hadoop高可用性的必要性

随着企业对数据分析的依赖日益增加,数据丢失或服务不可用的后果变得越来越严重。Hadoop高可用性架构通过提供实时数据备份、故障自动检测与恢复等功能,确保数据处理流程的持续运行,进而保障了企业的业务连续性。

## 1.2 高可用性架构的关键组件

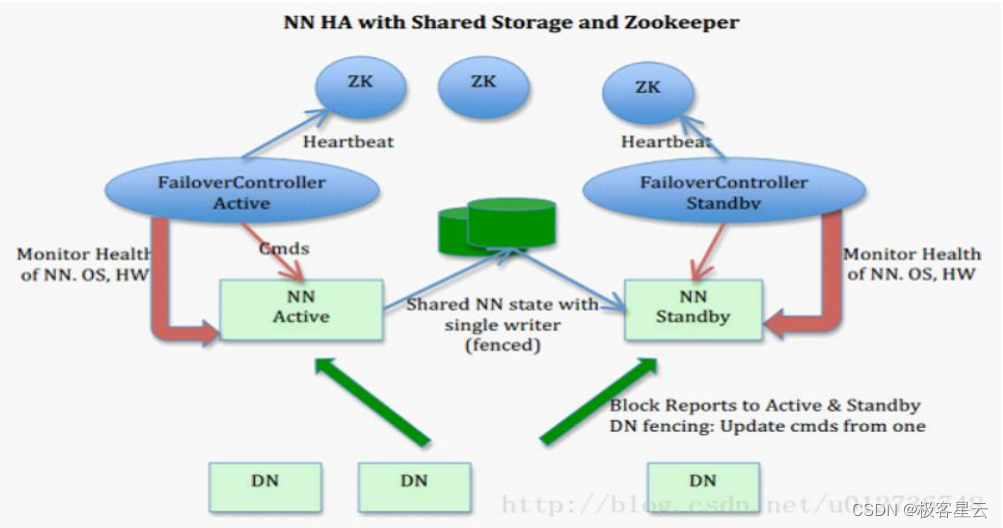

Hadoop高可用性架构主要包括NameNode高可用性、ZooKeeper集群管理以及故障转移机制等关键组件。这些组件协同工作,实现了数据冗余、资源动态分配和服务无间断切换等重要功能,为处理海量数据提供了强大的支撑。

通过理解这些关键组件的作用及其工作原理,用户可以更好地掌握Hadoop高可用性架构的精髓,并将其应用于大规模数据集群的建设和维护中。接下来的章节将详细探讨这些组件以及如何配置和管理高可用性Hadoop集群。

# 2. Hadoop高可用性理论基础

### 2.1 Hadoop分布式环境核心组件

Hadoop是一个由Apache基金会开发的开源分布式存储和计算框架,其核心组件包括HDFS(Hadoop Distributed File System)和MapReduce编程模型。HDFS用于存储大量数据,而MapReduce则用于处理这些数据。为了理解Hadoop高可用性,我们需要深入探讨这些组件的工作原理,特别是NameNode和DataNode的角色。

#### 2.1.1 NameNode与DataNode的工作原理

NameNode是HDFS的核心组件,负责管理文件系统的命名空间,维护文件系统树及整个目录树的结构。它记录着每个文件中各个块所在的DataNode节点信息,但它并不存储实际的数据,只保存文件的元数据,例如文件权限、访问时间和命名空间等。

DataNode则是在HDFS集群中实际存储数据的节点,它们负责存储和检索块(block)数据,并向NameNode报告自身持有的块信息。DataNode响应来自客户端的读写请求,并将数据缓存至本地文件系统。

为了保证NameNode的高可用性,Hadoop采用了一个称为“NameNode联邦”或“高可用NameNode”的机制。这涉及到多个NameNode,其中一个处于活跃状态,处理客户端请求,另一个处于热备份状态,在活跃节点失败时接管工作。

#### 2.1.2 HDFS的高可用性挑战与需求

HDFS作为一个分布式文件系统,面临的挑战是如何在多台计算机组成的集群上可靠地存储大量数据。系统的高可用性需求包括:

- 确保数据的持久性和一致性。

- 在节点故障时保持服务的连续性。

- 快速故障检测和自动恢复机制。

HDFS通过维护多个副本和心跳机制等来满足这些高可用性需求。为达到这些目标,Hadoop社区引入了如NameNode联邦、Quorum Journal Manager (QJM)等技术。

### 2.2 Hadoop高可用性关键技术

高可用性是任何企业级应用的重要特性,Hadoop通过一系列的关键技术来实现这一点。

#### 2.2.1 ZooKeeper在Hadoop中的角色

ZooKeeper是一个开源的分布式协调服务,它在Hadoop高可用性架构中扮演着至关重要的角色。ZooKeeper能够维护配置信息,提供命名服务、同步服务,以及组服务等。在Hadoop集群中,ZooKeeper用于同步NameNode状态、选举Active NameNode以及管理资源锁等。

#### 2.2.2 Quorum Journal Manager (QJM)的原理与配置

Quorum Journal Manager(QJM)是Hadoop中用于管理NameNode编辑日志的一种机制。编辑日志是记录HDFS文件系统元数据变更的重要数据结构。QJM使用一组独立的JournalNode服务器来存储日志信息,通过多数派投票的方式来保证数据的一致性。

在配置QJM时,需要在hdfs-site.xml文件中设置`dfs.journalnode.edits.dir`,指向JournalNodes存储编辑日志的目录,并确保所有JournalNodes的路径设置相同。一旦配置完成,需要格式化HDFS,并启动JournalNode和NameNode服务。

### 2.3 Hadoop集群故障转移机制

Hadoop集群的故障转移机制是其高可用性的核心组成部分。这个机制可以确保当集群中的某个节点出现故障时,能够迅速切换到备份节点,从而保证系统的连续运行。

#### 2.3.1 自动故障检测与转移流程

在Hadoop高可用性配置中,系统会持续监控Active NameNode的状态。如果检测到故障,ZooKeeper会开始一个故障转移流程。这个流程首先将故障的Active NameNode的角色转移到Standby NameNode,然后Standby节点接管成为新的Active节点。这个过程对于客户端来说是透明的。

#### 2.3.2 配置高可用性:配置文件与参数设置

配置Hadoop集群的高可用性涉及修改多个配置文件,包括hdfs-site.xml、core-site.xml和yarn-site.xml。在这些文件中,需要指定ZooKeeper的连接信息、JournalNode的地址、NameNode的高可用性设置等。例如,在hdfs-site.xml中,需要配置`dfs.nameservices`、`dfs.ha.namenodes.[nameservice-id]`等参数。

此外,还需要配置failover控制器(通常使用`zookeeperfc`),以及指定故障转移控制器类路径。高可用性配置是一个精细且复杂的过程,需要仔细配置所有参数以确保系统正常运行。

下一章节将详细介绍Hadoop高可用性的实践操作步骤,包括Hadoop集群的安装、配置ZooKeeper集群、以及配置HDFS高可用性的具体操作。

# 3. Hadoop高可用性实践操作

## 3.1 Hadoop集群安装与基本配置

### 3.1.1 环境准备与软件安装步骤

在开始安装Hadoop集群之前,需要确保每个节点的操作系统和环境变量配置一致。首先,设置主机名、编辑`/etc/hosts`文件以便于节点间能够通过主机名互相识别。接下来,配置SSH免密钥登录,以便于集群中的节点可以相互无密码访问。

安装步骤大致如下:

1. 更新系统软件包,并安装Java环境(Hadoop需要Java支持)。

2. 下载并解压Hadoop到本地目录。

3. 配置Hadoop的环境变量,如`HADOOP_HOME`,并将Hadoop的`bin`目录添加到`PATH`环境变量中。

4. 分发Hadoop安装包到集群中的所有节点,并同步配置文件。

5. 安装和配置所有必要的依赖项,例如ZooKeeper。

示例代码块和逻辑分析:

```bash

# 更新系统软件包

sudo yum update -y

# 安装Java环境

sudo yum install java-1.8.0-openjdk -y

sudo alternatives --set java /usr/lib/jvm/java-1.8.0-openjdk/jre/bin/java

# 下载并解压Hadoop

wget ***

* 设置Hadoop环境变量

echo 'export HADOOP_HOME=/usr/local/hadoop' >> ~/.bashrc

echo 'export PATH=$PATH:$HADOOP_HOME/bin:$HADOOP_HOME/sbin' >> ~/.bashrc

# 分发Hadoop到所有节点

scp -r /usr/local/hadoop/ user@node2:/us

```

0

0