【Hadoop NameNode与DataNode解析】:不同部署模式下的角色与功能大揭秘

发布时间: 2024-10-27 13:04:55 阅读量: 43 订阅数: 24

Hadoop守护者:NameNode与DataNode故障恢复全攻略

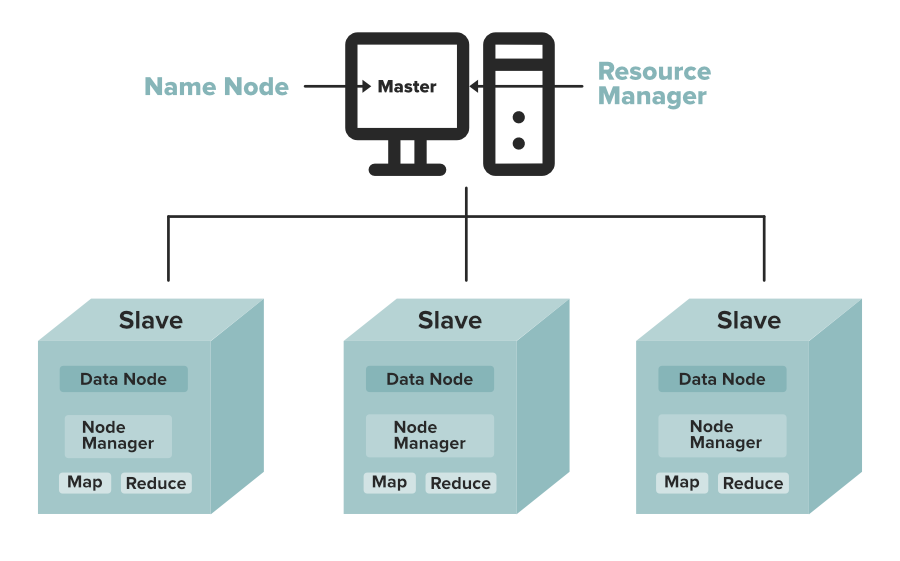

# 1. Hadoop的基本架构和组件

Hadoop是一个能够处理大量数据的分布式存储和计算框架。它的核心是HDFS(Hadoop Distributed File System),负责数据的存储,以及MapReduce,用于数据处理和分析。本章将介绍这些组件是如何协同工作的。

Hadoop架构的核心组件如下:

- NameNode:作为HDFS的主节点,负责管理文件系统命名空间和客户端对文件的访问。

- DataNode:在集群中分布存储实际数据,并执行数据块的创建、删除和复制等工作。

- ResourceManager:管理集群中的资源分配,例如CPU和内存。

- NodeManager:在每个节点上运行,负责监控资源使用情况,并向ResourceManager报告。

通过这些组件的协作,Hadoop提供了一个可靠、可扩展的存储和计算解决方案,特别适合大数据处理。在第二章中,我们将深入探讨NameNode的工作原理。

# 2. NameNode的工作原理

## 2.1 NameNode的职责和作用

### 2.1.1 元数据管理

NameNode的核心职责之一是管理Hadoop分布式文件系统(HDFS)的元数据。元数据记录了文件系统的结构信息,包括文件和目录信息、文件的权限、属性、每个文件的块位置等。为了保证数据的快速读取和高效管理,NameNode维护着两个重要的数据结构:命名空间(Namespace)和文件系统的元数据映射。

命名空间是文件系统目录结构的抽象,它是一个树状结构,包含了文件系统的所有目录和文件。而元数据映射则包含了文件和目录的详细信息,以及它们与数据块的对应关系。当客户端进行文件读写操作时,首先需要查询NameNode获取元数据信息,然后才能与DataNode交互,进行实际的数据操作。

元数据管理的挑战在于如何在保持高性能的同时,确保元数据的完整性和一致性。由于元数据存储在内存中,这要求系统具有足够的内存资源,并且需要通过定期或事务性的方式将元数据的状态持久化到磁盘。

### 2.1.2 命名空间的维护

命名空间的维护涉及到文件和目录的创建、删除、重命名等操作。当客户端执行这些操作时,NameNode需要确保它们是原子性的,即操作要么完全成功,要么完全不发生。为了实现这一点,NameNode使用一系列的事务日志来记录所有的元数据变更操作,确保在系统故障时能够恢复到一致的状态。

除此之外,NameNode还需要处理并发控制问题。因为HDFS允许多个客户端并发操作,NameNode通过锁机制控制对文件和目录的访问。例如,当一个客户端正在重命名一个文件时,其他客户端就不能同时对该文件进行操作。

NameNode的性能瓶颈主要在于命名空间的处理能力,这包括元数据的加载、更新和检索速度。随着HDFS规模的增长,命名空间可能会成为系统扩展的一个限制因素。

## 2.2 NameNode的故障转移机制

### 2.2.1 高可用性(HA)模式

在Hadoop 2.0之前,NameNode是HDFS的单点故障(Single Point of Failure, SPOF),一旦NameNode出现问题,整个集群将无法使用。为了解决这个问题,Hadoop引入了高可用性(High Availability, HA)模式。在这种模式下,有两个NameNode:一个处于活动状态,另一个处于备用状态。通过共享存储和状态同步机制,确保两个节点的数据保持一致。

高可用性模式下,通常采用Quorum Journal Manager(QJM)来实现状态的同步,确保当活动的NameNode故障时,备用的NameNode可以迅速接管服务,继续提供文件系统的访问。这大大提高了HDFS的可用性和稳定性。

### 2.2.2 自动故障转移过程

当活动NameNode发生故障时,自动故障转移过程会启动,以确保备用NameNode能够接管文件系统的所有职责。自动故障转移涉及以下关键步骤:

1. 故障检测:集群中的其他组件(如ZooKeeper)负责检测活动NameNode的健康状态。

2. 状态转换:当检测到活动NameNode故障时,ZooKeeper会将备用NameNode状态改为活动状态。

3. 数据同步:备用NameNode加载之前活动节点保存的元数据,可能还会从共享存储中读取最近的事务日志文件以更新状态。

4. 服务切换:所有客户端的请求会被重定向到新的活动NameNode,集群开始正常工作。

整个过程对用户是透明的,客户端并不需要关心NameNode之间的切换。对于运维人员来说,故障转移过程大大简化了系统的维护工作,降低了因单点故障带来的风险。

## 2.3 NameNode的性能优化

### 2.3.1 内存和磁盘的优化

由于NameNode的性能直接影响整个HDFS集群的性能,因此对NameNode的优化尤为重要。内存和磁盘的优化是主要的性能调整方向之一。

- 内存优化:由于元数据是存储在内存中的,因此增加NameNode的内存可以提升其处理能力。在设计Hadoop集群时,应该根据预期的文件数量和大小,合理规划NameNode的内存配置。

- 磁盘优化:为了避免NameNode成为瓶颈,除了内存之外,磁盘I/O同样重要。使用高性能的SSD而不是传统的HDD磁盘可以显著提高I/O性能。另外,可以通过配置多个磁盘控制器来提高并发I/O能力。

### 2.3.2 垃圾回收机制的调整

Java虚拟机(JVM)的垃圾回收(GC)机制对于NameNode的性能有很大影响。默认情况下,JVM的垃圾回收机制可能并不适用于高负载的NameNode,因此需要根据实际负载进行调整。

- 垃圾回收器的选择:根据不同的需求,可以选择不同的垃圾回收器。例如,G1垃圾回收器可以在保持较低停顿时间的同时,处理大规模的内存堆空间。

- 调整GC参数:调整GC的触发阈值、内存新生代和老年代的大小比例等参数,可以减少GC造成的停顿时间,从而提升NameNode的服务能力。

通过合理的内存和磁盘配置以及对垃圾回收机制的调优,可以显著提高NameNode的性能,确保Hadoop集群的稳定运行。

```java

// 示例代码块展示如何在Java中使用G1垃圾回收器

public class G1GCExample {

public static void main(String[] args) {

// JVM启动参数设置

String jvmOpts = "-XX:+UseG1GC -XX:MaxGCPauseMillis=100";

// 命令行执行

Runtime.getRuntime().exec("java " + jvmOpts + " YourApplication");

}

}

```

代码逻辑分析和参数说明:

- `-XX:+UseG1GC`:启用G1垃圾回收器。

- `-XX:MaxGCPauseMillis=100`:设置期望的最大垃圾回收暂停时间为100毫秒,这有助于保持应用的响应性。

- `YourApplication`:代表要运行的应用程序类。

通过对这些参数进行调整,可以优化Java应用的垃圾回收行为,减少因垃圾回收导致的服务中断时间,从而提升Hadoop集群的性能和稳定性。

# 3. DataNode的角色和功能

在Hadoop的生态系统中,DataNode是分布式存储的核心组件。每个DataNode负责存储部分数据,以块的形式存在,这些数据块构成整个Hadoop文件系统的基础。DataNode承担了Hadoop存储层的大部分物理存储工作,其性能和稳定性直接关系到整个Hadoop集群的健康与效率。

## 3.1 DataNode的数据存储

### 3.1.1 数据块的创建和复制

数据在Hadoop中是以块的形式存储的,块的默认大小为128MB(可通过配置调整),一个文件可能会被切分成多个块进行存储。DataNode是这些块存储的直接管理者。当HDFS接收到文件时,它会将文件切分成块,并在集群的DataNode上创建副本。

```java

// 创建DataNode数据块的示例伪代码

public void createDataBlock(String filePath, String data) {

// 将文件切分成块

List<String> blocks = file切割逻辑(filePath);

// 将块数据写入DataNode

for(String block : blocks) {

// 向DataNode写入数据块

writeBlockToDataNode(block, data);

// 复制块到其他DataNode

replicateBlock(block);

}

}

```

创建数据块的过程需要考虑数据的完整性校验,通常使用CRC32校验码来实现。此外,为了保证数据的可靠性,HDFS使用副本机制,每个数据块在不同的DataNode上保持若干个副本。DataNode会定期向NameNode报告块的校验和,以此来验证数据的一致性。

### 3.1.2 数据块的读写流程

数据的读写是HDFS最常见的操作之一。在读取数据时,客户端首先向NameNode请求文件的元数据,包括数据块的位置信息。然后,客户端直接与存储数据块的DataNode通信,进行数据的读取。而在写入数据时,

0

0