数据倾斜不再难:Map Join技术的深度剖析与实践

发布时间: 2024-11-01 08:15:26 阅读量: 25 订阅数: 26

C++ 中 std::unordered-map 与 std::map:容器选型的深度剖析

# 1. Map Join技术简介

Map Join技术是大数据处理领域中一项重要的优化手段,它主要应用于大数据框架下,如Hadoop或Spark,针对特定的数据处理场景,提高连接操作的效率。在大数据的分布式环境下,Map Join利用数据的局部性原理,通过预加载一个表的数据到所有Map任务的内存中,使得在执行连接操作时,可以极大地减少对数据的读取和Shuffle操作,从而加快了数据处理速度。Map Join不仅减少了网络传输的数据量,而且降低了因数据倾斜带来的性能问题,是处理大规模数据连接操作的高效解决方案。随着大数据技术的不断进步,Map Join作为一种优化技术,其应用范围和场景也在不断扩大和深化。

# 2. Map Join的工作原理

### 2.1 Map Join技术的理论基础

#### 2.1.1 分布式计算与MapReduce模型

MapReduce是Hadoop框架的核心组件,用于处理大规模数据集的编程模型。它由两个主要阶段组成:Map阶段和Reduce阶段。Map阶段处理输入数据,将它们分解成一系列键值对;Reduce阶段则对这些键值对进行汇总和组合,以生成最终结果。MapReduce的这种设计,极大地简化了分布式编程的复杂性,使得开发者可以不必关注底层的分布式和容错机制。

在MapReduce模型中,Map Join是一种特殊的应用场景,用于优化大规模数据集的join操作。当需要对两个数据集进行join操作时,若其中一个数据集远小于另一个,可以将小数据集广播到所有Map节点上,在Map阶段就完成join操作,避免了数据在网络中传输和Reduce阶段的处理,从而大幅度提升了处理速度。

#### 2.1.2 数据倾斜的产生与影响

在分布式计算中,数据倾斜指的是数据在各个节点上的分布极度不均匀,导致某些节点负载过重而其他节点空闲。数据倾斜通常是由于数据分布不均匀、分区策略不当或者不合理的join操作导致的。当数据倾斜发生时,系统的处理效率会大幅下降,因为部分节点成为瓶颈,拖慢整个作业的完成时间。

数据倾斜在Map Join中的影响尤为显著,因为Map Join依赖于数据的均匀分布。如果倾斜严重,即使小表被广播,但节点间处理数据量的差异仍然可能导致执行效率的不一致,进而影响整体的性能。

### 2.2 Map Join的关键执行流程

#### 2.2.1 静态Map Join的处理机制

静态Map Join(也称为广播hash join)在执行前已知需要join的小表不会发生变化,所以可以将小表加载到每个Map节点的内存中,然后对大表进行分区处理。当Map节点处理大表中的数据时,可以直接从内存中查找并完成join操作。

在Hadoop中,Map Join依赖于Map任务的配置参数来实现静态广播。通过设置`mapreduce.job.map.input.fluff`参数为true,小表会以fluff形式在每个Map任务中被处理,这样Map任务就可以直接访问到小表数据进行join操作。

#### 2.2.2 动态Map Join的工作原理

与静态Map Join不同,动态Map Join适用于小表数据会发生变化的情况。动态Map Join通过一个中央化的广播机制,将小表数据广播到每个Map节点上。这个过程一般需要在Map之前执行一个特殊的Map任务,用于从源头加载小表数据并广播。完成后,实际的Map任务就可以像静态Map Join一样进行join操作。

动态Map Join在处理动态数据集时更为灵活,但也会增加网络传输开销和内存消耗。因此,需要仔细权衡数据集的大小和动态变化的程度,来决定是否使用动态Map Join。

#### 2.2.3 参数和配置对性能的影响

参数的配置对于Map Join性能有显著影响。在Hadoop中,可以通过调整Map任务的内存设置(如`mapreduce.map.memory.mb`)和CPU核心数(如`mapreduce.map.cpu.vcores`),来优化Map Join的性能。此外,合理设置`mapreduce.job.reduces`参数来控制Reduce任务的数量,可以影响到数据的分区策略,从而影响到Map Join的性能。

需要注意的是,参数设置应基于实际的集群资源和数据集特性进行调整。过高的配置可能会导致资源浪费,而配置不足则可能导致性能瓶颈。例如,当`mapreduce.job.reduces`设置得太低时,可能会导致某些Map节点的输出数据太大,造成网络传输的瓶颈。因此,在部署Map Join之前,进行适当的基准测试和性能调优是非常必要的。

下面展示一个简单的Hadoop Map Join的代码示例,以及如何在Hadoop的配置文件中进行设置:

```java

public class MapJoinExample {

public static void main(String[] args) throws IOException, InterruptedException, ClassNotFoundException {

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "Map Join Example");

job.setJarByClass(MapJoinExample.class);

job.setMapperClass(MapJoinMapper.class);

job.setNumReduceTasks(0); // 禁用Reduce任务

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(Text.class);

job.addCacheFile(new Path(args[0]).toUri()); // 小表文件路径

FileInputFormat.addInputPath(job, new Path(args[1])); // 大表文件路径

FileOutputFormat.setOutputPath(job, new Path(args[2]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

```

在配置文件中,需要设置相关参数来启用Map Join:

```

mapreduce.job.map.memory.mb = 2048

mapreduce.job.map.cpu.vcores = 1

mapreduce.job.reduces = 0

```

这里设置`mapreduce.job.reduces`为0,意味着整个作业没有Reduce阶段。通过`mapreduce.job.cache.files`或`addCacheFile()`方法将小表文件加入到每个Map任务的缓存中,Map任务可以利用这些数据来执行join操作。

在后续章节,我们将更深入地探讨Map Join的实践应用,包括在不同大数据框架中的实现方式和真实场景下的案例分析。

# 3. Map Join的实践应用

### 3.1 Map Join在不同大数据框架中的实现

#### 3.1.1 Hadoop MapReduce中的Map Join

在Hadoop MapReduce框架中,Map Join是一种优化技术,用于优化处理涉及大表和小表连接的作业。其基本思想是将小表加载到每个Mapper的内存中,从而避免Reducer端的Shuffle过程,减少网络传输开销,加速处理速度。

具体实现步骤如下:

1. **预处理小表数据**:在MapReduce作业开始之前,将小表转换为键值对的形式,键通常是连接键,值是小表的其他字段。

2. **配置Mapper**:将小表数据分发到所有Mapper任务的本地内存中,每个Mapper任务读取小表数据,并将这些数据存储在内存数据结构中(例如HashMap)。

3. **读取大表数据**:大表数据被切分成多个片段,并被分配给不同的Mapper任务。

4. **执行连接操作**:在Mapper任务处理大表数据时,通过连接键将大表中的记录与内存中的小表数据进行连接操作。

一个典型代码示例如下:

```java

// 伪代码

public class MapJoinMapper extends Mapper<LongWritable, Text, Text, Text> {

private HashMap<String, String> smallTableMap = new HashMap<>();

// Map任务初始化时加载小表数据

public void setup(Context context) {

// 从HDFS读取小表数据并加载到HashMap中

// 此处代码省略...

}

// 处理大表数据,与HashMap中的数据进行连接操作

public void map(LongWritable key, Text value, Context context) {

// 从Text中解析出连接键与大表数据

// 此处代码省略...

// 将大表数据与HashMap中对应的记录进行连接操作

// 此处代码省略...

}

}

```

该代码逻辑中,`setup`方法负责小表数据的加载,`map`方法负责大表数据的处理和连接操作。通过这种方式,可以避免大表与小表的数据Shuffle过程,从而提高整体作业的效率。

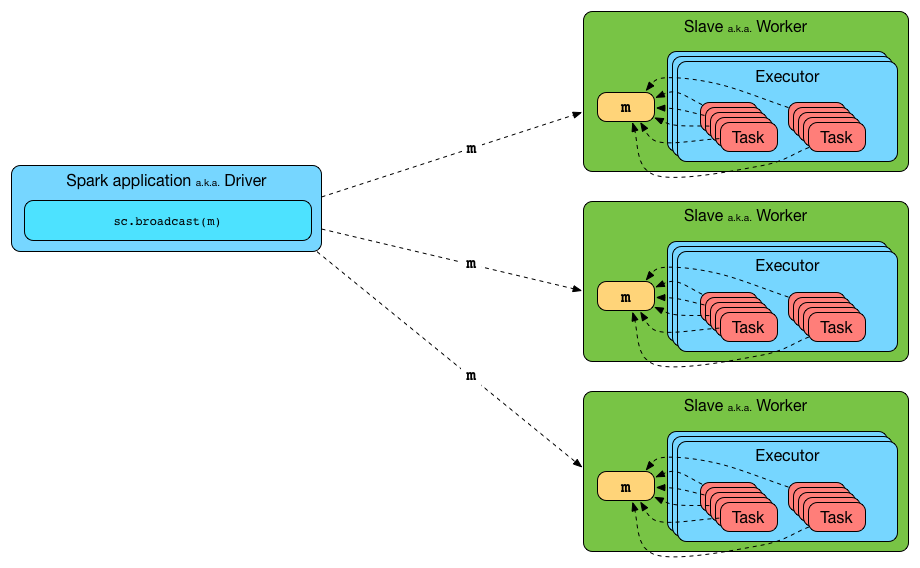

#### 3.1.2 Spark SQL中的Map Join

Spark SQL提供了更为高级的数据处理能力,其内置的优化器(Catalyst optimizer)可以自动识别并执行Map Join优化。Spark SQL中的Map Join不仅限于静态小表,还能处理动态情况下(表的大小在运行时才能确定)的连接操作。

实现步骤概述:

1. **构建DataFrame**:首先,将大表和小表转换为DataFrame。

2. **执行连接操作**:在调用DataFrame的`join`方法时,Spark SQL优化器会自动检测是否满足Map Join的条件。

3. **触发Map Join优化**:如果满足条件,Spark SQL会在物理执行计划中选择Map Join。

4. **执行Map Join**:在执行计划中,小表的数据会被广播到每个Executor上,然后在Mapper端进行连接操作。

下面是一个使用Spark SQL进行Map Join的代码示例:

```scala

// Scala代码

val sparkSession: SparkSession = ...

import sparkSession.implicits._

// 创建DataFrame

val bigDataFrame = sparkSession.read.parquet("path_to_big_table")

val smallDataFrame = sparkSession.read.parquet("path_to_small_table")

// 执行连接操作

val joinedDataFrame = bigDataFrame.join(broadcast(smallDataFrame), $"bigTableKey" === $"smallTableKey")

// 执行查询操作

joinedDataFrame.show()

```

在上述代码中,`broadcast`函数用于将小表广播到每个Executor,以支持Map Join。这种优化对于小表来说,大大减少了Shuffle过程,加速了数据处理速度。

### 3.2 Map Join案例分析

#### 3.2.1 真实场景下的数据倾斜问题

数据倾斜是指在分布式计算中,部分节点处理的数据量远大于其他节点,导致处理速度不均衡,整个作业的性能受到拖累。这种情况在连接操作中尤为常见,特别是当连接键的数据分布不均匀时。

例如,一个电子商务平台的订单表和产品表进行连接操作,连接键是产品ID。如果某个热门产品有数十万笔订单,而其他产品只有几笔订单,那么分配到处理热门产品的节点将会承受极大的压力,导致数据倾斜。

#### 3.2.2 Map Join技术的解决方案实施

解决数据倾斜的一个有效手段是使用Map Join技术。在前面的章节中已经介绍了在Hadoop MapReduce和Spark SQL中实施Map Join的方法。通过在Mapper端执行连接操作,可以避免Shuffle过程,从而减少数据倾斜的可能性。

例如,在Hadoop MapReduce作业中,可以将包含热门产品的数据片段拆分出来,只对这部分数据片段进行Map Join操作,而不是对整个大表执行。拆分操作后,其他数据片段仍然可以进行传统的Reduce Join操作。

#### 3.2.3 效果评估与优化

对于Map Join的性能评估和优化,可以参考以下步骤:

1. **性能评估**:运行作业并监控各阶段的执行时间和资源使用情况。可以使用Hadoop集群管理工具,例如Ambari或Ganglia,来监控资源消耗。

2. **分析结果**:使用Spark的UI界面或者Hadoop的日志文件来分析作业执行的详细信息。

3. **优化参数配置**:调整Hadoop或Spark的配置参数,比如调整执行的并行度`mapreduce.job.maps`和`mapreduce.job.reduces`,来获得更优的性能。

4. **数据处理策略**:对数据倾斜问题严重的表执行预处理,比如使用随机前缀、哈希分桶等技术,来减少数据倾斜的影响。

5. **复审代码逻辑**:确保Map Join逻辑正确实现,没有在代码中引入不必要的数据处理开销。

通过以上步骤,可以系统地优化和改进Map Join的实施效果,提升作业的处理性能。在实践中,Map Join技术的运用需要结合具体场景灵活调整,以达到最佳的性能表现。

# 4. ```

# 第四章:Map Join的性能调优

## 4.1 性能调优的理论知识

### 4.1.1 数据分布与负载均衡

数据分布的均匀性对Map Join的性能有着直接的影响。当数据倾斜发生时,某些Map任务会因为处理大量数据而显著变慢,从而导致整个作业的执行时间增加。负载均衡是解决数据倾斜问题的关键,其目标是确保每个Map任务所分配到的数据量大致相同,从而使得任务能够并行执行且完成时间接近。

为了实现负载均衡,可以采取以下措施:

- **预处理数据**:在执行Map Join前,对输入数据进行重新分片和洗牌(Shuffle),以达到更均匀的数据分布。

- **调整Map任务数量**:适当增加Map任务的数量,可以更细致地控制数据的分配,但需权衡任务管理开销。

- **使用数据抽样**:通过数据抽样分析,了解数据分布情况,进而做出更有针对性的调整。

### 4.1.2 并行度与任务调度优化

并行度指的是并行任务的数量。在Map Join中,提高并行度可以在一定程度上减少作业的总执行时间。但并行度过高会导致过多的任务调度开销和资源竞争,反而可能降低整体效率。

任务调度的优化通常涉及以下几个方面:

- **资源优化**:合理分配CPU、内存和磁盘资源,确保每个Map任务都能在资源足够的条件下运行。

- **调度策略**:采用有效的任务调度策略,如优先级调度或公平调度,以确保任务的高效执行。

- **动态调度**:利用动态调度机制,根据系统的实时状况,动态调整任务的分配和调度策略。

## 4.2 Map Join的监控与诊断

### 4.2.1 性能监控工具的使用

性能监控是性能调优的重要手段。通过性能监控工具,可以实时收集和分析作业执行过程中的各种性能指标。常用的性能监控工具有:Hadoop自带的JobHistoryServer、YARN的ResourceManager Web UI、以及专门的性能分析工具如Ganglia和Nagios。

使用这些工具时,监控的指标包括但不限于:

- **任务完成时间**:各个任务完成所需的时间,用于判断是否存在数据倾斜。

- **资源使用情况**:包括CPU、内存和磁盘I/O的使用率,帮助判断资源是否瓶颈。

- **吞吐量**:单位时间内的数据处理量,有助于评估作业效率。

### 4.2.2 常见性能瓶颈的诊断与解决

诊断性能瓶颈是调优过程中的关键步骤,常见的性能瓶颈及其解决方案如下:

- **内存溢出**:增加JVM的内存分配,优化代码以减少内存使用,或者采用更高效的数据结构。

- **磁盘I/O瓶颈**:优化数据存储格式,利用列式存储减少磁盘I/O量,或者通过增加磁盘吞吐量来提升性能。

- **网络瓶颈**:在网络带宽有限的情况下,可以优化数据传输过程中的序列化和反序列化方法,减少不必要的数据交换。

## 4.3 代码块示例与分析

假设在Spark SQL中,我们使用DataFrame API来进行Map Join操作,并希望优化其性能。下面是一个简单的代码示例:

```scala

import org.apache.spark.sql.SparkSession

import org.apache.spark.sql.functions.broadcast

val spark = SparkSession.builder().appName("Map Join Performance Tuning").getOrCreate()

// 加载两张表的数据

val largeTable = spark.table("large_table")

val smallTable = spark.table("small_table").limit(1000) // 假设小表数据量小

// 使用broadcast hint来优化大表与小表之间的连接操作

val joinedDF = largeTable.join(broadcast(smallTable), $"largeTable.id" === $"smallTable.id")

joinedDF.show()

```

### 代码逻辑分析:

- **导入必要的包和类**:首先导入SparkSession以及DataFrame操作中可能需要的函数。

- **创建SparkSession实例**:使用`SparkSession.builder().appName()`创建Spark会话,并启动Spark SQL。

- **加载数据**:使用`spark.table()`方法加载需要进行Join操作的数据表。

- **优化连接操作**:通过`broadcast`提示,将小表广播到各个节点上,这样在执行Join操作时,可以在本地直接访问小表数据,避免了不必要的数据传输,从而提高了Join操作的性能。

- **执行并展示结果**:通过`show()`方法来执行计算并展示结果。

### 参数说明:

- `broadcast(smallTable)`:这是提示Spark SQL框架将小表`smallTable`广播到每个节点上,对于小表而言,这样做能够显著加快Join操作的速度。

- `($"largeTable.id" === $"smallTable.id")`:表示按照大表和小表的`id`字段进行连接。

通过上述代码,我们不仅展示了Map Join的基本操作,还解释了如何使用Spark SQL提供的优化提示来提升性能。在实际应用中,开发者可以根据数据的具体情况,调整广播的大小和条件,以达到最佳性能。

# 5. Map Join的高级应用场景

## 5.1 复杂数据结构下的Map Join

在处理复杂数据结构时,Map Join技术同样能够发挥其独特的优势。本节将探讨在多维数据以及大表与小表之外场景的Map Join策略。

### 5.1.1 多维数据的Map Join策略

多维数据通常包含多个字段,需要进行复杂的联接操作,Map Join在这种场景中可以减少数据的洗牌(Shuffle),提高查询效率。例如,在数据仓库的星型模型中,事实表与维度表的联接操作是常见的数据处理任务。

#### 实现步骤

1. **数据准备阶段**:将维度表加载到内存中,以Map端联接的方式准备联接键值对。

2. **数据清洗**:对事实表进行过滤和转换,以确保其键值与维度表匹配。

3. **Map Join执行**:在Map阶段,根据键值对将事实表中的记录与内存中的维度表进行联接。

4. **结果输出**:处理完毕后,输出到磁盘或直接加载到内存中供下一轮处理使用。

```scala

// 示例:在Spark中执行Map Join的简化伪代码

val dimensionTable = sc.broadcast(loadDimensionTableToMemory())

val factRecords = sc.textFile("path/to/fact_data")

val joinedData = factRecords.map { record =>

val key = extractKey(record)

(key, record)

}.join(dimensionTable.value)

.values

.collect()

```

#### 性能考量

在多维数据联接时,内存管理变得尤为重要。大数据框架会尽量利用内存缓存数据,减少磁盘I/O操作。需要注意的是,维度表的大小必须能够在内存中容纳,否则需要考虑其他联接策略。

#### 适用场景

多维数据的Map Join适用于数据仓库、数据湖等对读取效率要求较高的场景。在某些实时数据处理场景中,也可使用Map Join策略,但由于内存限制,可能需要采用优化后的变体。

### 5.1.2 大表与小表之外的优化方法

在大数据处理中,不仅仅有大表与小表的联接,还存在大表与中等大小表、甚至是两个大表之间的联接操作。在这些场景下,传统的Map Join可能不再适用,需要一些创新的优化方法。

#### 双小表合并策略

如果两个参与联接的表都较小,可以通过一个Map Join操作先将它们合并为一个小表,然后进行后续处理。这要求两个表的大小能够一起放入内存。

```sql

SELECT /*+ MAPJOIN(small_table) */ *

FROM big_table, small_table1, small_table2

WHERE big_table.key = small_table1.key AND big_table.key = small_table2.key;

```

#### 数据分区策略

另一个常见的优化是使用数据分区。通过对大表进行分区,可以限制数据洗牌的范围,每个Map任务只处理有限的分区数据。

```java

// 伪代码示例:在Hadoop中对大表进行分区操作

JobConf conf = new JobConf(getConf(), MyJob.class);

FileInputFormat.setInputPaths(conf, new Path[] {inputPath1, inputPath2});

JobClient.runJob(conf);

```

#### 分布式缓存

在某些情况下,可以使用分布式缓存技术将关键数据(如小表)缓存在所有节点的内存中,以减少数据传输和洗牌。

#### 性能考量

在处理大表与大表之间的联接时,主要的性能考量是减少数据洗牌的数量和减少I/O开销。这可能意味着更细致地调整MapReduce作业的执行参数,或者使用更高级的执行计划,如基于成本的优化器。

#### 适用场景

这些方法适用于数据量庞大但可以预见到性能瓶颈的场景,如大型在线分析处理(OLAP)环境、大数据ETL作业,以及任何需要高效数据联接的业务智能应用。

## 5.2 Map Join与数据仓库

数据仓库系统中存储的数据通常具有高度的规范化和复杂性,数据倾斜和大表联接是常见的性能瓶颈问题。本节将探讨在数据仓库中运用Map Join技术的方法。

### 5.2.1 数据仓库中的数据倾斜问题

数据倾斜是数据仓库环境中常见的问题,尤其是在处理大表或事实表与维度表联接操作时。Map Join技术可以用于缓解数据倾斜问题,因为它减少了跨节点的数据洗牌。

#### 数据倾斜的原因及影响

数据倾斜通常是由于数据分布不均匀导致的,部分节点上的任务需要处理比其他节点多得多的数据量。这会导致某些任务先于其他任务完成,进而引发资源浪费和延迟增加。

#### 解决方案

解决数据倾斜的策略包括:

- **重新划分数据**:通过创建更均匀的数据分布,如通过哈希或范围分区。

- **增加并行度**:在Map端和Reduce端都增加执行任务的并行度。

- **使用Map Join**:减少洗牌,减轻倾斜带来的负面影响。

#### 实施Map Join的注意事项

在数据仓库中实施Map Join时需要考虑:

- **内存大小**:确保内存能够容纳参与联接的小表。

- **数据版本**:数据仓库中数据的静态特性使得Map Join更为合适。

- **数据实时性**:数据仓库中的数据通常是历史数据,较少发生变动。

### 5.2.2 Map Join在ETL流程中的应用

在ETL(抽取、转换、加载)流程中,Map Join技术可以作为数据预处理和联接操作的重要组件。ETL流程往往包含大量的数据联接操作,Map Join在此可以发挥其在减少数据转移方面的优势。

#### ETL中数据联接的需求

ETL流程中的数据联接操作通常需要:

- 处理多个数据源。

- 高效地执行数据清洗和转换。

- 快速地完成数据加载。

#### Map Join的优势

Map Join可以:

- 减少网络I/O开销。

- 提升数据处理的吞吐量。

- 降低延迟。

#### 应用案例

在实际案例中,一家零售企业使用Map Join优化其销售数据与库存数据的联接操作,使得整个ETL过程的时间减少了约30%。

在本章节中,我们深入探讨了Map Join在处理复杂数据结构和数据仓库应用中的高级应用场景。通过分析具体的实现策略、性能考量以及案例应用,我们进一步理解了Map Join如何解决传统大数据处理中的一些难题。随着大数据处理技术的不断发展,Map Join技术将继续在各种应用场景中扮演重要角色,并不断被优化和创新。

# 6. Map Join技术的未来展望

随着技术的不断进步和数据量的日益增长,Map Join技术在未来大数据处理领域中的角色将继续扩大。新出现的技术,如分布式流处理和云原生计算环境,对Map Join技术提出了新的挑战和机遇。

## 6.1 Map Join在新兴技术中的角色

### 6.1.1 分布式流处理中的Map Join

分布式流处理框架如Apache Kafka Streams、Apache Flink等,它们允许实时处理大量的数据流。在这些框架中,Map Join可以用于实时合并两个流的数据或者合并流与状态存储中的数据。

例如,在Apache Flink中,我们可以利用广播状态模式来实现类似于Map Join的操作。数据流被广播到每一个并行任务中,然后通过键值关联与另一个流进行连接操作。这种方式要求设计合理的键选择和缓冲策略,以避免内存溢出,并确保处理的实时性。

```java

// 伪代码示例

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

DataStream<Record> stream1 = env.addSource(...); // 数据流1

DataStream<Record> stream2 = env.addSource(...); // 数据流2

stream1.keyBy("key").connect(stream2.broadcast(stateDescriptor))

.process(new MyBroadcastJoinFunction());

```

### 6.1.2 云原生环境下Map Join的挑战与机遇

云原生环境为大数据处理提供了可扩展、可弹性伸缩的资源。在这样的环境下,Map Join需要适应动态资源分配带来的影响,比如在不同的计算节点上执行Map Join时,数据传输和处理效率可能会受到影响。

容器化和Kubernetes技术的兴起使得大数据工作负载可以更加灵活地部署。Map Join的优化可以包括优化容器资源请求和限制、利用持久化存储以及确保网络策略的高效性。这要求深入理解云原生基础设施的细节,以便为Map Join选择最优的执行策略。

## 6.2 Map Join的创新方向与研究

### 6.2.1 自适应Map Join机制

自适应Map Join机制会根据数据的实际分布和查询负载自动调整执行策略。这种机制通常会涉及复杂的决策算法和机器学习技术来预测数据的分布情况。

例如,系统可能会基于历史数据的分析,动态调整Map端和Reduce端的处理逻辑,使得数据处理更加灵活。此外,自适应机制还可以根据实时的系统负载和资源使用情况,动态分配资源以达到最优的处理效率。

### 6.2.2 机器学习与Map Join的结合

将机器学习技术引入Map Join的优化过程,可以更好地预测和优化数据倾斜和数据传输问题。例如,机器学习模型可以预测在执行Map Join时哪些键可能会导致倾斜,并据此提出优化建议,如预分割数据或调整执行计划。

一个可能的场景是,使用聚类算法预先识别出潜在的数据倾斜问题,并针对性地提出解决方案。另一个场景是,利用机器学习模型预测数据倾斜的发生,并动态地调整任务分配策略来避免倾斜的发生。

在所有这些前沿探索中,对Map Join技术的深入理解和不断的技术创新是必不可少的。随着技术的演进,Map Join将继续在大数据处理中扮演着重要角色,它的未来充满了挑战也充满了机遇。

0

0