R语言数据清洗实战:规则设定与数据包应用完整教程

发布时间: 2024-11-05 16:31:06 阅读量: 38 订阅数: 24

MATLAB辅助Bootstrap区间预测技术:完整源码与数据包解读及实战应用指南,MATLAB实战:基于Bootstrap方法的区间预测系统(含完整源码、数据及多指标分析),MATLAB实现基于Bo

# 1. R语言数据清洗基础概念

在数据分析过程中,数据清洗作为至关重要的一步,其目标是通过移除不一致、错误或不完整的数据,确保数据的准确性和可用性。数据清洗不仅仅是一项技术活,它需要在理解数据的基础上,采取科学的方法论来进行。R语言作为强大的统计分析工具,提供了丰富的数据处理包和函数,能够高效地完成数据清洗任务。本章将介绍数据清洗的基本概念,阐述为什么要进行数据清洗,以及R语言在数据清洗中的优势和应用前景。通过对数据清洗的理解和初步认识,我们将为深入学习R语言数据清洗打下坚实的基础。

# 2. 数据规则的建立与应用

## 2.1 数据类型和结构的理解

### 2.1.1 R语言中的基本数据类型

在R语言中,数据类型分为原子型和复合型两大类。原子型数据包括数值型(numeric)、整型(integer)、字符型(character)、逻辑型(logical)和复数型(complex)。复合型数据则是由原子型数据组合起来的,比如向量(vector)、矩阵(matrix)、数组(array)、数据框(data.frame)和列表(list)。

#### 数值型(numeric)

数值型数据用来存储浮点数。在R中,默认情况下,当我们创建一个没有明确声明为整型的数字时,它就是数值型的。

```r

numeric_data <- 1.23

print(numeric_data)

```

#### 整型(integer)

整型数据专门用来存储整数。在声明时需要在数字后面加上`L`后缀。

```r

integer_data <- 2L

print(integer_data)

```

#### 字符型(character)

字符型数据用来存储文本信息。字符型数据总是用引号括起来。

```r

character_data <- "hello"

print(character_data)

```

#### 逻辑型(logical)

逻辑型数据只有两个值:TRUE 或 FALSE。它们通常用于逻辑判断。

```r

logical_data <- TRUE

print(logical_data)

```

#### 复数型(complex)

复数型数据表示复数,由实部和虚部组成,用`i`表示虚部。

```r

complex_data <- 1 + 2i

print(complex_data)

```

### 2.1.2 数据结构的分类与特点

#### 向量(vector)

向量是R中最基本的数据结构,它可以包含多种数据类型,但通常来说,向量中的数据类型是统一的。可以使用`c()`函数来创建向量。

```r

vector_data <- c(1, 2, 3, "four", TRUE, 5+6i)

print(vector_data)

```

向量的数据类型可以通过`typeof()`函数来识别。

#### 矩阵(matrix)

矩阵是一种二维数据结构,其中的元素必须是相同类型的数据。可以用`matrix()`函数来创建。

```r

matrix_data <- matrix(1:9, nrow = 3, ncol = 3)

print(matrix_data)

```

#### 数组(array)

数组是一种多维数据结构,可以看做是矩阵的推广。`array()`函数用于创建数组。

```r

array_data <- array(1:12, dim = c(2, 3, 2))

print(array_data)

```

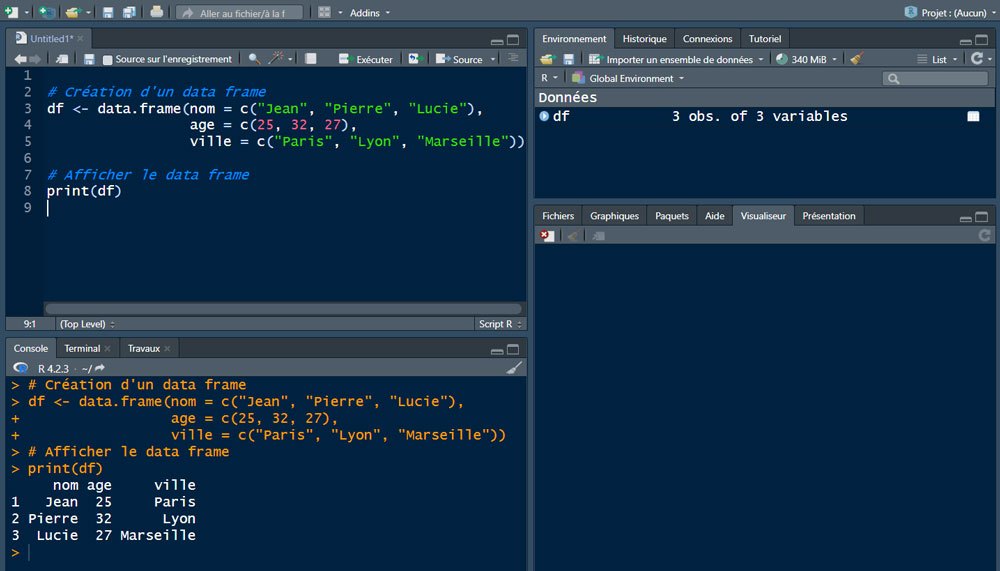

#### 数据框(data.frame)

数据框是R中用于存储表格数据的主要结构,允许包含不同类型的数据列。数据框通过`data.frame()`函数来创建。

```r

data_frame_data <- data.frame(

integer_column = 1:3,

character_column = c("A", "B", "C"),

logical_column = c(TRUE, FALSE, TRUE)

)

print(data_frame_data)

```

#### 列表(list)

列表是R中可以包含任意类型数据结构的通用容器。列表通过`list()`函数创建。

```r

list_data <- list(

vector_data = c(1, 2, 3),

matrix_data = matrix_data,

data_frame_data = data_frame_data

)

print(list_data)

```

对于R语言的初学者来说,理解上述的数据类型和结构是至关重要的一步。这不仅有助于理解数据在内存中的存储方式,而且对于后续学习数据的处理和分析至关重要。而想要深入掌握数据清洗,首先就需要对这些基础数据类型和结构有着清晰的认识,才能够有效地利用R语言进行数据的探索、清洗和准备。

## 2.2 数据清洗规则的设计

### 2.2.1 规则设定的理论基础

数据清洗是数据预处理的一个重要环节,它包括了识别、纠正或删除数据集中不准确、不完整或无关的数据。设计数据清洗规则的理论基础是识别数据中的错误或不一致性,并建立一套系统性的方法来修正或删除这些错误。

数据清洗规则的设计通常遵循以下步骤:

1. 数据探索:了解数据内容、数据结构、数据质量。

2. 错误识别:发现数据中的错误或不一致性,如缺失值、异常值、数据类型错误。

3. 规则建立:根据识别到的问题建立相应的清洗规则。

4. 规则应用:应用这些规则到数据集中,进行数据的清洗和修正。

5. 结果评估:评估清洗后数据的质量,确保规则的应用达到了预期效果。

### 2.2.2 实际案例分析

以一个零售行业数据集为例,我们可能会发现以下几种常见的数据问题:

- 缺失值:一些销售记录的客户地址缺失。

- 异常值:某些产品的销售量异常高或低,可能是数据录入错误。

- 不一致数据:产品分类信息存在多种不同的表述方式。

对于上述问题,我们可以建立以下清洗规则:

- 缺失值处理:对于客户地址的缺失值,可以选择用平均地址或主要地址填充,或者直接删除这些记录。

- 异常值处理:根据业务逻辑设定阈值,识别并修正或删除超出阈值的异常数据。

- 数据标准化:统一产品分类信息的表述,确保数据的一致性。

通过设计出合理的清洗规则,我们可以对数据进行规范化处理,为后续的数据分析和挖掘打下良好的基础。

## 2.3 数据清洗工具包的选择与安装

### 2.3.1 常用数据清洗包的介绍

在R语言中,有多个数据清洗相关的包可以帮助我们高效地进行数据预处理。以下是几个常用的包:

- `dplyr`:提供了一系列函数,用于数据的筛选、排序、分组、聚合等操作。

- `tidyr`:特别擅长处理数据的整洁性问题,如数据的拆分、合并、重塑等。

- `stringr`:用于字符串操作,提供了对正则表达式的支持。

- `forcats`:专门处理因子类型的数据,用于管理分类变量。

这些包都是`tidyverse`这个更大生态系统的一部分,它是由一系列数据科学相关的R包构成,目的是为了提供一套高效且一致的数据操作方式。

### 2.3.2 包的安装与加载方法

安装一个包的方法非常简单,可以使用`install.packages()`函数:

```r

install.packages("dplyr")

```

安装完毕后,要使用包中的函数或数据,需要先加载该包,使用`library()`函数:

```r

li

```

0

0