知识蒸馏的最佳实践:从专家那里学习模型压缩的技巧

发布时间: 2024-08-22 16:45:26 阅读量: 69 订阅数: 31

YOLOv11模型优化:知识蒸馏技术的应用与实践

# 1. 知识蒸馏概述

**1.1 知识蒸馏的概念**

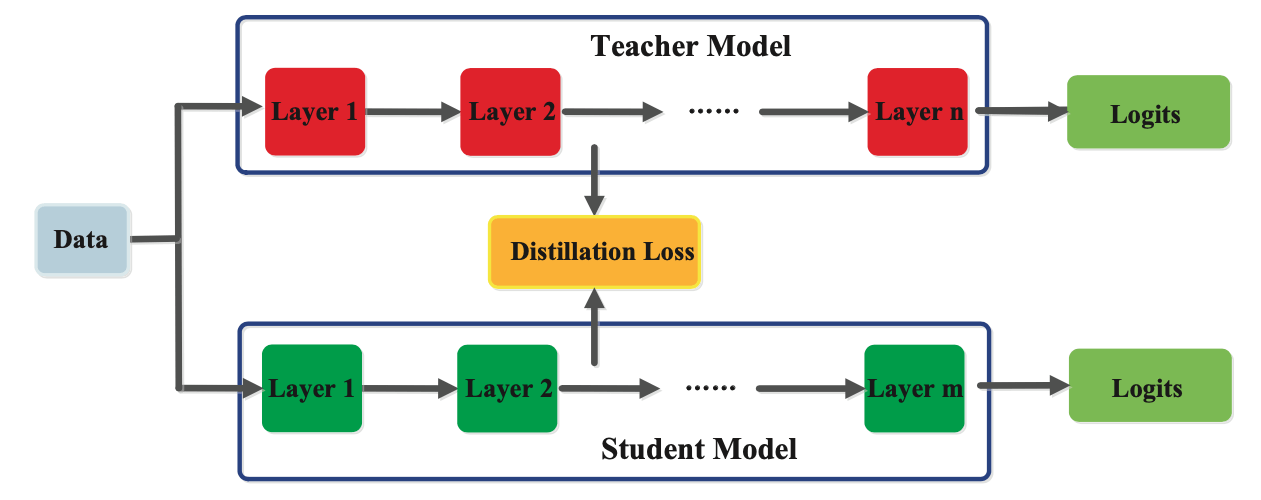

知识蒸馏是一种机器学习技术,它允许一个大型、复杂的模型(称为教师模型)将其知识转移给一个较小、较简单的模型(称为学生模型)。通过这种方式,学生模型可以获得与教师模型相似的性能,同时具有更小的模型大小和更快的推理时间。

**1.2 知识蒸馏的优势**

知识蒸馏提供了以下优势:

* **模型压缩:**学生模型比教师模型小得多,这使其更适合于资源受限的设备。

* **推理速度:**学生模型的推理速度比教师模型快得多,这使其适用于实时应用程序。

* **鲁棒性:**学生模型通常比教师模型更鲁棒,因为它从教师模型中学到了知识,而不是仅仅拟合训练数据。

# 2.1 知识蒸馏的概念和原理

### 知识蒸馏的定义

知识蒸馏是一种机器学习技术,它允许一个大型、复杂的神经网络(称为教师模型)将其知识转移到一个较小、更简单的网络(称为学生模型)。教师模型通常在大量的数据集上进行训练,因此包含丰富的知识和模式。学生模型则在较小的数据集上进行训练,并且通过蒸馏过程从教师模型中学习。

### 蒸馏原理

知识蒸馏的基本原理是通过最小化教师模型和学生模型之间的差异来实现知识转移。具体来说,蒸馏过程涉及以下步骤:

1. **训练教师模型:**教师模型在大量的数据集上进行训练,直到达到较高的准确率。

2. **初始化学生模型:**学生模型是一个较小、更简单的网络,通常在较小的数据集上进行初始化。

3. **定义损失函数:**损失函数衡量教师模型和学生模型之间的差异。它通常包括以下组件:

- **分类损失:**衡量教师模型和学生模型在分类任务上的差异。

- **软标签损失:**鼓励学生模型产生更平滑、更分布式的预测,类似于教师模型。

- **蒸馏损失:**直接衡量教师模型和学生模型的中间特征或输出之间的差异。

4. **优化损失函数:**使用优化算法(如梯度下降)最小化损失函数,从而调整学生模型的参数。

5. **评估学生模型:**训练后,评估学生模型在测试数据集上的性能,以验证知识蒸馏的有效性。

### 蒸馏损失函数

蒸馏损失函数是知识蒸馏过程中的关键组件。它定义了教师模型和学生模型之间的差异,并指导学生模型的训练。常用的蒸馏损失函数包括:

- **均方误差(MSE):**衡量教师模型和学生模型的输出之间的平方误差。

- **交叉熵损失:**用于分类任务,衡量教师模型和学生模型的预测分布之间的交叉熵。

- **知识蒸馏(KD)损失:**直接衡量教师模型和学生模型的中间特征之间的差异。

选择合适的蒸馏损失函数取决于任务的性质和教师模型和学生模型的架构。

# 3.1 数据准备和预处理

**数据收集和选择**

知识蒸馏的成功很大程度上取决于训练数据的质量和相关性。在数据准备阶段,需要考虑以下因素:

- **数据量:**一般来说,数据量越大,蒸馏模型的性能越好。但是,对于某些任务,使用较小的数据集也可以获得良好的结果。

- **数据质量:**数据应该准确、完整且没有噪音。脏数据或不一致的数据可能会损害蒸馏模型的性能。

- **数据相关性:**训练数据应该与蒸馏任务相关。例如,如果蒸馏目标是图像分类模型,则训练数据应该包含与目标任务相似的图像。

**数据预处理**

数据预处理是将原始数据转换为适合知识蒸馏模型训练的格式的过程。常见的预处理技术包括:

- **数据标准化:**将数据缩放或归一化到一个特定的范围,以提高训练稳定性和模型性能。

- **数据增强:**通过随机裁剪、翻转和旋转等技术,增加训练数据的多样性,以提高模型的泛化能力。

- **特征工程:**从原始数据中提取有用的特征,以提高模型的性能。

### 3.2 模型训练和评估

**模型选择**

知识蒸馏模型的选择取决于蒸馏任务的复杂性和可用资源。常用的模型类型包括:

- **教师模型:**一个大型且性能良好的模型,用于指导学生模型的训练。

- **学生模型:**一个较小且性能较差的模型,将从教师模型中获取知识。

**损失函数**

损失函数衡量学生模型和教师模型之间的差异。常用的损失函数包括:

- **均方误差 (MSE):**衡量预测值和真实值之间的平方差。

- **交叉熵损失:**用于分类任务,衡量预测概率分布和真实概率分布之间的差异。

- **知识蒸馏损失:**专门设计用于知识蒸馏,考虑了学生模型和教师模型之间的知识差异。

**优化算法**

优化算法用于最小化损失函数并训练学生模型。常用的优化算法包括:

- **随机梯度下降 (SGD):**一种简单且有效的优化算法,每次迭代更新模型参数。

- **Adam:**一种自适应优化算法,可以自动调整学习率,加快训练速度。

**模型评估**

在训练过程中,需要定期评估学生模型的性能。常用的评估指标包括:

- **准确率:**预测正确的样本数量与总样本数量的比率。

- **召回率:**预测为正例的正例数量与所有正例数量的比率。

- **F1 分数:**准确率和召回率的调和平均值。

### 3.3 蒸馏过程的监控和调整

**监控蒸馏过程**

在蒸馏过程中,需要监控以下指标:

- **

0

0