数据重塑与透视表:Pandas数据汇总艺术详解

发布时间: 2024-11-22 05:27:07 阅读量: 19 订阅数: 20

python数据分析与可视化

# 1. 数据重塑与透视表的理论基础

在数据分析和数据科学的世界中,数据重塑与透视表是关键的概念,它们构成了数据处理和商业智能分析的基石。数据重塑涉及将数据从一种格式转换为另一种格式,以便更好地进行分析或可视化。而透视表是一种特殊类型的表格,能够快速汇总和展示大型数据集中的关键信息。

## 理论基础

数据重塑的理论基础包括了数据的宽格式(宽表)与长格式(长表)转换,这两种格式各有优劣,适应于不同的数据分析和处理场景。宽格式数据集中每个变量都有自己的列,适合进行数据查询和比较;而长格式数据则将每个变量和对应的值放在单独的行中,适合进行数据的统计和分析。理解这些基础概念对于有效运用数据重塑技术至关重要。

数据透视表则提供了将数据进行分组、聚合,并以易于理解的表格形式展现复杂数据集的方法。无论是进行数据汇总、计算比例,还是进行交叉分析,透视表都能以直观的方式揭示数据背后的故事。通过学习和实践,数据分析师可以熟练地运用这些工具来优化数据处理流程,提高工作效率。

# 2. Pandas中的数据清洗与预处理

在数据科学的实践中,数据清洗和预处理是不可忽视的重要步骤。一个准确无误的数据集为后续的数据分析、建模和可视化工作打下坚实的基础。Python中的Pandas库以其强大的数据处理功能而广受数据分析师的青睐。本章将深入探讨Pandas中的数据清洗与预处理技术。

## 2.1 Pandas的基本数据结构

### 2.1.1 Series与DataFrame的创建和操作

Pandas库中的两个基本数据结构是Series和DataFrame。Series是一维的标签数组,可以保存任何数据类型(整数、字符串、浮点数、Python对象等)。而DataFrame则是一个二维的标签数据结构,可以看作是一个表格或者说是Series对象的容器。

创建和操作这些结构的基本代码示例如下:

```python

import pandas as pd

# 创建Series

s = pd.Series([1, 2, 3, 4], index=['a', 'b', 'c', 'd'])

# 创建DataFrame

df = pd.DataFrame({'A': [1, 2, 3], 'B': [4, 5, 6]})

# 显示DataFrame的前五行

print(df.head())

```

执行逻辑说明:

1. 首先,导入pandas库,并通过pd作为别名。

2. 使用`pd.Series()`创建一个Series对象,其中包含4个元素和对应的标签。

3. 使用`pd.DataFrame()`创建一个DataFrame对象,其中包含两列数据。

4. 使用`.head()`方法查看DataFrame的前五行数据。

参数说明:

- `pd.Series()`中`index`参数定义了数据的标签。

- `pd.DataFrame()`接受字典格式的输入数据。

### 2.1.2 数据类型和缺失值处理

Pandas提供了直观和高效的方式来处理数据类型转换和缺失值。例如,可以通过`.dtypes`属性来查看数据类型,使用`.fillna()`方法来填充缺失值。

```python

# 查看数据类型

print(df.dtypes)

# 处理缺失值

df.fillna(value=0, inplace=True)

```

执行逻辑说明:

1. 使用`.dtypes`属性可以查看DataFrame中各列的数据类型。

2. 使用`.fillna(value=0, inplace=True)`方法可以将所有缺失值填充为0。参数`inplace=True`表示直接在原DataFrame上进行修改,否则返回一个新的DataFrame。

参数说明:

- `value`用于填充缺失值的值。

- `inplace=True`在原地修改DataFrame,不返回新的对象。

## 2.2 数据清洗技巧

### 2.2.1 数据筛选与过滤

数据筛选是根据一定的条件选择数据集的子集。在Pandas中,这通常通过布尔索引来实现。

```python

# 数据筛选示例

filtered_df = df[df.A > 2]

```

执行逻辑说明:

1. 通过`df.A > 2`创建一个布尔索引,返回一个Series,其值为True或False。

2. 使用这个布尔索引筛选出原DataFrame中满足条件的行。

参数说明:

- `df.A > 2`是条件表达式,用于生成布尔索引。

### 2.2.2 字符串操作和条件替换

字符串操作允许你对存储为字符串的列进行修改和提取信息。Pandas提供了`.str`访问器来进行这些操作。

```python

# 字符串操作示例

df['C'] = df['B'].astype(str).str.upper()

```

执行逻辑说明:

1. 将`df['B']`列的数据转换为字符串类型,然后使用`.str.upper()`方法将所有字符转换为大写。

参数说明:

- `.str.upper()`将字符串转换为大写形式。

### 2.2.3 重复数据和异常值处理

重复数据的处理涉及检测和删除数据集中重复的行或列。异常值则需要根据数据的上下文来定义,然后决定如何处理。

```python

# 删除重复数据

df.drop_duplicates(inplace=True)

# 异常值处理示例(假设已定义异常值条件)

df.loc[df['A'] < 0, 'A'] = None

```

执行逻辑说明:

1. 使用`.drop_duplicates(inplace=True)`方法删除DataFrame中的重复行。

2. 使用`.loc`方法定位到A列中所有小于0的行,并将这些行的值设置为None。

参数说明:

- `inplace=True`表示在原地修改DataFrame。

## 2.3 数据融合与数据透视

### 2.3.1 合并数据集的方法

在数据处理中,有时需要将多个数据集合并为一个。Pandas提供多种合并方法,最常用的是`.merge()`方法。

```python

# 合并数据集示例

merged_df = pd.merge(df1, df2, on='A')

```

执行逻辑说明:

1. 使用`.merge()`方法,通过键`'A'`来合并`df1`和`df2`两个DataFrame。

参数说明:

- `on`参数指明了用于合并的键。

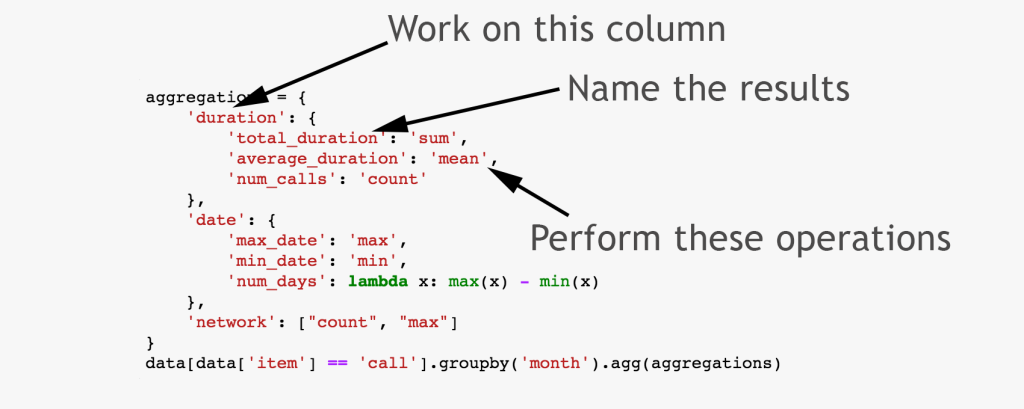

### 2.3.2 数据分组和聚合操作

分组和聚合操作是数据分析中常见的操作,Pandas通过`.groupby()`方法提供分组功能,通过聚合方法如`.mean()`、`.sum()`等进行聚合计算。

```python

# 数据分组和聚合操作示例

grouped_df = df.groupby('A').sum()

```

执行逻辑说明:

1. 使用`.groupby('A')`方法将DataFrame按照'A'列的值进行分组。

2. 然后使用`.sum()`方法计算每个分组的总和。

参数说明:

- `.sum()`是聚合方法之一,用于计算总和。

通过本章的介绍,我们可以了解到Pandas在数据清洗和预处理中的强大功能和灵活性。下一章节将探讨如何通过Pandas实现数据的重塑,将数据从一个格式转换为另一个格式以满足不同分析需求。

# 3. 数据重塑的艺术

数据重塑是数据处理过程中的核心技能,它能够将数据从一种结构转换为另一种结构,以满足不同的分析需求。在数据科学和商业智能的实践中,数据重塑可以帮助我们整合和重构数据,从而深入挖掘数据中的模式和趋势。

## 3.1 理解数据重塑的概念

数据重塑不仅仅是技术操作,更是一种分析思维的体现。了解数据重塑的概念和场景对于任何数据分析师和工程师来说至关重要。

### 3.1.1 数据重塑的目标和意义

数据重塑的目标是将数据的格式调整为更适合分析和展示的形式。这通常意味着将数据从宽格式(每个变量为一列)转换为长格式(多个变量构成两列),或者相反。数据重塑的意义在于,它能够帮助我们更清晰地理解数据中的信息,并且在数据挖掘和可视化中提供更多的灵活性。

### 3.1.2 常见的数据重塑场景

在数据分析的实践中,数据重塑通常出现在以下场景:

- 集合数据:当需要将不同时间点或不同条件下的数据集合并在一起时。

- 数据报告:需要生成定期报告,数据需按照特定格式组织。

- 数据分析:特定的分析方法要求数据遵循特定的格式。

- 数据可视化:图表和可视化工具往往需要特定格式的数据。

## 3.2 实现数据重塑的技术

在Pandas库中,有几个强大的函数可以帮助我们实现数据的重塑。

### 3.2.1 melt函数:从宽格式到长格式

`melt()`函数可以将宽格式数据转换为长格式。这在数据整合和清理过程中非常有用。

```python

import pandas as pd

# 创建一个宽格式的DataFrame作为例子

df_wide = pd.DataFrame({

'Date': ['2021-01-01', '2021-01-01', '2021-02-01', '2021-02-01'],

'Product': ['A', 'B', 'A', 'B'],

'Sales': [100, 200, 250, 300],

'Profit': [50, 100, 125, 150]

})

# 使用melt转换为长格式

df_long = df_wide.melt(id_vars=['Date', 'Product'], var_name='Metric', value_name='Amount')

print(df_long)

```

在上述代码中,`id_vars`参数指定了在转换过程中保持不变的列,而`var_name`和`value_name`参数分别指定了新的列名。

### 3.2.2 pivot函数:从长格式到宽格式

`pivot()`函数则用于将长格式数据转换为宽格式。这对于创建报告或图表时调整数据布局特别有用。

```python

# 使用pivot转换为宽格式

df_wide = df_long.pivot(index='Date', columns='Metric', values='Amount')

print(df_wide)

```

在上述代码中,`index`参数指定了新表格的行索引,`columns`参数指定了新表的列标题,而`values`参数指定了填充值。

### 3.2.3 stack与unstack:多层索引的转换

`stack()`和`unstack()`方法则用于将DataFrame的列转

0

0