MySQL数据库数据导入导出实战:高效管理数据,应对数据迁移与备份需求

发布时间: 2024-07-17 03:51:28 阅读量: 45 订阅数: 40

# 1. MySQL数据库数据导入导出概述**

数据导入导出是数据库管理中的常见操作,用于在不同数据库实例或不同格式之间移动数据。MySQL数据库提供了多种数据导入导出方法,可以满足不同的需求。

**数据导入**是指将外部数据源中的数据加载到MySQL数据库中。**数据导出**是指将MySQL数据库中的数据提取到外部文件中或其他数据库中。

本章将概述MySQL数据库数据导入导出的基本概念、常见方法和优化技巧,为读者提供一个全面的指南。

# 2. 数据导入实践

### 2.1 数据导入的准备工作

在进行数据导入之前,需要做好充分的准备工作,以确保导入过程的顺利进行。主要包括以下两个方面:

#### 2.1.1 导出数据源的准备

- 确认数据源数据库的版本和字符集。

- 确保数据源数据库中拥有要导入数据的权限。

- 确定要导出的数据范围,包括数据库、表和具体数据行。

- 选择合适的导出格式,如 CSV、JSON 或 SQL。

#### 2.1.2 导入目标数据库的准备

- 确认目标数据库的版本和字符集与导出数据源一致。

- 确保目标数据库中拥有导入数据的权限。

- 创建要导入数据的数据库和表,并设置适当的字段类型和约束。

- 根据导入数据的格式,调整目标数据库的设置,如字符集和字段分隔符。

### 2.2 常见的数据导入方法

#### 2.2.1 使用 MySQL 命令行工具

```

mysqldump -u username -p password database_name table_name > dump.sql

```

**参数说明:**

- `-u username`: 指定 MySQL 用户名。

- `-p password`: 指定 MySQL 密码。

- `database_name`: 指定要导出的数据库名称。

- `table_name`: 指定要导出的表名称。

- `> dump.sql`: 指定导出的文件路径和文件名。

**逻辑分析:**

该命令使用 `mysqldump` 工具将指定数据库和表的数据导出到一个 SQL 文件中。

```

mysql -u username -p password database_name < dump.sql

```

**参数说明:**

- `-u username`: 指定 MySQL 用户名。

- `-p password`: 指定 MySQL 密码。

- `database_name`: 指定要导入数据的数据库名称。

- `< dump.sql`: 指定要导入的 SQL 文件路径和文件名。

**逻辑分析:**

该命令使用 `mysql` 工具将 SQL 文件中的数据导入到指定数据库中。

#### 2.2.2 使用第三方工具(如 Navicat)

第三方工具,如 Navicat,提供了图形化界面,可以方便地进行数据导入操作。具体步骤如下:

- 连接到导出数据源数据库。

- 选择要导出的数据库和表。

- 选择导出格式。

- 指定导出文件路径和文件名。

- 点击“导出”按钮。

- 连接到目标数据库。

- 选择要导入数据的数据库和表。

- 选择导入格式。

- 指定导入文件路径和文件名。

- 点击“导入”按钮。

### 2.3 数据导入的优化技巧

#### 2.3.1 优化导入速度

- **使用多线程导入:**可以使用 `--threads` 参数指定导入线程数,以并行导入数据。

- **调整缓冲区大小:**可以使用 `--bulk-insert-buffer-size` 参数调整缓冲区大小,以提高导入速度。

- **禁用外键约束:**在导入过程中,可以暂时禁用外键约束,以提高导入速度。

- **使用 INSERT IGNORE:**可以使用 `INSERT IGNORE` 语句导入数据,忽略重复数据,以提高导入速度。

#### 2.3.2 处理数据冲突

- **使用 REPLACE INTO:**可以使用 `REPLACE INTO` 语句导入数据,覆盖已存在的重复数据。

- **使用 ON DUPLICATE KEY UPDATE:**可以使用 `ON DUPLICATE KEY UPDATE` 语句导入数据,更新已存在的重复数据。

- **使用 INSERT ... ON CONFLICT:**可以使用 `INSERT ... ON CONFLICT` 语句导入数据,根据冲突条件执行不同的操作。

# 3. 数据导出实践

### 3.1 数据导出的准备工作

#### 3.1.1 确定导出数据范围

在导出数据之前,需要明确需要导出的数据范围,包括:

- **导出表:**指定需要导出的具体表,可以是单个表或多个表。

- **导出字段:**选择需要导出的字段,可以是所有字段或指定部分字段。

- **导出条件:**根据特定条件筛选需要导出的数据,例如:时间范围、数据状态等。

#### 3.1.2 选择导出格式

MySQL支持多种导出格式,包括:

- **CSV(逗号分隔值):**以逗号分隔字段,适用于数据分析和加载到其他系统。

- **JSON(JavaScript对象表示法):**以JSON格式导出数据,便于在Web应用程序和API中使用。

- **XML(可扩展标记语言):**以XML格式导出数据,适用于数据交换和存储。

- **SQL转储文件:**以SQL语句的形式导出数据,可以用于在其他MySQL数据库中重建数据。

选择导出格式时,需要考虑数据的用途和兼容性。

### 3.2 常见的数据导出方法

#### 3.2.1 使用MySQL命令行工具

使用MySQL命令行工具导出数据,可以使用`mysqldump`命令:

```bash

mysqldump -u 用户名 -p 密码 数据库名 表名 > 导出文件.sql

```

参数说明:

- `-u 用户名`:指定数据库用户名。

- `-p 密码`:指定数据库密码。

- `数据库名`:指定需要导出的数据库名称。

- `表名`:指定需要导出的表名称。

- `> 导出文件.sql`:指定导出文件的路径和名称。

#### 3.2.2 使用第三方工具(如Navicat)

第三方工具,如Navicat,提供了图形化界面,可以方便地导出数据:

1. 连接到数据库。

2. 选择需要导出的表或数据库。

3. 选择导出格式。

4. 指定导出文件的路径和名称。

5. 点击导出按钮。

### 3.3 数据导出的优化技巧

#### 3.3.1 优化导出速度

- **使用并行导出:**使用`--parallel`选项指定并行导出的线程数,可以提高导出速度。

- **使用快速导出:**使用`--quick`选项快速导出数据,但可能会导致数据不完整。

- **优化查询条件:**使用索引和适当的查询条件缩小导出数据的范围。

- **使用管道导出:**将导出命令与其他命令管道连接,例如:`mysqldump | gzip > 导出文件.sql.gz`,可以边导出边压缩,提高效率。

#### 3.3.2 压缩导出文件

- **使用gzip压缩:**使用`gzip`命令压缩导出文件,可以节省存储空间和传输时间。

- **使用bzip2压缩:**使用`bzip2`命令压缩导出文件,压缩率更高,但速度较慢。

- **使用xz压缩:**使用`xz`命令压缩导出文件,压缩率最高,但速度最慢。

# 4. 数据迁移与备份实战

### 4.1 数据迁移的准备工作

#### 4.1.1 确定迁移需求

数据迁移是指将数据从一个数据库或系统移动到另一个数据库或系统。在进行数据迁移之前,需要明确迁移需求,包括:

- **迁移目标:**明确迁移的目的,是将数据从旧系统迁移到新系统,还是在不同数据库之间迁移数据。

- **迁移范围:**确定需要迁移的数据范围,包括数据库、表、数据行等。

- **迁移时间:**确定迁移的时间窗口,避免影响业务系统正常运行。

- **迁移方式:**选择合适的迁移方式,如在线迁移、离线迁移或混合迁移。

#### 4.1.2 选择迁移工具

根据迁移需求,选择合适的迁移工具。常用的迁移工具包括:

- **MySQL命令行工具:**使用mysqldump和mysqlimport命令进行数据迁移。

- **第三方工具:**如MySQL Workbench、Navicat等,提供图形化界面,简化迁移操作。

- **专业迁移服务:**如AWS Database Migration Service,提供全托管的数据迁移服务。

### 4.2 数据迁移的具体操作

#### 4.2.1 使用MySQL命令行工具

使用mysqldump命令导出数据,然后使用mysqlimport命令导入数据。

**导出数据:**

```sql

mysqldump -u root -p --databases database_name > dump.sql

```

**导入数据:**

```sql

mysqlimport -u root -p database_name dump.sql

```

#### 4.2.2 使用第三方工具(如MySQL Workbench)

**导出数据:**

1. 打开MySQL Workbench,连接到源数据库。

2. 右键单击要导出的数据库,选择“导出”。

3. 选择导出格式(如SQL Dump)。

4. 指定导出文件路径。

**导入数据:**

1. 打开MySQL Workbench,连接到目标数据库。

2. 右键单击要导入的数据库,选择“导入”。

3. 选择导入文件路径。

4. 选择导入选项(如覆盖现有数据)。

### 4.3 数据备份的准备工作

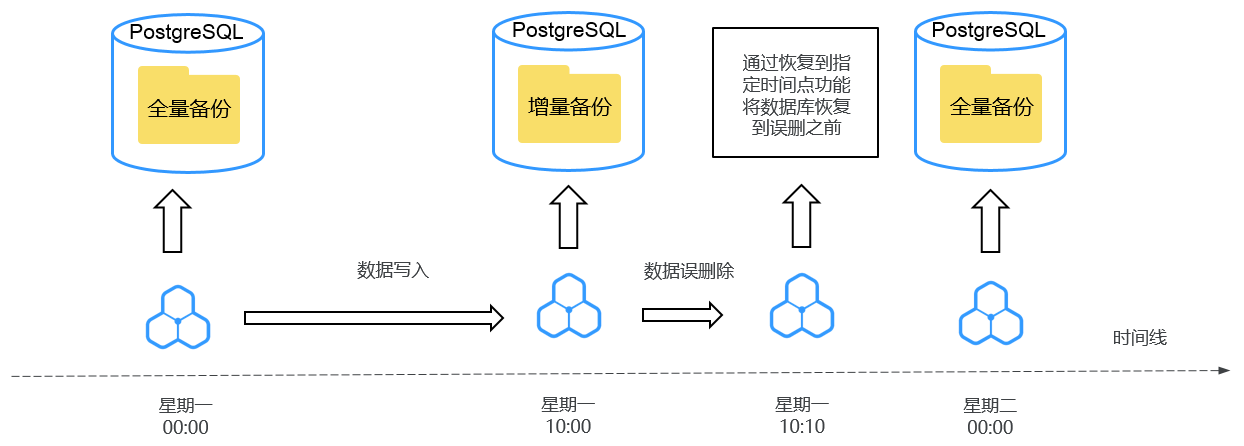

#### 4.3.1 确定备份策略

数据备份是保护数据免受意外丢失或损坏的重要措施。在进行数据备份之前,需要确定备份策略,包括:

- **备份频率:**确定备份的频率,如每天、每周或每月。

- **备份范围:**确定需要备份的数据范围,包括数据库、表、数据行等。

- **备份类型:**选择合适的备份类型,如全备份、增量备份或差异备份。

- **备份存储位置:**确定备份存储的位置,如本地存储、云存储或异地存储。

#### 4.3.2 选择备份工具

根据备份策略,选择合适的备份工具。常用的备份工具包括:

- **MySQL命令行工具:**使用mysqldump命令进行数据备份。

- **第三方工具:**如Percona XtraBackup、MySQL Enterprise Backup等,提供全面的备份功能。

- **云备份服务:**如AWS S3、Azure Blob Storage等,提供云端备份存储。

### 4.4 数据备份的具体操作

#### 4.4.1 使用MySQL命令行工具

**全备份:**

```sql

mysqldump -u root -p --all-databases > full_backup.sql

```

**增量备份:**

```sql

mysqldump -u root -p --databases database_name --incremental --master-data=2 > incremental_backup.sql

```

#### 4.4.2 使用第三方工具(如Percona XtraBackup)

**全备份:**

1. 安装Percona XtraBackup。

2. 执行以下命令:

```

innobackupex --backup --user=root --password=password /path/to/backup_directory

```

**增量备份:**

1. 执行以下命令:

```

innobackupex --incremental --user=root --password=password --incremental-basedir=/path/to/previous_backup_directory /path/to/new_backup_directory

```

# 5. 数据导入导出疑难解答**

**5.1 常见错误及解决方法**

**5.1.1 导入数据失败**

* **错误:1062 Duplicate entry 'x' for key 'PRIMARY'**

* **原因:**主键冲突。

* **解决方法:**检查导入数据是否包含重复主键,或在导入时使用 `REPLACE INTO` 语句覆盖现有数据。

* **错误:1452 Cannot add or update a child row: a foreign key constraint fails**

* **原因:**外键约束冲突。

* **解决方法:**确保导入数据中的外键值在目标数据库中存在,或在导入时使用 `SET FOREIGN_KEY_CHECKS=0` 暂时禁用外键检查。

* **错误:1048 Column 'x' cannot be null**

* **原因:**导入数据中包含空值,而目标列不允许空值。

* **解决方法:**检查导入数据是否包含空值,或在导入时使用 `SET SQL_MODE='ALLOW_INVALID_DATES'` 允许导入空值。

**5.1.2 导出数据不完整**

* **原因:**导出过程中遇到错误或中断。

* **解决方法:**重新导出数据,并确保导出过程完整无误。

* **原因:**导出权限不足。

* **解决方法:**确保导出操作拥有必要的权限,如 `SELECT` 和 `LOCK TABLES`。

**5.2 性能优化建议**

**5.2.1 优化导入速度**

* **使用多线程导入:**使用 `mysqlimport` 工具的 `--threads` 参数指定并行导入线程数。

* **使用 bulk load 导入:**使用 `LOAD DATA INFILE` 语句将数据从文件直接导入到表中。

* **禁用外键检查:**在导入过程中使用 `SET FOREIGN_KEY_CHECKS=0` 暂时禁用外键检查。

**5.2.2 优化导出速度**

* **使用并行导出:**使用 `mysqldump` 工具的 `--parallel` 参数指定并行导出线程数。

* **使用压缩导出:**使用 `mysqldump` 工具的 `--compress` 参数启用导出文件压缩。

* **使用增量导出:**使用 `mysqldump` 工具的 `--incremental` 参数仅导出自上次导出后更改的数据。

0

0