数据增强技术中常见的数据清洗操作

发布时间: 2024-04-15 07:39:23 阅读量: 96 订阅数: 44

# 1. **数据清洗的重要性**

数据清洗在数据分析和机器学习项目中至关重要。它涉及识别和纠正数据集中的错误、不完整和不准确的部分,确保数据质量和准确性。通过数据清洗,可以避免不良数据对分析结果造成的影响,提高模型的准确性和可靠性。数据清洗还有助于减少数据分析过程中出现的偏差,使决策更具信服力。因此,对于任何数据驱动的项目,都应当重视数据清洗步骤,以确保从整体上获得可靠和准确的分析结果。rowData Cleaning in Projects in Data Analysis and Machine Learning is Invarsing Data in the data. it's seemingly data as the 大道 produce the provided slightly, and improve reliability of edger, may make decisions more confidence. in Awhile must data project, should particularly to data cleaning steps, to ensure the analysis results.gain and to assure.pertable

# 2. **常见的数据质量问题**

数据质量是数据清洗的核心问题之一,常见的数据质量问题包括缺失值、重复值和异常值。解决这些问题是数据清洗的首要任务。

#### 2.1 缺失值处理

缺失值是数据中的空值或者缺失数值,会对数据分析和建模造成影响。常见的缺失值处理方法有删除缺失值、插值填充和使用模型预测填充。

##### 2.1.1 删除缺失值

删除缺失值是最简单的处理方法之一,但可能会丢失有用信息,适用于缺失值占比较少的情况。

```python

# 删除包含缺失值的行

data.dropna(inplace=True)

```

##### 2.1.2 插值填充缺失值

插值填充是根据已有值推算缺失值,常用的插值方法有线性插值、多项式插值等。

```python

# 使用线性插值填充缺失值

data['column'].interpolate(method='linear', inplace=True)

```

##### 2.1.3 使用模型预测填充缺失值

利用其他特征建立模型来预测缺失值,比如使用随机森林、神经网络等模型进行预测填充。

```python

# 使用随机森林模型填充缺失值

from sklearn.ensemble import RandomForestRegressor

rf = RandomForestRegressor()

rf.fit(X_train, y_train)

predicted_values = rf.predict(X_test)

data.loc[data['column'].isnull(), 'column'] = predicted_values

```

#### 2.2 重复值处理

重复值可能导致数据分析结果不准确,处理重复值需要先检测,然后选择合适的方法去除。

##### 2.2.1 检测重复值

检测重复值可以通过对数据集进行重复值的标记和计数来实现。

```python

# 检查重复行

duplicate_rows = data[data.duplicated()]

```

##### 2.2.2 删除重复值

删除重复值可以保证数据的唯一性,确保数据分析结果准确。

```python

# 删除重复行

data.drop_duplicates(inplace=True)

```

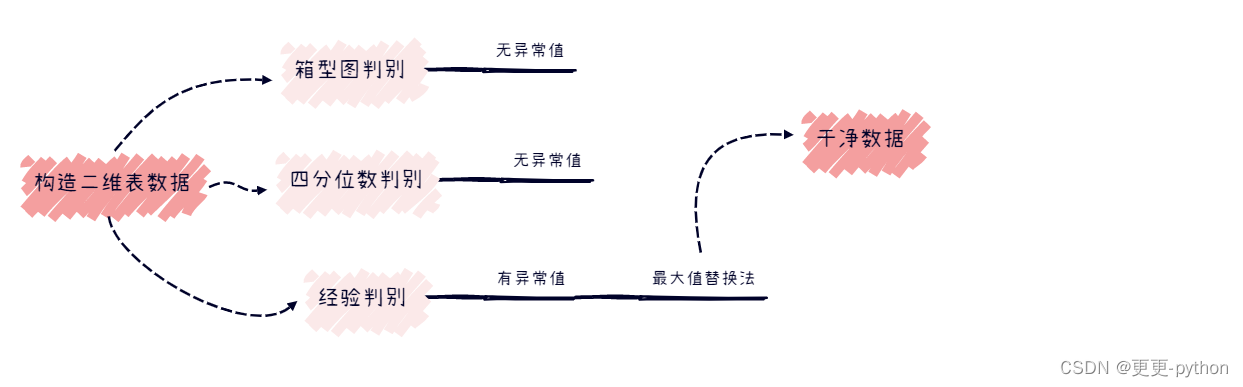

#### 2.3 异常值处理

异常值是数据中与大部分数值差异较大的数值,可能是录入错误或者数据分布不均匀导致。

##### 2.3.1 确定异常值方法

确定异常值可以通过统计方法如箱线图、3σ原则等来识别。

```python

# 使用箱线图检测异常值

plt.boxplot(data['column'])

```

##### 2.3.2 处理异常值的策略

处理异常值可以选择删除、替换或者进行数据转换来使得异常值对分析结果影响降到最低。

```python

# 将异常值替换为特定值

data.loc[data['column'] > upper_bound, 'column'] = max_value

```

综上所述,处理数据质量问题是数据清洗的重要一步,缺失值、重复值和异常值等问题若不及时处理,将对后续的数据分析产生影响。

# 3. 数据清洗的基本流程

数据清洗是数据处理流程中至关重要的一环,它包括数据收集、探索、预处理和转换等多个步骤。下面将详细介绍数据清洗的基本流程及每个步骤的具体操作。

#### 3.1 数据收集与导入

在进行数据清洗之前,首先需要从不同的数据源中收集数据,并将数据导入到数据处理环境中。数据的质量和规模直接影响后续的清洗效果。

##### 3.1.1 数据来源

数据可以来源于各种渠道,包括数据库、文本文件、API 接口、传感器等。不同数据来源的数据格式和结构各异。

##### 3.1.2 数据导入工具

常用的数据导入工具有MySQL、MongoDB、Excel等,根据数据来源选择合适的导入工具,并确保数据导入的准确性和完整性。

#### 3.2 数据探索与预处理

数据探索和预处理是数据清洗的前提,通过对数据的可视化、统计和描述,可以更好地理解数据的特征和问题,为后续清洗提供参考。

##### 3.2.1 数据可视化

利用图表、直方图、散点图等可视化工具,展示数据的分布和趋势,从视觉上观察数据的异常情况。

##### 3.2.2 数据统计和描述

对数据进行基本统计分析,包括均值、中位数、标准差等,了解数据的集中趋势和离散程度。

##### 3.2.3 数据预处理方法

数据预处理包括数据清洗、缺失值处理、异常值检测等,通过数据预处理,可以为后续的分析和建模工作做好准备。

#### 3.3 数据清洗与转换

数据清洗是数据处理流程中的关键步骤,通过数据清洗,可以解决数据中存在的噪音、错误和不一致性问题,使数据更加干净和可靠。

##### 3.3.1 数据清洗步骤

数据清洗步骤包括去除重复值、处理缺失值、筛选异常值、数据转换等操作,确保数据质量符合分析需求。

##### 3.3.2 数据转换方法

数据转换是将原始数据转换为更符合分析要求的格式,包括数据格式转换、特征处理、数据归一化等,提高数据的可解释性和可用性。

以上是数据清洗的基本流程及关键步骤,数据清洗是数据处理过程中不可或缺的环节,只有经过有效的清洗处理,才能保证数据分析和建模的准确性和可靠性。

# 4. **数据清洗工具和技术**

数据清洗是数据处理中至关重要的一步,而选择合适的工具和技术可以极大地提高数据清洗的效率和准确度。本章节将介绍两种常用的数据清洗工具和技术:OpenRefine和Python Pandas。

#### 4.1 OpenRefine

OpenRefine 是一款开源的数据清洗工具,提供了丰富的数据转换和清洗功能,可帮助用户快速处理数据质量问题。下面分别介绍其功能和一个简单的数据清洗案例。

##### 4.1.1 功能介绍

- **数据导入和整理**:支持导入多种数据格式,如 CSV、Excel,方便数据处理。

- **数据清洗和转换**:提供丰富的数据清洗操作,如删除重复行、填充空值等。

- **数据可视化**:支持数据可视化操作,帮助用户更直观地了解数据分布。

##### 4.1.2 数据清洗案例

下面是一个使用 OpenRefine 进行数据清洗的简单案例:

- **步骤1:导入数据**

首先,将要清洗的数据文件导入 OpenRefine 中。

- **步骤2:处理缺失值**

使用 OpenRefine 的填充空值功能,对缺失值进行处理。

```mermaid

graph LR

A(导入数据) --> B(处理缺失值)

```

#### 4.2 Python Pandas

Python Pandas 是一个强大的数据处理库,提供了丰富的数据结构和功能,适用于数据清洗和分析。以下将介绍其数据处理功能和一个简单的数据清洗实践示例。

##### 4.2.1 数据处理功能

- **数据结构**:Pandas 提供了 Series 和 DataFrame 两种数据结构,方便处理不同类型的数据。

- **数据清洗**:Pandas 提供了各种数据清洗方法,如处理缺失值、重复值和异常值等。

##### 4.2.2 数据清洗实践示例

以下是一个使用 Pandas 进行数据清洗的实践示例:

```python

# 导入 Pandas 库

import pandas as pd

# 读取数据

data = pd.read_csv('data.csv')

# 处理缺失值

data.fillna(method='ffill', inplace=True)

```

```mermaid

graph TD

A(读取数据) --> B(处理缺失值)

```

# 5. 数据清洗的相关挑战和解决方法

数据清洗是数据处理过程中不可或缺的环节,但随着数据规模的增大和数据变化的复杂性,数据清洗也面临着一些挑战。在本节中,我们将探讨数据清洗过程中可能遇到的一些挑战,并介绍相应的解决方法。

1. **大数据量清洗的难点**

随着大数据时代的到来,数据量呈指数级增长,这给数据清洗带来了很大的挑战。大数据量清洗面临的主要问题在于处理速度慢、内存占用高、计算资源需求大等方面。针对这些问题,可以采取以下解决方法:

- **分布式数据清洗解决方案:** 使用分布式计算框架如Hadoop、Spark等进行数据清洗,将数据分配到多台机器上同时进行处理,提高处理速度和效率。

- **数据清洗优化策略:** 优化数据清洗算法和流程,减少不必要的计算和IO操作,尽可能减小数据处理的时间复杂度和空间复杂度。

2. **数据变化频繁的处理**

在许多实时数据处理场景下,数据是不断变化和更新的,这给数据清洗带来了新的挑战。实时数据清洗的关键在于快速响应数据变化并及时进行清洗处理。针对这一问题,可以采取以下解决方法:

- **实时数据清洗技术:** 使用流式计算技术如Apache Flink、Storm等进行实时数据清洗,能够实时监测数据变化并进行处理,保证数据的及时性和准确性。

- **数据实时监控和异常处理:** 引入数据监控系统,监控数据质量和数据变化情况,及时发现异常数据并进行处理,确保数据处理的完整性和稳定性。

在面对数据清洗过程中的各种挑战时,结合适当的解决方法和技术工具,可以有效提高数据清洗的效率和质量,保证数据处理结果的准确性和可靠性。数据清洗作为数据处理过程中的重要步骤,需要不断优化和改进,以适应不断变化的数据环境和需求。

0

0