MySQL主从复制技术演进趋势:从业者必知,把握技术前沿

发布时间: 2024-08-01 06:09:45 阅读量: 46 订阅数: 50

# 1. MySQL主从复制概述**

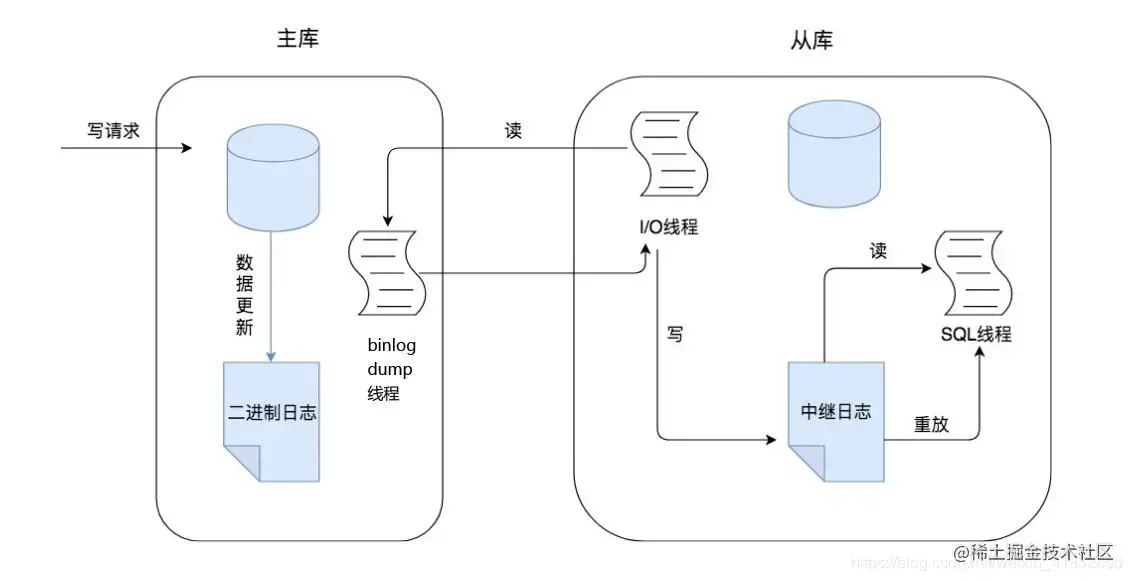

MySQL主从复制是一种数据复制技术,它允许将一个数据库(主库)中的数据复制到一个或多个其他数据库(从库)。主从复制的主要目的是提供数据冗余、提高可用性和可扩展性。

主从复制的工作原理是:主库将所有写入操作记录到二进制日志(binlog)中。从库连接到主库并从binlog中读取这些操作,然后在自己的数据库中执行这些操作。这样,从库的数据始终与主库保持一致。

主从复制具有以下优点:

* **数据冗余:**从库提供主库数据的副本,即使主库发生故障,数据也不会丢失。

* **提高可用性:**如果主库出现故障,可以快速将一个从库提升为主库,以最小化停机时间。

* **可扩展性:**通过添加更多从库,可以扩展数据库的读取能力,以满足不断增长的负载需求。

# 2. MySQL主从复制技术演进

### 2.1 传统主从复制技术

#### 2.1.1 半同步复制

**架构和原理:**

半同步复制在主从复制的基础上,增加了半同步机制。当主库执行事务时,会将事务日志发送到从库,从库收到事务日志后,会先执行本地事务,再发送一个确认信号给主库。主库收到确认信号后,才会提交事务。

**优势:**

* 提高数据一致性:半同步复制可以保证从库在主库提交事务之前已经执行了该事务,从而避免了主库故障导致的数据丢失。

* 降低复制延迟:半同步复制通过减少主库和从库之间的确认时间,降低了复制延迟。

**局限性:**

* 性能开销:半同步复制会增加主库和从库的性能开销,因为需要进行额外的确认操作。

* 不支持所有存储引擎:半同步复制仅支持InnoDB存储引擎。

#### 2.1.2 并行复制

**架构和原理:**

并行复制是一种主从复制技术,它允许从库并行执行来自主库的事务日志。主库将事务日志拆分为多个块,并将其发送到从库。从库收到事务日志块后,会同时执行这些块中的事务。

**优势:**

* 提高复制性能:并行复制通过并行执行事务,提高了复制性能。

* 降低复制延迟:并行复制可以减少复制延迟,因为从库可以同时执行多个事务。

**局限性:**

* 复杂性:并行复制的实现比传统主从复制更复杂,需要对MySQL内核进行修改。

* 不支持所有存储引擎:并行复制仅支持InnoDB存储引擎。

### 2.2 Group Replication

#### 2.2.1 架构和原理

Group Replication是一种多主复制技术,它允许一个MySQL集群中的多个节点同时作为主库。每个节点都维护自己的数据副本,并且可以向其他节点复制更新。

**优势:**

* 高可用性:Group Replication提供了高可用性,因为即使一个或多个节点故障,集群仍然可以继续运行。

* 可扩展性:Group Replication可以轻松扩展到更多节点,以满足不断增长的负载。

* 无单点故障:Group Replication没有单点故障,因为每个节点都可以作为主库。

**局限性:**

* 复杂性:Group Replication的实现比传统主从复制更复杂,需要对MySQL内核进行修改。

* 性能开销:Group Replication会增加集群的性能开销,因为需要进行额外的复制操作。

### 2.3 MyS

0

0