Hadoop NameNode日志分析:系统健康状况深度挖掘

发布时间: 2024-10-30 06:35:41 阅读量: 62 订阅数: 45

基于hadoop的离线用户行为分析(日志处理).zip

# 1. Hadoop NameNode基础介绍

## 1.1 Hadoop分布式文件系统概述

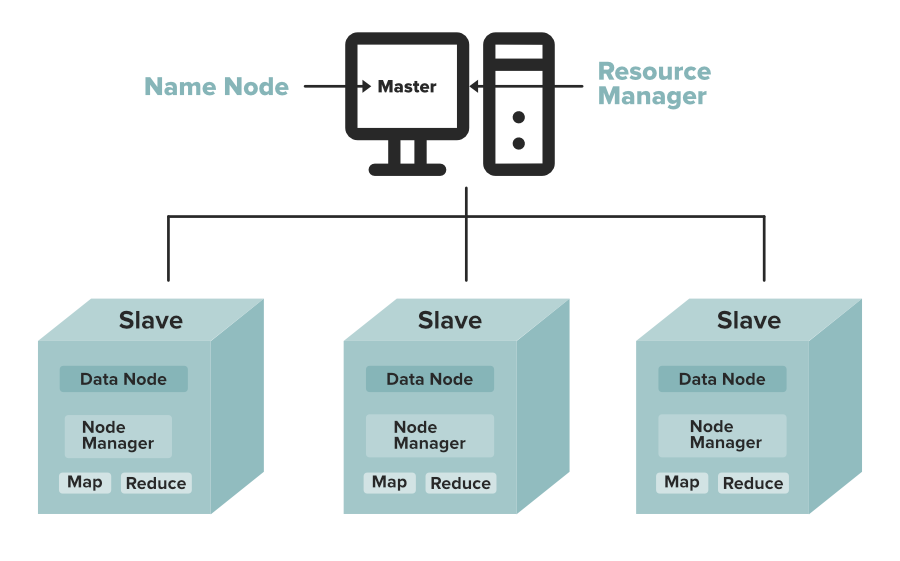

Hadoop的分布式文件系统(HDFS)是Hadoop生态系统的核心组件之一。HDFS具有高容错性、高吞吐量的特点,特别适合于大规模数据集的存储和处理。其设计基于传统的master/slave架构,其中NameNode扮演master的角色,负责维护文件系统的元数据,而DataNode则作为slave,负责存储实际的数据。

## 1.2 NameNode的作用与重要性

在Hadoop集群中,NameNode承担着至关重要的角色。它是整个HDFS的命名空间和客户端对文件进行读写的入口点。NameNode记录每个文件中各个块所在的DataNode节点信息,以及文件的元数据,包括权限、修改和访问时间等。如果NameNode出现故障,整个HDFS将无法使用,因此对NameNode的维护和监控是至关重要的。

## 1.3 NameNode的高可用性解决方案

为了解决单点故障问题,Hadoop社区引入了高可用性(HA)架构。这涉及到多个NameNode实例的部署和共享存储系统(如Zookeeper和Quorum Journal Manager)。如果主NameNode发生故障,备用NameNode可以迅速接管,保障了系统的高可用性和稳定性。在后续章节中,我们将深入探讨NameNode高可用性的细节及其日志管理策略。

# 2. NameNode日志的理论基础

### 2.1 Hadoop日志系统概述

#### 2.1.1 Hadoop日志架构

在大数据处理框架Hadoop中,日志系统扮演着不可或缺的角色。Hadoop的日志架构设计用来记录系统运行过程中产生的各种信息,这些信息对于故障诊断、性能优化以及系统监控至关重要。

Hadoop日志架构主要包含几个关键组件:

- **日志记录器(Loggers)**:在Hadoop的代码库中,每个组件都有一个或多个日志记录器,负责记录信息。

- **日志收集(Log Aggregation)**:日志文件分散在多个节点上,日志收集机制能够将它们汇总到中心位置。

- **日志存储(Log Storage)**:汇总后的日志文件存储在可配置的存储系统中,便于后续的查询和分析。

- **日志分析工具(Log Analysis Tools)**:各种工具和平台用于解析和分析日志数据,以提取有用信息。

#### 2.1.2 NameNode日志的角色和功能

NameNode是Hadoop分布式文件系统(HDFS)的核心组件,负责管理文件系统的命名空间以及客户端对文件的访问。在NameNode的操作中,会产生两类关键日志:编辑日志(Edit Log)和命名空间镜像(Namespace Image)。

编辑日志记录了对文件系统的每一次修改,如创建、删除文件或目录。命名空间镜像是HDFS文件系统状态的一个快照。日志角色和功能具体包括:

- **数据一致性保障**:在NameNode重启时,编辑日志用于重构文件系统的状态。

- **故障恢复**:通过编辑日志和命名空间镜像,HDFS可以恢复到故障发生前的一致状态。

- **监控与审计**:日志记录了所有的文件系统操作,有助于监控系统运行状态和审计用户的活动。

### 2.2 NameNode日志格式解析

#### 2.2.1 日志文件结构

NameNode日志文件通常以二进制格式存储,但它们遵循特定的结构。一个编辑日志条目由三个主要部分组成:

- **事务ID(Transaction ID)**:每个操作的唯一标识,可以用来追踪特定操作。

- **时间戳(Timestamp)**:操作发生的时间。

- **操作类型和数据(Operation Type & Data)**:具体的操作类型(如创建、删除、重命名文件)以及相关的数据。

#### 2.2.2 关键日志条目的含义

- **追加记录(Append Record)**:表示数据被追加到文件中。

- **删除记录(Delete Record)**:表示文件或目录被删除。

- **重命名记录(Rename Record)**:表示文件或目录被重命名。

这些关键条目共同构成了HDFS文件系统变更的历史记录。

### 2.3 日志分析的理论方法

#### 2.3.1 日志内容的统计与趋势分析

统计分析是日志分析的基础。通过收集日志中不同事件的频率和模式,可以对系统的运行状态进行评估。例如,分析NameNode日志中的`CREATE`和`DELETE`事件频率可以帮助判断系统的繁忙程度。

趋势分析可以检测到系统行为的长期变化,例如,逐渐增长的读写请求可能预示着系统负载的增加,从而需要扩展资源。

#### 2.3.2 机器学习在日志分析中的应用

机器学习技术可以用来预测系统的行为和故障。通过训练模型来识别日志数据中的异常模式,可以预测即将发生的故障并采取预防措施。

例如,利用机器学习对NameNode日志中的操作序列进行分析,模型可以学习到正常的操作模式。一旦检测到偏离正常模式的行为,系统可以发出警报,从而提前进行干预。

```mermaid

graph LR

A[开始收集日志] --> B[解析日志条目]

B --> C[统计分析]

C --> D[趋势分析]

D --> E[训练机器学习模型]

E --> F[预测系统行为]

F --> G[故障预测和避免]

```

在本节中,我们介绍了Hadoop日志系统的架构和组件,详细解读了NameNode日志的结构和重要条目,讨论了使用统计分析和机器学习进行日志分析的理论方法。通过这些理论知识,我们可以为实际操作和应用奠定基础。在接下来的章节中,我们将深入探讨如何使用工具和平台进行日志分析实践,包括日志文件的采集、预处理、模式识别以及实现日志分析的自动化和可视化等操作。

# 3. NameNode日志分析实践

## 3.1 日志分析工具和平台

### 3.1.1 开源日志分析工具介绍

日志分析工具是数据分析师和系统管理员的重要助手。开源工具以其灵活性、免费和社区支持而受到广泛欢迎。在Hadoop生态系统中,一些强大的日志分析工具值得探讨:

- **Ganglia**: 适用于监控大规模集群的性能,提供高性能的聚合和可视化。

- **Nagios**: 是一个高度可定制的系统和服务监控工具,可以用来监控Hadoop集群的状态和性能。

- **Fluentd**: 一个开源数据收集器,旨在统一日志层。它允许你统一管理数据收集和消费。

- **Logstash**: 作为Elastic Stack(以前称为ELK Stack)的一部分,Logstash擅长日志数据处理和可视化。

为了实现更深入的日志分析,我们还需要了解如何使用这些工具以及它们在日志分析中的作用。

### 3.1.2 构建自己的日志分析平台

构建自定义的日志分析平台是一个复杂但充满可能性的过程。这涉及到几个关键步骤:

- **数据收集**: 集成各种日志源,使用像Flume或Apache Kafka这样的流处理系统。

- **数据存储**: 使用像Elasticsearch或HBase这样的数据库来存储结构化或半结构化的日志数据。

- **数据处理**: 使用像Apache Spark或Apache Flink这样的框架来处理大规模数据。

- **数据分析**: 结合机器学习算法,如异常检测和模式识别,以发现有用信息。

- **数据可视化**: 使用工具如Grafana或Kibana

0

0