"这是一个关于Hadoop的超级详细安装文档,涵盖了从创建虚拟机到配置集群的全过程,特别适合初学者和需要搭建Hadoop环境的技术人员。"

在大数据处理领域,Hadoop是一个关键的开源框架,它允许分布式存储和处理大规模数据集。这篇文档详细指导了如何在虚拟环境下部署一个由1个Master节点和2个Slave节点组成的Hadoop集群。

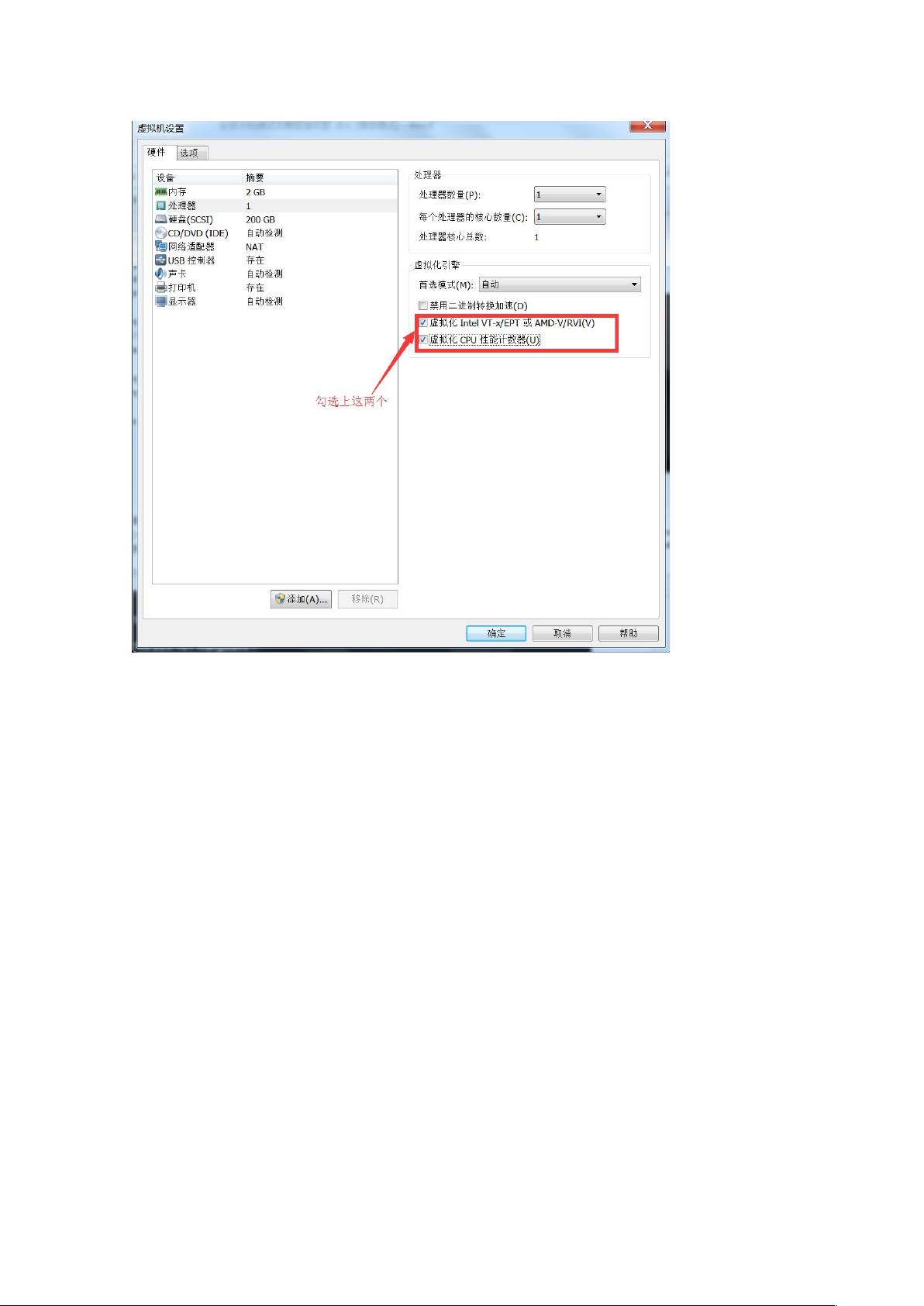

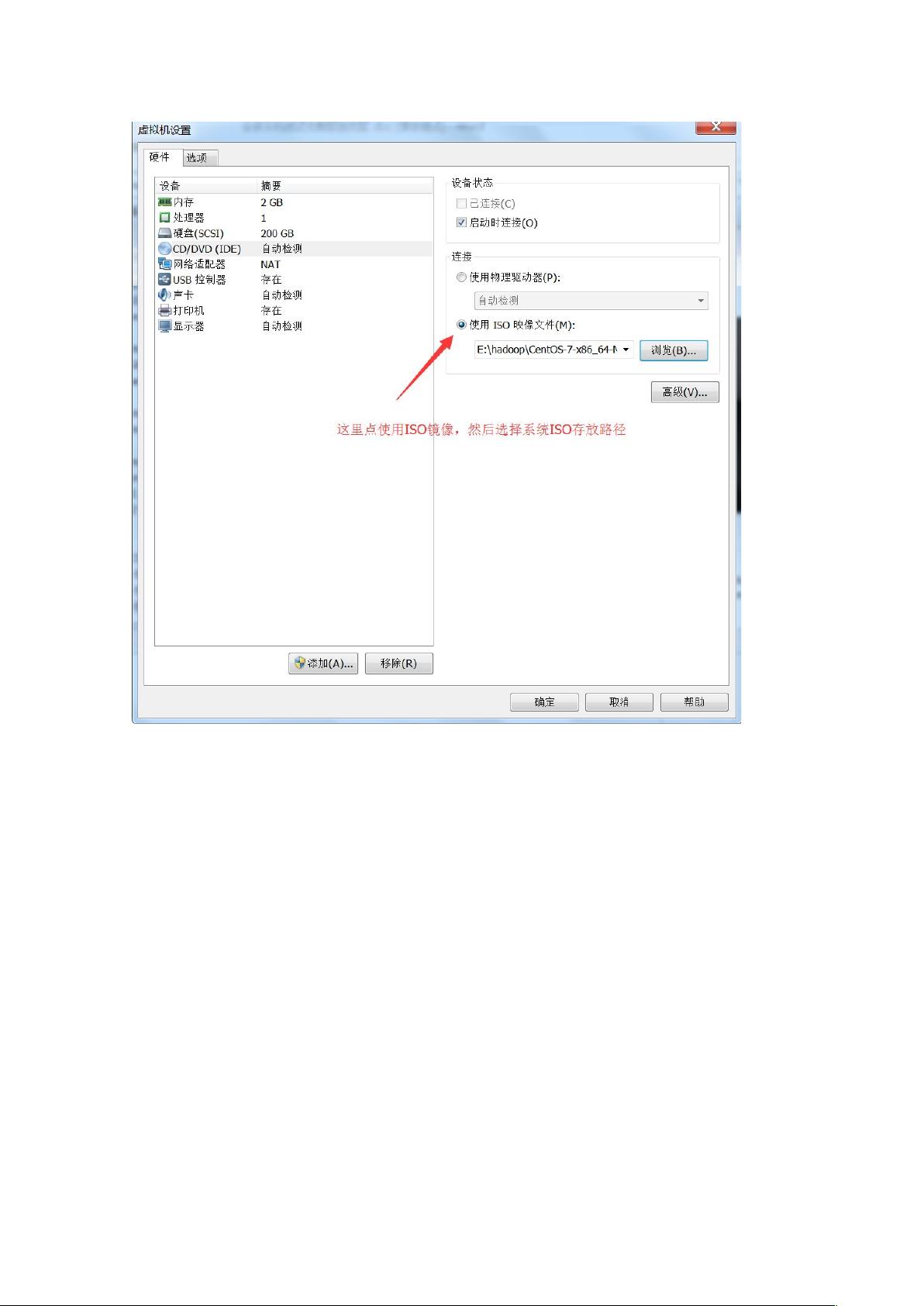

首先,你需要使用VMware创建一个虚拟机,将其设定为Master节点。创建完成后,你需要克隆这个Master节点两次以生成两个Slave节点。在创建虚拟机时,需要为系统分配合适的硬件资源,如内存和CPU,以满足Hadoop服务的需求。

在系统安装过程中,需要为虚拟机划分分区。文档中提到,应创建一个1GB大小的/boot分区,用于存储引导文件,以及一个大小为物理内存两倍的swap分区,用作虚拟内存。文件系统分别选择ext4和swap。

系统安装完毕并重启后,要进行网络配置。确保每个节点都有一个静态IP地址,便于集群内的通信。在文档中,IP地址被设置为192.168.225.100,子网掩码为255.255.255.0,网关需根据实际网络环境设置。同时,记得更改主机名,以便区分各个节点。

完成基本系统配置后,接下来的步骤包括安装Hadoop所需的各种依赖,配置Hadoop环境变量,以及调整Hadoop配置文件,如core-site.xml、hdfs-site.xml、yarn-site.xml和mapred-site.xml。这些配置文件将定义Hadoop集群的行为,例如数据块复制数、NameNode和DataNode的位置等。

在所有节点上安装并配置好Hadoop后,需要启动Hadoop服务,包括DataNode、NameNode、ResourceManager和NodeManager。最后,验证Hadoop集群是否正常运行,可以通过运行简单的MapReduce任务或检查HDFS的状态来完成。

通过这篇文档,读者可以深入了解Hadoop集群的构建过程,掌握必要的系统管理和网络配置技能,这对于任何希望在本地环境中实践Hadoop的人来说都是宝贵的资源。