深入剖析Hadoop源代码:从HDFS到MapReduce

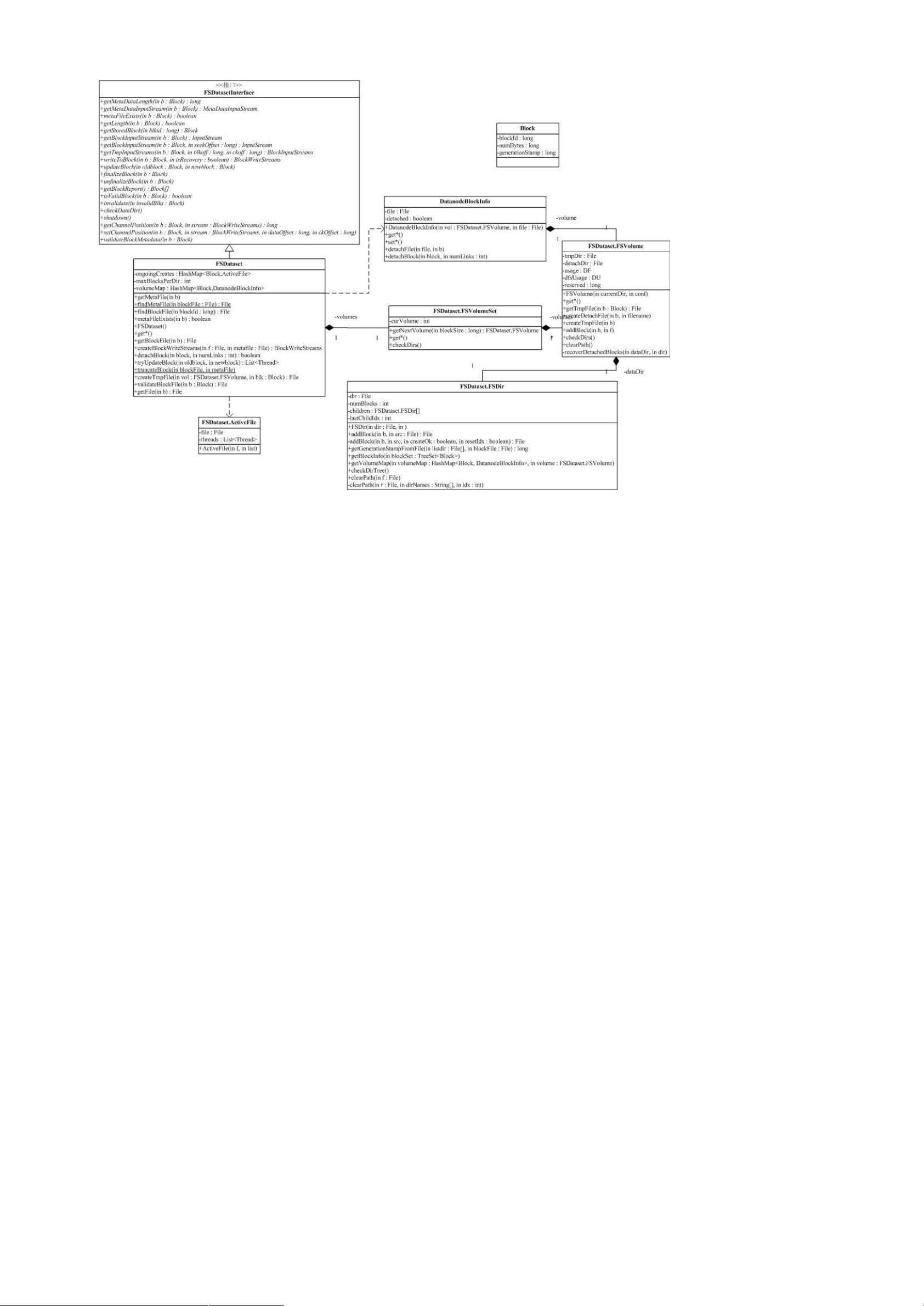

"Hadoop源代码分析的完整版涵盖了Hadoop的运行原理,包括其核心组件HDFS、MapReduce以及与其他开源项目的对比。" Hadoop是一个开源的分布式计算框架,最初受到Google一系列论文的启发,旨在提供高可靠性和可扩展性的数据处理能力。Google的五篇关键技术论文——GoogleCluster、Chubby、GFS、BigTable和MapReduce,分别对应了Hadoop项目中的ZooKeeper、HDFS、HBase和MapReduce。 Hadoop分布式文件系统(HDFS)是Hadoop的基础,它是一个设计用于处理大规模数据集的分布式文件系统。HDFS具有高度容错性,能够自动将数据复制到多个节点,确保即使在硬件故障的情况下也能保持数据的可用性。HDFS的设计目标是让应用程序可以像访问本地文件系统一样访问远程文件,同时提供高带宽的数据访问。 MapReduce是Hadoop的并行计算模型,用于处理和生成大数据集。它将大型任务拆分成小的“映射”(map)任务和“化简”(reduce)任务,这些任务可以在集群中的多台机器上并行执行,从而实现快速的数据处理。Map阶段处理输入数据,生成中间键值对;Reduce阶段则聚合这些中间结果,生成最终的输出。 ZooKeeper在Hadoop中扮演着分布式协调服务的角色,类似于Google的Chubby,它维护了集群中的各种配置和服务状态,确保在分布式环境中的一致性和高可用性。 HBase是基于HDFS的分布式数据库,灵感来源于Google的BigTable,适合存储非结构化和半结构化的数据,提供实时读写访问。它是一个列族数据库,支持高效的随机读写操作,常用于实时数据分析。 Hive是由Facebook开发的数据仓库工具,它可以将结构化的数据文件映射为一张数据库表,并提供SQL-like查询语句,使得用户能够方便地进行大数据分析,无需编写复杂的MapReduce程序。 Hadoop的源代码分析涉及包间复杂的依赖关系,例如,`conf`包用于读取系统配置,依赖于`fs`包来访问文件系统。这种依赖结构使得理解Hadoop的内部工作原理变得复杂,但也展示了其灵活性,能适应不同的存储系统。 在进行Hadoop源代码分析时,关注的重点是Hadoop的蓝色部分,这通常包含了Hadoop的关键组件和核心功能。通过深入分析这些部分,可以深入了解Hadoop如何处理数据分布、任务调度、错误恢复等核心问题,这对于优化Hadoop集群的性能和解决实际问题至关重要。对于开发者和运维人员来说,理解Hadoop的源代码可以帮助他们更好地调试、优化和扩展Hadoop系统。

剩余63页未读,继续阅读

- 粉丝: 0

- 资源: 18

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- C++多态实现机制详解:虚函数与早期绑定

- Java多线程与异常处理详解

- 校园导游系统:无向图实现最短路径探索

- SQL2005彻底删除指南:避免重装失败

- GTD时间管理法:提升效率与组织生活的关键

- Python进制转换全攻略:从10进制到16进制

- 商丘物流业区位优势探究:发展战略与机遇

- C语言实训:简单计算器程序设计

- Oracle SQL命令大全:用户管理、权限操作与查询

- Struts2配置详解与示例

- C#编程规范与最佳实践

- C语言面试常见问题解析

- 超声波测距技术详解:电路与程序设计

- 反激开关电源设计:UC3844与TL431优化稳压

- Cisco路由器配置全攻略

- SQLServer 2005 CTE递归教程:创建员工层级结构

信息提交成功

信息提交成功