"这篇文档是关于Logistic Regression的入门教程,涵盖了从理论基础到实际应用的多个方面,包括最小二乘法、极大似然估计、逻辑回归的推导、优化方法、Sklearn库的使用以及实战案例。"

Logistic Regression是机器学习中的一种基本算法,尤其适用于二分类问题。它在很多领域都有广泛应用,如医学诊断、市场预测等。本文档旨在帮助初学者掌握这一重要工具。

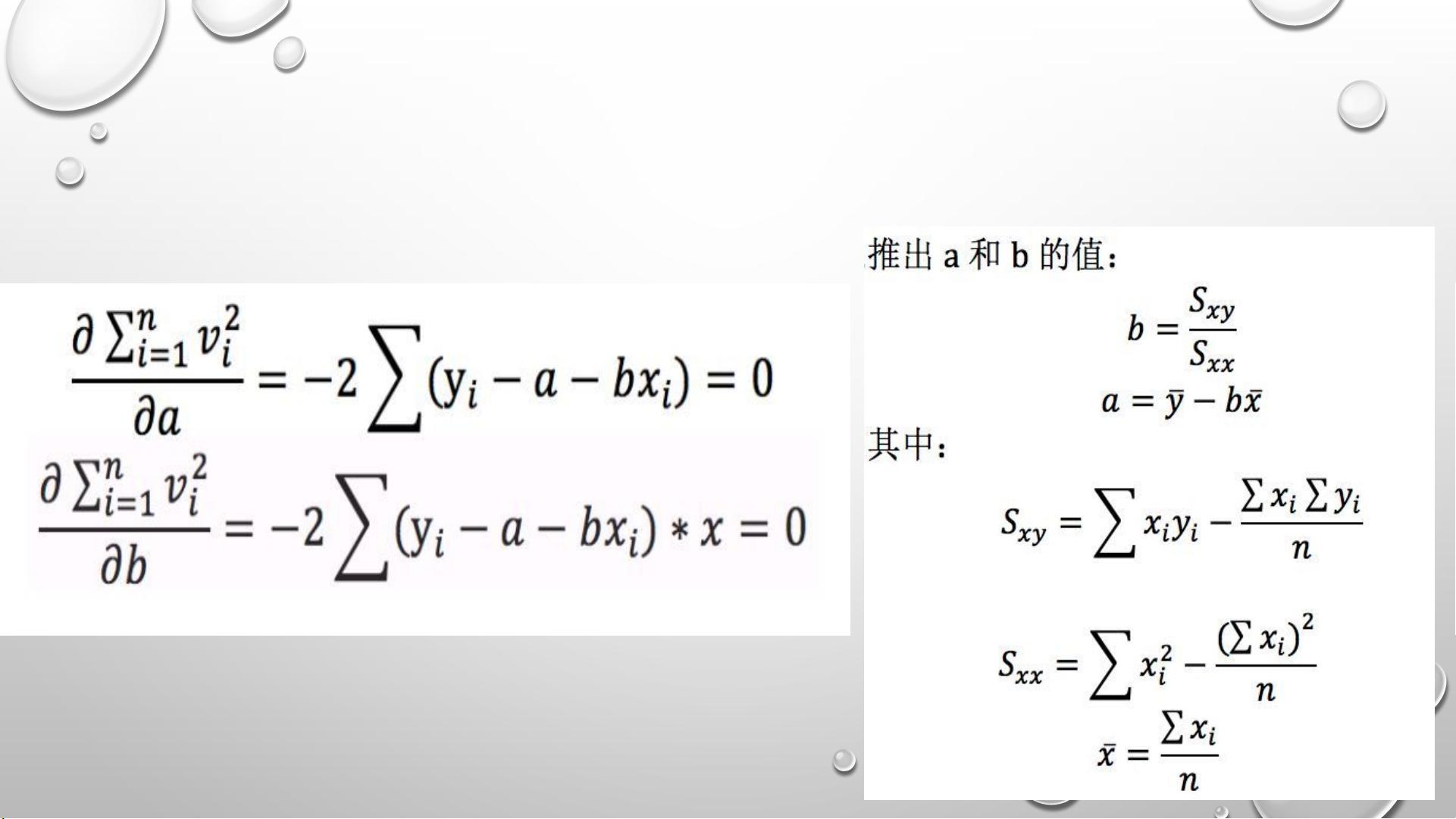

1、最小二乘法:这是线性回归中常用的一种参数估计方法,目标是找到一条直线(或超平面)来拟合数据,使得所有数据点到该直线的垂直距离(即误差)之和最小。在二元线性回归模型Y=a+bx中,通过最小化误差平方和来估计参数a和b。

2、极大似然估计:这是一种估计统计模型参数的常用方法,它通过最大化观察数据出现的概率来确定模型参数。在有多个独立同分布的数据点时,可以构建联合概率密度函数,并通过取对数和求导找到使得似然函数最大的参数估计。

3、Lr推导:逻辑回归(Logistic Regression)是将线性模型的输出通过一个非线性函数(通常是Sigmoid函数)转化为0-1之间的概率。在二分类问题中,Sigmoid函数将线性预测值映射到0和1之间,形成概率输出。

4、Lr求解优化:逻辑回归的优化通常采用梯度下降法更新参数,寻找损失函数的最小值。此外,还可以使用向量化操作来提高计算效率。在实际应用中,还可能涉及正则化(如L1或L2正则化)来防止过拟合。

5、Sklearn工具函数:Python中的Scikit-learn库提供了`LogisticRegression`类,用于实现逻辑回归模型。这个类包含多个参数,如正则化强度`C`、是否使用正则化的双变量形式`dual`、迭代次数`max_iter`等。常用方法包括`fit`进行模型训练,`predict`进行预测,`predict_proba`输出类别概率,以及`score`计算模型性能。

6、实战案例:文档中可能提到使用逻辑回归对鸢尾花数据集进行分类,这是机器学习中经典的多类分类问题。此外,Netflix数据集可能被用于演示大型数据集上的逻辑回归应用,展示模型在实际场景中的表现和调整。

这份资料详尽地介绍了逻辑回归的基本概念、数学原理和实际操作,是学习和理解逻辑回归的宝贵资源。通过深入学习和实践,读者能够熟练掌握这一重要算法并应用于实际问题解决。