GPU并行编程中的内 warp 分支优化策略

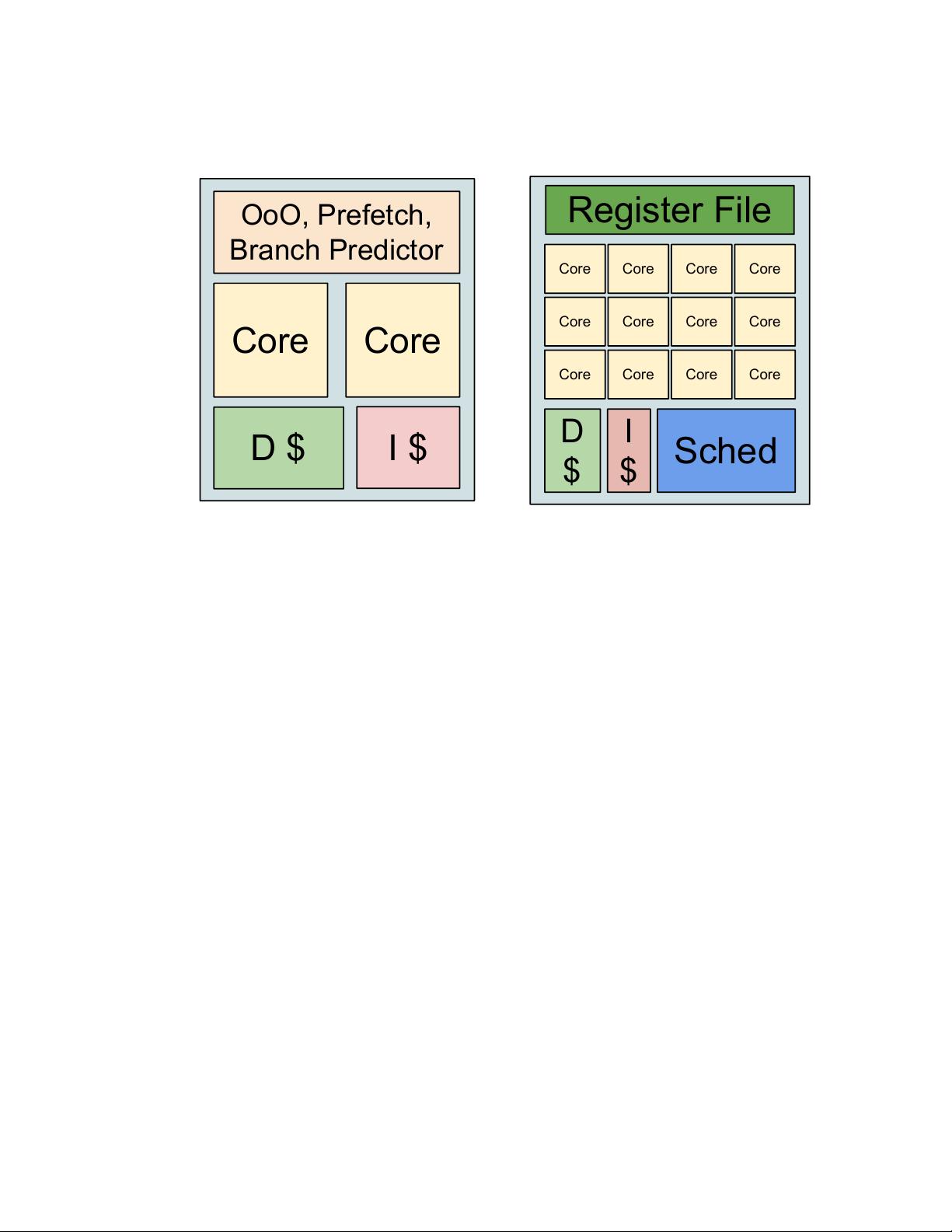

本篇论文标题为《GPU上基于互 warp 分支感知的执行优化》(Inter-warp Divergence Aware Execution on GPUs),由Chulian Zhang撰写,作为他在东北大学电气与计算机工程专业硕士学业的一部分,于2016年4月提交。论文着重探讨了在现代GPU(图形处理器)编程中面临的分支问题,以及如何通过编程和架构层面的优化来提高性能。 首先,论文定义了问题(1.1节),指出CUDA编程模型中的warp(线程块)分支执行可能会导致性能下降,因为不同warp内的线程可能执行不同的代码路径,产生分支 divergence,这会降低并行度和流水线效率。作者针对这一挑战,提出了一种优化策略,旨在解决这个问题。 在编程层面(1.2.1节),作者探索了如何利用高级编程技巧,如分支预测和控制流管理,减少分支引起的不一致性,并提供更高效的指令调度。这包括利用条件分支指令的延迟策略,以及对分支依赖的合理安排,以最小化潜在的性能损失。 在架构层面(1.2.2节),论文分析了GPU的硬件特性,如多级内存系统、occupancy(指令并行度)、以及与CPU的交互方式。理解这些因素有助于设计针对分支 divergence 的适应性执行策略,例如调整工作负载分配,以保持更多的warp在连续执行,从而提高整体吞吐量。 接着,论文回顾了相关工作(2.1和2.2节),特别是背景减法(background subtraction)在GPU上的应用,这是许多计算密集型任务的基础,以及GPU上的线程调度算法,这些都与分支处理密切相关。作者还提到了GPGPU-Sim(3.3节),一个用于模拟GPU行为的工具,它被用来验证和优化算法在实际硬件上的性能。 高性能背景减法(4章)部分,可能是论文的核心部分,讨论了如何结合前面提到的优化技术,通过有效的数据管理和计算策略,提升背景减法的并行性能,同时减少分支带来的影响。这可能包括使用混合高斯模型(Mixture of Gaussian)等算法,这些算法对于并行化处理具有天然优势。 这篇论文不仅深入剖析了GPU编程中的分支问题,还提供了实用的优化策略和方法,对于理解和改进GPU应用程序的性能有着重要的参考价值。通过理论分析和实验验证,作者为开发者提供了一套在面临分支 divergence 时提升GPU程序效率的全面指南。

剩余75页未读,继续阅读

- 粉丝: 0

- 资源: 1

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- C++标准程序库:权威指南

- Java解惑:奇数判断误区与改进方法

- C++编程必读:20种设计模式详解与实战

- LM3S8962微控制器数据手册

- 51单片机C语言实战教程:从入门到精通

- Spring3.0权威指南:JavaEE6实战

- Win32多线程程序设计详解

- Lucene2.9.1开发全攻略:从环境配置到索引创建

- 内存虚拟硬盘技术:提升电脑速度的秘密武器

- Java操作数据库:保存与显示图片到数据库及页面

- ISO14001:2004环境管理体系要求详解

- ShopExV4.8二次开发详解

- 企业形象与产品推广一站式网站建设技术方案揭秘

- Shopex二次开发:触发器与控制器重定向技术详解

- FPGA开发实战指南:创新设计与进阶技巧

- ShopExV4.8二次开发入门:解决升级问题与功能扩展

信息提交成功

信息提交成功