Support Vector Machine(SVM)是一种强大的监督学习算法,特别适用于分类问题。本文将对SVM的原理进行分析,并且专门面向初学者,帮助他们更好地理解这一复杂算法。SVM的主要目标是找到最佳的决策边界,以最好地区分不同类别的特征数据。但是支持向量机数据本身如果很难分隔,该如何处理?该算法的计算复杂程度又如何?它在实际应用中是否有效?这些问题都将在下文中得到论述。

首先,让我们来了解SVM的决策边界选择原则。SVM采取的方法是选出使得类别之间距离最大化的决策边界,也就是离雷区(即边界上的样本点)最远的边界。换句话说,SVM的目标是要找到一个能够将不同类别的样本点有效分隔开的边界,同时使得距离这个边界最近的样本点(支持向量)的距离尽量远离这个边界。因此,SVM的决策边界在所有可能的边界中是最具有鲁棒性的。

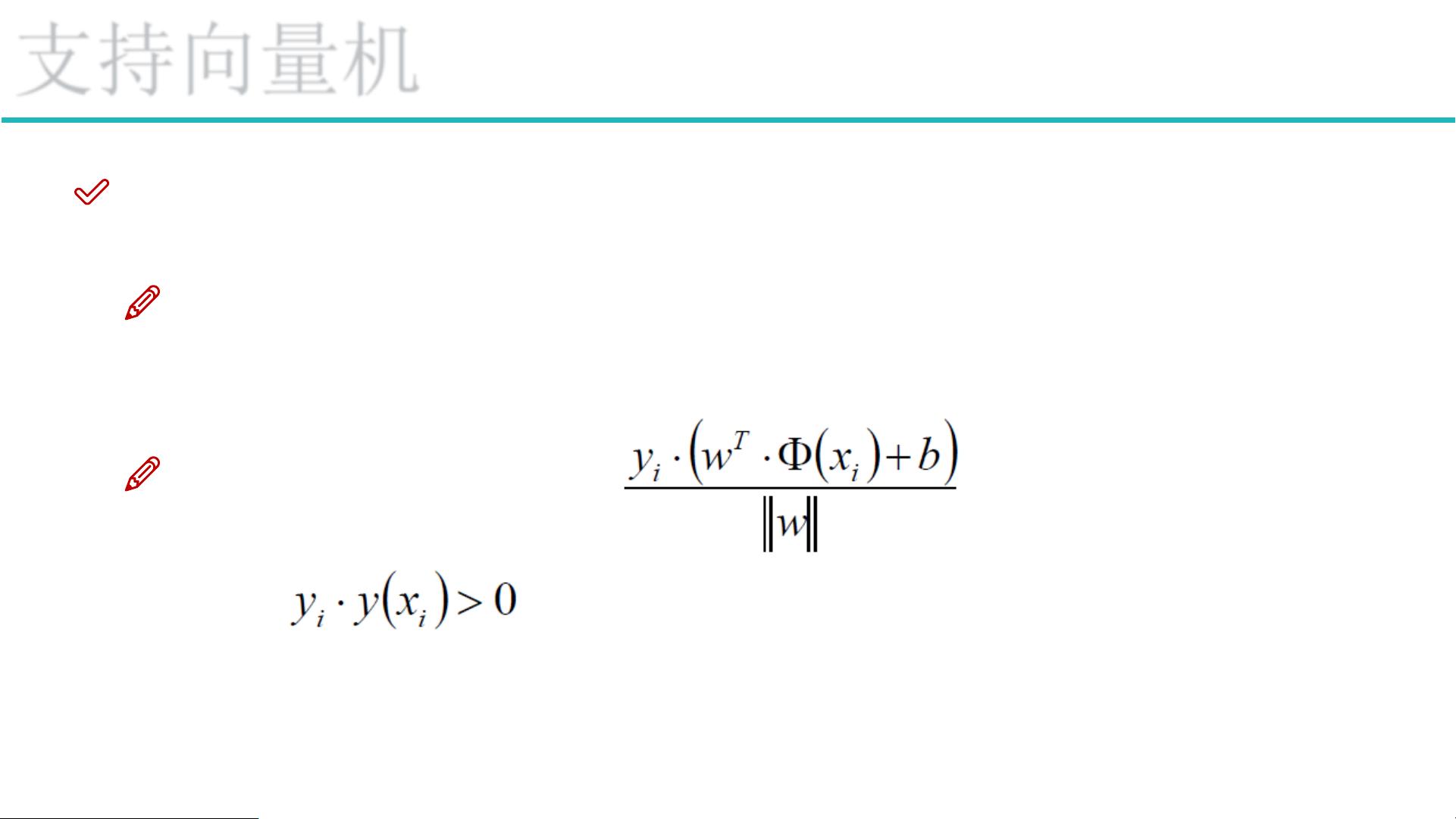

接下来,我们来看一下支持向量机是如何计算样本点到决策边界的距离的。在SVM中,我们定义数据集为(X1,Y1)(X2,Y2)… (Xn,Yn),其中Y为样本的类别,一般规定当X为正例时候Y = 1,当X为负例时候Y = -1。SVM的决策方程可以表示为:f(x) = w^Tx + b,其中w和b是待求的参数。然而,为了便于计算,我们需要对这个决策方程做一些变换。

具体地,我们将决策方程进行如下变换:f(x) = w^Tx + b => f(x) = \frac{w^T}{|w|}x + \frac{b}{|w|}。如此一来,我们可以对决策边界的距离进行更加简单的计算,并且保证了距离的有效性。

接下来,我们需要对目标函数进行放缩变换,以使得优化问题更容易求解。在SVM中,我们的优化目标是要找到w和b,使得|Y|f(x) = |Y|\frac{w^T}{|w|}x + |Y|\frac{b}{|w|}>= 1。由于|Y|一般等于1,所以这个目标函数可以进一步被放缩为:f(x) = w^Tx + b,使得决策边界是最具鲁棒性的。

最后,我们需要利用对偶问题对SVM进行优化。由于原始问题中存在绝对值,求解过程复杂,我们可以通过对偶问题对其进行简化。通过对偶问题,我们可以得到SVM的优化目标函数,并且能够更加高效地解出参数w和b。因此,通过对偶问题的求解,我们可以在更短的时间内得到最优的决策边界。

总的来说,SVM是一种非常有效的分类算法,其决策边界的选择原则、距离的计算方法、目标函数的放缩以及对偶问题的优化方法,都使得SVM在实际应用中表现出色。通过本文的介绍,相信初学者们已经对SVM有了更深刻的了解,也能够更加轻松地应用SVM来解决实际问题。