Hadoop作业提交流程详解

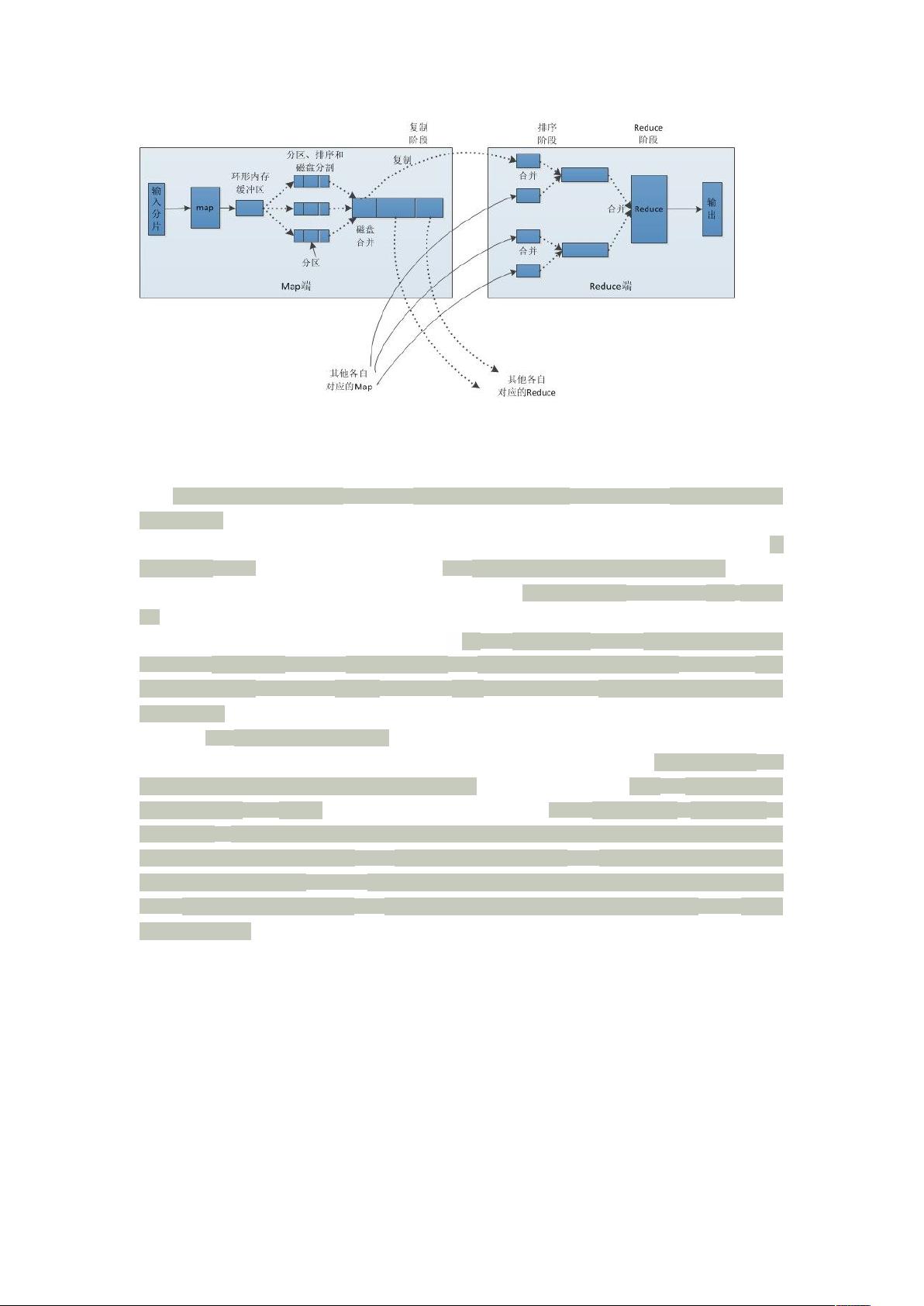

"Hadoop作业提交流程详解" 在Hadoop生态系统中,MapReduce是核心的分布式计算框架,负责处理大规模数据的并行计算。当开发者编写好MapReduce程序后,需要将其提交到Hadoop集群上执行。以下是Hadoop1版本中MapReduce作业(Job)的提交流程,这个流程在Hadoop后续版本中虽有所调整,但基本原理保持一致。 1. **启动JobClient**:开发者通过编程调用`runJob()`方法启动JobClient实例,这是提交作业的起点。 2. **获取JobID和工作目录**:JobClient通过`getNewJobId()`接口向JobTracker发送请求,JobTracker返回一个唯一的作业ID(例如job_201101281410_0001)以及作业的存放目录,该目录通常与用户的用户名相关联。 3. **数据源切片**:JobClient根据输入数据进行切片(split),每个split代表一部分输入数据,每个split对应一个map任务。split文件不包含实际数据,而是数据的引用。 4. **上传资源文件**:JobClient将作业所需的资源文件(如JAR包、配置文件、job.split文件等)上传至HDFS的JobTracker工作目录下的特定jobid目录。这些文件会被冗余地存储在多个节点上,以确保高可用性。 5. **提交作业**:JobClient通过远程过程调用(RPC)将作业ID和HDFS中的文件路径等基本信息提交给JobTracker,而不是直接传输计算数据或资源数据,因为两者都可直接访问HDFS。 6. **作业调度**:JobTracker收到请求后,将作业放入队列等待。当有可用资源时,JobTracker从队列中取出作业进行初始化。 7. **任务分配**:JobTracker读取HDFS上的job.split文件,根据split信息分配任务给TaskTracker。每个split对应一个map任务。 8. **心跳机制**:TaskTracker通过心跳机制(默认每3秒一次)向JobTracker报告状态并请求新的任务。 9. **获取并执行任务**:TaskTracker从HDFS下载作业的资源文件,启动新的Java进程(child JVM)来执行maptask和reducetask。每个TaskTracker可以同时处理多个map和reduce任务。 10. **任务执行**:在child JVM中,map任务处理其对应的split数据,生成中间结果;reduce任务接收并合并这些中间结果,最终产生作业的输出。 11. **进度与状态更新**:在整个过程中,TaskTracker会持续向JobTracker报告任务的进度和状态,JobTracker会将这些信息反馈给JobClient,使开发者能够监控作业的执行情况。 这个流程描述了Hadoop1中MapReduce作业的基本提交和执行步骤。随着Hadoop版本的演进,如YARN(Yet Another Resource Negotiator)的引入,JobTracker的角色被Resource Manager取代,而TaskTracker被NodeManager替代,但作业提交和执行的核心逻辑大体保持不变,只是管理和调度层面变得更加精细和灵活。理解这一流程对于理解和优化Hadoop MapReduce应用至关重要。

剩余21页未读,继续阅读

- 粉丝: 0

- 资源: 11

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 计算机人脸表情动画技术发展综述

- 关系数据库的关键字搜索技术综述:模型、架构与未来趋势

- 迭代自适应逆滤波在语音情感识别中的应用

- 概念知识树在旅游领域智能分析中的应用

- 构建is-a层次与OWL本体集成:理论与算法

- 基于语义元的相似度计算方法研究:改进与有效性验证

- 网格梯度多密度聚类算法:去噪与高效聚类

- 网格服务工作流动态调度算法PGSWA研究

- 突发事件连锁反应网络模型与应急预警分析

- BA网络上的病毒营销与网站推广仿真研究

- 离散HSMM故障预测模型:有效提升系统状态预测

- 煤矿安全评价:信息融合与可拓理论的应用

- 多维度Petri网工作流模型MD_WFN:统一建模与应用研究

- 面向过程追踪的知识安全描述方法

- 基于收益的软件过程资源调度优化策略

- 多核环境下基于数据流Java的Web服务器优化实现提升性能

信息提交成功

信息提交成功