"史上最全的Hadoop大数据处理方案"

在当今数据爆炸的时代,Hadoop作为一款开源的大数据处理框架,已经成为处理海量数据的核心工具。本文将深入探讨Hadoop 2.0的最佳实践,涵盖其核心组件、应用场景以及如何利用Hadoop进行大数据分析。

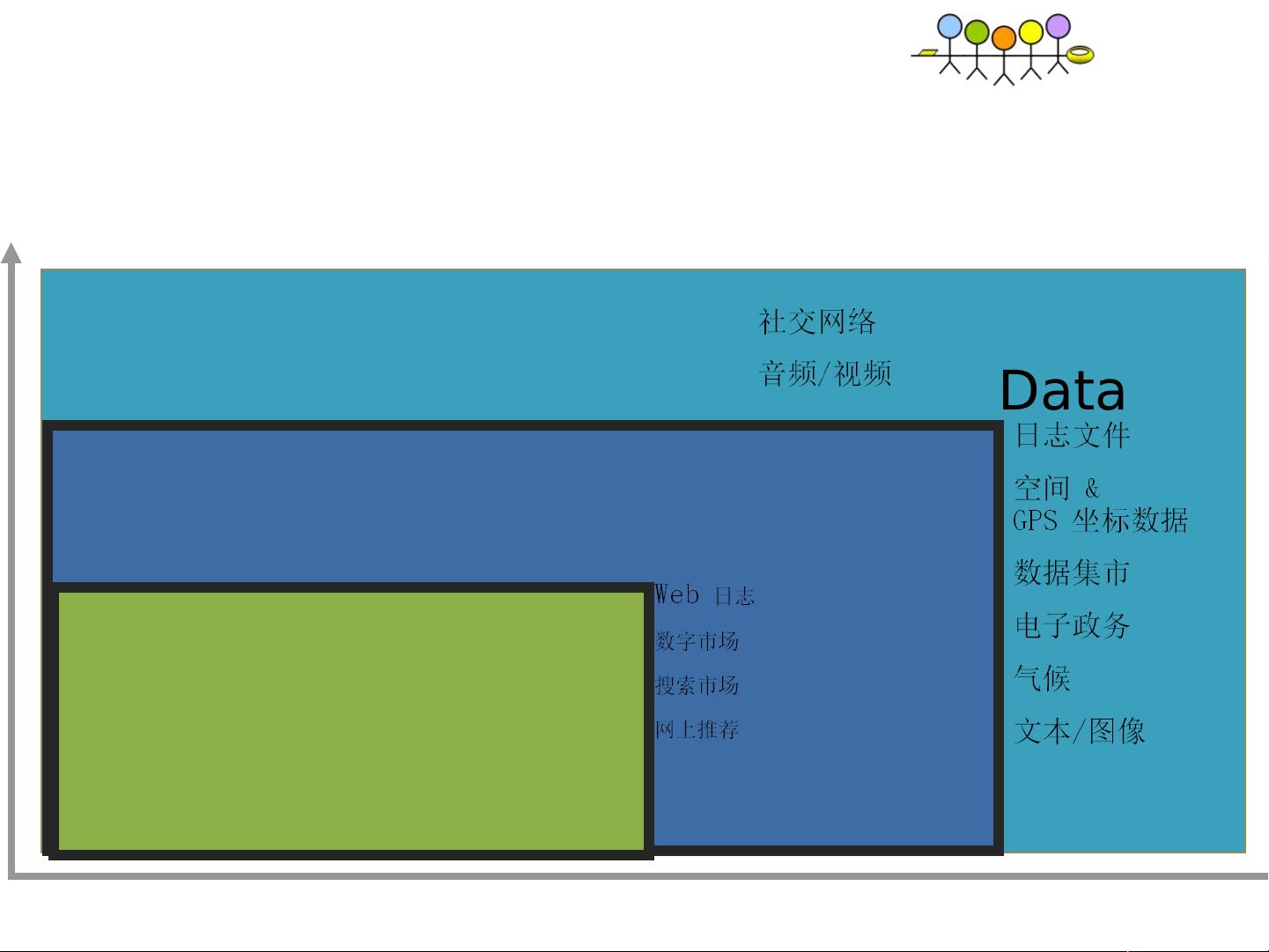

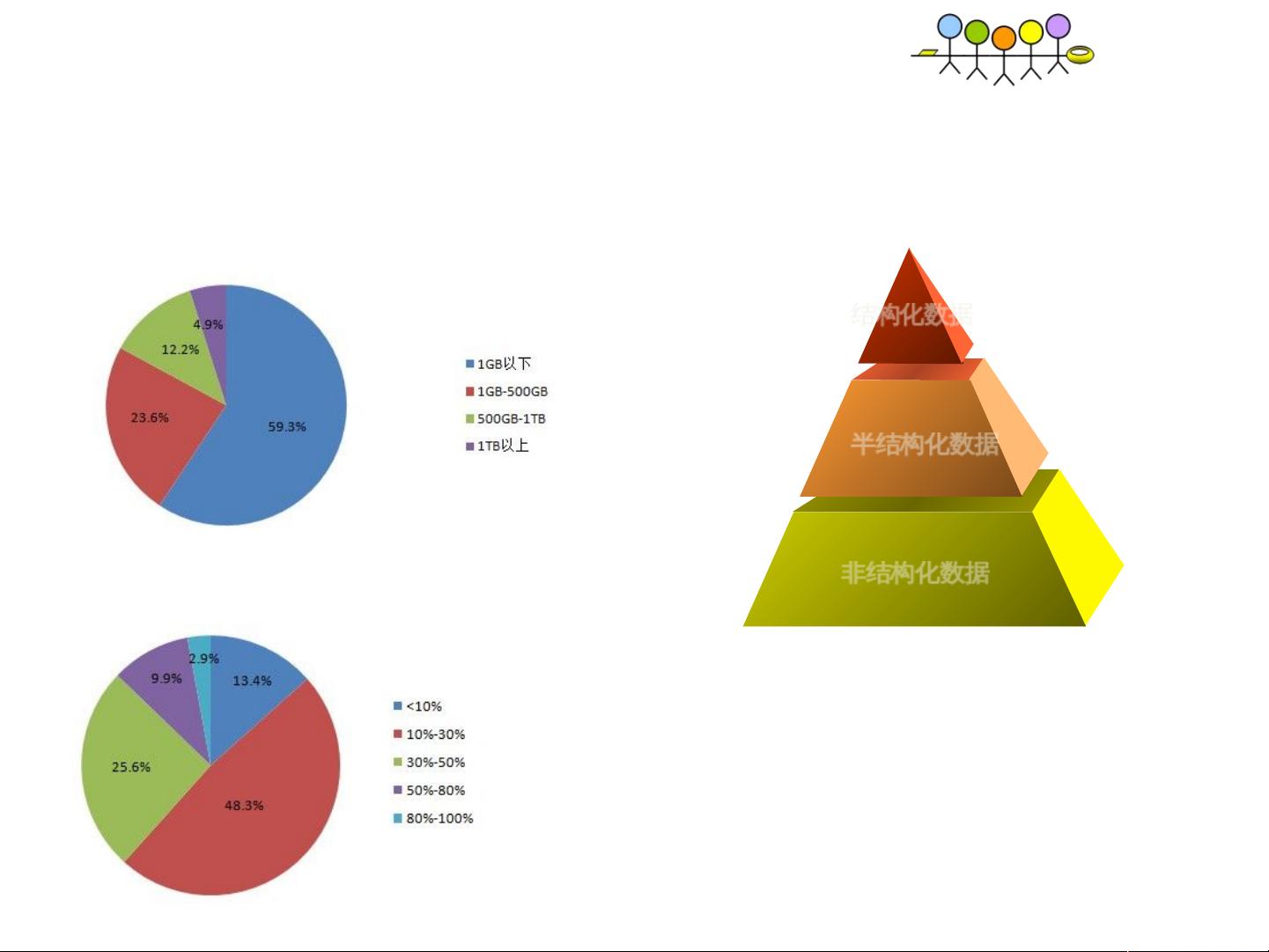

首先,Hadoop的出现是为了解决大规模数据存储和计算的问题。传统的数据库系统在面对PB级别的数据时往往力不从心,而Hadoop通过分布式计算模型,实现了数据的横向扩展,能够高效地处理大量非结构化和半结构化的数据。

Hadoop的核心组件包括HDFS(Hadoop Distributed File System)和MapReduce。HDFS是一种高容错性的分布式文件系统,它将大文件分割成多个块,并将这些块分布在不同的节点上,确保数据的冗余和可靠性。MapReduce则是一种编程模型,用于处理和生成大数据集,通过“映射”(map)和“化简”(reduce)两个阶段实现并行计算。

在Hadoop 2.0中,引入了YARN(Yet Another Resource Negotiator),作为资源管理系统,负责调度和管理集群中的计算资源,提高了系统的资源利用率和整体性能。同时,Hadoop生态还包括其他重要组件,如HBase(分布式NoSQL数据库)、Hive(数据仓库工具)、Pig(数据分析工具)和Spark(快速、通用的计算引擎)等,它们共同构建了一个强大的大数据处理生态系统。

提到最佳实践,培训课程通常会涵盖以下几个方面:

1. 环境配置:包括Hadoop集群的硬件选择、软件安装、配置优化等,以确保系统稳定运行和高效性能。

2. 数据处理:学习如何使用MapReduce编写程序,解决实际问题,以及如何使用Hive进行SQL式的查询分析。

3. 数据安全:探讨Hadoop的安全机制,如HDFS的权限管理、Kerberos认证等,以保障数据的安全性。

4. 故障恢复:理解Hadoop的容错机制,如检查点、数据复制等,以及如何应对集群故障。

5. 监控与优化:学习使用Ambari等工具监控集群状态,识别性能瓶颈,并进行优化调整。

课程可能还会涉及一些具体的应用案例,如智能交通项目中的实时数据分析,电商网站的客户行为分析,社交媒体数据挖掘,以及电信行业的上网日志分析等。这些案例有助于学员理解Hadoop在实际业务场景中的应用和价值。

此外,授课者作为行业专家,拥有丰富的实战经验,曾担任大数据顾问、CEO、架构师和技术总监等职务,还参与了开源项目Aqulia的开发,这意味着课程将包含大量实战经验和前沿洞察。

总结来说,Hadoop大数据处理方案涵盖了从理论到实践的全方位知识,旨在帮助学习者掌握大数据处理的核心技能,应对大数据时代带来的挑战。通过深入学习和实践,不仅可以提升个人在大数据领域的专业能力,也为企业的数据驱动决策提供了坚实的技术支持。