阿里终面:大数据量下10亿数据MySQL高效插入策略

需积分: 0 103 浏览量

更新于2024-08-03

收藏 589KB PDF 举报

在"阿里终面:10亿数据如何快速插入MySQL?"这篇文档中,主要探讨了在大数据场景下如何高效地将10亿级数据快速插入MySQL数据库的问题。MySQL作为关系型数据库系统,其索引结构对性能有着显著影响。文章首先提到,由于MySQL的B+树索引设计,单表建议存储上限为2000万行,这是因为超过此数量会导致索引深度增加,从而降低插入和查询性能。

B+树的叶子节点每页大小为16KB,适合存储1KB大小的数据,这意味着每个叶子节点可以存储大约16条记录。非叶子节点存储的是主键和指向叶子节点的指针,这限制了每个非叶子节点能够关联的叶子节点数量。通过计算,当数据量超过2000万,B+树的层数会从3层升至4层,严重影响性能。

为了优化大量数据的插入,文档提出了以下策略:

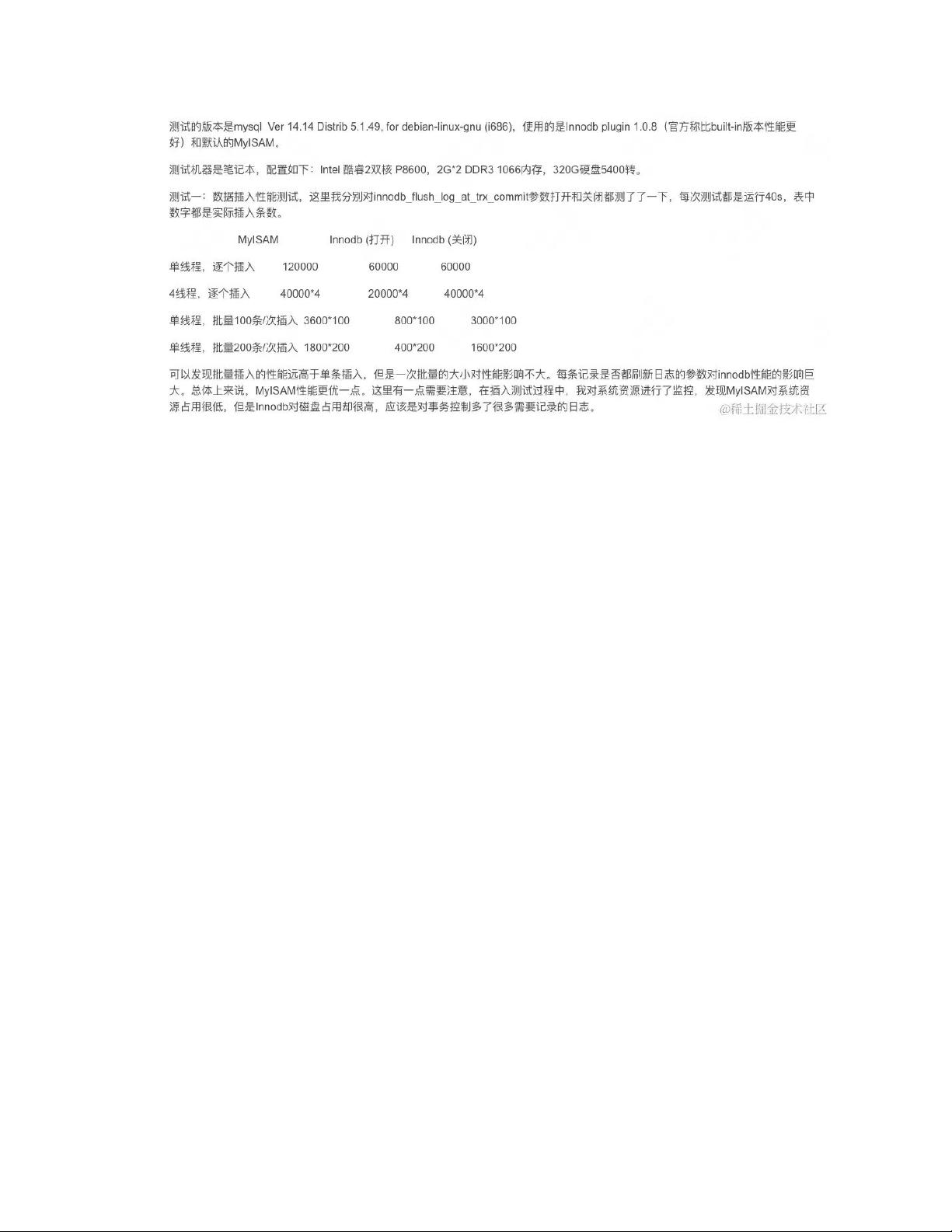

1. 批量写入:单条插入效率低,可以通过批量插入来提高性能。比如,可以将数据分为100个批次,每批100条数据进行写入,利用InnoDB存储引擎的事务支持,确保批量写入的原子性。

2. 顺序插入:按照主键ID的顺序进行插入,能最大化利用索引性能。而非主键索引插入可能导致随机访问,影响插入速度。

3. 并发控制:并发写入同一张表可能会导致数据乱序,因此不建议这样做。可以通过增加批量插入的阈值来提升并发度,而不是并发写入单表。

4. 存储引擎选择:MyISAM虽然插入性能优于InnoDB,但缺乏事务支持,不适合大规模批量插入。因此,在追求高性能的同时,应权衡事务保障的需求。

5. 索引管理:尽量避免在表创建后频繁创建或调整非主键索引,以保持插入性能。

总结来说,本文针对10亿数据快速插入MySQL的挑战,提供了基于批量操作、顺序插入和合理配置存储引擎的解决方案,强调了在大数据处理时对数据库性能优化的重要性。

2022-01-23 上传

2023-09-20 上传

2020-11-09 上传

2023-06-08 上传

2023-06-07 上传

2023-06-07 上传

2023-06-02 上传

2023-07-23 上传

2023-07-15 上传

2023-07-15 上传

毕业小助手

- 粉丝: 2737

- 资源: 5598

最新资源

- Hadoop生态系统与MapReduce详解

- MDS系列三相整流桥模块技术规格与特性

- MFC编程:指针与句柄获取全面解析

- LM06:多模4G高速数据模块,支持GSM至TD-LTE

- 使用Gradle与Nexus构建私有仓库

- JAVA编程规范指南:命名规则与文件样式

- EMC VNX5500 存储系统日常维护指南

- 大数据驱动的互联网用户体验深度管理策略

- 改进型Booth算法:32位浮点阵列乘法器的高速设计与算法比较

- H3CNE网络认证重点知识整理

- Linux环境下MongoDB的详细安装教程

- 压缩文法的等价变换与多余规则删除

- BRMS入门指南:JBOSS安装与基础操作详解

- Win7环境下Android开发环境配置全攻略

- SHT10 C语言程序与LCD1602显示实例及精度校准

- 反垃圾邮件技术:现状与前景