"word2vec.pdf 是一份关于word2vec的介绍,涵盖了其基本原理和应用,主要涉及自然语言处理、深度学习技术,如机器翻译、拼写纠错和智能问答。此外,文件也讨论了语言模型在这些领域的核心作用及其挑战。"

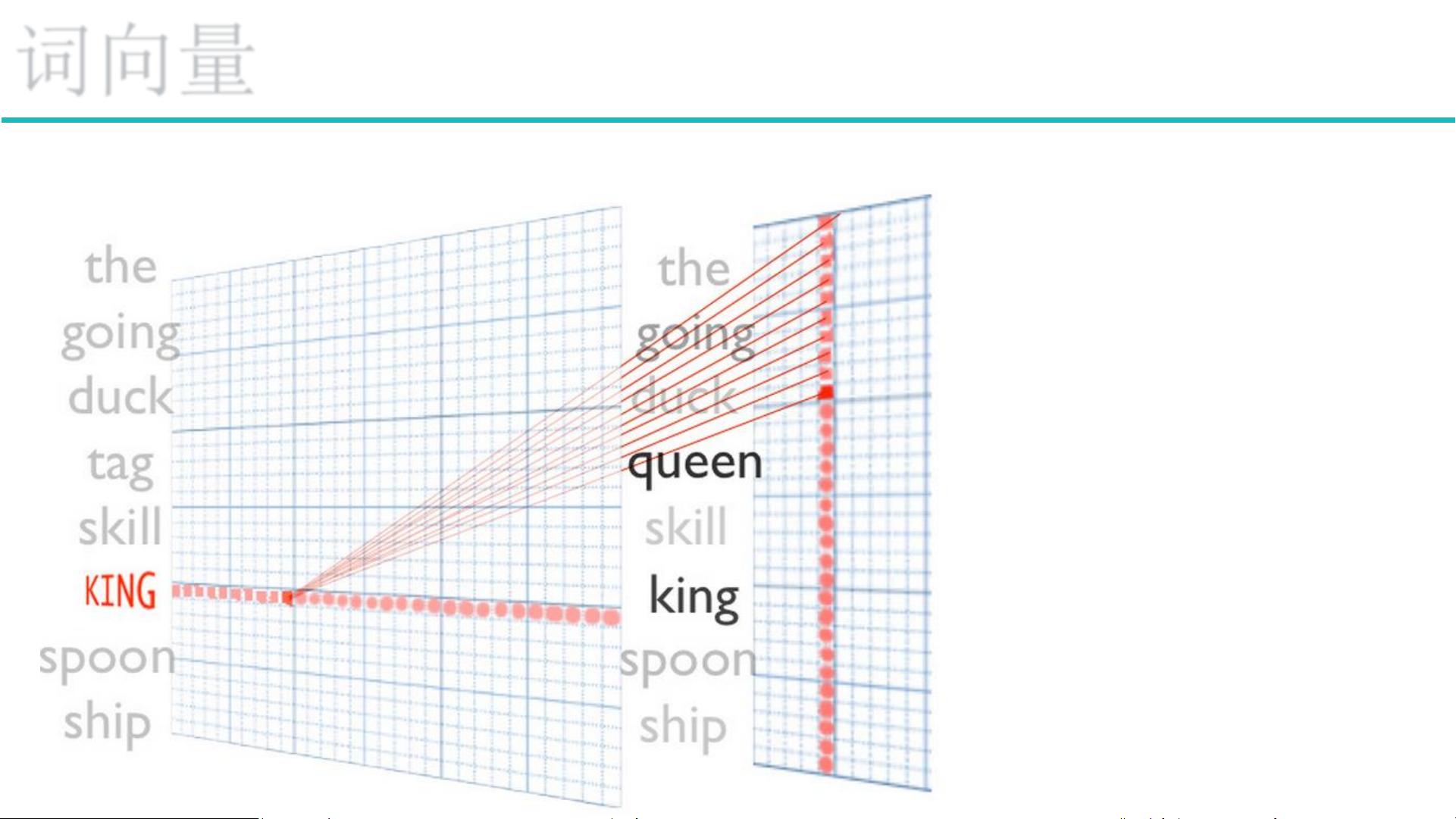

在自然语言处理领域,word2vec是一种广泛应用的工具,它通过学习大量文本数据中的词汇共现模式来生成词向量。这些词向量能够捕捉到词汇之间的语义关系,从而在诸如机器翻译、拼写纠错和智能问答等任务中提高性能。

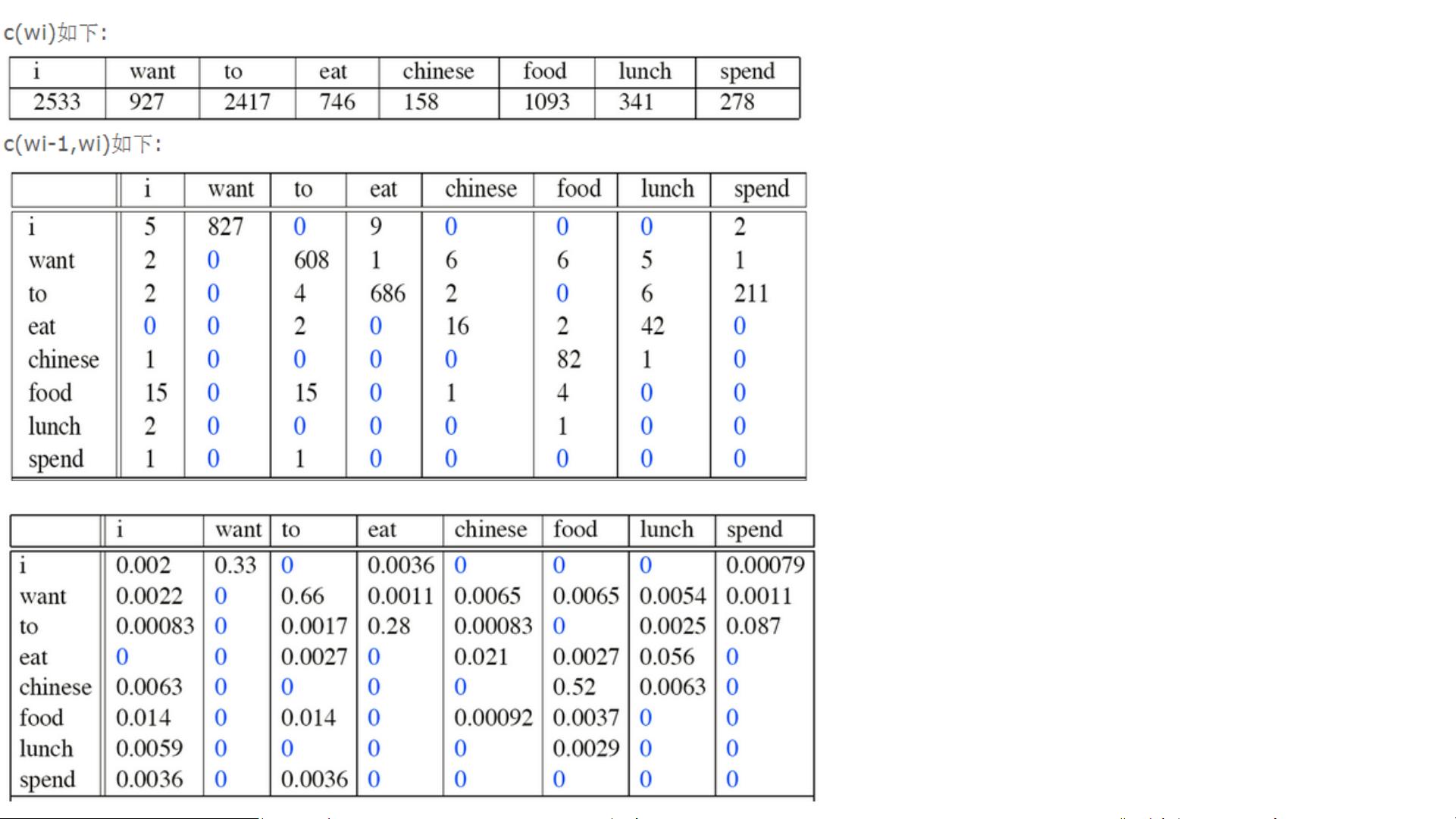

深度学习在word2vec中起着关键作用,它通过神经网络模型来学习词向量。语言模型是深度学习在自然语言处理中的基础,它的目标是估计一个句子或单词序列的概率。例如,p(S)表示句子S的概率,可以分解为每个单词出现的条件概率,如p(w1)p(w2|w1)p(w3|w1,w2)...,这被称为n-gram模型。

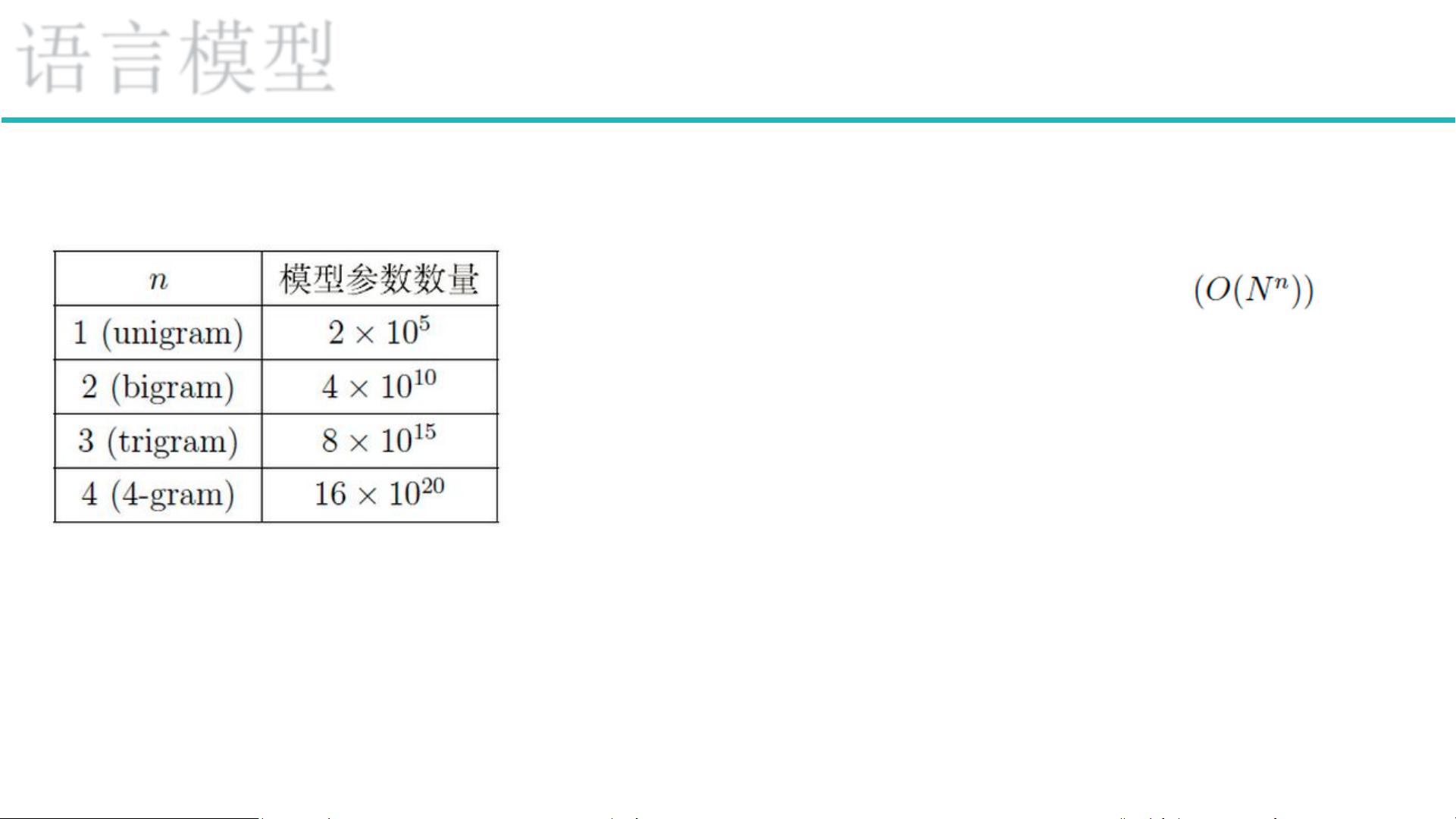

在实际应用中,n-gram模型面临数据稀疏性和参数空间过大的问题。为了解决这些问题,word2vec提出了两种主要的模型:Continuous Bag-of-Words (CBOW) 和 Skip-gram。CBOW模型尝试预测当前词,给定其上下文词汇;而Skip-gram模型则相反,它预测上下文词,给定当前词。这两种方法都利用上下文窗口内的信息,但预测目标不同。

神经网络模型通过大量训练样本学习,例如,对于“我今天去网咖”和“我今天去网吧”,CBOW模型会学习到在“我今天去”的上下文中,“网咖”和“网吧”的概率差异。这种模型的优点在于,即使在语料库中出现次数较少的句子,如“我今天去网吧”,也能得到相对合理的概率估计,不像传统的N-gram模型那样过于依赖历史频率。

Hierarchical Softmax和Negative Sampling是word2vec模型中常用的两种优化策略,它们加速了模型的训练过程并降低了计算复杂度。Hierarchical Softmax通过二叉树结构减少了分类问题的计算量,而Negative Sampling则在每个训练步骤中仅选择少量负样本进行对比学习,提高了效率。

word2vec通过深度学习和巧妙的模型设计,有效地解决了自然语言处理中的词向量表示问题,为后续的文本分析任务提供了强大的预处理手段。无论是机器翻译、拼写纠错,还是智能问答系统,word2vec都发挥了不可或缺的作用。