记忆神经网络与LSTM:语音识别的应用

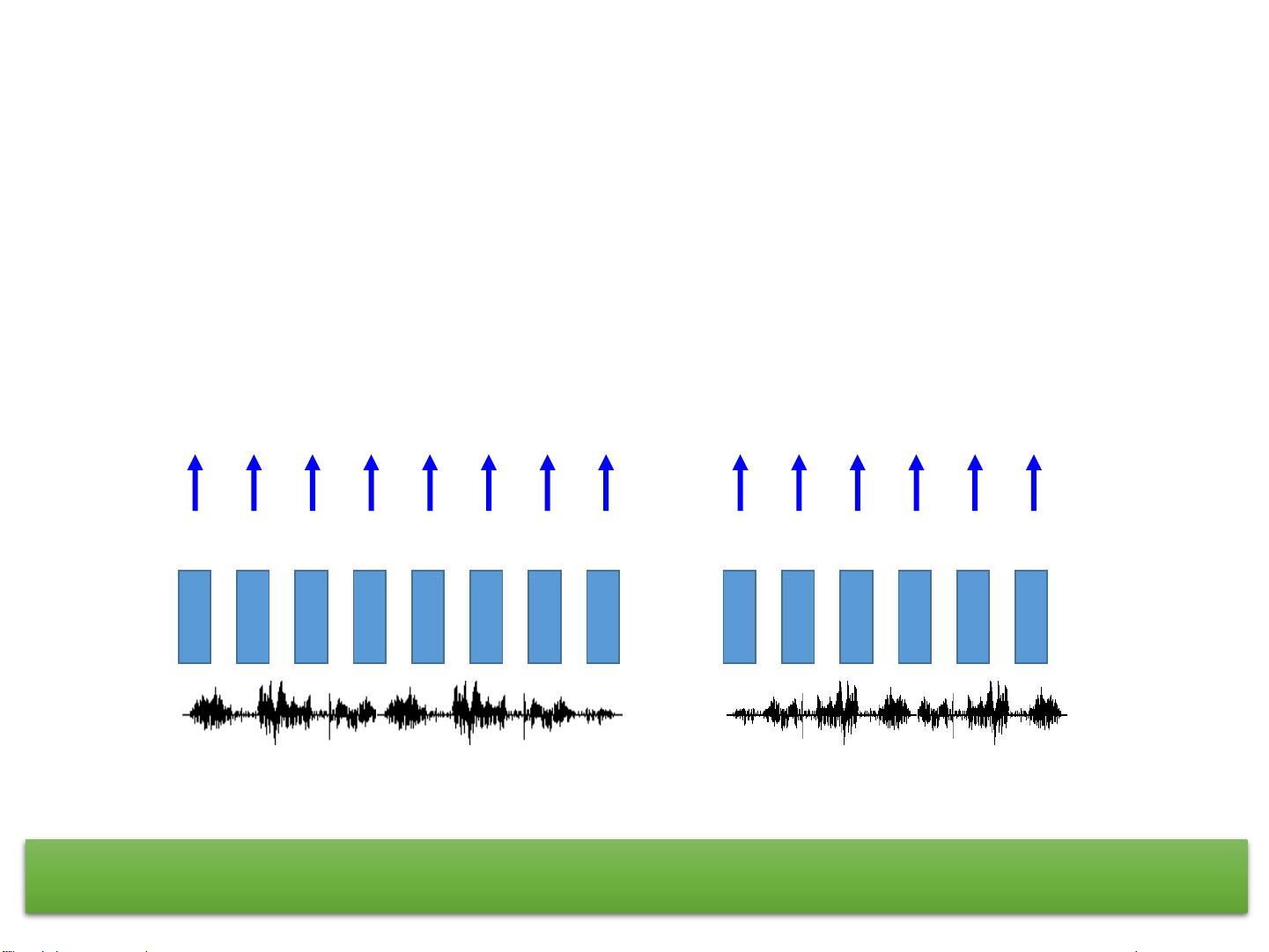

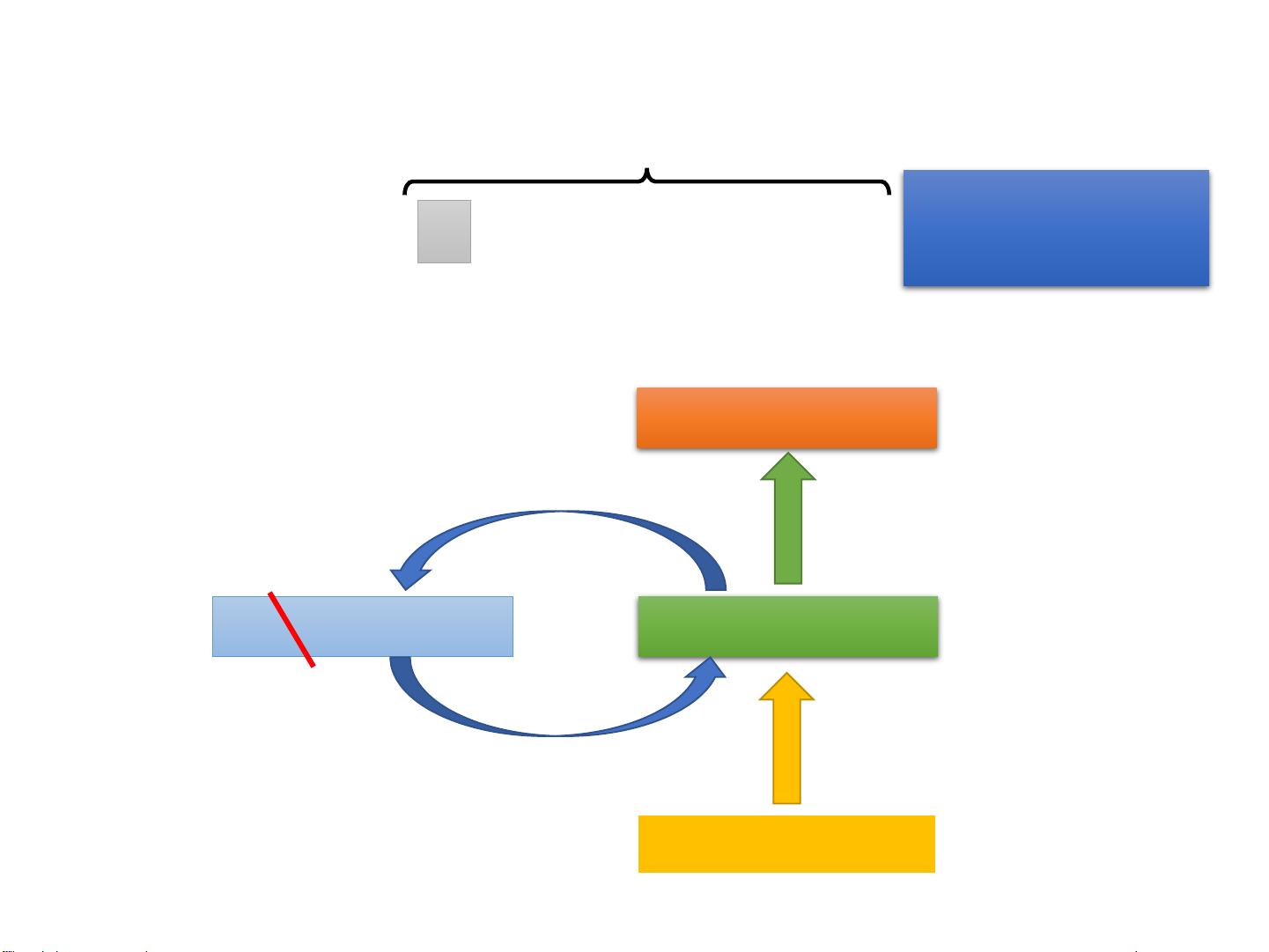

该资源是关于“神经网络与记忆”的一个文档,主要探讨了在神经网络中引入记忆机制的重要性,并提到了长短期记忆网络(LSTM)和循环神经网络(RNN)的不同变体。 正文: 在人工智能和深度学习领域,神经网络已经成为处理复杂任务的关键工具。然而,传统神经网络在处理序列数据时,如语音识别或自然语言处理,往往存在一个问题:它们无法有效地捕捉长期依赖关系。这是因为标准的前馈神经网络(Feedforward Neural Networks)在处理连续序列时,信息流只能单向传递,无法保留过去的信息以供后续时间步使用。这就引出了我们今天要讨论的核心概念——记忆。 记忆在神经网络中的引入是通过循环神经网络(Recurrent Neural Networks, RNN)实现的。RNN 的设计允许信息在时间步之间循环传递,理论上可以解决长距离依赖问题。然而,简单的RNN(也称为Vanilla RNN)在训练过程中可能会遇到梯度消失或梯度爆炸的问题,这限制了它在处理长期依赖时的能力。 长短期记忆网络(Long Short-term Memory, LSTM)是RNN的一种变体,旨在克服这些挑战。LSTM通过引入三个门(输入门、遗忘门和输出门)以及一个称为“细胞状态”的记忆单元,有效地控制了信息的流动和存储。这些门结构允许LSTM在网络中选择性地记住或忘记信息,从而在处理序列数据时能更好地保持长期依赖。 例如,在语音识别中,LSTM可以帮助网络理解一个句子的上下文,即使句子中存在长时间的停顿或间隔。在图示的网络结构中,我们可以看到输入数据(𝑥1, 𝑥2, 𝑥3)经过LSTM单元,其内部的细胞状态(Memory Cell)随着每个时间步更新,存储了过去的信息。输出(𝑦1, 𝑦2, 𝑦3)则依赖于当前输入和细胞状态的组合,通过softmax层转化为概率分布,用于预测下一个词或者音素。 LSTM的变体包括门控循环单元(Gated Recurrent Units, GRU),它们简化了LSTM的设计,但仍然保留了门控机制来管理信息流。这两种模型在许多序列建模任务中都表现出色,比如机器翻译、情感分析、语音识别和文本生成。 记忆在神经网络中的引入极大地扩展了模型处理动态序列数据的能力。LSTM和其变体如GRU通过智能地控制信息的存储和检索,解决了传统RNN的局限,成为了现代深度学习中的关键组成部分。通过理解和应用这些模型,我们可以构建更强大、更适应复杂任务的AI系统。

剩余42页未读,继续阅读

- 粉丝: 0

- 资源: 9

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 新型矿用本安直流稳压电源设计:双重保护电路

- 煤矿掘进工作面安全因素研究:结构方程模型

- 利用同位素位移探测原子内部新型力

- 钻锚机钻臂动力学仿真分析与优化

- 钻孔成像技术在巷道松动圈检测与支护设计中的应用

- 极化与非极化ep碰撞中J/ψ的Sivers与cos2φ效应:理论分析与COMPASS验证

- 新疆矿区1200m深孔钻探关键技术与实践

- 建筑行业事故预防:综合动态事故致因理论的应用

- 北斗卫星监测系统在电网塔形实时监控中的应用

- 煤层气羽状水平井数值模拟:交替隐式算法的应用

- 开放字符串T对偶与双空间坐标变换

- 煤矿瓦斯抽采半径测定新方法——瓦斯储量法

- 大倾角大采高工作面设备稳定与安全控制关键技术

- 超标违规背景下的热波动影响分析

- 中国煤矿选煤设计进展与挑战:历史、现状与未来发展

- 反演技术与RBF神经网络在移动机器人控制中的应用

信息提交成功

信息提交成功