计算广告在线学习算法是一门在现代数字营销中至关重要的技术,它涉及到利用机器学习和优化理论解决广告分配问题,以最大化广告点击率(CTR)并实现个性化推荐。该领域的研究主要围绕如何在实时环境中高效地处理大规模数据流,同时兼顾模型的准确性与稀疏性。

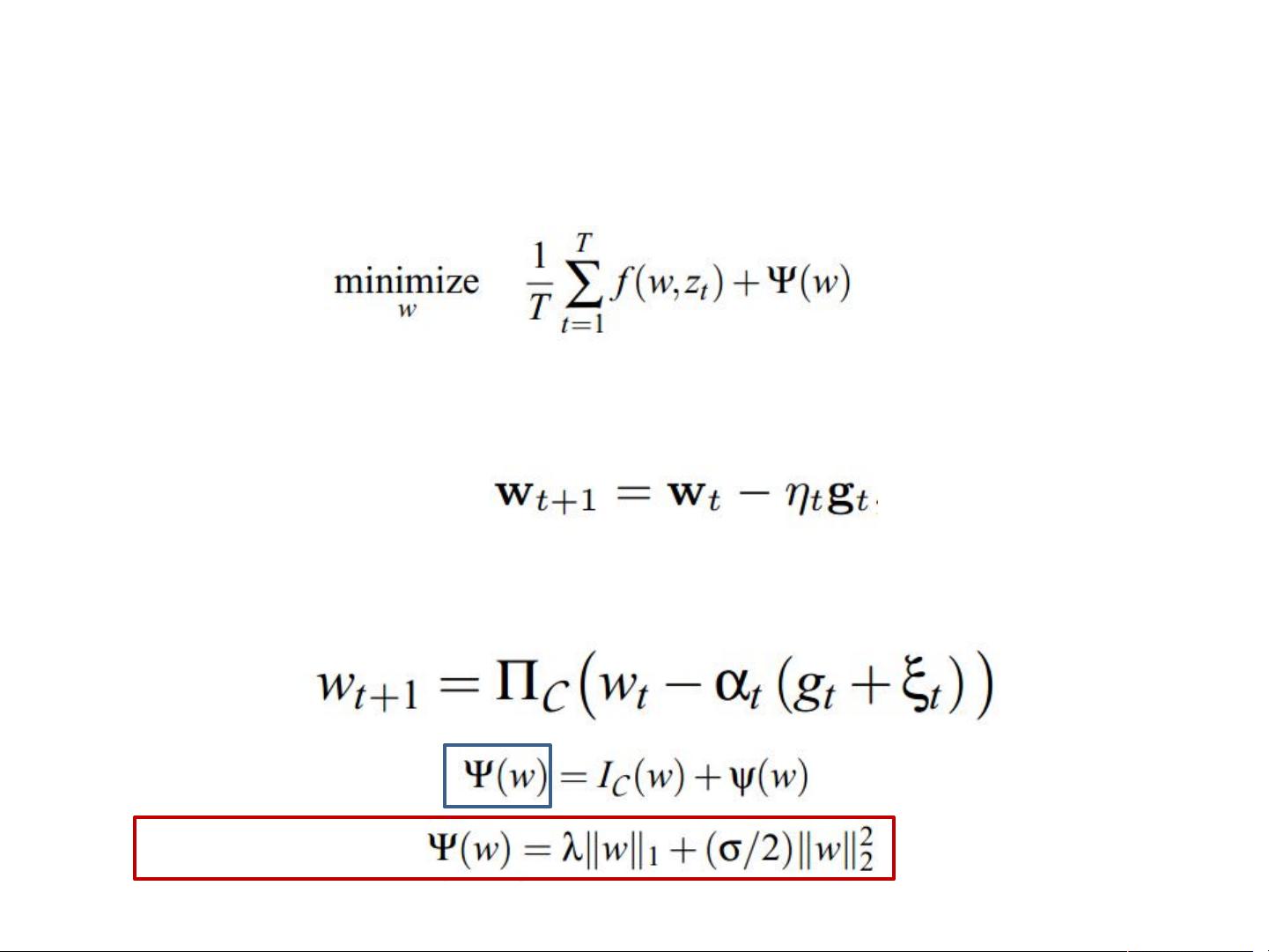

算法的核心是求解无约束优化问题或等价的有约束优化问题,其中最常使用的策略包括全局梯度下降、牛顿法、LBFGS等传统批量方法,以及针对在线环境的在线梯度下降(OGD)和随机梯度下降(SGD)。在优化过程中,为了提升模型的泛化能力和减少过拟合,通常会引入正则化项,如L2范数(软约束)或L1范数(用于促进稀疏性)。

1. **传统方法**:

- **Truncated Gradient (截断梯度法)**:09年的工作提出的一种方法,通过设置阈值对梯度进行截断,以保证特征权重的稀疏性,虽然这种方法简单直观,但可能无法完全消除噪声和非零特征。

- **FOBOS (Forward-Backward Splitting)**:谷歌和伯克利大学在09年开发的黑盒方法,它将特征选择融入到迭代过程中,通过反复训练去除无效特征,但这种方法需要多次运行,对于大规模数据集效率较低。

2. **在线学习算法**:

- **Follow-the-Regularized-Leader (FTRL)**:这是一种动态调整策略,通过遵循正则化后的领导者策略来更新模型参数,适用于实时数据流场景,能够快速响应变化,但可能会遇到对于不可微点的迭代问题。

- **随机梯度下降 (SGD)**:在凸集上进行操作,虽然具有较好的在线学习能力,但可能难以生成真正的稀疏解,特别是仅依赖L1正则化时。

3. **稀疏性考量**:

- L1正则化:虽然能促进模型的稀疏性,但在实际应用中,由于浮点数的精确性问题,两个非常接近的float数可能会有很小的差异,这导致无法得到严格的零权重,因此常结合阈值截断来增强稀疏效果。

- **Truncated Gradient 的变种**:如FOBOS,它们都是通过限制特征的重要性来实现稀疏性,但需要不断迭代和尝试,对资源消耗较大。

计算广告在线学习算法的关键在于平衡实时性、准确性与稀疏性之间的权衡,不同的方法各有优缺点,选择哪种取决于应用场景的需求和数据特性。随着大数据和AI的发展,这些算法的研究也在不断进化,以适应不断变化的广告市场环境。