深度学习中激活函数LeafSpring的研究与对比分析

2.虚拟产品一经售出概不退款(资源遇到问题,请及时私信上传者)

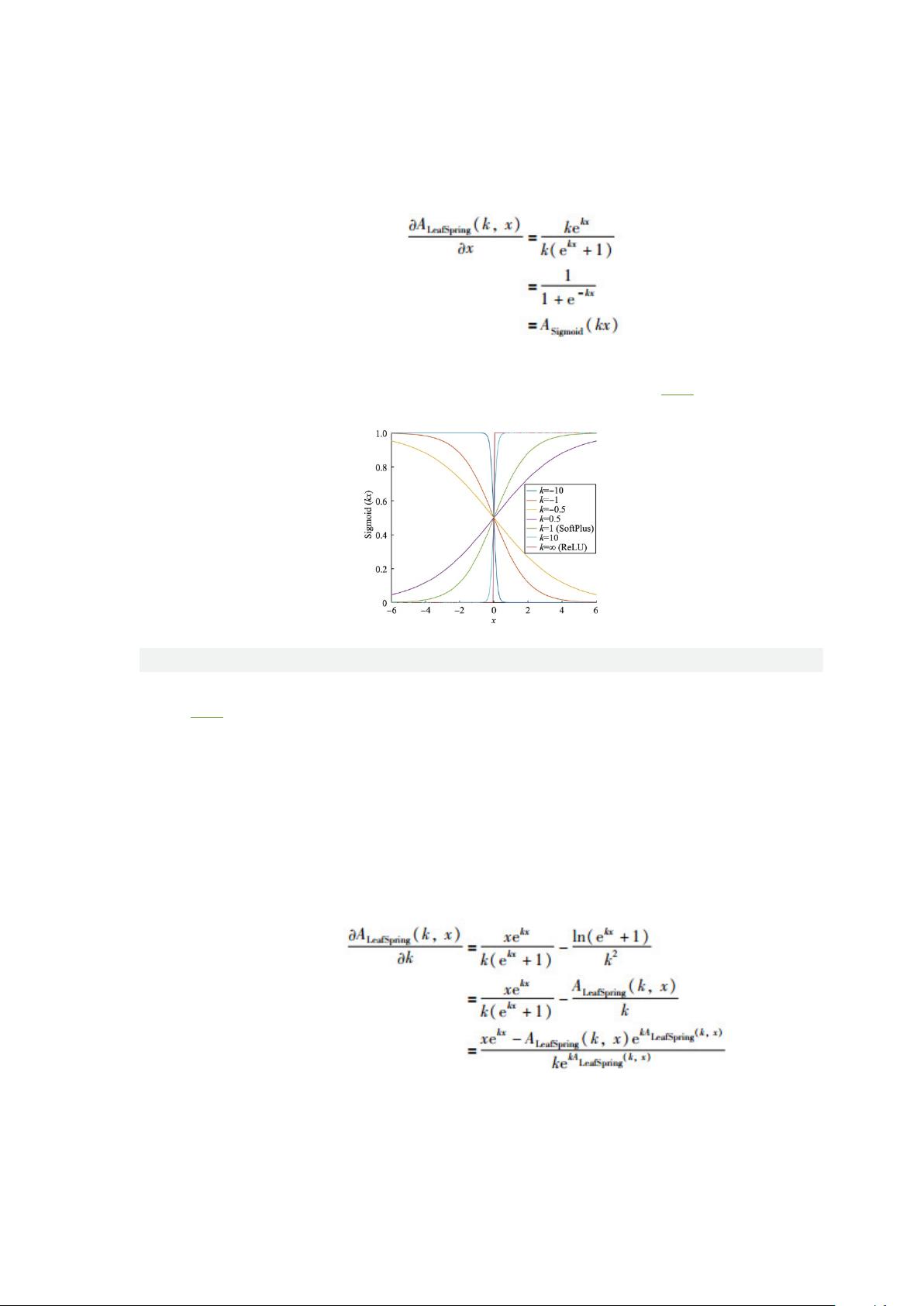

"本文档深入探讨了激活函数在深度学习中的重要性,并针对ReLU激活函数的局限性,分析了当前流行的ReLU变体以及Softplus激活函数的优缺点。作者提出了一种新的激活函数——LeafSpring,旨在解决ReLU及其变体存在的问题,提高神经网络的性能和效率。" 在深度学习领域,激活函数扮演着至关重要的角色,它们赋予神经网络非线性能力,使得模型能够处理复杂的数据模式。传统的激活函数如Sigmoid和Tanh在早期的神经网络中广泛使用,但随着ReLU(Rectified Linear Unit)的出现,它们逐渐被替代。ReLU因其简单的数学运算和高效的计算速度而受到青睐,尤其是在大型神经网络中。然而,ReLU也存在一些问题,如负区间的饱和导致的“死亡ReLU”现象,以及在拟合某些特定函数时需要更多的神经元。 为了解决ReLU的这些问题,研究者们提出了一系列ReLU的变体,如LeakyReLU、Parametric ReLU (PReLU)、Randomized Leaky ReLU (RReLU)、Exponential Linear Units (ELU)、Scaled Exponential Linear Units (SELU)和S-shaped ReLU (SReLU)。这些变体通过调整ReLU的负区行为,试图改善收敛速度和减少“死亡神经元”的情况。尽管这些方法在一定程度上缓解了ReLU的问题,但它们仍然是基于ReLU的基本结构,没有根本性地解决ReLU的本质局限。 Softplus激活函数作为ReLU的一个替代,它是一个连续平滑的函数,能更好地拟合光滑的非线性函数。Softplus的输出始终为正,其导数也为非零连续函数,避免了“死亡神经元”。然而,Softplus的导数通常小于1,可能导致梯度消失问题,而且其计算复杂度较高,涉及指数函数,这在大规模计算时可能成为瓶颈。 为克服现有激活函数的局限,文献提出了LeafSpring激活函数。LeafSpring的设计灵感来源于ReLU和Softplus的优点,它试图提供一个更平滑且无饱和的响应,同时避免梯度消失和计算效率低下的问题。通过对激活函数的结构进行创新,LeafSpring有望在保持计算效率的同时,提高神经网络在各种数据集上的泛化能力和训练速度。 通过多数据集的对比研究,作者评估了LeafSpring相对于其他激活函数的性能。这样的实验设计有助于揭示LeafSpring在不同任务和数据集上的适用性和优势,从而为深度学习模型的选择提供依据。LeafSpring激活函数的构建和研究对于优化神经网络架构,提升模型性能具有重要意义,对于深度学习领域的进步和发展具有积极的推动作用。

剩余16页未读,继续阅读

- 粉丝: 4341

- 资源: 1万+

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 多模态联合稀疏表示在视频目标跟踪中的应用

- Kubernetes资源管控与Gardener开源软件实践解析

- MPI集群监控与负载平衡策略

- 自动化PHP安全漏洞检测:静态代码分析与数据流方法

- 青苔数据CEO程永:技术生态与阿里云开放创新

- 制造业转型: HyperX引领企业上云策略

- 赵维五分享:航空工业电子采购上云实战与运维策略

- 单片机控制的LED点阵显示屏设计及其实现

- 驻云科技李俊涛:AI驱动的云上服务新趋势与挑战

- 6LoWPAN物联网边界路由器:设计与实现

- 猩便利工程师仲小玉:Terraform云资源管理最佳实践与团队协作

- 类差分度改进的互信息特征选择提升文本分类性能

- VERITAS与阿里云合作的混合云转型与数据保护方案

- 云制造中的生产线仿真模型设计与虚拟化研究

- 汪洋在PostgresChina2018分享:高可用 PostgreSQL 工具与架构设计

- 2018 PostgresChina大会:阿里云时空引擎Ganos在PostgreSQL中的创新应用与多模型存储

信息提交成功

信息提交成功