深度学习面试精华:七月在线DL面经解析

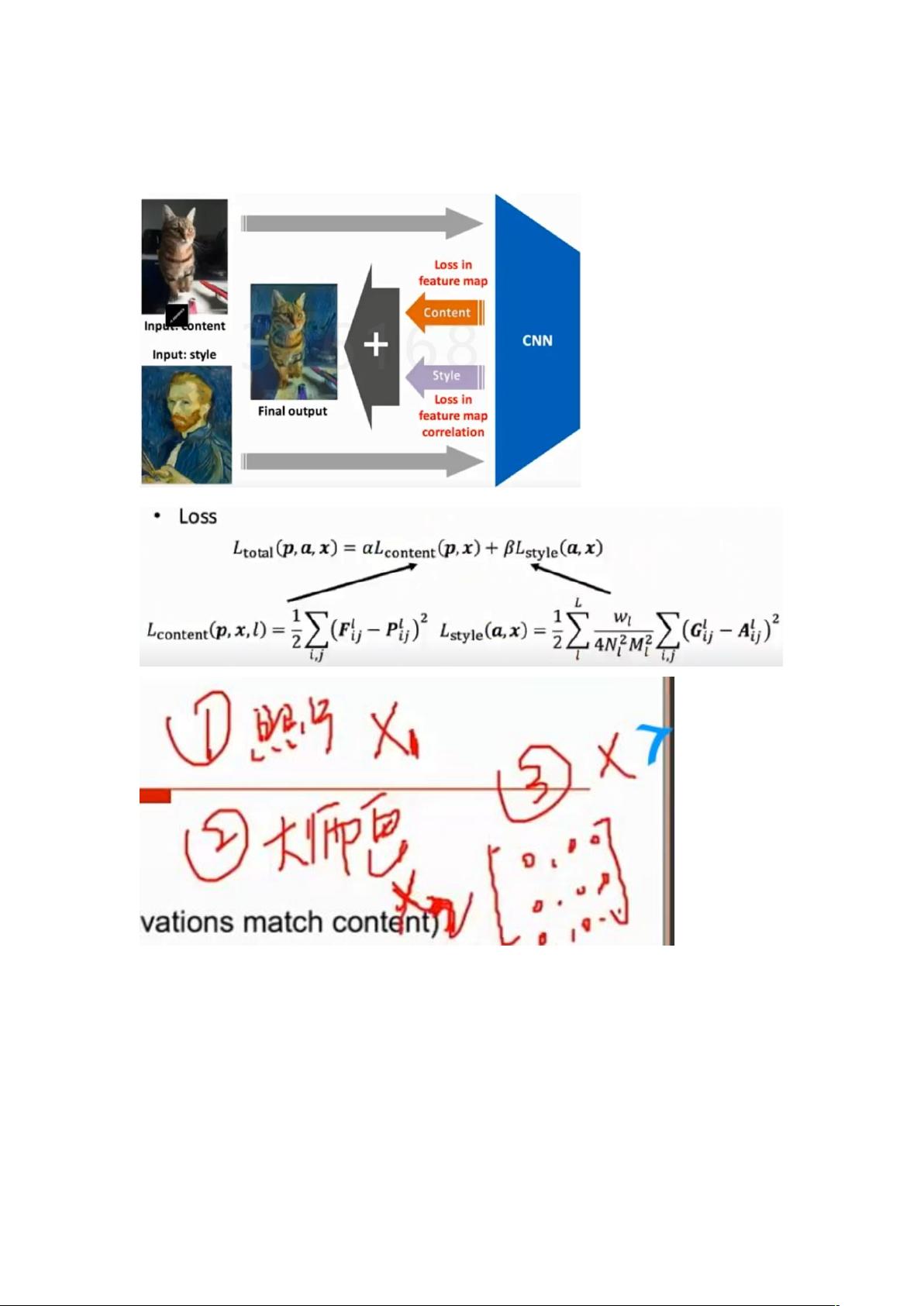

"这篇文档包含了作者在七月在线学习深度学习面试知识后的个人总结,主要涉及了深度学习面试中常见的问题,如梯度下降算法、优化方法、矩阵运算效率以及处理大数据的方法等。文档还提到了一些重要的算法和概念,如H-K算法与感知器算法的对比、混沌度在NLP评估中的作用,以及正则化和dropout在防止过拟合中的应用。" 深度学习面试中的关键知识点包括: 1. **梯度下降算法**:这是深度学习模型训练中最常用的优化算法之一。其基本步骤包括随机初始化权重和偏差,将输入传递给网络并计算输出,然后通过比较预测值和真实值的差异来调整权重,以减少误差。这个过程会反复进行,直至找到最佳权重。 2. **H-K算法与感知器算法的比较**:H-K算法(也称为最小均方误差准则)相对于感知器算法,具有以下优点:它不仅可以用于线性可分数据,也可以用于非线性可分数据,并且在处理线性可分数据时能找出最优解。在非线性可分情况下,H-K算法能检测到不可分性并结束迭代。 3. **矩阵运算效率优化**:在处理大型矩阵乘法时,选择合适的运算顺序可以提高效率。根据题目中给出的矩阵尺寸m < n < p < q,计算效率最高的方式是先计算(AB),然后再与C相乘,即(AB)C,因为这能减少总的乘法和加法操作。 4. **处理大数据**:当数据量太大,无法一次性装入内存时,可以采用随机梯度下降(SGD)策略,每次仅处理一个样本,以降低对内存的需求。批量梯度下降法则是一次处理所有样本,但在内存有限的情况下不适用。 5. **优化方法**:除了基本的SGD,还有各种变种,如AdaGrad、Momentum、NesterovMomentum、Adagrad、RMSprop和Adam等。这些方法旨在改进学习率的调整,以更有效地收敛到局部或全局最优解。例如,AdaGrad通过自适应学习率处理稀疏数据,而Adam结合了Momentum和RMSprop的优点。 6. **混沌度(Perplexity)**:在自然语言处理(NLP)中,混沌度用于评估模型的性能。一个较低的混沌度表示模型对数据的预测更好,因此通常来说,模型的混沌度越小,性能越好。 7. **防止过拟合**:正则化是通过添加惩罚项来限制模型复杂度,避免过拟合。 dropout是一种常用的正则化技术,它在训练过程中随机忽略一部分神经元,以此强制模型学习到更多冗余特征,提高泛化能力。 这些知识点涵盖了深度学习面试中的基础理论、算法实现和实践策略,对于准备深度学习面试的候选人来说,是非常有价值的学习资料。

剩余26页未读,继续阅读

- 粉丝: 55

- 资源: 2

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 前端面试必问:真实项目经验大揭秘

- 永磁同步电机二阶自抗扰神经网络控制技术与实践

- 基于HAL库的LoRa通讯与SHT30温湿度测量项目

- avaWeb-mast推荐系统开发实战指南

- 慧鱼SolidWorks零件模型库:设计与创新的强大工具

- MATLAB实现稀疏傅里叶变换(SFFT)代码及测试

- ChatGPT联网模式亮相,体验智能压缩技术.zip

- 掌握进程保护的HOOK API技术

- 基于.Net的日用品网站开发:设计、实现与分析

- MyBatis-Spring 1.3.2版本下载指南

- 开源全能媒体播放器:小戴媒体播放器2 5.1-3

- 华为eNSP参考文档:DHCP与VRP操作指南

- SpringMyBatis实现疫苗接种预约系统

- VHDL实现倒车雷达系统源码免费提供

- 掌握软件测评师考试要点:历年真题解析

- 轻松下载微信视频号内容的新工具介绍

信息提交成功

信息提交成功