Word2Vec深度解析:原理与训练流程

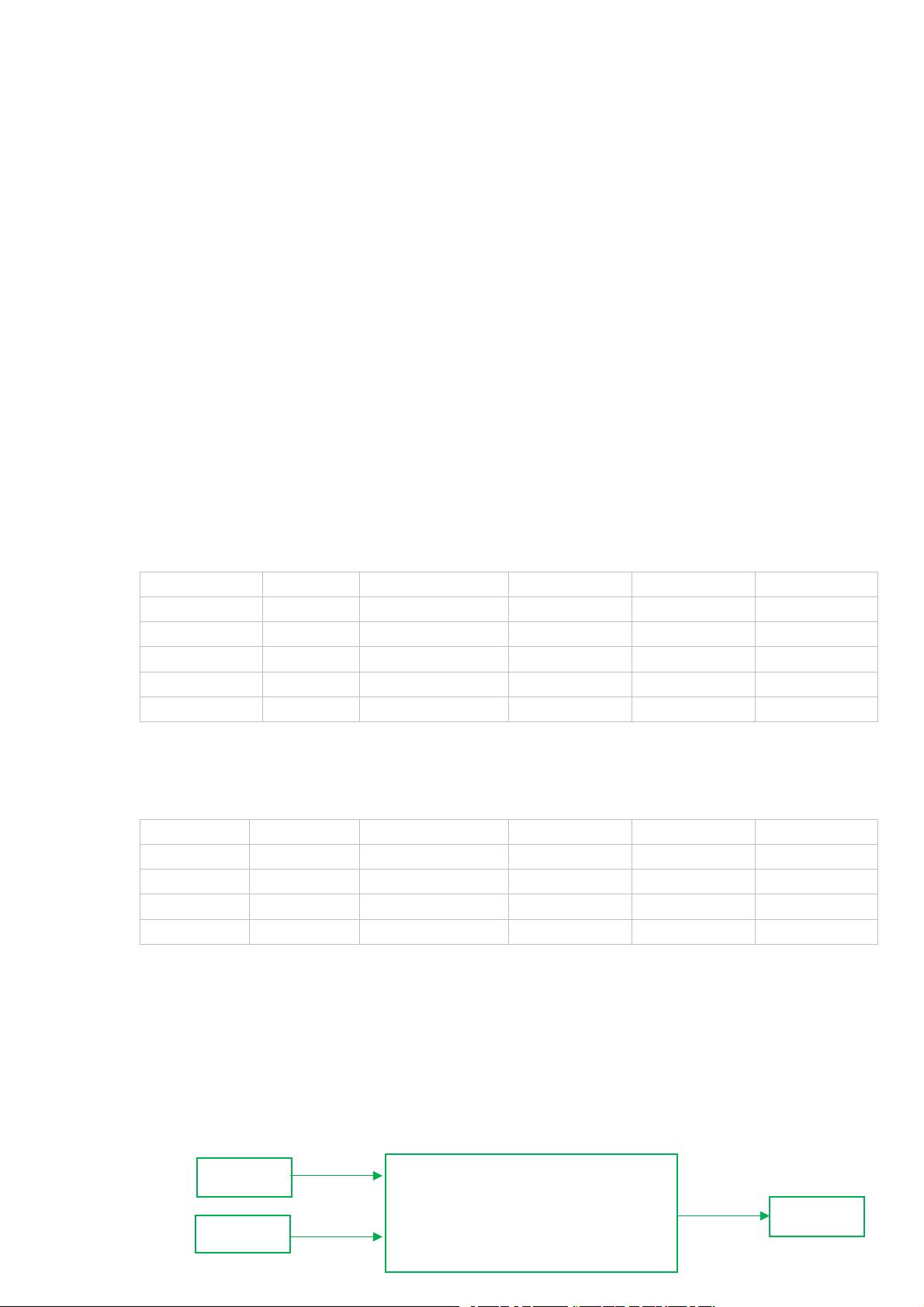

Word2Vec是一种强大的自然语言处理技术,它旨在将单词转化为含有语义信息的向量,以便于计算机更好地理解和处理文本数据。Word2Vec的核心概念起源于两个主要模型:Continuous Bag of Words (CBOW) 和 Skip-gram。CBOW模型通过上下文中的词预测中心词,而Skip-gram则相反,使用中心词预测其周围的上下文。 Word2vec的工作原理主要包括以下几个步骤: 1. **模型构建**:词向量的维度通常在50到300维之间,每个词都被映射到这个高维空间中,使得具有相似语义的词在向量空间中彼此靠近。这种表示方式捕捉了词与词之间的共性和上下文关系。 2. **训练过程**:训练过程分为前向传播和反向传播两部分。在前向传播阶段,模型接收输入的词向量表示,然后计算损失函数以评估模型的性能。损失函数通常是预测下一个词的概率,如果模型的预测准确度较低,就会产生误差。在反向传播阶段,误差被用于调整模型的权重参数和输入向量(embedding),以优化模型。 3. **负采样**:在实际应用中,训练集中的标签通常是全1,这意味着所有预测都是正样本。为了解决这个问题,负采样技术被引入,即在每次训练时,除了正样本外,还会随机选择一定数量的负样本(错误的词对)进行预测,以增强模型区分真正相关词的能力。 4. **模型对比**:Word2vec有两个主要的实现方法:CBOW和Skip-gram。CBOW使用上下文信息预测中心词,而Skip-gram则是反过来。尽管这两种方法在理论上有区别,但在实践中它们的效果往往相近,可以根据具体应用场景和计算资源选择适合的方法。 5. **新词处理**:对于新加入的词,可以将其加入到预训练的模型中,通过训练得到相应的词向量表示,使其适应已有的语义结构。 6. **预测和应用**:Word2vec模型的最终目标是生成包含上下文信息的词向量,这些向量可用于各种NLP任务,如文本分类、情感分析、机器翻译等,通过计算相似度或进行向量运算来实现。 Word2Vec是一种基础但强大的工具,它利用神经网络和高效的负采样策略,成功地将词语转化为语义相关的向量表示,为自然语言处理任务提供了强有力的底层支持。

下载后可阅读完整内容,剩余4页未读,立即下载

- 粉丝: 15

- 资源: 299

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 十种常见电感线圈电感量计算公式详解

- 军用车辆:CAN总线的集成与优势

- CAN总线在汽车智能换档系统中的作用与实现

- CAN总线数据超载问题及解决策略

- 汽车车身系统CAN总线设计与应用

- SAP企业需求深度剖析:财务会计与供应链的关键流程与改进策略

- CAN总线在发动机电控系统中的通信设计实践

- Spring与iBATIS整合:快速开发与比较分析

- CAN总线驱动的整车管理系统硬件设计详解

- CAN总线通讯智能节点设计与实现

- DSP实现电动汽车CAN总线通讯技术

- CAN协议网关设计:自动位速率检测与互连

- Xcode免证书调试iPad程序开发指南

- 分布式数据库查询优化算法探讨

- Win7安装VC++6.0完全指南:解决兼容性与Office冲突

- MFC实现学生信息管理系统:登录与数据库操作

信息提交成功

信息提交成功