神经网络发展史与计算模型详解

版权申诉

199 浏览量

更新于2024-06-13

收藏 2.55MB DOC 举报

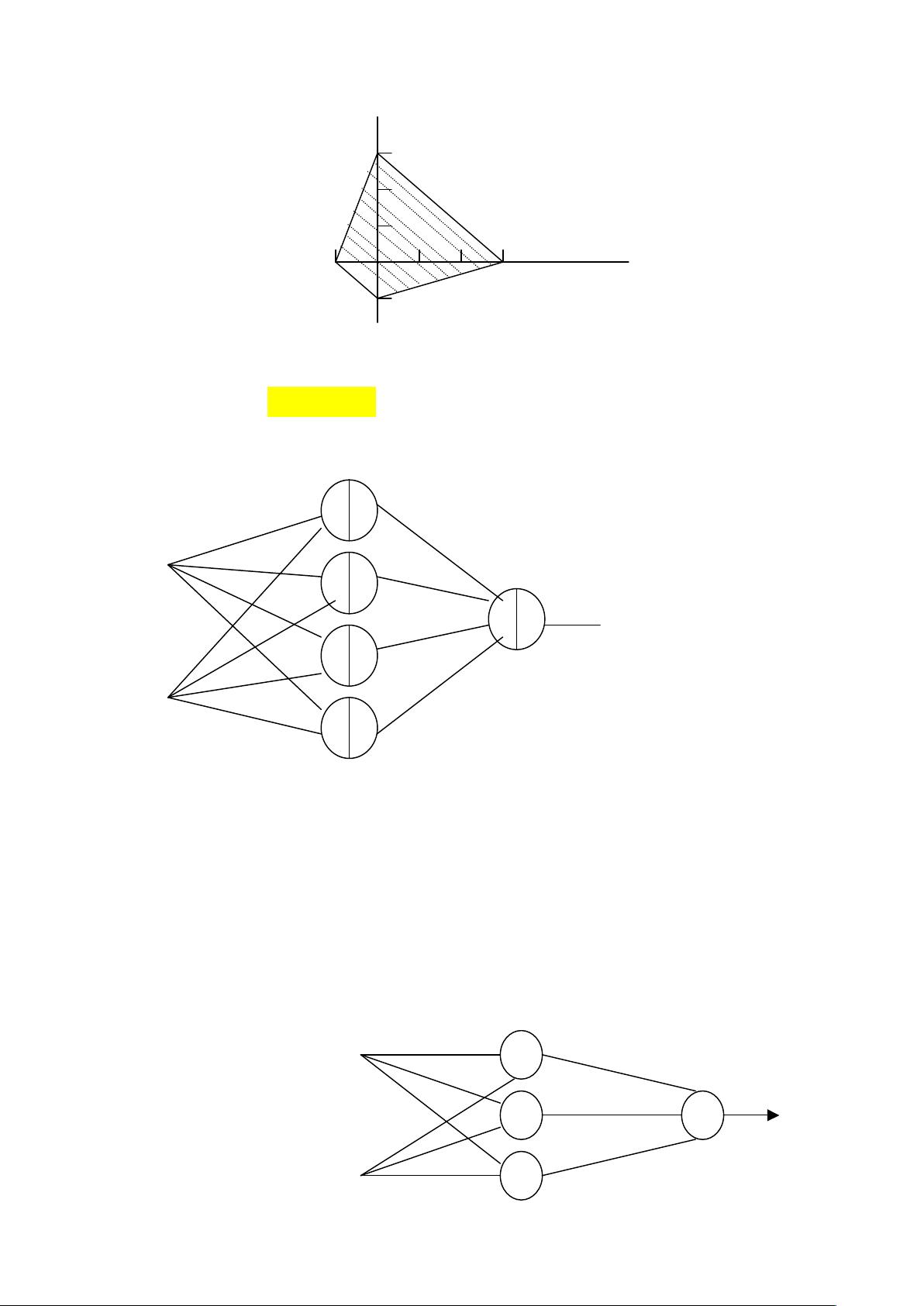

本资源是一份详细的神经网络讲义合集,分为13讲,涵盖了神经网络的基础概念、发展历程以及关键理论。首先,第一章从神经网络的定义开始,强调了它与计算机的区别,指出计算机经历了电子管、晶体管等技术变革,而智能计算机被认为是第五代,尽管速度提升显著,但在模拟人类智能方面还有待突破。计算机由二进制系统构成,主要由中央处理器、存储器、输入输出设备等模块组成。

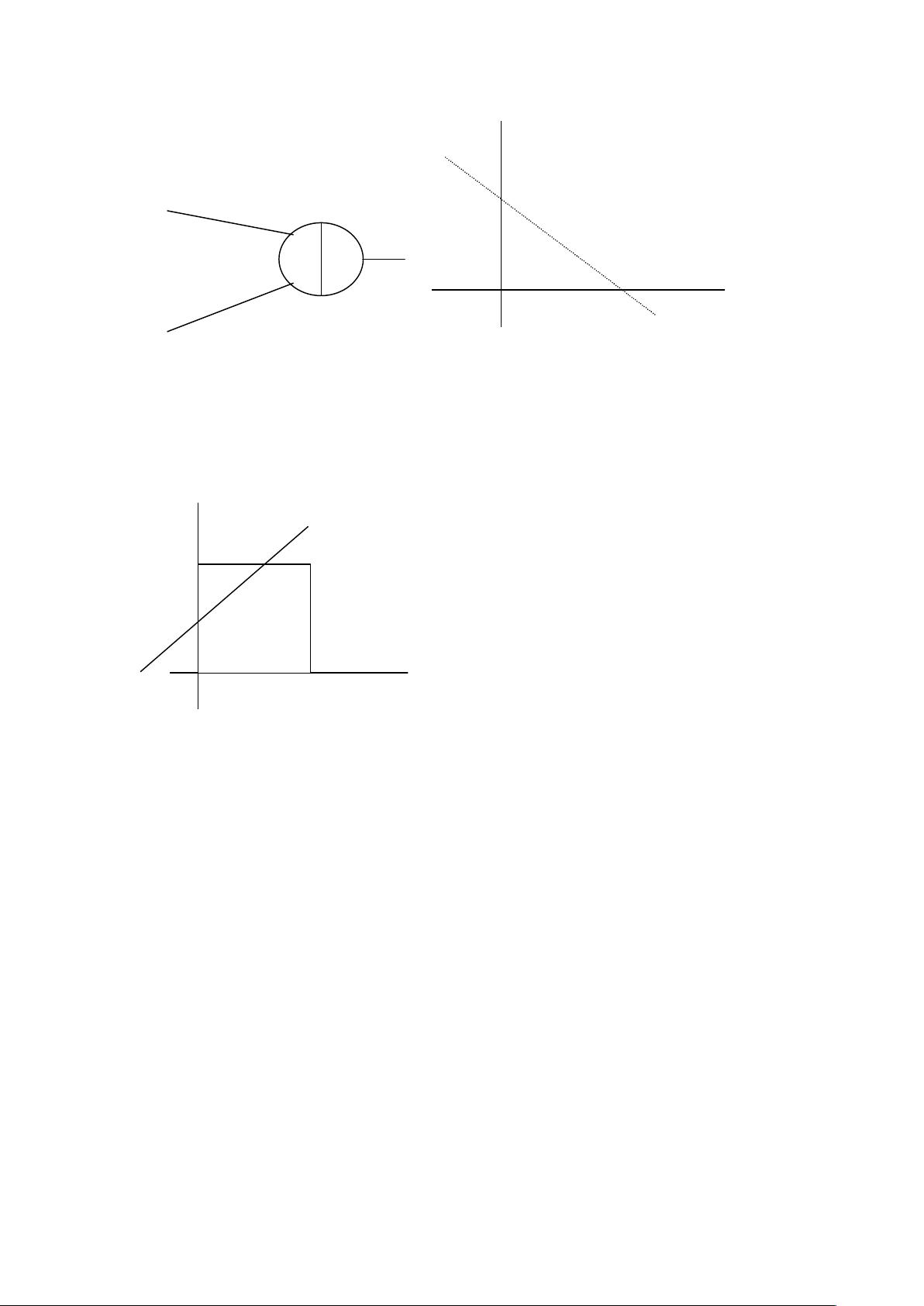

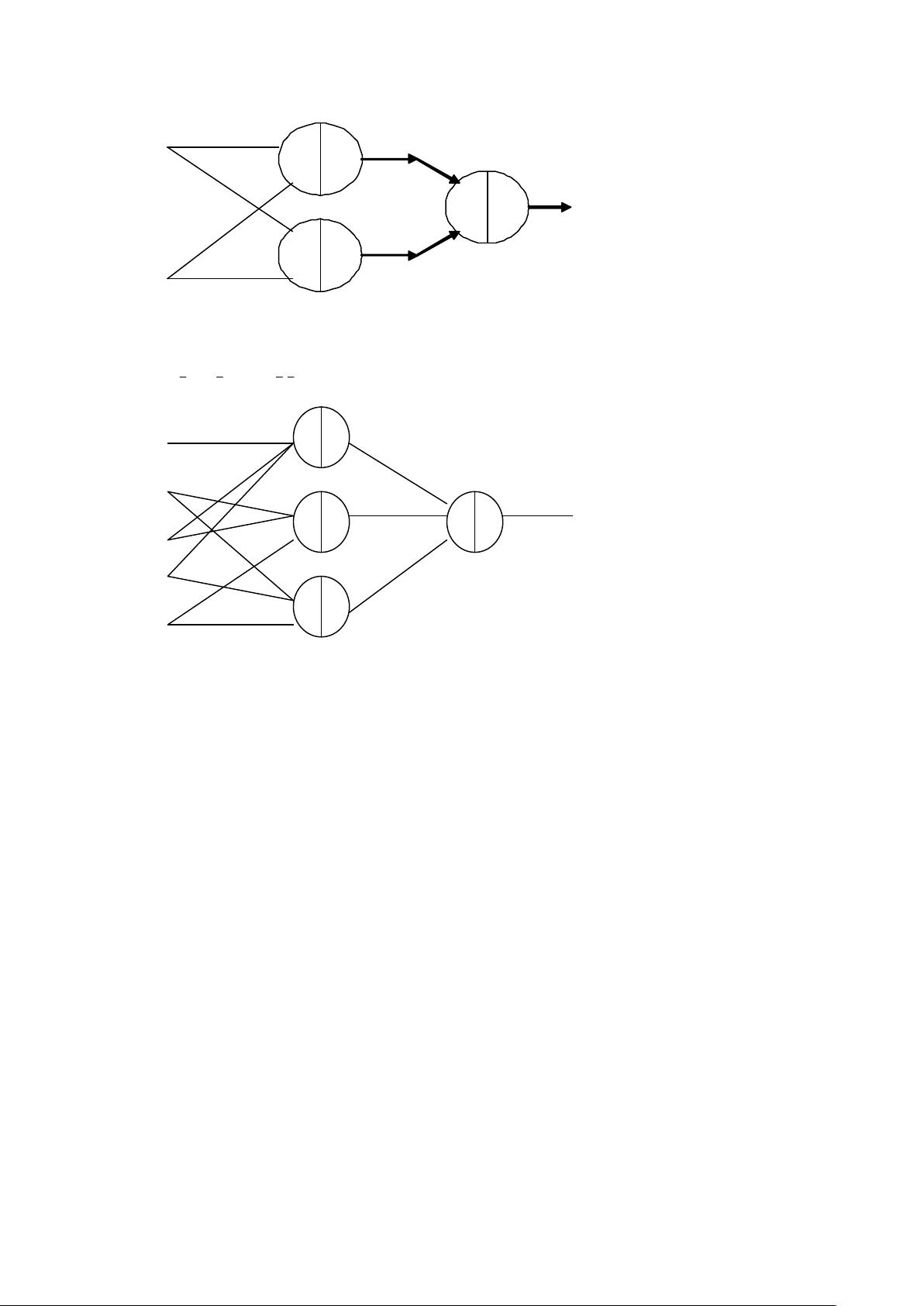

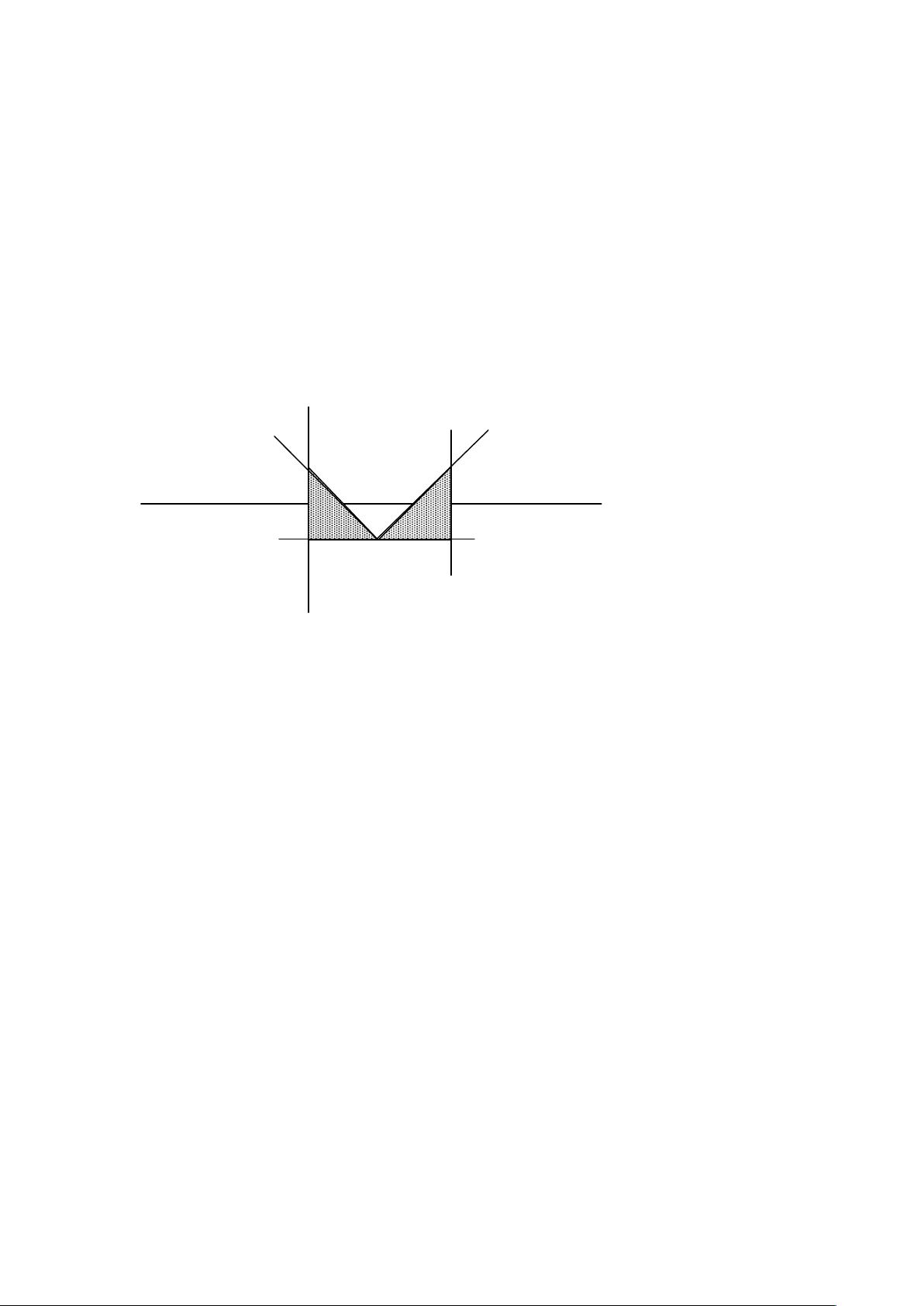

神经网络的发展历程富有传奇色彩,起源于19世纪末和20世纪初,科学家们试图通过研究生物体的智能来建立计算模型。1940年,Warren McCulloch和Walter Pitts提出了人工神经元模型,奠定了现代神经网络的基础。Hebb规则在1949年提出,阐述了神经元之间信息传递和相互作用的学习机制。

Rosenblatt于1958年创造了Perceptron,这是首个实用化的神经网络模型,主要用于电话回声消除。然而,随后Minsky和Papert在1969年出版的著作对感知器的局限性提出了批评,导致神经网络研究一度停滞。这个时期也是计算机快速发展的黄金岁月,但神经网络研究面临挑战。

1972年,Teuvo Kohonen和James Anderson发明了自组织神经网络,Stephen Grossberg也发现了其新特性,证明即使在困难时期,科学家也能在不那么热门的领域取得成果。尽管1960年代至1980年代期间,神经网络研究相对平静,随着计算机技术的困扰逐渐解决,1980年后神经网络研究再次迎来快速发展。

本讲义不仅介绍了神经网络的理论基础,还穿插了历史事件和科学家的故事,帮助读者理解神经网络如何从理论到实践的演进,以及其中的关键技术和突破。对于想要深入理解神经网络的学者和从业者来说,这是一份宝贵的参考资料。

2023-09-07 上传

2023-05-01 上传

2023-06-30 上传

2023-08-26 上传

2023-09-02 上传

2024-06-23 上传

通信瓦工

- 粉丝: 362

- 资源: 5894

最新资源

- 计算机人脸表情动画技术发展综述

- 关系数据库的关键字搜索技术综述:模型、架构与未来趋势

- 迭代自适应逆滤波在语音情感识别中的应用

- 概念知识树在旅游领域智能分析中的应用

- 构建is-a层次与OWL本体集成:理论与算法

- 基于语义元的相似度计算方法研究:改进与有效性验证

- 网格梯度多密度聚类算法:去噪与高效聚类

- 网格服务工作流动态调度算法PGSWA研究

- 突发事件连锁反应网络模型与应急预警分析

- BA网络上的病毒营销与网站推广仿真研究

- 离散HSMM故障预测模型:有效提升系统状态预测

- 煤矿安全评价:信息融合与可拓理论的应用

- 多维度Petri网工作流模型MD_WFN:统一建模与应用研究

- 面向过程追踪的知识安全描述方法

- 基于收益的软件过程资源调度优化策略

- 多核环境下基于数据流Java的Web服务器优化实现提升性能