自我与交叉引导学习:提升小样本分割性能

需积分: 13 117 浏览量

更新于2024-07-08

收藏 3.58MB PPTX 举报

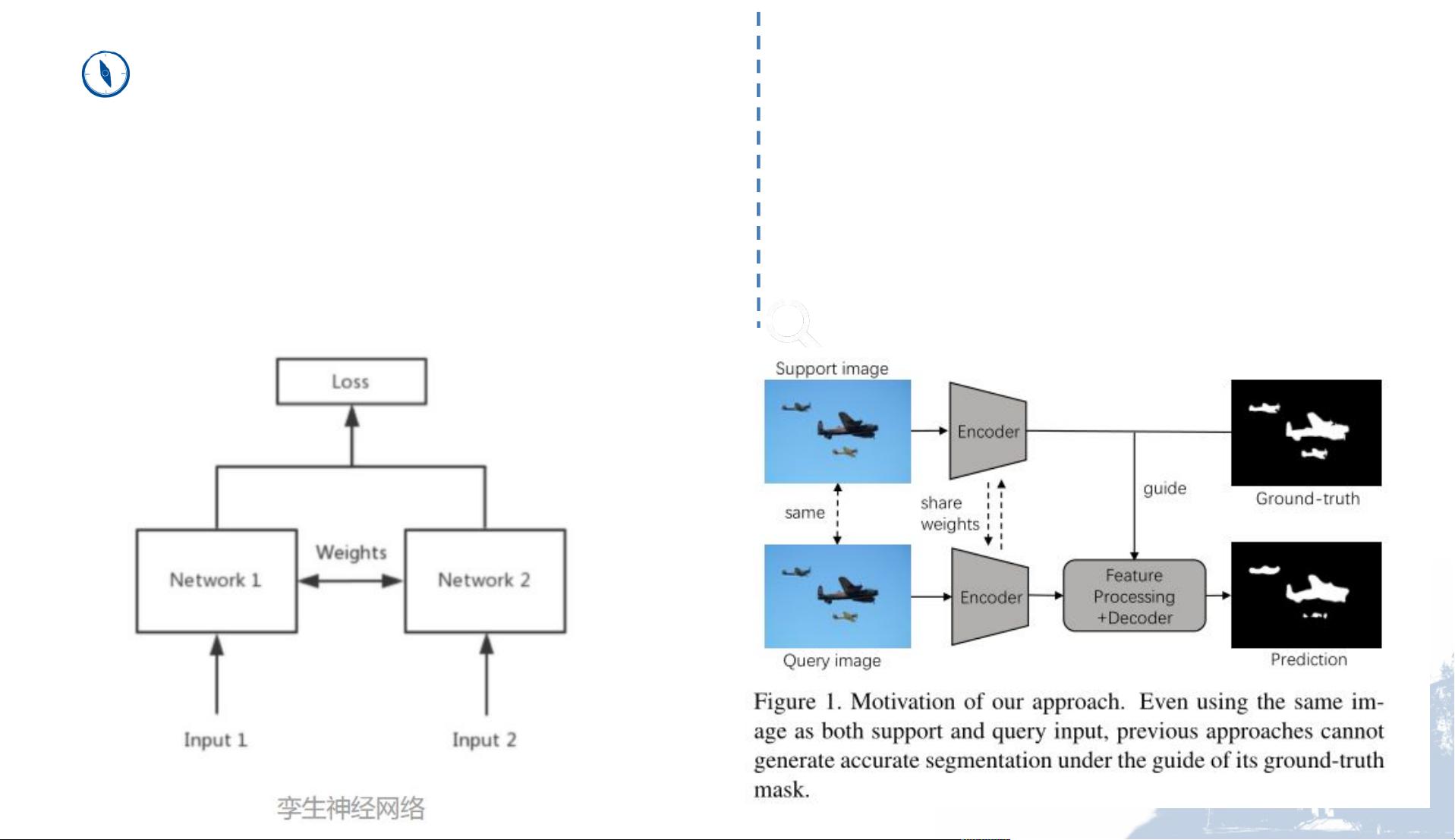

"这篇文档是关于CVPR2021会议上的一篇研究论文,主题是'Self-Guided and Cross-Guided Learning for Few-Shot Segmentation',主要探讨了小样本分割(Few-Shot Segmentation)的问题。该研究旨在解决现有方法在小样本分割时因使用全局平均池化(GAP)导致的关键信息丢失问题,提出了自我引导学习(Self-Guided Learning, SGM)和交叉引导学习(Cross-Guided Learning, CGM)两个新模块。

在小样本分割中,目标是利用有限的带标注样本高效地分割未见过的类别。现有的技术通常依赖于掩码全局平均池化来编码支持图像,形成特征向量以指导查询图像的分割。然而,平均操作往往抹去了图像中的细节差异。为此,研究者们设计了一个自我引导学习策略,通过初始预测来区分覆盖和未覆盖的前景区域,分别用掩码GAP编码为主支持向量和辅助支持向量。这两种向量的融合能提升对查询图像的分割效果。

进一步,他们提出了交叉引导模块,适用于多样本分割任务。在这个模块中,最终的掩码是通过综合多个带注释样本的预测得出的,高质量的支持向量对结果的贡献更大。这个模块的优势在于,它不需要额外的训练,在推理阶段就能直接提升预测的准确性。

实验结果显示,这种方法在PASCAL-5i和COCO-20i数据集上取得了最新的最佳性能。1-shot分割中,mIoU达到61.8%,5-shot分割中达到62.9%。这表明,该方法不仅可以应用于各种基线模型,而且能有效提升它们的性能,对于处理小样本和未知类别的语义分割问题具有显著的改进作用。"

2019-05-16 上传

2024-01-07 上传

2023-07-28 上传

2023-06-11 上传

2023-12-24 上传

2023-09-03 上传

2024-09-22 上传

2023-04-11 上传

2023-05-14 上传

栗子菜菜

- 粉丝: 39

- 资源: 21

最新资源

- WPF渲染层字符绘制原理探究及源代码解析

- 海康精简版监控软件:iVMS4200Lite版发布

- 自动化脚本在lspci-TV的应用介绍

- Chrome 81版本稳定版及匹配的chromedriver下载

- 深入解析Python推荐引擎与自然语言处理

- MATLAB数学建模算法程序包及案例数据

- Springboot人力资源管理系统:设计与功能

- STM32F4系列微控制器开发全面参考指南

- Python实现人脸识别的机器学习流程

- 基于STM32F103C8T6的HLW8032电量采集与解析方案

- Node.js高效MySQL驱动程序:mysqljs/mysql特性和配置

- 基于Python和大数据技术的电影推荐系统设计与实现

- 为ripro主题添加Live2D看板娘的后端资源教程

- 2022版PowerToys Everything插件升级,稳定运行无报错

- Map简易斗地主游戏实现方法介绍

- SJTU ICS Lab6 实验报告解析