大数据与大模型:周虎成探讨学习时代挑战与应对策略

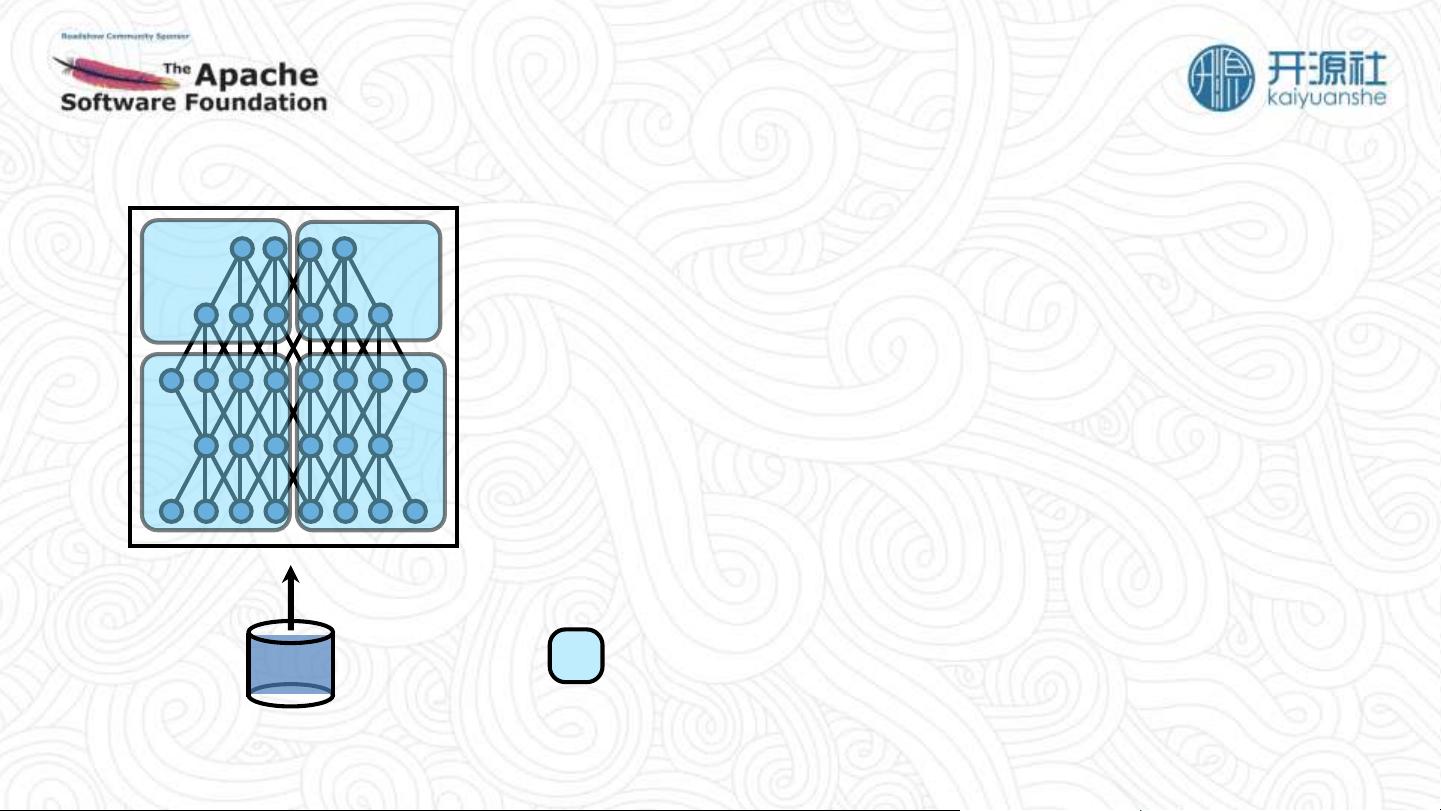

在2015年的Apache中国路演上,周虎成(微软亚洲研究院系统研究组)发表了一篇关于“大学习时代:应对大数据和大模型带来的挑战”的主题演讲。随着信息技术的发展,大数据和大规模机器学习模型成为关键领域,它们带来了全新的技术挑战和需求。 首先,演讲者关注的核心问题在于大数据(Big Data,10亿到万亿样本量)和大模型(如包含100M至10B特征的深度学习模型)驱动的学习过程。这些模型在处理海量数据时,计算密集型的需求显著增加,尤其是在诸如逻辑回归(Logistic Regression)和潜在狄利克雷分配(Latent Dirichlet Allocation, LDA)等案例中。每一轮迭代涉及的操作繁多,例如: 1. **读取数据**(readdata): 在大数据环境中,数据读取操作需要高效处理巨大的数据集,可能导致网络流量压力大。 2. **分区计算**(partition and calculatelocal gradient): 数据通常被分割,以便于分布式计算,每个节点负责一部分,然后进行局部梯度计算。 3. **聚合操作**(aggregate and global gradient): 局部结果需汇总形成全局梯度,用于更新模型权重,如使用L-BFGS算法。 4. **内存、计算和网络瓶颈**: 大模型和大数据处理对硬件资源(尤其是内存)有极高的要求,而计算和通信效率直接影响整体性能。 针对Logistic Regression,每个单词的计算复杂性是O(K),这意味着随着特征数量K的增长,单个操作的时间成本会急剧上升。而如果使用400个核心,完成整个文档的处理所需时间将减少到约800年,尽管如此,这种计算速度仍然远远低于实际应用的要求,比如在文本分析中的实时处理能力。 空间复杂性方面,存储大量数据(O(d*w) for corpus)和模型参数(O(d*k) for doc-topic)也构成挑战,这促使研究人员寻求更有效的数据结构和模型设计。 周虎成在演讲中强调了如何通过优化算法、分布式计算框架和硬件升级来克服这些挑战,以及如何利用云计算和分布式存储技术来扩展处理能力。他还可能探讨了模型压缩、并行计算策略、异步训练等方法,以提高学习效率和降低资源消耗。 这场演讲深入剖析了大数据和大模型背景下面临的实际问题,展示了技术界如何在面临计算、存储和通信限制时,寻找创新解决方案来推动大学习时代的进程。对于IT从业者和研究人员来说,理解这些挑战与解决方案对于应对未来的技术发展至关重要。

剩余48页未读,继续阅读

- 粉丝: 2242

- 资源: 117

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 计算机人脸表情动画技术发展综述

- 关系数据库的关键字搜索技术综述:模型、架构与未来趋势

- 迭代自适应逆滤波在语音情感识别中的应用

- 概念知识树在旅游领域智能分析中的应用

- 构建is-a层次与OWL本体集成:理论与算法

- 基于语义元的相似度计算方法研究:改进与有效性验证

- 网格梯度多密度聚类算法:去噪与高效聚类

- 网格服务工作流动态调度算法PGSWA研究

- 突发事件连锁反应网络模型与应急预警分析

- BA网络上的病毒营销与网站推广仿真研究

- 离散HSMM故障预测模型:有效提升系统状态预测

- 煤矿安全评价:信息融合与可拓理论的应用

- 多维度Petri网工作流模型MD_WFN:统一建模与应用研究

- 面向过程追踪的知识安全描述方法

- 基于收益的软件过程资源调度优化策略

- 多核环境下基于数据流Java的Web服务器优化实现提升性能

信息提交成功

信息提交成功