深度学习之图像分类深度学习之图像分类—-多分类支持向量机(多分类支持向量机(Multi-SVM)与)与

softmax分类分类

本文学习自该大V

概述概述:

由于KNN算法的局限性,我们需要实现更强大的方法来实现图像分类,一般情况下该方法包含两个函数,一是评分函数评分函数(score

function),它是原始图像到每个分类的分值映射,二是损失函数损失函数(loss function),它是用来量化预测分类标签的得分与真实

标签的一致性的。该方法可以转化为一个最优化问题,在最优化过程中,将通过更新评分函数的参数来最小化损失函数的值,从而

使得我们找到一个更好的评分函数(参数W)。

从图像到标签分值的参数化映射从图像到标签分值的参数化映射

评分函数将图像的像素值映射为各个类别的得分,得分越高说明越有可能属于该类别。

评分函数评分函数:

我们定义一个简单的函数映射:$ f(x_i,W,b) = Wx_i + b $

参数W被称为权重(weights)。b被称为偏差向量(biasvector),这是因为它影响输出数值,但是并不和原始数据xi产生关

联。每个输入图像xi经过该评分映射后会得到一个[K×1]的矩阵,每一个表示该图像在该分类中的得分,即可能是该分类的可能性

参数W被称为权重(weights)。b被称为偏差向量(bias vector),这是因为它影响输出数值,但是并不和原始数据x_i产生关

联。每个输入图像x_i经过该评分映射后会得到一个[K × 1 ]的矩阵,每一个表示该图像在该分类中的得分,即可能是该分类的可能

性参数W被称为权重(weights)。b被称为偏差向量(biasvector),这是因为它影响输出数值,但是并不和原始数据xi产生

关联。每个输入图像xi经过该评分映射后会得到一个[K×1]的矩阵,每一个表示该图像在该分类中的得分,即可能是该分类的可能

性

需要注意的几点:

1.该方法的一个优势是训练数据是用来学习到参数W和b的,一旦训练完成,训练数据就可以丢弃,留下学习到的参数即可。

这是因为一个测试图像可以简单地输入函数,并基于计算出的分类分值来进行分类。

2.输入数据(xi,yi)(x_i,y_i)(xi,yi)是给定不变的,我们的目的是通过设置权重W和偏差值b,使得计算出来的分类分值情况

和训练集中图像的数据真实类别标签相符合

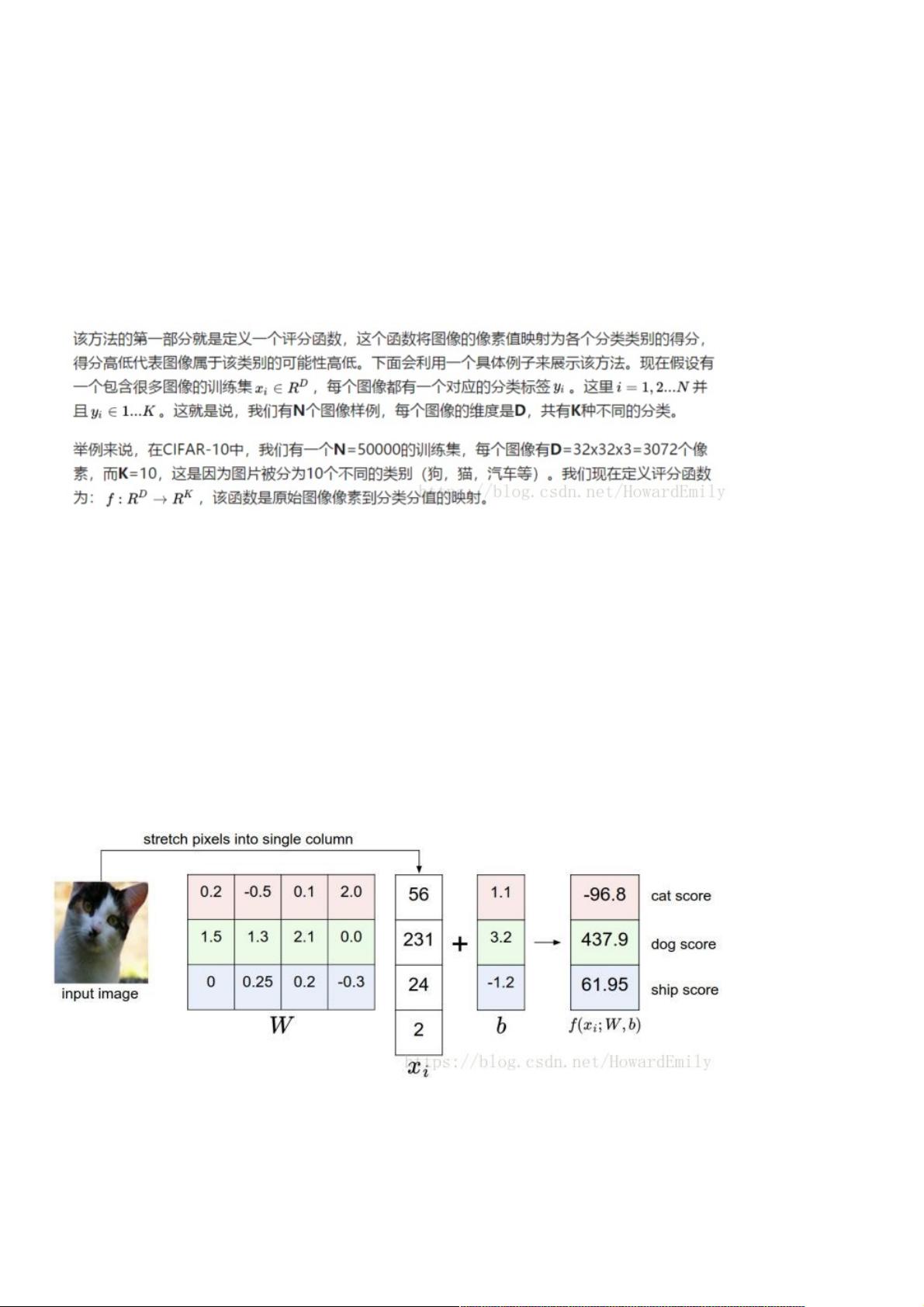

一个将图像映射到分类分值的例子。为了便于可视化,假设图像只有4个像素(都是黑白像素,这里不考虑RGB通道),有3

个分类(红色代表猫,绿色代表狗,蓝色代表船,注意,这里的红、绿和蓝3种颜色仅代表分类,和RGB通道没有关系)。首

先将图像像素拉伸为一个列向量,与W进行矩阵乘,然后得到各个分类的分值。需要注意的是,这个W一点也不好:猫分类的

分值非常低。从上图来看,算法倒是觉得这个图像是一只狗。

偏差和权重的合并技巧偏差和权重的合并技巧:

在进一步学习前,要提一下这个经常使用的技巧。它能够将我们常用的参数W和b合二为一。回忆一下,分类评分函数定义

为:

$f(x_i,W,b) = Wx_i + b $

分开处理这两个参数(权重参数W和偏差参数b)有点笨拙,一般常用的方法是把两个参数放到同一个矩阵中,同时x_i向量就