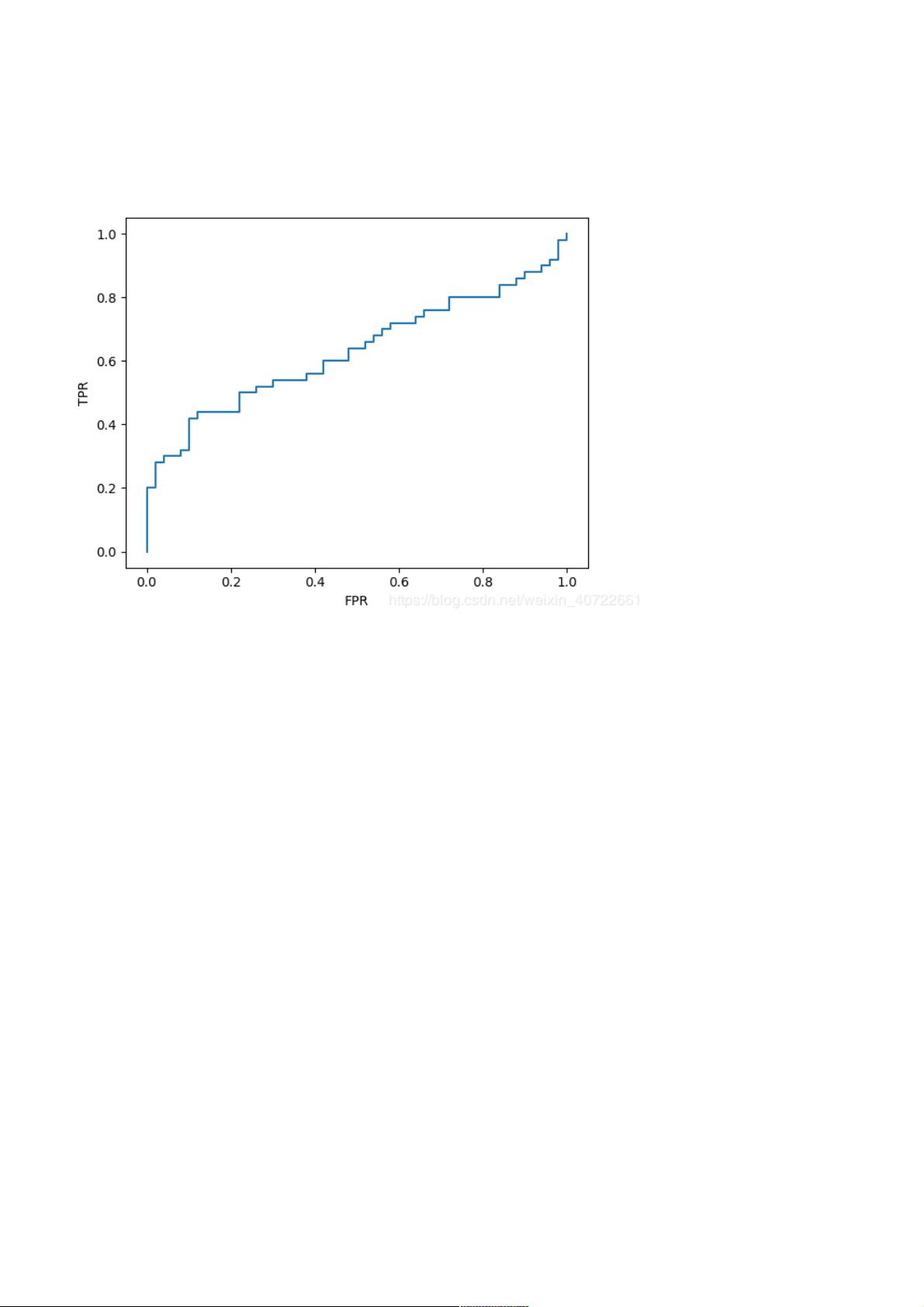

本篇文章主要介绍了如何使用Python实现ROC曲线的绘制,以鸢尾花数据集(Iris dataset)中的两个类别为例,进行模型性能评估。鸢尾花数据集包含了四个特征:sepal length (cm), sepal width (cm), petal length (cm), 和 petal width (cm),我们将其中的'setosa'和'versicolor'作为分类目标,分别对应0和1。 首先,文章提到使用回归方法对鸢尾花数据进行拟合,获取模型参数和偏置。这里假设我们使用的是某种回归模型,但实际上在评估ROC曲线时,通常使用的是二元分类模型,如逻辑回归、支持向量机或决策树等。模型训练完成后,通过`model.fit(data_train, data_train_label)`对训练数据进行学习。 接着,对测试数据进行预测并得到概率值,例如使用`res = model.predict(data[:100])`来获取前100个样本的预测概率。这些概率值是后续计算ROC曲线的关键,因为ROC曲线展示了真正例率(True Positive Rate, TPR)与假正例率(False Positive Rate, FPR)之间的关系,对于二分类问题,概率值会被映射到[0,1]范围内,其中0表示完全不正确,1表示完全正确。 预测结果后,需要将这些概率值与对应的训练集标签匹配,并按照预测概率从大到小排序。排序后的数据被用来计算TNR(True Negative Rate),即没有被错误地标记为正例的样本比例。然后,我们根据TPR和FPR定义的公式计算每一个点的坐标,形成ROC曲线。 最后,文章提到了一系列具体的预测概率值,这些数值代表了预测过程中的不同阶段,每个数值对应着一组TPR和FPR的组合,用于绘制ROC曲线。在绘制过程中,我们可以使用诸如matplotlib这样的库,通过计算不同阈值下的TPR和FPR来生成连续的曲线。整个过程包括计算曲线上每个点的坐标、连接这些点以及最终评估模型的性能,特别是在平衡精度和召回率方面的表现。 总结来说,这篇文章主要讲解了如何通过Python的机器学习库(如sklearn)对鸢尾花数据集进行二分类任务,利用回归模型预测后,通过计算预测概率并构建ROC曲线来可视化模型的性能。理解ROC曲线有助于我们在不同的业务场景中选择合适的模型,尤其是在医疗诊断、金融风险评估等领域,对模型的真阳性率和假阳性率有较高的关注。

信息提交成功

信息提交成功