"本文主要介绍了卷积神经网络(CNN)的基本概念、训练方法以及发展历程与未来研究方向。首先回顾了传统的BP神经网络,强调了深度学习中CNN的重要性。"

CNN,全称为卷积神经网络,是深度学习领域的重要组成部分,尤其在图像处理、计算机视觉、自然语言处理等领域有着广泛应用。相比于传统的全连接BP神经网络,CNN引入了卷积层、池化层和局部连接等特性,使其在处理二维数据如图像时具有更好的性能和效率。

**为什么需要CNN?**

传统的BP神经网络在处理高维图像数据时面临问题,例如参数过多、计算复杂度高以及训练困难等。当图像尺寸较大时,如100*100像素,全连接的神经网络会导致大量参数,这不仅增加了计算成本,也容易导致过拟合。而CNN通过局部连接和权值共享大大减少了参数数量,提高了模型的计算效率。

**什么是CNN?**

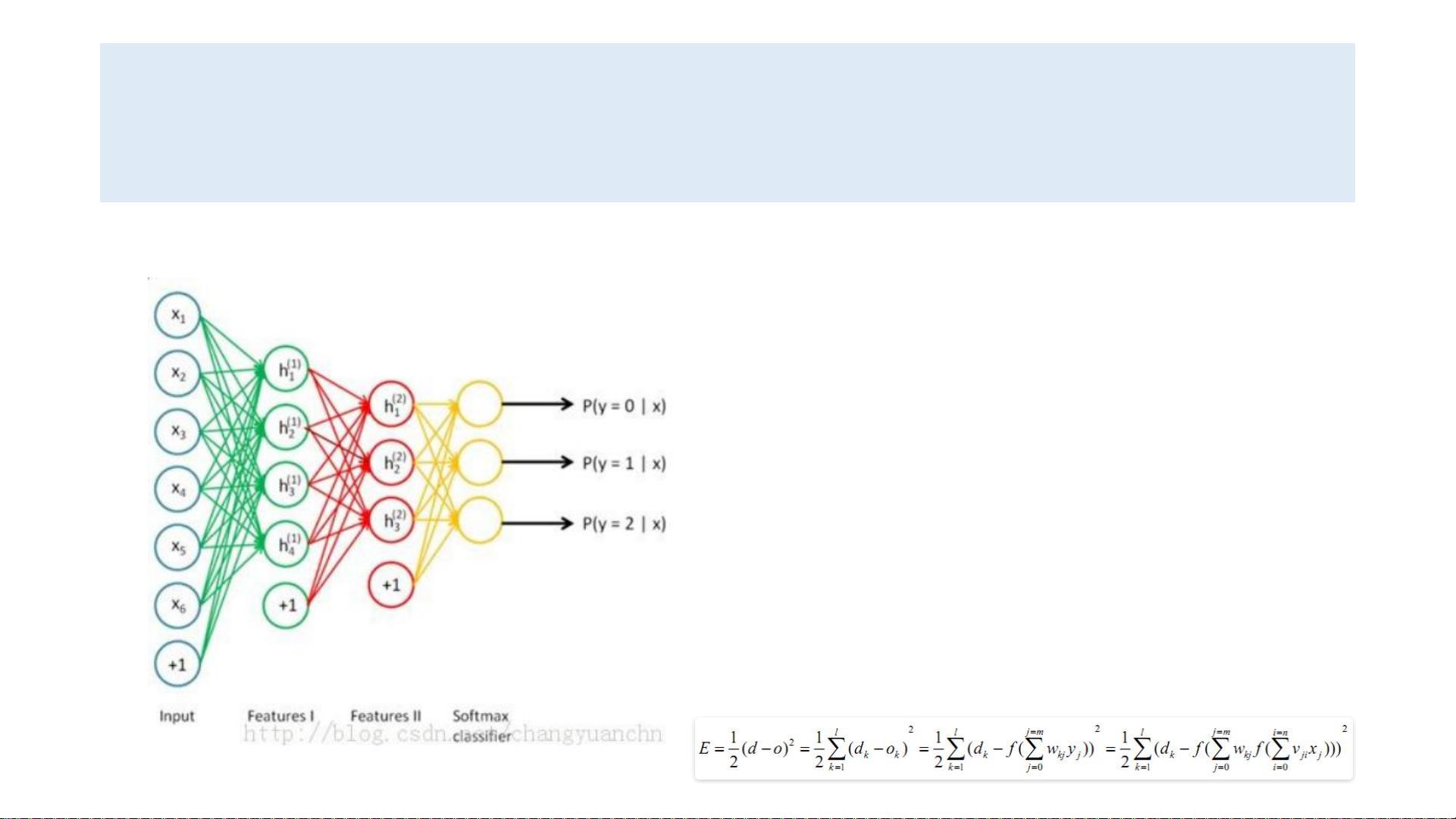

CNN通常由卷积层、池化层、激活函数、全连接层等构成。卷积层通过卷积核(滤波器)对输入图像进行扫描,提取特征;池化层用于降低数据的维度,减少计算量,同时保持关键信息;激活函数如ReLU引入非线性,增强模型表达能力。这些层次共同构建了一个能够自动学习和理解图像特征的模型。

**怎么训练CNN?**

CNN的训练过程主要包括前向传播、反向传播和参数更新。在前向传播阶段,输入数据通过网络层层传递,计算损失函数。反向传播阶段,根据损失函数的梯度更新权重,这通常采用梯度下降法实现。学习率η控制着参数更新的步长,防止过快或过慢收敛。通过反复迭代,使损失函数逐渐减小,模型性能提升。

**目前发展**

近年来,CNN在图像识别、目标检测、语义分割等领域取得了显著成果,如AlexNet、VGG、ResNet等标志性模型的提出。此外,结合其他技术如注意力机制、生成对抗网络等,CNN在自动驾驶、医疗影像分析、视频理解等方面也展现出强大的潜力。

**研究方向**

未来CNN的研究将继续深入,包括但不限于以下方向:提高模型的计算效率和存储效率;开发新型的卷积结构和池化方式;探索更有效的正则化策略防止过拟合;结合 Transformers 等其他模型,提升模型的序列理解和跨模态学习能力;以及在强化学习、元学习等领域的应用。

总结来说,CNN作为一种强大的深度学习模型,通过其特有的结构设计解决了传统神经网络在处理图像数据时的局限性,持续推动着人工智能领域的发展。随着技术的不断进步,CNN的应用范围还将进一步拓宽。