人工智能安全与隐私:对抗攻击与鲁棒性

版权申诉

"该资源是关于人工智能专题的讨论,特别是关注人工智能的安全与隐私问题。内容涵盖了自动驾驶、人脸识别、推荐系统等多个领域,强调了在AI发展过程中必须考虑的安全性、隐私性和伦理道德。文档中提到了多种对抗性攻击方法对AI模型的影响,以及如何通过改进模型来增强预测结果的鲁棒性。同时,还讨论了迁移学习在实际应用中的作用,以及其可能带来的安全挑战。"

在当前快速发展的AI领域,安全与隐私问题已经成为不可忽视的关键议题。自动驾驶、人脸识别和推荐系统等AI技术的广泛应用,虽然极大地便利了我们的生活,但也带来了潜在的风险。例如,安全攻击可能导致自动驾驶车辆的误判,而人脸识别系统的漏洞则可能被利用来伪造身份验证。此外,推荐系统的个性化算法可能会在收集大量用户数据的同时,侵犯用户的隐私。

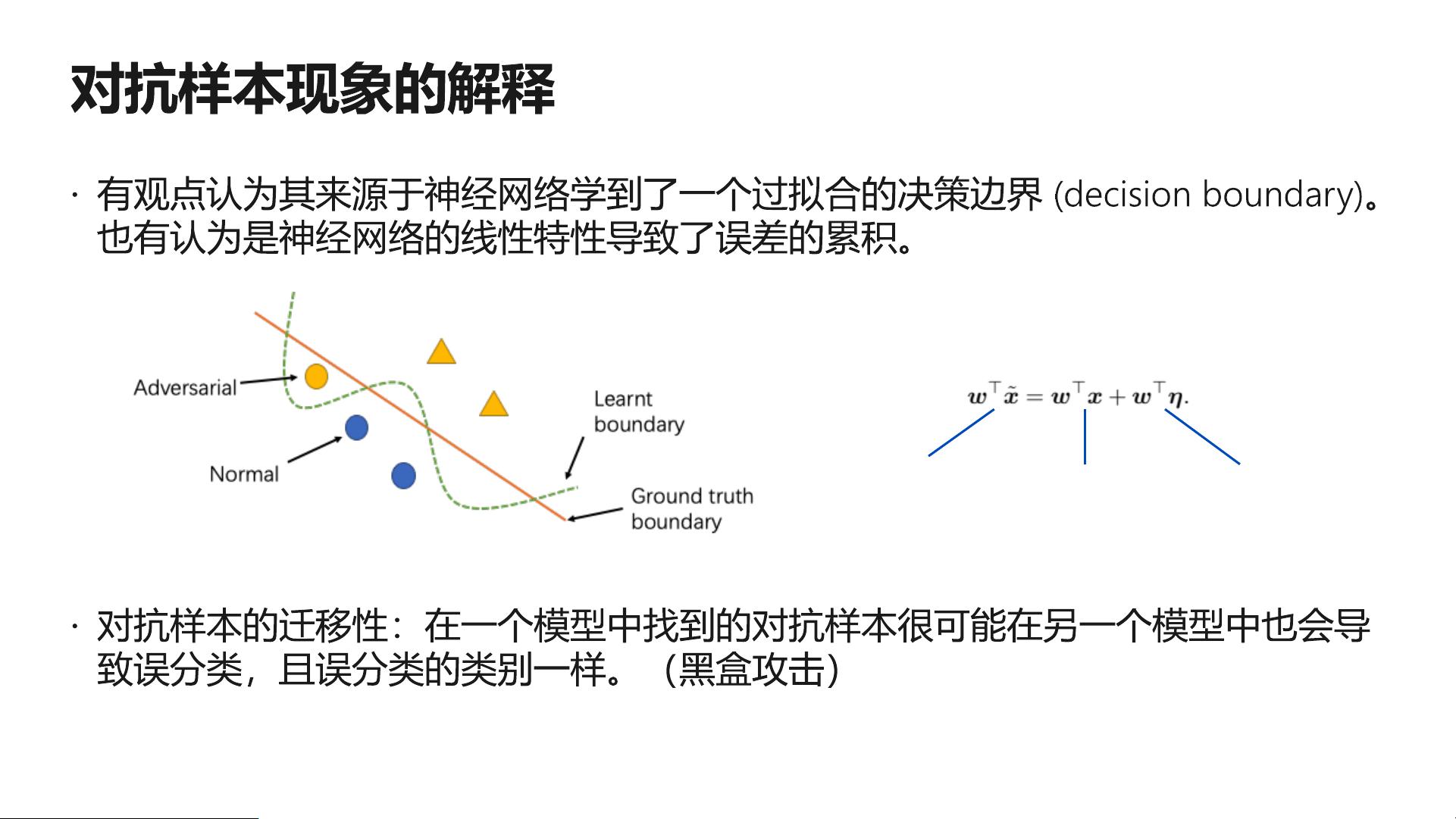

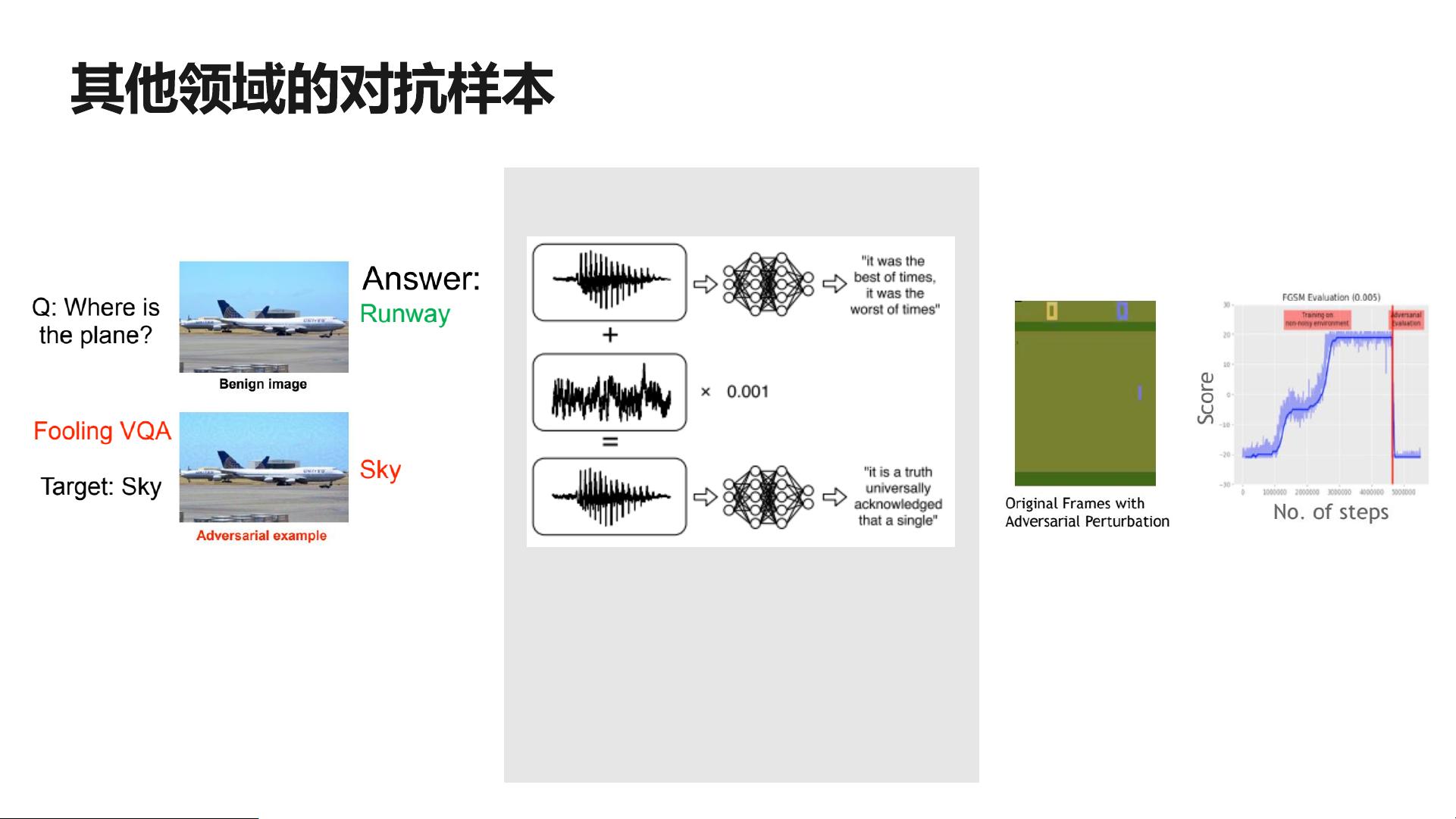

文档中特别提到了对抗性攻击,这是一种针对AI模型的恶意操作,旨在误导模型的预测结果。Fast Gradient Sign Method (FGSM) 是一种常见的对抗性攻击方法,它通过向输入数据添加微小扰动,使得模型做出错误的预测。为了增强模型的鲁棒性,研究者提出了如Adversarial Transformation Networks (AFN)等方法,通过训练输入转换模型,自动将正常样本转化为对抗样本,以此提升模型对这类攻击的抵御能力。

此外,文档还提及了迁移学习,这是AI训练中的一个重要策略。通过利用预训练模型的部分参数,可以更快地适应新的任务,减少所需的训练数据量。然而,这种方法也可能带来安全隐患,因为教师模型的参数可能会被攻击者利用,对模型的完整性构成威胁。

在AI的发展中,除了技术进步,我们还需要关注模型的完整性、预测过程的可信性、数据和模型的保密性,以及AI算法的公平性和防止滥用。例如,模型的公平性问题涉及到算法是否会对某些特定群体产生偏见,而模型保密性则关系到防止模型被恶意复制或逆向工程。

这份资料深入探讨了AI安全和隐私的多个层面,提醒我们在享受AI带来的便利的同时,必须警惕并解决这些潜在的问题,以实现负责任的人工智能发展。

2023-06-02 上传

2023-10-16 上传

2023-12-21 上传

2023-07-29 上传

2023-07-27 上传

2023-08-17 上传

2023-10-07 上传

mugui3

- 粉丝: 0

- 资源: 811

最新资源

- 多模态联合稀疏表示在视频目标跟踪中的应用

- Kubernetes资源管控与Gardener开源软件实践解析

- MPI集群监控与负载平衡策略

- 自动化PHP安全漏洞检测:静态代码分析与数据流方法

- 青苔数据CEO程永:技术生态与阿里云开放创新

- 制造业转型: HyperX引领企业上云策略

- 赵维五分享:航空工业电子采购上云实战与运维策略

- 单片机控制的LED点阵显示屏设计及其实现

- 驻云科技李俊涛:AI驱动的云上服务新趋势与挑战

- 6LoWPAN物联网边界路由器:设计与实现

- 猩便利工程师仲小玉:Terraform云资源管理最佳实践与团队协作

- 类差分度改进的互信息特征选择提升文本分类性能

- VERITAS与阿里云合作的混合云转型与数据保护方案

- 云制造中的生产线仿真模型设计与虚拟化研究

- 汪洋在PostgresChina2018分享:高可用 PostgreSQL 工具与架构设计

- 2018 PostgresChina大会:阿里云时空引擎Ganos在PostgreSQL中的创新应用与多模型存储