深入解析Hadoop源代码:分布式存储与计算

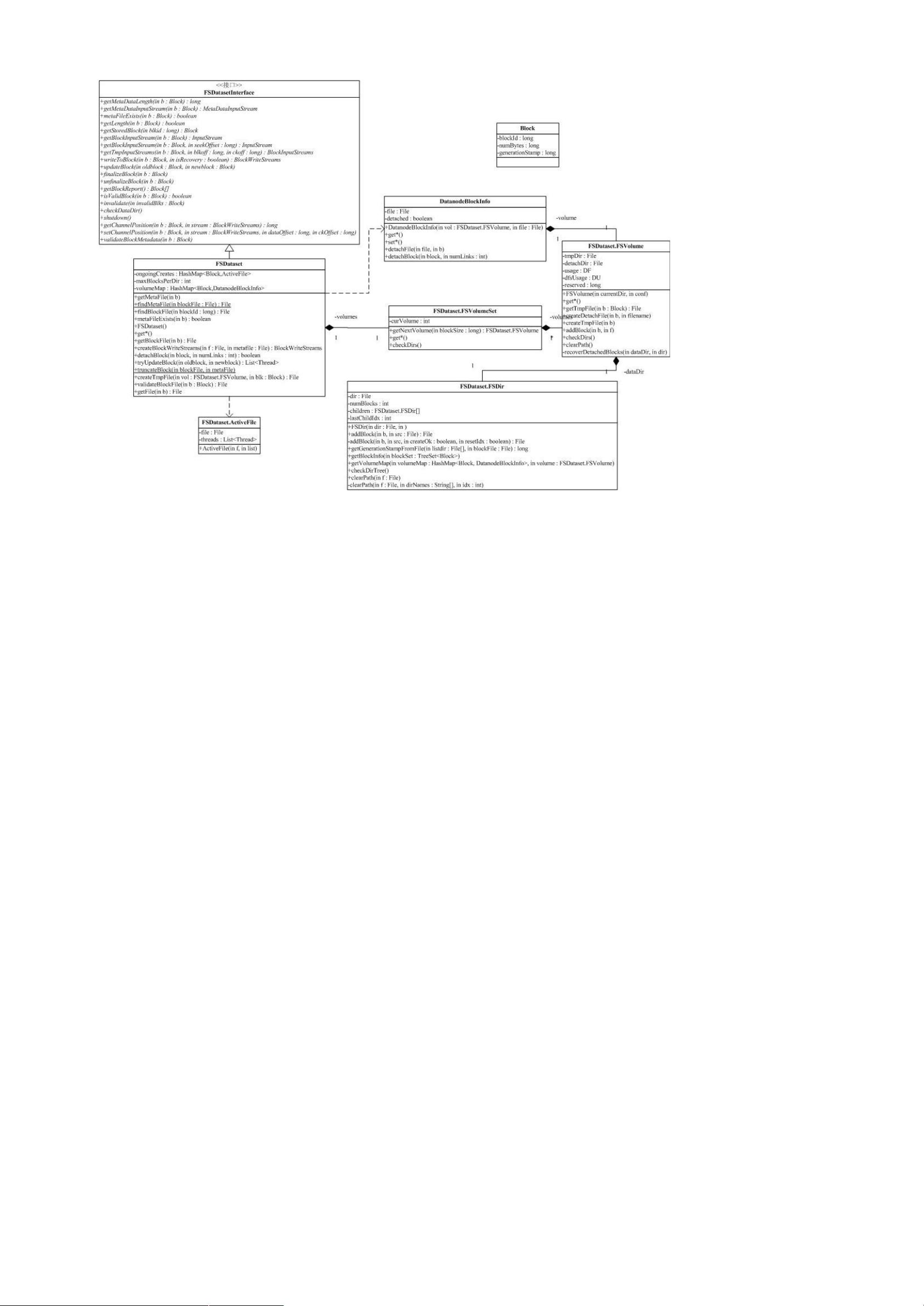

"Hadoop源代码分析" Hadoop作为开源的大数据处理框架,其核心在于分布式文件系统HDFS(Hadoop Distributed File System)和并行计算模型MapReduce。Hadoop源代码分析提供了深入理解这两个关键组件以及相关生态系统的途径。本文将依据给定的标题和描述,详细探讨Hadoop的主要组成部分及其工作原理。 首先,Hadoop的设计灵感来源于Google的一系列开创性论文,包括GoogleCluster、Chubby、GFS、BigTable和MapReduce。在开源社区的努力下,这些技术被转化为Apache Hadoop项目中的相应组件: 1. Chubby -> ZooKeeper:ZooKeeper是一个分布式协调服务,类似于Chubby,用于解决分布式环境中的命名、配置管理和锁服务等问题。 2. GFS -> HDFS:HDFS是分布式文件系统,模仿了Google的GFS,提供高容错性和高吞吐量的数据访问。 3. BigTable -> HBase:HBase是基于HDFS的分布式数据库,类似于BigTable,支持大规模随机读写操作,适用于非结构化和半结构化数据。 4. MapReduce -> Hadoop MapReduce:Hadoop的MapReduce是分布式计算框架,借鉴了Google的MapReduce,用于处理和生成大数据集。 HDFS是Hadoop的基础,它将大型数据集分割成块并分布存储在集群的不同节点上,确保数据的冗余和容错。MapReduce则负责数据的处理,通过“映射”(map)和“归约”(reduce)两个阶段进行分布式计算。 MapReduce项目的顶层包图揭示了复杂的依赖关系,其中包括用于配置管理的conf包,它依赖于fs包来读取系统配置。fs包抽象了文件系统功能,允许HDFS与其他存储系统(如本地文件系统或Amazon S3)交互。 在Hadoop源代码分析中,我们可以看到关键部分集中在处理分布式文件系统和MapReduce计算的代码上。这些部分包括数据的读写、任务调度、容错机制以及数据分片和处理的逻辑。 对于学习和分析Hadoop源代码,除了理解上述核心组件,还需要关注其他重要组件,如YARN(Yet Another Resource Negotiator),它是Hadoop的资源管理系统,负责作业调度和集群资源的分配。此外,Hadoop生态系统还包括Hive(数据仓库工具,用于SQL-like查询)、Pig(数据分析工具,支持高级数据流语言)等,它们都与Hadoop紧密集成,共同构建了强大的大数据处理平台。 通过深入源代码,开发者可以更好地理解Hadoop的内部运作,优化性能,排查问题,并可能贡献新的特性或改进。这不仅有助于提升开发者的专业技能,也为企业的数据处理能力提供了坚实的技术基础。

剩余63页未读,继续阅读

- 粉丝: 0

- 资源: 13

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- 构建Cadence PSpice仿真模型库教程

- VMware 10.0安装指南:步骤详解与网络、文件共享解决方案

- 中国互联网20周年必读:影响行业的100本经典书籍

- SQL Server 2000 Analysis Services的经典MDX查询示例

- VC6.0 MFC操作Excel教程:亲测Win7下的应用与保存技巧

- 使用Python NetworkX处理网络图

- 科技驱动:计算机控制技术的革新与应用

- MF-1型机器人硬件与robobasic编程详解

- ADC性能指标解析:超越位数、SNR和谐波

- 通用示波器改造为逻辑分析仪:0-1字符显示与电路设计

- C++实现TCP控制台客户端

- SOA架构下ESB在卷烟厂的信息整合与决策支持

- 三维人脸识别:技术进展与应用解析

- 单张人脸图像的眼镜边框自动去除方法

- C语言绘制图形:余弦曲线与正弦函数示例

- Matlab 文件操作入门:fopen、fclose、fprintf、fscanf 等函数使用详解

信息提交成功

信息提交成功