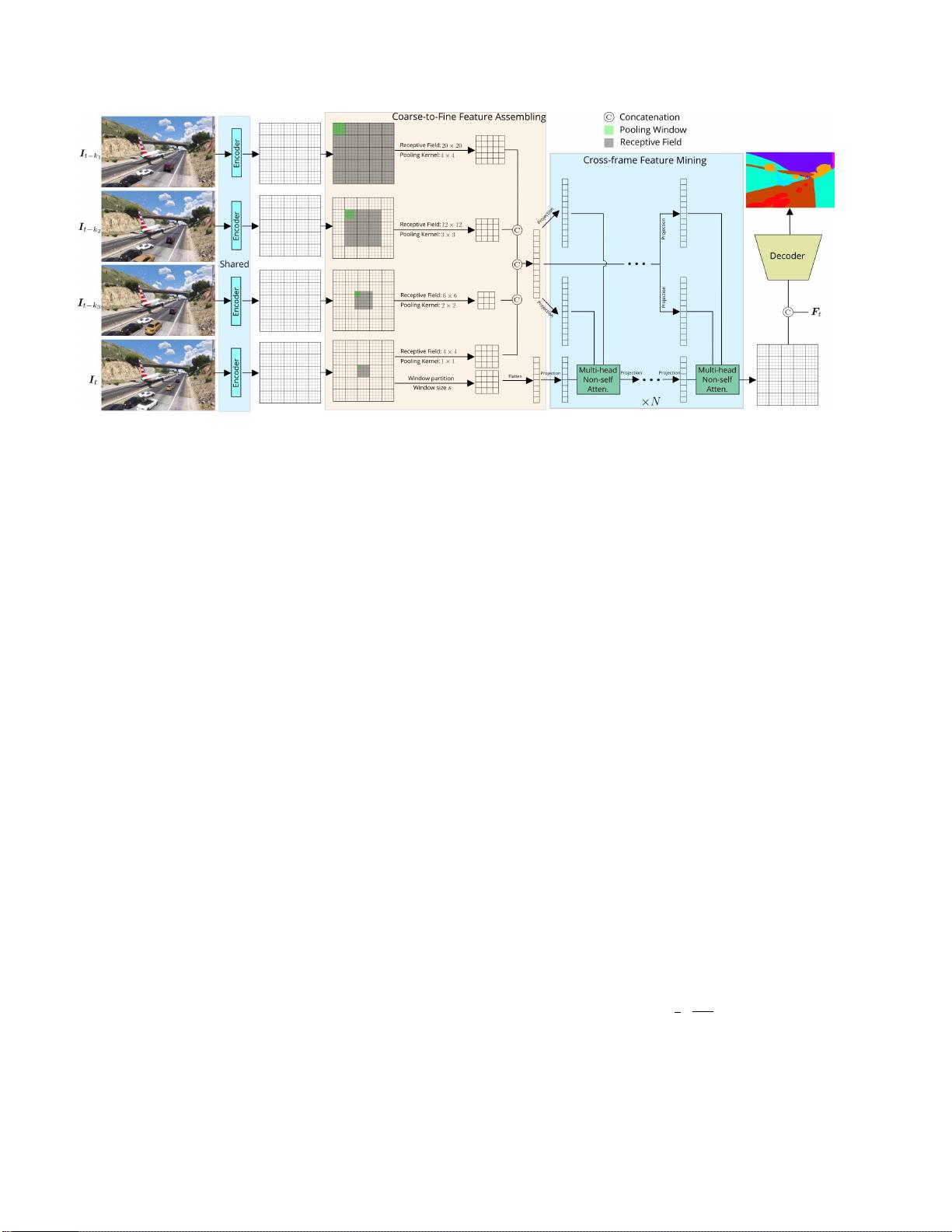

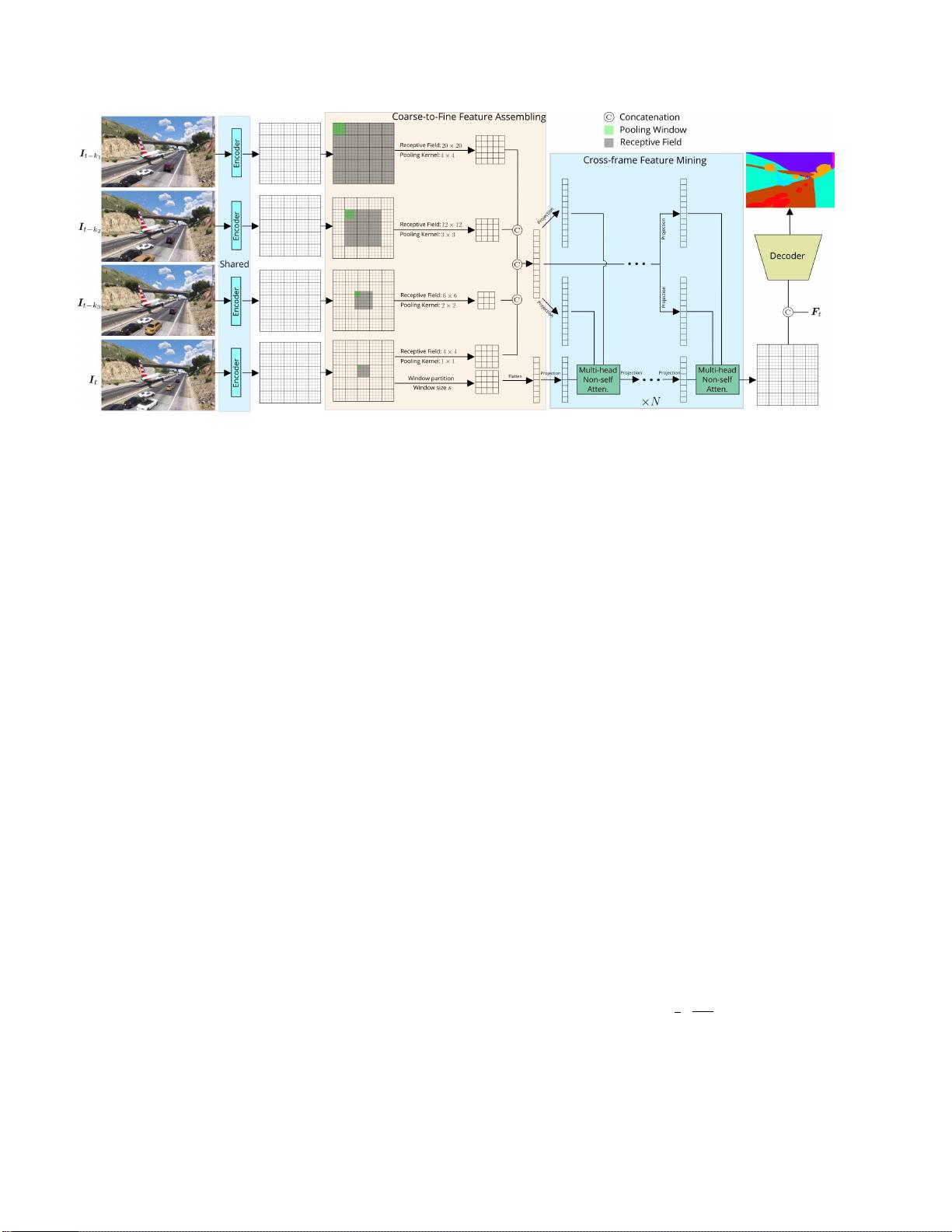

图2.概述拟议的粗到细特征挖掘。所有帧首先输入到编码器以提取特征,然后通过粗到精特征组装模块(CFFA)。通过不同

的池化策略处理不同帧的特征以生成上下文令牌。原理是对于更远的帧,使用更大的感受野和更粗的池化。所示的特征尺寸

(20 20)、感受野和池化核用于简单解释。所有帧的上下文标记被连接,然后由跨帧特征挖掘(CFM)模块处理。利用上下

文令牌来更新目标特征,由多个多头非自注意层。最后,我们利用增强的目标特征对目标帧进行分割

最好用缩放查看。

虽然视频内容可能跨帧改变,但是整体语义和环境将

不会改变很多,这意味着大多数视频内容可能仅具有

少量时间不一致性。第三,相邻帧之间的“静态”内容

的小的时间不一致性受第二次和第三次观察的启发,

通过相邻帧中的池化操作进行的变大小区域采样可以

传达多尺度上下文信息。因此,所设计的CFFA可以感

知多尺度的上下文信息(

静态上下文

)和

动态上下

文

。具体地,目标帧中的每个像素对应于更远帧中的

更大的感受野和更粗的池化,如图1B所示。二、请注

意,采样标记的长度比默认的自我注意中的长度短得

多。

CFFM的第二步,跨帧特征挖掘(CFM),旨在从

相邻帧的特征中挖掘有用的信息。这是一个基于注意

力的过程。然而,与传统的自我注意力[18,76,80]

不同,其查询,键和值来自相同的输入,我们建议使

用

非自我注意力

机制,其中查询来自目标帧,键和值

来自相邻帧。此外,在非自注意的迭代过程中,我们

只更新查询,这是直观的,因为我们的目标是从相邻

帧中挖掘信息,因此不需要更新上下文令牌与需要连

接和处理所有组装特征的自我注意相比,这种非自我

注意具有以下特点:

从而降低了计算成本。

3.2.

由粗到精的特征装配

在不失去普遍性的情况下,我们开始讨论 对 培

训 数据 含有 视频帧

{

I

t−k

1

,

· · ·

,

I

t−k

l

,

I

t

}

, 其具有

S

t−k

1

,

S

t−k

l

,

S

t

的地面真值分割

,并且我们专注于分割

I

t

。具体

地,

I

t

是目标帧,并且

{

I

t-k

1

,

· · ·

,

I

t-k

l

}

是l

个

先前帧,

{

k

1

,

...

,

k

1

}帧。 让我们将

U

={

t-k

1

,

···

,

t-k

l

,

t

}

表示

为所有帧下标的集合。 我们首先

使用 编码器处理

I

t

−

k

1

, ,

I

t

−

k

l

,

I

t

以 提取 信息

特征

F

=

F

t−k

1

, ,

F

t

−

k

l

,

F

t

,每个的大小为

R

h

×

w

×

c

(

h

,

w

和

c

分别表示高度,宽度和通道数)。我们的目标

是利用

F

生成更好的特征,用于分割

I

t

,因为在先前

的帧中存在相关的和有价值的视频上下文

为了有效地建立

参考框架特征(

F

t-k

1

,,

F

t-k

l

)和

目标框架特征

F

t

之间的远程交互

,我们提出了由粗到精的特

征组装模块,如图所示。二、受先前工作的启发

[56

,

79

,

87]

,我们将目标帧特征

F

t

拆分为窗口,每

个窗口关注一组共享的上下文令牌。这背后的原因

是,参加

- ing

在

F

t

中的每个位置到一组特定的上下

文令牌需要巨大的计算和内存成本。当使用

窗口大小为s×s,

Ft

被划分为

h

×

w

个

窗口。