梯度下降与二元线性回归解析:BGD、SGD、MBGD

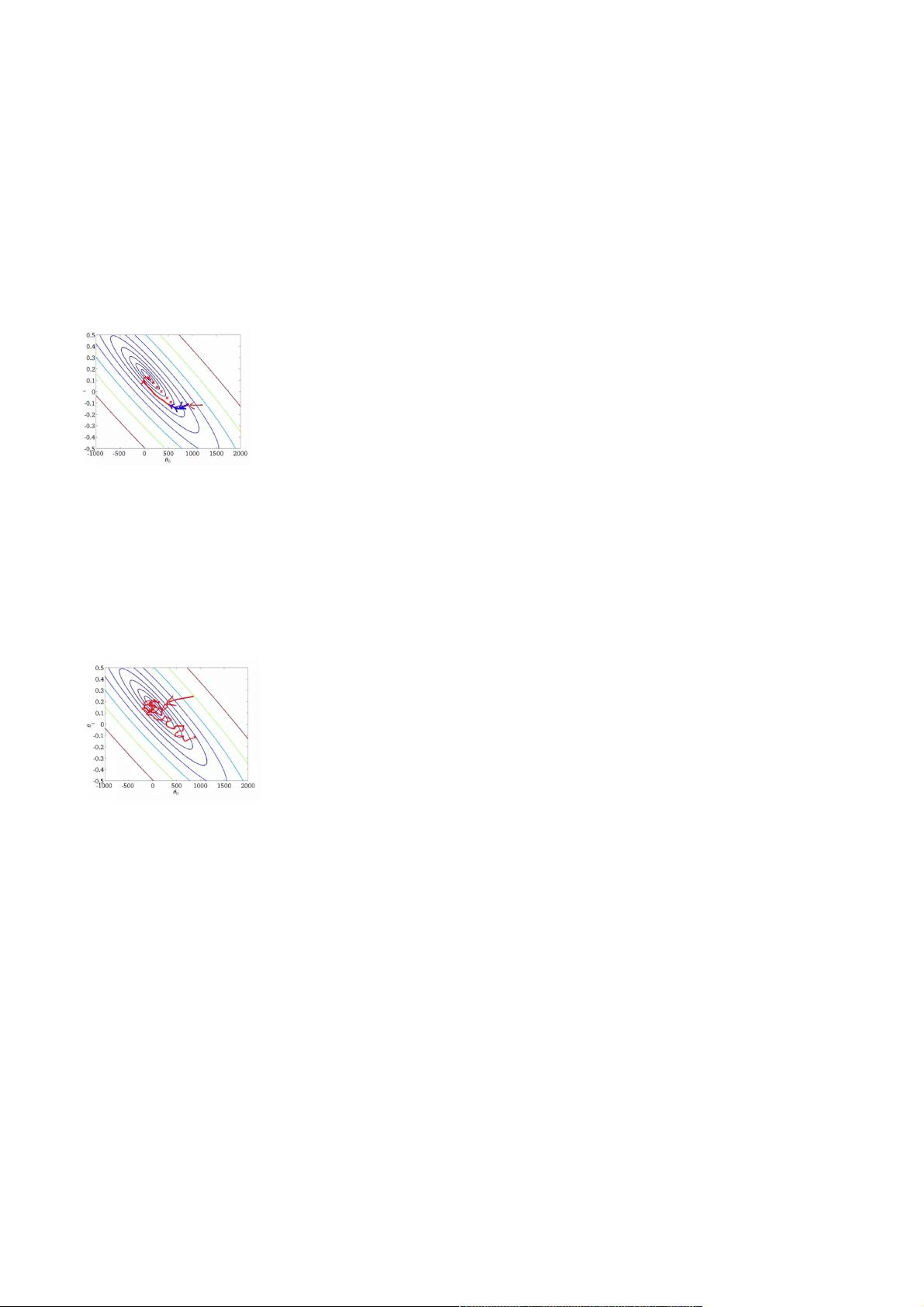

"梯度下降与二元线性回归在机器学习中的应用" 梯度下降是机器学习中一种常用的最优化算法,它主要用于寻找损失函数的最小值,从而更新模型参数。在二元线性回归中,梯度下降扮演着至关重要的角色。线性回归是一种预测模型,它试图找到一条直线或超平面来最好地拟合输入数据。 1. 梯度下降的核心思想是沿着梯度向量的负方向移动,因为梯度指向了损失函数增加最快的方向。在这个过程中,学习率(learning rate)决定了每次迭代参数更新的步长,它直接影响收敛速度和稳定性。 2. 梯度下降有三种主要的训练形式: - 批量梯度下降法(BGD):在每次迭代时,使用所有训练样本更新参数。这确保了每次更新方向的一致性,有可能找到全局最优解,但计算成本高,尤其是在大规模数据集上。 - 随机梯度下降法(SGD):每次迭代仅使用一个随机样本进行更新,使得算法速度非常快,但可能导致收敛到局部最优解,且更新方向可能存在较大噪声。 - 小批量梯度下降法(MBGD):介于BGD和SGD之间,每次迭代使用一部分随机选取的样本集,平衡了速度和准确性,通常能获得较好的效果。 3. 在二元线性回归中,代价函数J(θ) = (X * θ - y) / (2 * m),其中X是特征矩阵,θ是参数向量,y是目标变量,m是样本数量。除以2m而不是m的原因在于简化后续的数学运算,实际上,不论除以2m还是m,对θ的最优化结果并无影响。 4. 求解二元线性回归的梯度下降算法涉及到更新规则:θ = θ - α / m * [Σ(X * θ - y) * Σ((X * θ - y) * X(:,2))], 其中α是学习率。这个公式用于计算梯度并更新权重,以减小损失函数。 5. 梯度下降算法的优势在于其简单和高效,尤其适用于大型数据集,能够逐步逼近损失函数的最小值。然而,选择合适的学习率和训练策略对于梯度下降的成功至关重要。 梯度下降是机器学习中优化模型参数的关键工具,而在二元线性回归中,通过合理选择梯度下降的训练形式和调整参数,我们可以有效地拟合数据并构建预测模型。

下载后可阅读完整内容,剩余3页未读,立即下载

- 粉丝: 20

- 资源: 350

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- Hadoop生态系统与MapReduce详解

- MDS系列三相整流桥模块技术规格与特性

- MFC编程:指针与句柄获取全面解析

- LM06:多模4G高速数据模块,支持GSM至TD-LTE

- 使用Gradle与Nexus构建私有仓库

- JAVA编程规范指南:命名规则与文件样式

- EMC VNX5500 存储系统日常维护指南

- 大数据驱动的互联网用户体验深度管理策略

- 改进型Booth算法:32位浮点阵列乘法器的高速设计与算法比较

- H3CNE网络认证重点知识整理

- Linux环境下MongoDB的详细安装教程

- 压缩文法的等价变换与多余规则删除

- BRMS入门指南:JBOSS安装与基础操作详解

- Win7环境下Android开发环境配置全攻略

- SHT10 C语言程序与LCD1602显示实例及精度校准

- 反垃圾邮件技术:现状与前景

信息提交成功

信息提交成功