BP算法,即误差反向传播算法,是一种用于多层神经网络训练的常用算法。通过不断调整网络中的权重和阈值,使得网络输出的预测值与实际值之间的误差最小化。BP算法的优点包括能够处理非线性关系、适用于各种类型的问题、易于实现和调整等。然而,也存在一些缺点,如易陷入局部极小值、收敛速度较慢、对初始权重和阈值敏感等。

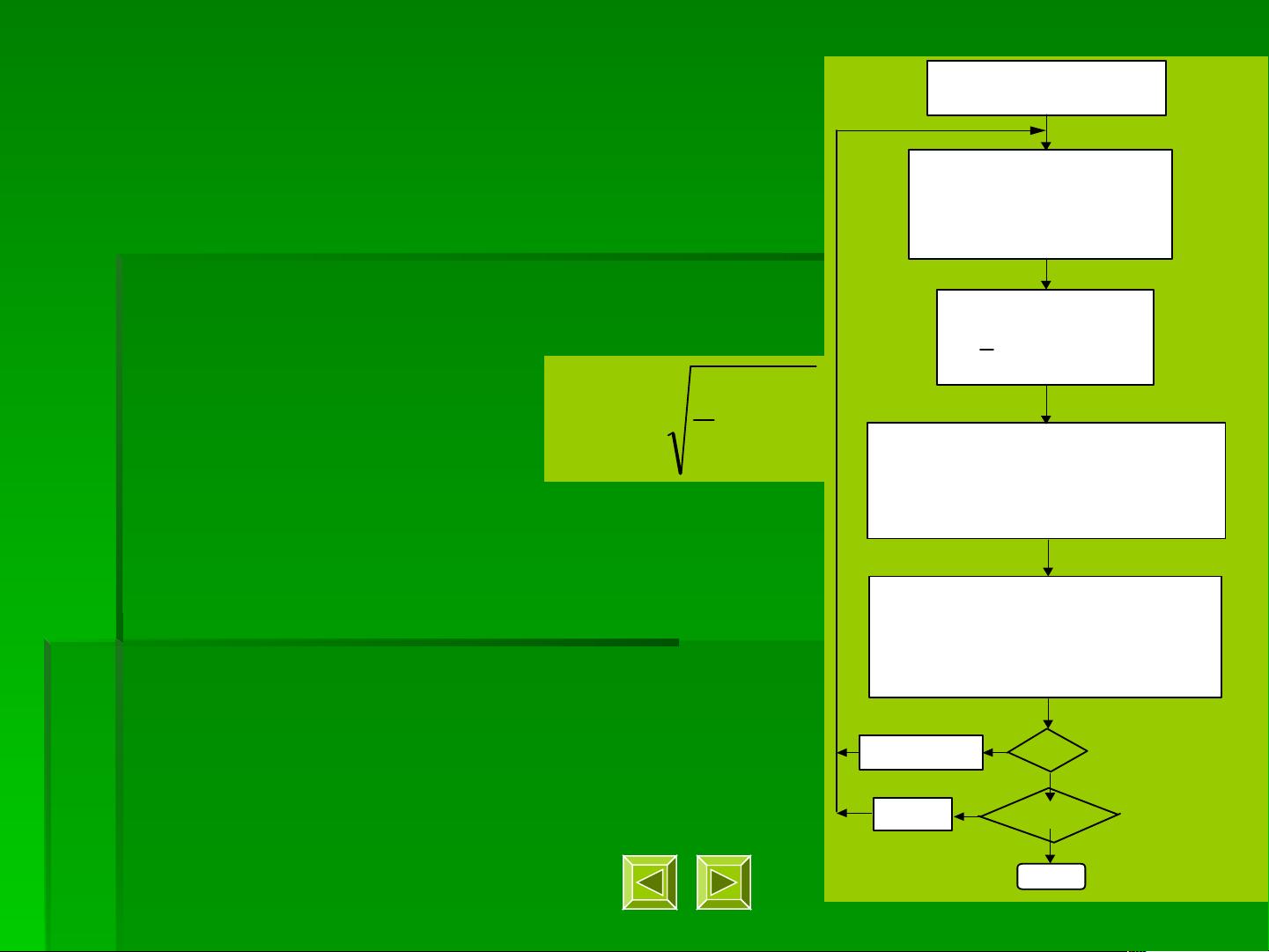

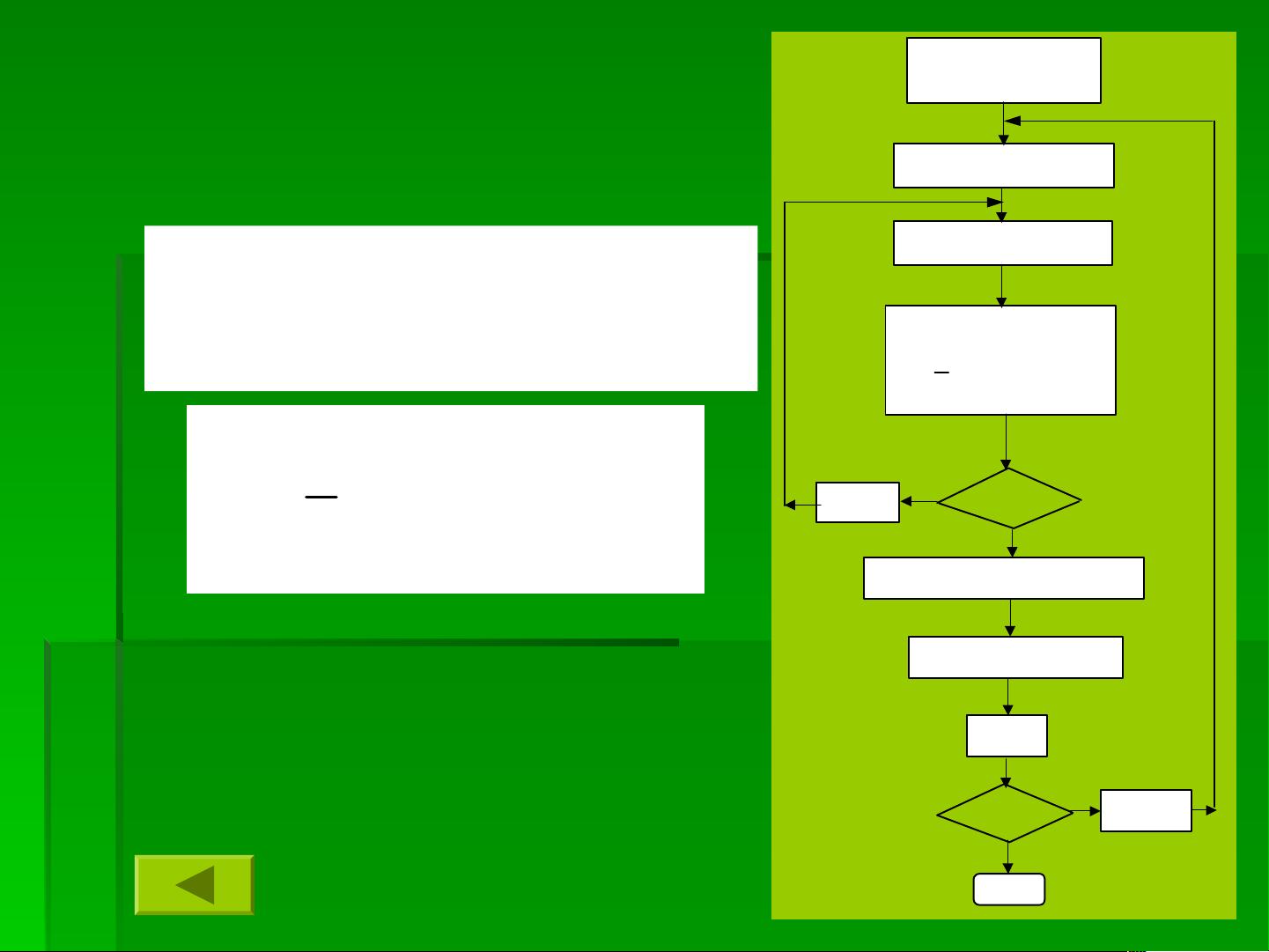

BP算法的基本原理是利用反向传播来不断调整网络中的权重和阈值,使得网络输出与真实值之间的误差最小化。在训练过程中,首先将输入的数据经过输入层传播到隐藏层,再经过隐藏层传播到输出层,最终与实际值进行对比,计算误差并反向调整权重和阈值。通过不断迭代更新权重和阈值,使得网络的预测能力不断提升。

BP算法的优点之一是其能够处理非线性关系。由于神经网络的非线性结构,BP算法能够学习到复杂的数据模式和特征,适用于各种类型的问题,如分类、回归、聚类等。此外,BP算法相比其他机器学习算法具有更好的泛化能力,能够在新数据上取得较好的预测效果。

另外,BP算法易于实现和调整,不需要太多的先验知识和参数设置。只需要设置输入数据、隐藏层和输出层的神经元数量,以及学习率、迭代次数等参数即可进行训练。同时,BP算法也具有较好的扩展性,可以很容易地应用于深层神经网络、卷积神经网络等复杂结构中。

然而,BP算法也存在一些缺点。首先,BP算法容易陷入局部极小值,使得网络无法达到全局最优解。因为在多维空间中,存在多个局部最优解,网络很可能停留在局部最优解而不是全局最优解。其次,BP算法的收敛速度较慢,需要较长的训练时间才能达到收敛状态。即使采用一些优化方法,仍然存在收敛速度慢的问题。

另外,BP算法对初始权重和阈值较为敏感,需要合适的初始化方法才能让网络顺利训练。初始权重和阈值不当会导致网络无法收敛或陷入局部最优解。因此,调整和优化网络的初始参数对于BP算法的训练效果具有重要影响。

综上所述,BP算法作为一种常用的神经网络训练算法,在处理非线性问题、泛化能力强、易于实现和调整方面具有优势。但同时,也面临着易陷入局部最优解、收敛速度较慢、对初始权重和阈值敏感等缺点。为了克服这些缺点,可以结合其他优化方法如遗传算法、粒子群算法等,优化网络结构和参数设置,以提高BP算法的训练效果和速度。

评论0