集成学习:从AdaBoost到随机森林

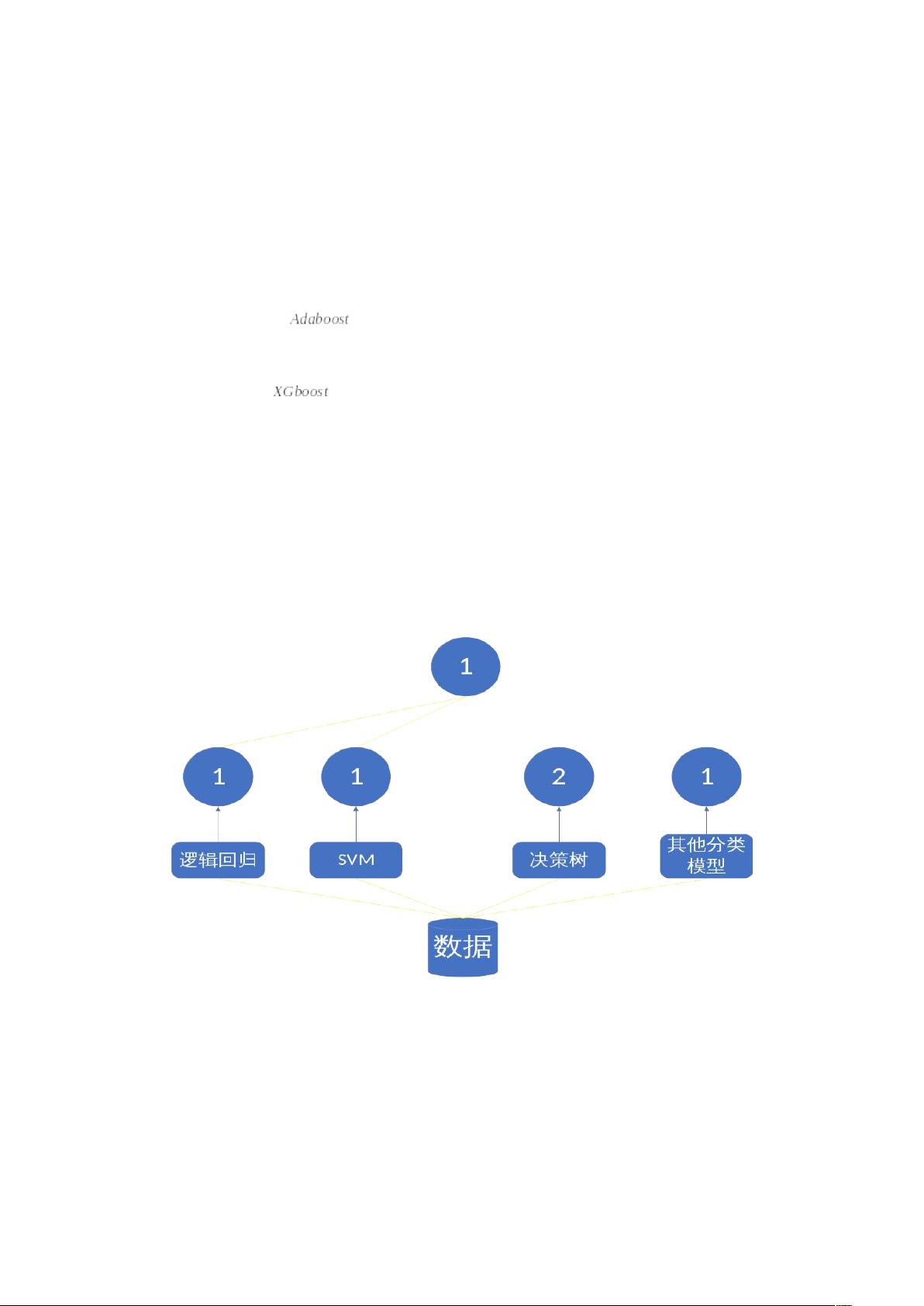

"这篇文档是关于集成学习的详细介绍,涵盖了集成学习的基本概念,常见的集成学习方法,如Voting、Bagging、Boosting以及随机森林,同时也讨论了如何处理样本不均衡的问题。" 集成学习是一种机器学习策略,它通过结合多个预测器的输出来提升整体预测性能,通常能获得比单个预测器更优的结果。这一理念源于“三个臭皮匠顶一个诸葛亮”,意在通过集成多个“专家”的意见来得到更准确的决策。 集成学习中的一种常见方法是Voting,分为硬投票和软投票。硬投票是基于各个分类器的预测结果,选择最多被预测的类别作为最终预测;而软投票则考虑每个分类器对各类别的概率估计,选择概率最高的类别。 Bagging,全称为Bootstrap Aggregating,是一种通过在不同的随机子集上训练相同的算法来创建多个预测器的方法。如果样本在每次抽取时不放回,称为Pasting。Bagging的一个典型应用是随机森林,它在Bagging的基础上增加了特征选择的随机性,每棵树只基于一部分随机选取的特征进行构建,增强了模型的多样性,减少了过拟合风险。 Boosting是一种迭代的增强方法,其中每个后续的弱分类器会更关注前一轮中被错误分类的样本,以逐步提升整体性能。AdaBoost是Boosting的代表,而GBDT(Gradient Boosting Decision Tree)和XGBoost是基于梯度提升的决策树模型,它们在优化过程中通过不断添加新的决策树来减少残差,从而提升整体预测效果。 对于样本不均衡问题,文档列举了几种解决方案。例如,对于多数类样本过多的情况,可以选择对多数类进行降采样,或者将多数类分为多个子类,与少数类分别进行训练。对于少数类样本过少的情况,可以采用过采样技术,如SMOTE(Synthetic Minority Over-sampling Technique),通过生成合成的新样本来增加少数类的样本量。此外,代价敏感学习也是一种有效策略,通过调整不同类别的损失权重,使得模型更加关注少数类的预测。 这篇文档深入浅出地介绍了集成学习的核心概念和技术,对于理解和实践集成学习方法有着重要的指导价值。

下载后可阅读完整内容,剩余7页未读,立即下载

- 粉丝: 1921

- 资源: 11

我的内容管理

展开

我的内容管理

展开

我的资源

快来上传第一个资源

我的资源

快来上传第一个资源

我的收益 登录查看自己的收益

我的收益 登录查看自己的收益 我的积分

登录查看自己的积分

我的积分

登录查看自己的积分

我的C币

登录后查看C币余额

我的C币

登录后查看C币余额

我的收藏

我的收藏  我的下载

我的下载  下载帮助

下载帮助

最新资源

- OptiX传输试题与SDH基础知识

- C++Builder函数详解与应用

- Linux shell (bash) 文件与字符串比较运算符详解

- Adam Gawne-Cain解读英文版WKT格式与常见投影标准

- dos命令详解:基础操作与网络测试必备

- Windows 蓝屏代码解析与处理指南

- PSoC CY8C24533在电动自行车控制器设计中的应用

- PHP整合FCKeditor网页编辑器教程

- Java Swing计算器源码示例:初学者入门教程

- Eclipse平台上的可视化开发:使用VEP与SWT

- 软件工程CASE工具实践指南

- AIX LVM详解:网络存储架构与管理

- 递归算法解析:文件系统、XML与树图

- 使用Struts2与MySQL构建Web登录验证教程

- PHP5 CLI模式:用PHP编写Shell脚本教程

- MyBatis与Spring完美整合:1.0.0-RC3详解

信息提交成功

信息提交成功