理解BP神经网络:误差逆传播与权重调整

需积分: 9 53 浏览量

更新于2024-09-09

收藏 188KB DOC 举报

"BP神经网络的基本原理"

BP神经网络,全称为反向传播(Back Propagation)神经网络,是由Rumelhart、Hinton和Williams等人于1986年提出的,它是一种多层前馈神经网络,广泛应用于深度学习领域。BP网络的主要特点是通过误差逆传播算法来调整网络中的权重和阈值,以最小化网络的总误差。这种算法基于最速下降法,即沿着误差梯度的反方向更新参数,以期望在网络的训练过程中逐步减少误差。

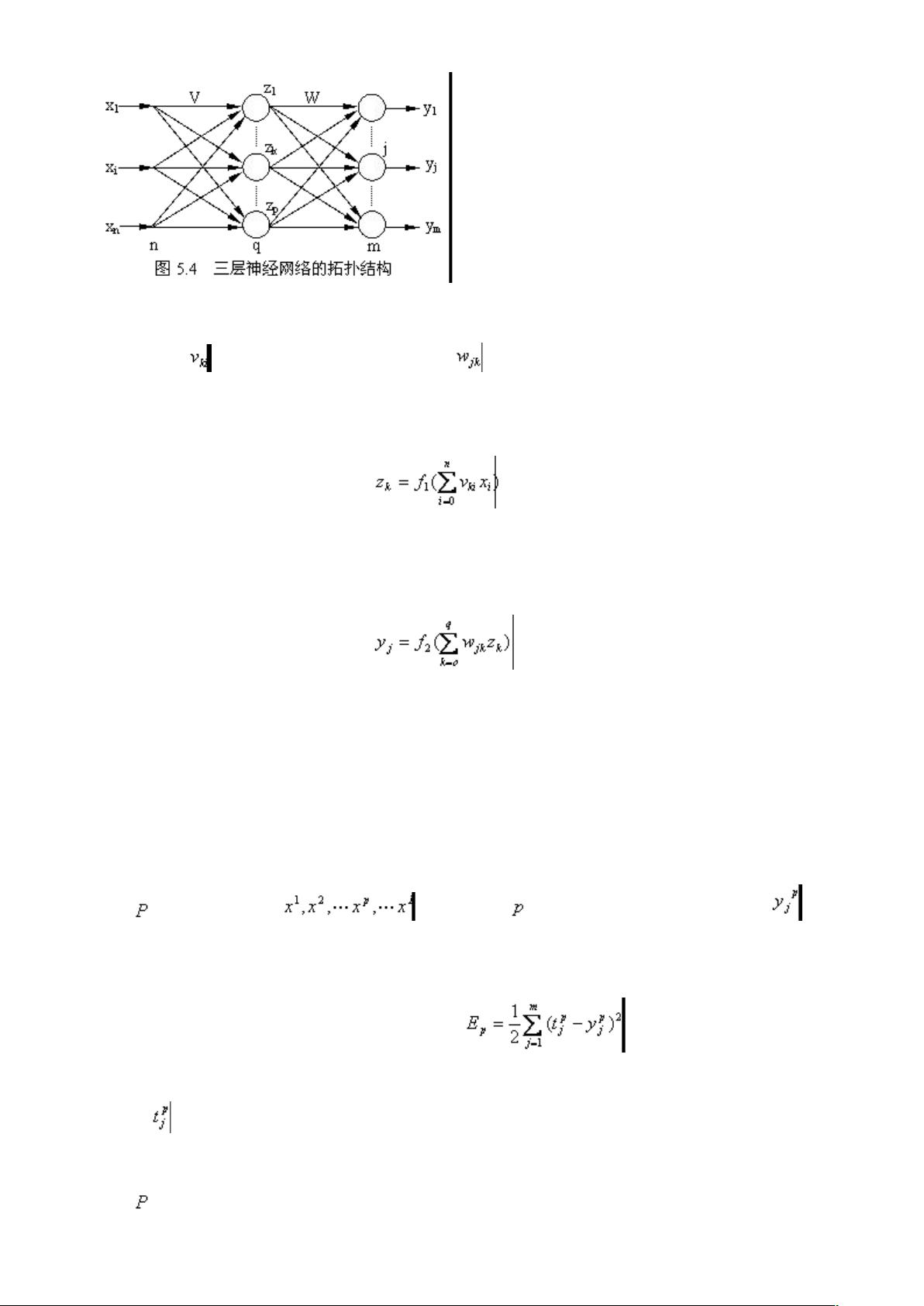

BP神经网络的结构主要包括输入层、隐藏层和输出层。输入层接收原始数据,隐藏层对数据进行非线性转换,而输出层则生成最终的预测结果。每个神经元都具备加权求和与非线性转换的功能,这是模拟生物神经元的基本行为。神经元的净输入是其所有输入信号与相应权重的乘积之和,加上一个阈值。然后,这个净输入通过一个传递函数(如Sigmoid或ReLU)转化为神经元的输出。传递函数必须是单调递增且有界的,以确保输出值的范围控制在一定区间内。

在BP算法中,正向传播是首先进行的步骤。从输入层开始,每个神经元根据当前层的输入和权重计算出自己的输出,并将这些输出作为下一层的输入,直至到达输出层。如果输出层的输出与期望值不符,网络会进入反向传播阶段。在反向传播过程中,误差从输出层按照相反的路径回传到输入层,通过计算误差梯度,更新每一层的权重和阈值,使得网络的总误差逐渐减小。

公式(5.12)定义了神经元的净输入,它是输入信号与权重的乘积之和加上阈值。公式(5.13)和(5.14)分别展示了如何通过传递函数计算神经元的输出。在这个过程中,神经元的净输入与传递函数的组合决定了神经元的激活状态,从而影响整个网络的输出。

BP神经网络通过迭代地调整权重和阈值,能够在大量输入-输出模式中学习并建立映射关系,而无需显式地定义这些关系的数学表达。这一特性使得BP网络在许多复杂问题的解决中展现出强大的能力,例如分类、回归和模式识别等任务。然而,BP网络也存在一些缺点,比如易陷入局部极小值、训练时间较长等,这些问题在后续的深度学习研究中得到了改进,发展出了如卷积神经网络(CNN)和循环神经网络(RNN)等更先进的模型。

点击了解资源详情

点击了解资源详情

526 浏览量

410 浏览量

2023-11-07 上传

280 浏览量

127 浏览量

112 浏览量

如雪残阳

- 粉丝: 22

- 资源: 9

最新资源

- Object Oriented Analysis and Design ——Understanding System Development with UML 2.0

- 数据结构, 浙大的PPT哦,很值得一看, 不过是基础篇

- 软件工程实验指导书(包括两个实验)

- Linux系统指令大全.pdf

- javaScript+验证总结

- Java数据结构 线性表,链表,哈希表是常用的数据结构

- DDR2 SDRAM 操作时序规范 中文版

- A Beginner’s Introduction to Computer Programming

- 索引Index的优化设计

- 软件建模技术教程样节_3.2类.pdf

- 国防科技大学TSM(成功sql,db2,oracle)

- 微软Word_vba范例源代码

- 3G技术普及手册(华为内部版)

- AVS视频标准研究 pdf

- Autonomy白皮书

- Oracle 面试 22种问题