卷积神经网络CNN详解:局部连接、权重共享与特征提取

需积分: 5 64 浏览量

更新于2024-06-22

收藏 18.2MB PPTX 举报

"卷积神经网络(CNN)是一种前馈神经网络,灵感来源于生物视觉系统中的感受野概念,特别设计用于处理具有局部不变性的数据,如图像。CNN的核心特点包括局部连接、权重共享以及空间或时间上的次采样。在图像处理中,卷积操作被用作特征提取器,能够识别和学习局部模式,对图像进行多层次的抽象。"

卷积神经网络(CNN)是深度学习领域的重要组成部分,尤其在图像识别和计算机视觉任务中表现出色。与传统的全连接前馈神经网络相比,CNN在处理图像等高维数据时具有显著优势。全连接网络的所有神经元都与其他所有神经元相连,导致参数数量巨大,这在处理大型图像时容易造成过拟合和计算效率低下。相反,CNN通过以下三个关键特性降低了复杂性:

1. **局部连接**:在CNN中,每个神经元只与其局部邻域内的输入连接,而不是全局连接。这种设计减少了参数数量,同时允许网络学习输入数据的局部特征。

2. **权重共享**:在每个卷积核(或滤波器)中,同一位置的神经元共享相同的权重。这意味着整个滤波器在输入数据的不同位置应用时使用同一套参数,进一步减少参数数量并提高计算效率。

3. **次采样**:也称为池化,这一操作通常在卷积层之后进行,目的是降低数据的空间维度,减少计算量,同时保持模型对平移的不变性。常见的池化方式有最大池化、平均池化等。

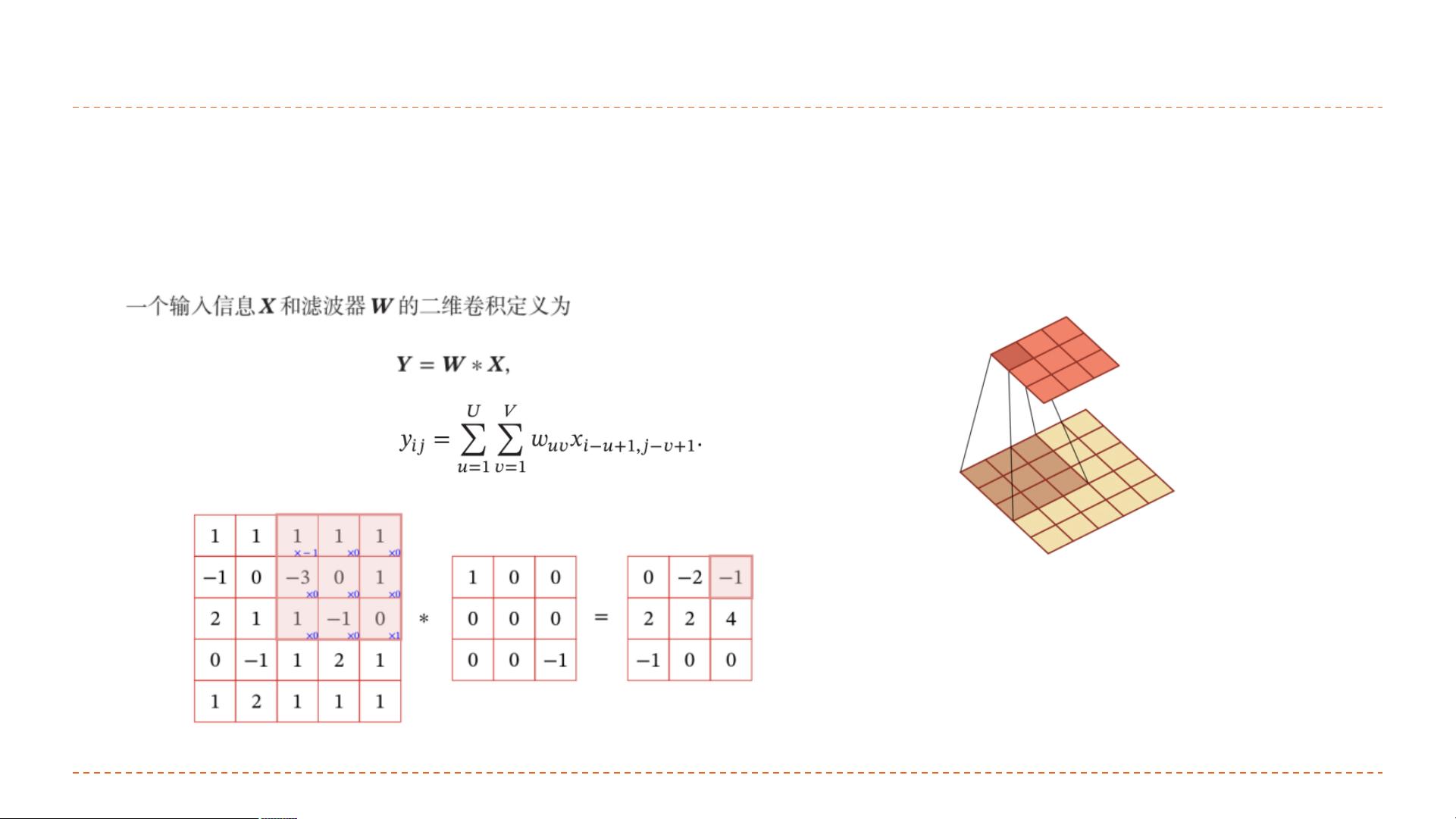

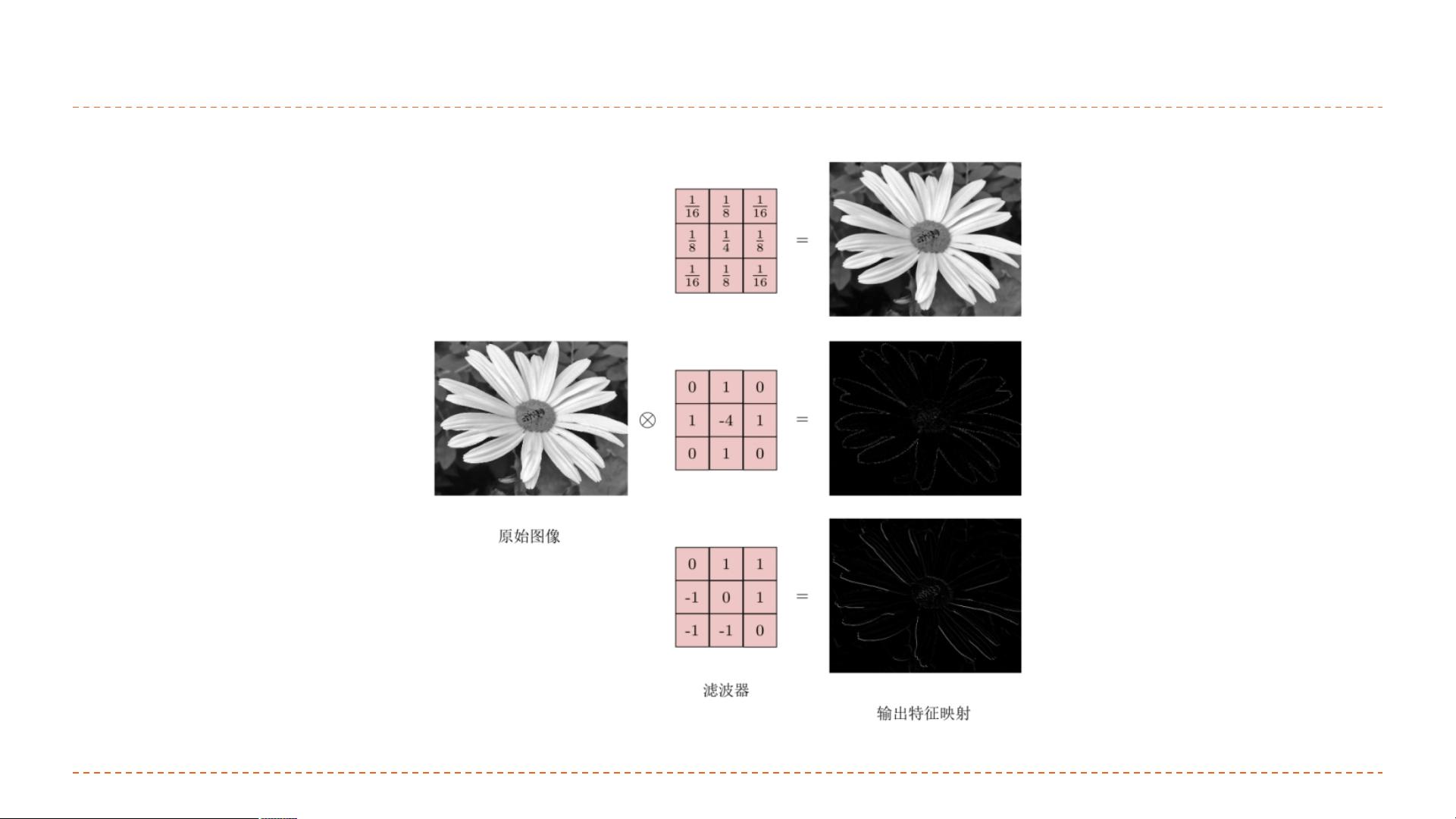

卷积操作在信号处理中有着悠久的历史,它可以捕获信号的历史信息,即延迟累积。例如,一个滤波器可以用来加权整合过去的信号,以提取特定的特征。在CNN中,滤波器(或卷积核)在输入数据上滑动,对每个位置执行卷积运算,产生特征映射(feature map)。

卷积的类型包括窄卷积、宽卷积和等宽卷积,它们的区别在于零填充(padding)和步长(stride)的设置,影响输出的大小。窄卷积保持输出长度接近输入,宽卷积增加输出长度,等宽卷积则使输出长度固定。

在二维卷积中,滤波器在图像的两个维度上滑动,同样执行卷积操作。CNN通常包含多层卷积层,每一层提取不同级别的特征。此外,卷积层之间有时会插入池化层,以降低维度并增加模型的泛化能力。

值得注意的是,卷积操作与互相关操作密切相关,但两者之间有一个区别:卷积需要对滤波器进行翻转,而互相关则不需要。然而,在实际应用中,由于卷积的目的主要是提取特征,而翻转并不影响这一目标,因此在许多实现中,卷积和互相关被视为同义词。

卷积神经网络通过其独特的架构和操作,有效地学习和提取图像等数据的局部特征,从而在图像识别、物体检测、图像分割等任务中展现出强大的性能。随着深度学习的发展,CNN的应用已经扩展到语音识别、自然语言处理等领域,成为现代人工智能技术不可或缺的一部分。

点击了解资源详情

点击了解资源详情

点击了解资源详情

2023-07-21 上传

2019-05-09 上传

2021-09-07 上传

2021-09-16 上传

weixin_44079197

- 粉丝: 1718

- 资源: 598