机器人路径规划中的强化学习:案例研究与实践

发布时间: 2024-09-01 12:46:41 阅读量: 201 订阅数: 40

# 1. 强化学习与机器人路径规划概述

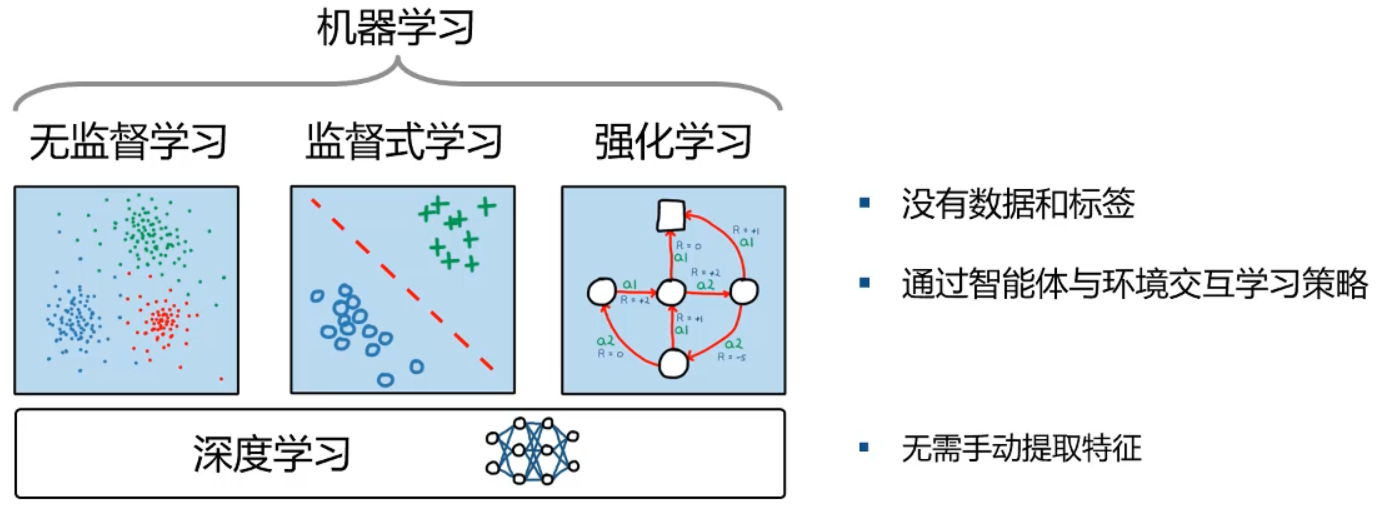

## 1.1 强化学习与路径规划的交叉融合

在当今智能机器人的发展浪潮中,路径规划是实现机器人自主导航与控制的核心技术之一。强化学习作为一种让机器通过与环境的交互进行学习的方法,在机器人路径规划领域展现出了巨大的潜力。这一章节,我们将介绍强化学习与机器人路径规划的基本概念、理论基础与应用前景,为读者构建一个全面的入门框架。

## 1.2 从概念到技术实现的路径

路径规划的最终目的是为了寻找最优的路径,使机器人能以最小的成本从起始点到达目标点,同时避开障碍物并考虑实际环境的约束。而强化学习,则通过奖励机制来指导机器人学习如何在不同情况下做出决策,以达到长期目标。本章旨在将强化学习理论与机器人路径规划的实际应用相结合,探索机器学习在机器人导航中的应用潜力。

## 1.3 为何关注强化学习路径规划

近年来,随着深度学习技术的突破,强化学习在处理复杂的决策问题上取得了显著进展。在机器人路径规划领域,强化学习方法能够处理不确定和动态变化的环境,提供了一种更为高效和适应性强的路径规划策略。本章节将探讨强化学习在机器人路径规划中的应用,以及其对于未来机器人智能化所具有的意义。

# 2. 强化学习基础理论

强化学习作为人工智能领域的一个分支,近年来在机器人路径规划中得到了广泛的应用。本章节将对强化学习的定义、核心概念、主要算法、以及探索与利用之间的关系进行深入的探讨和阐述。

### 2.1 强化学习定义与核心概念

#### 2.1.1 强化学习的定义

强化学习(Reinforcement Learning, RL)是一种通过与环境进行交互来学习最优行为策略的方法。在强化学习中,一个智能体(agent)通过试错(trial-and-error)的方式,在给定的环境中执行动作,并根据反馈的奖励信号(reward)来调整其行为策略。这种方法旨在最大化累积奖励,使智能体能够学习到在特定任务中表现最佳的行为方式。

#### 2.1.2 状态、动作和奖励

在强化学习中,状态(state)是指智能体在某一时刻的环境描述。动作(action)则是智能体可以执行的所有可能行为。奖励(reward)是一个即时信号,它反映了智能体在执行了某个动作后从环境中获得的正面或负面反馈。

#### 2.1.3 策略、值函数和模型

策略(policy)是智能体根据当前状态决定动作的一种映射,可以是确定性的或概率性的。值函数(value function)用于评估在给定策略下,智能体从某一状态开始,能获得的期望回报。模型(model)是智能体对环境动态的预测表示,它可以帮助智能体预测在执行某个动作后环境会如何变化。

### 2.2 强化学习的主要算法

#### 2.2.1 Q-Learning和SARSA

Q-Learning是一种无模型的强化学习算法,它直接对值函数中的Q值进行估计,Q值表示在给定状态下执行某一动作的期望回报。而SARSA是一种在策略学习算法,它与Q-Learning类似,但在更新Q值时使用了实际采取的动作和下一个状态来计算下一个动作。

```python

# Q-Learning伪代码示例

for episode in range(num_episodes):

state = env.reset()

action = select_action(state)

while not done:

next_state, reward, done, _ = env.step(action)

next_action = select_action(next_state)

q_target = reward + gamma * Q[next_state, next_action]

Q[state, action] += learning_rate * (q_target - Q[state, action])

state = next_state

action = next_action

```

#### 2.2.2 Deep Q-Networks (DQN)

DQN通过结合Q-Learning和深度学习技术来解决连续和高维动作空间中的强化学习问题。它使用深度神经网络来近似Q值函数。DQN的一个关键创新是经验回放(experience replay),它有助于打破样本之间的相关性并稳定学习过程。

#### 2.2.3 Policy Gradients

策略梯度(Policy Gradient)方法直接对策略函数进行优化,而不是计算值函数。它通过梯度上升来最大化期望回报。策略梯度方法特别适用于那些动作空间很大或连续的情况。

### 2.3 强化学习的探索与利用

#### 2.3.1 探索策略

探索(exploration)是指智能体尝试新的、未探索过的行为以发现更好的策略。常见的探索策略包括ε-greedy策略,其中智能体有一定概率随机选择动作,以及高斯噪声策略等。

#### 2.3.2 利用现有知识

利用(exploitation)是指智能体根据当前已知的最佳策略来行动,以期获得最大的即时奖励。良好的强化学习算法需要在探索和利用之间找到平衡点。

#### 2.3.3 探索与利用的平衡

强化学习中的一个核心问题是如何平衡探索和利用。最著名的平衡策略之一是上置信界限(Upper Confidence Bound, UCB)策略和汤普森采样(Thompson Sampling)。

```mermaid

graph LR

A[开始] --> B[初始化]

B --> C{选择动作}

C -->|探索| D[探索策略]

C -->|利用| E[利用策略]

D --> F[更新策略]

E --> F

F --> G[收敛?]

G -->|是| H[结束]

G -->|否| C

```

通过不断的迭代,智能体可以学会在特定的环境中通过探索新动作来发现更好的策略,同时在学习过程中有效地利用已知信息以获取最大的即时奖励。

以上章节内容展示了强化学习的基础理论,为后面章节对机器人路径规划的具体应用提供了坚实的理论基础。接下来的章节将深入探讨路径规划问题的建模以及强化学习在此领域的应用实践。

# 3. ```

# 第三章:路径规划问题的建模

## 3.1 路径规划问题的定义

### 3.1.1 路径规划的目标和约束

在路径规划问题中,目标是寻找到一条从起点到终点的最优路径,考虑到实际应用中可能存在的限制和要求。路径规划的目标和约束可以分为以下几点:

- **最短路径**:路径的总距离尽可能短,这在很多应用场景中都是最基本的优化目标。

- **最少时间**:如果存在不同的路径速度限制,那么选择一个能够快速到达的路径就显得尤为重要。

- **安全性**:路径应该避开障碍物,确保机器人在运动过程中的安全性。

- **资源消耗**:在某些情况下,路径规划需要考虑能耗的最小化,尤其是在电量有限的机器人或无人机中。

- **动态环境适应**:环境的动态变化需要被纳入考虑,比如其他移动对象的存在,或是一些可变的环境因素。

### 3.1.2 路径的评价指标

为了评估和比较不同的路径,我们需要定义一些评价指标。这些指标可以帮助我们量化路径的性能,并且选择最优的路径。以下是一些常用的评价指标:

- **路径长度**:衡量路径的总距离,最短路径是最常见的目标。

- **时间成本**:衡量实际耗时,特别是在考虑不同路段速度限制的情况下。

- **安全性评分**:考虑路径的障碍物接近度、狭窄度等因素,给予安全性一个量化的评分。

- **能量消耗**:量化路径所涉及的能量消耗,尤其是对于低能量机器人系统来说非常重要。

## 3.2 环境建模与状态表示

### 3.2.1 环境的分类与特征

环境建模是路径规划中至关重要的一步,它需要准确地表示出机器人将要操作的空间。环境可以被分为以下几类:

- **已知静态环境**:在这种环境中,所有的障碍物和地形都是已知且不会变化的。这为路径规划提供了很大的便利。

- **部分未知环境**:机器人可能在探索过程中遇到新的障碍物或地形变化,要求算法具有适应性。

- **动态环境**:存在移动的障碍物和其他不可预测的因素,需要实时地进行路径规划和调整。

### 3.2.2 状态空间的定义和划分

状态空

```

0

0