【解决HDFS Block小文件问题】:提升存储性能的全方位策略

发布时间: 2024-10-28 22:23:27 阅读量: 2 订阅数: 8

# 1. HDFS Block小文件问题概述

## 1.1 HDFS和小文件问题简介

Hadoop分布式文件系统(HDFS)是大数据技术栈中的核心组件,广泛应用于存储大规模数据集。然而,HDFS对于小文件处理存在天然的劣势,即“小文件问题”。小文件指的是那些大小远小于HDFS默认数据块(Block)大小的文件。这类文件在存储和处理时会引发一系列性能问题,从而影响整个大数据系统的效率。

## 1.2 小文件问题的普遍性和严重性

小文件问题是一个普遍存在的问题,对于使用HDFS的系统而言,它们可以显著增加NameNode的内存消耗,降低文件系统的伸缩性。由于每个小文件都会占用NameNode中的一个元数据记录,大量小文件会导致NameNode内存耗尽,这在实践中被称为“内存饱和”问题。

## 1.3 小文件问题对大数据生态的影响

随着大数据应用的增长,小文件问题对生态系统的整体性能、成本效益以及可靠性都有深远影响。它不仅降低数据处理效率,还可能导致集群扩展困难和资源浪费。因此,理解和解决HDFS中的小文件问题对于构建高效的大数据处理系统至关重要。

```markdown

小结:

- HDFS是大数据存储的核心组件,面临小文件问题。

- 小文件会引发性能问题,对NameNode内存和系统效率产生影响。

- 小文件问题需要深入分析和解决,以维护大数据生态系统的健康。

```

# 2. 理论分析小文件对HDFS性能的影响

### HDFS的基本概念和工作原理

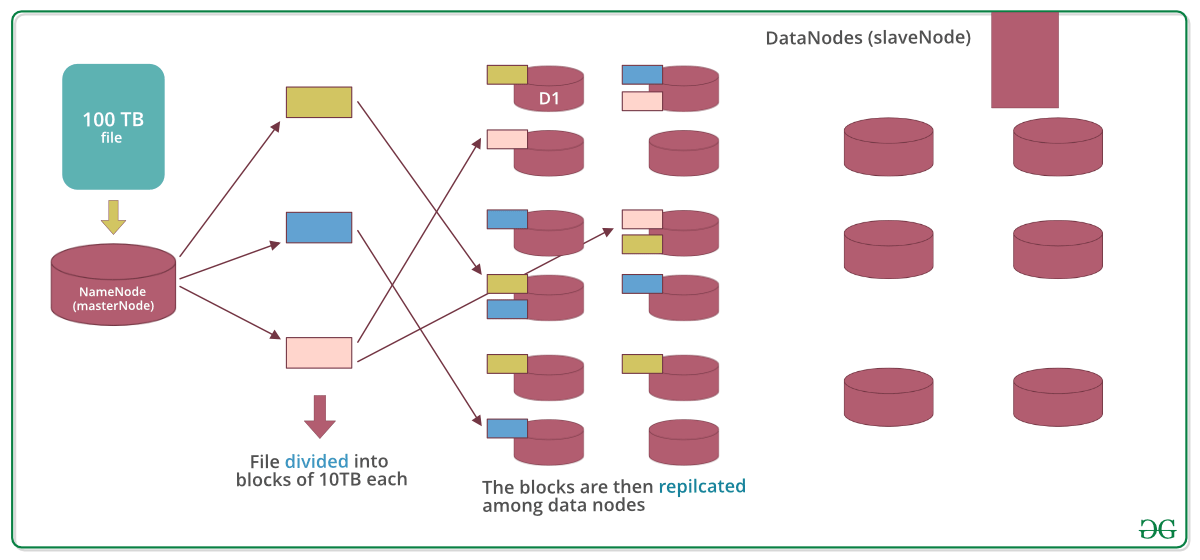

#### HDFS架构简介

Hadoop分布式文件系统(HDFS)是Hadoop框架中的一个核心组件,专为大规模数据集的存储而设计,能够运行在普通硬件上。HDFS采用了主从(Master/Slave)结构模型,一个HDFS集群由一个NameNode(命名节点)和多个DataNode(数据节点)组成。NameNode负责管理文件系统的命名空间和客户端对文件的访问;DataNode则在本地文件系统上存储实际的数据块,并执行数据块的创建、删除和复制等操作。

HDFS对外提供了高吞吐量的数据访问,非常适合那些有着大量数据集的应用程序。此外,HDFS也支持高容错性,自动在多个DataNode之间创建数据的多个副本,并能够在某个节点发生故障时重新复制数据。

#### HDFS Block机制的作用与设计

HDFS的块(Block)机制是其能够高效处理大数据集的关键。HDFS将文件分割成一系列块,并将这些块分布在集群中的多个DataNode上。默认的块大小是128MB,但这个值可以根据实际需要进行调整。块的大小设置对性能有着重要影响:

- 较小的块大小意味着更多的元数据信息需要由NameNode处理,增加了NameNode的内存占用和管理开销。

- 较大的块大小意味着减少了NameNode的管理开销,但会导致单个节点故障时的数据损失风险增加,同时降低了数据的局部性,可能会增加数据读取的延迟。

### 小文件问题的成因与表现

#### 小文件在HDFS中的定义和分类

小文件是指那些大小低于HDFS块大小(默认128MB)的文件。它们在HDFS中可以被进一步分类为:

- 微小文件(Micromap):小于64KB的文件。

- 小文件(Small File):大小在64KB到128MB之间的文件。

- 大文件(Large File):大小超过128MB的文件。

#### 小文件导致的性能问题剖析

小文件问题主要表现在以下几个方面:

- **NameNode的元数据压力**:HDFS中,所有的文件系统命名空间的操作以及对文件的元数据管理均由NameNode完成。小文件的存在导致了元数据数量的剧增,进而增加了NameNode的内存消耗,甚至可能耗尽其内存,引发性能瓶颈。

- **NameNode和DataNode之间的通信开销**:每个小文件的管理都涉及到大量的网络通信,造成网络拥堵。

- **DataNode的I/O性能压力**:小文件被分散存储在多个DataNode上,导致每个DataNode的磁盘I/O操作增多,频繁的寻址和读写操作增加了磁盘的负担。

### 小文件问题对存储性能的具体影响

#### 命名节点的负载分析

在HDFS中,所有的文件系统命名空间操作都由NameNode处理。这意味着每个文件的创建、删除、重命名、打开以及获取文件属性等操作都要经过NameNode。小文件数量的增加,导致了对这些操作的需求成倍增长。同时,每个小文件都需要在NameNode中创建对应的文件目录结构、文件记录和块列表等元数据信息,大大增加了NameNode的内存和CPU负担。长期以往,NameNode可能会因为资源耗尽而成为系统的瓶颈。

#### 数据节点的I/O性能压力

对于存储小文件的DataNode而言,虽然单个文件对磁盘I/O的压力可能不大,但是大量的小文件却可以导致频繁的磁盘寻址操作,使得I/O性能显著下降。小文件的随机访问特性使得文件系统的缓存利用率下降,降低了整体的数据读取效率。

接下来,我们将详细讨论小文件问题的诊断与评估方法。

# 3. ```

# 第三章:小文件问题的诊断与评估

## 3.1 常用的HDFS性能监控工具

在Hadoop生态系统中,监控HDFS的性能是一个持续的过程,通过使用不同的监控工具,管理员能够快速诊断出系统中的问题,并及时进行优化。Hadoop自带的一些工具和第三方工具各有特色,下面将分别介绍这些工具的使用方法和优缺点。

### 3.1.1 Hadoop自带的监控工具使用方法

Hadoop自带的监控工具有多个,例如NameNode UI、DataNode UI、ResourceManager UI、NodeManager UI和YARN Timeline Service等。这些工具通过Web界面提供实时信息,并允许管理员执行一些基本的管理任务。

- **NameNode UI**:显示了NameNode的状态信息,包括文件系统的命名空间、正在运行的DataNodes、以及每个文件块的复制情况。管理员可以通过它来检查系统的健康状态。

- **YARN ResourceManager UI**:提供了关于YARN资源管理和作业调度的详细信息。管理员可以查看应用的运行状态和资源使用情况。

- **YARN NodeManager UI**:允许管理员监控每个节点上的资源使用情况和运行任务的状态。

对于这些工具,它们共同的优点是安装方便,配置简单。但是,它们也存在一些局限性,比如展示的信息比较有限,且对集群状态的查看仅限于单个组件,缺乏全局视角。

### 3.1.2 第三方监控工具的比较和选择

随着大数据生态的发展,出现了许多第三方的监控工具,它们提供了更加丰富的功能和更加直观的视图,如Ambari、Cloudera Manager、Ganglia等。这些工具通常集成了集群监控、报警、资源管理和优化建议于一体。

- **Ambari**:提供了直观的Web界面,可以方便地查看集群状态、安装服务、执行健康检查,还能设置警报通知。

- **Cloudera Manager**:是Cloudera发行版中的一个集成管理工具,支持对集群的全面监控,包括性能指标、服务状态、系统配置等。

- **Ganglia**:是一个可扩展的分布式监控系统,它主要用于监控大规模集群的性能。

在选择第三方工具时,需要考虑它们的易用性、功能的完整性、社区支持度和费用等因素。比如,Ambari是开源的,适合预算有限且需要集成在Hadoop生态系统内的用户。

## 3.2 小文件的识别和统计方法

为了有效地处理小文件问题,首先需要对现有的小文件进行识别和统计。通过具体的统计和分析,可以了解小文件在集群中的分布和规模,进而为制定优化策略提供依据。

### 3.2.1 使用Hadoop命令行工具进行统计

Hadoop提供了多个命令行工具可用于小文件的识别和统计,其中最常用的包括`hdfs dfs -count`命令和`hadoop fsck`命令。

- `hdfs dfs -count`命令可以用来统计指定目录下文件的数量、大小以及副本数。

```bash

hdfs dfs -count /path/to/directory

```

上面的命令会返回指定目录下的总文件数量、目录数量、总大小以及副本信息。

- `hadoop fsck`命令能够检查文件系统的健康状态,并输出有关文件的统计信息。

```bash

hadoop fsck / -files -blocks -locations

```

此命令会列出整个文件系统中的文件、块以及它们的位置信息。

通过这些工具,管理员可以识别出哪些目录包含了大量的小文件,并采取相应的策略进行处理。

### 3.2.2 利用Hive/Spark等数据分析工具进行分析

除了Hadoop自带的命令行工具外,还可以利用更高级的数据分析工具,如Hive或Spark,来进行更深入的文件分析。

- **Hive**:Hive是一个构建在Hadoop之上的数据仓库工具,可以使用SQL查询HDFS上的数据。通过Hive,用户可以轻松地查询存储在HDFS中的数据,对文件进行分组统计。

```sql

SELECT COUNT(*) FROM my_table WHERE size <= 1048576;

```

上述SQL语句可以用来统计表中小于1MB的文件数量。

- **Spark**:Spark是一个快速的分布式计算系统,支持SQL查询、流处理、机器学习和图处理等。Spark可以使用其RDD(弹性分布式数据集)和DataFrame API来分析存储在HDFS中的数据。

```scala

val smallFilesCount = sc.textFile("/path/to/directory/*").filter(_.length < 1024).count()

```

这段Scala代码计算了指定目录下小于1KB的文件总数。

通过使用这些高级数据分析工具,可以对HDFS中的文件进行更复杂的分析,获取关于小文件分布的详细信息。

## 3.3 小文件问题的量化评估

在识别和统计了小文件后,需要对问题进行量化评估,以便衡量采取的优化措施的有效性。量化评估通常包括建立评估指标体系和进行数据对比分析。

### 3.3.1 评估指标体系建立

```

0

0