Numpy.linalg的并行计算:加速大规模矩阵运算

发布时间: 2024-10-15 21:35:31 阅读量: 58 订阅数: 23

# 1. Numpy.linalg简介

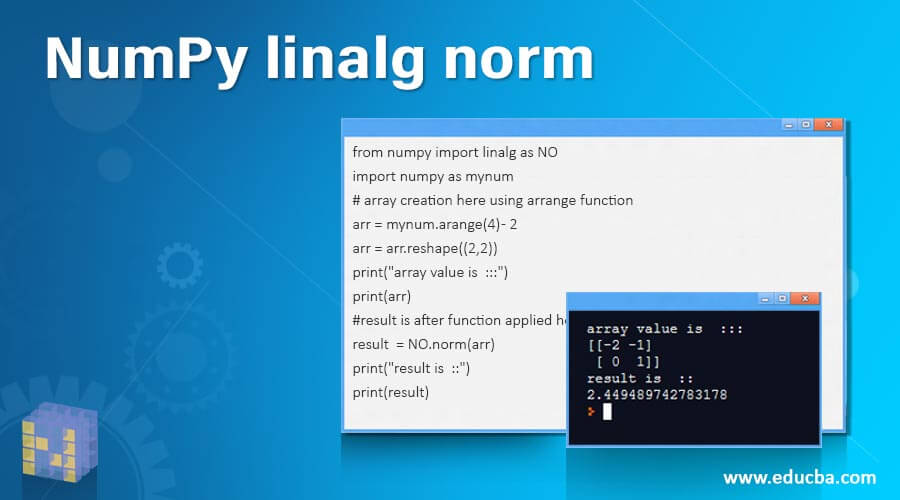

在本章节中,我们将首先了解Numpy.linalg模块的基础知识。Numpy.linalg是Python中Numpy库的一个子模块,专门用于线性代数计算。它提供了一系列的函数来计算矩阵的范数、解线性方程组、计算特征值和特征向量等。对于那些在数据科学、机器学习和科学计算中经常需要进行矩阵运算的开发者来说,Numpy.linalg是不可或缺的工具。

```python

import numpy as np

# 创建一个简单的矩阵

matrix = np.array([[1, 2], [3, 4]])

# 计算矩阵的逆

inverse_matrix = np.linalg.inv(matrix)

# 计算矩阵的行列式

determinant = np.linalg.det(matrix)

print("矩阵:\n", matrix)

print("矩阵的逆:\n", inverse_matrix)

print("矩阵的行列式:", determinant)

```

通过上述代码示例,我们可以看到如何使用Numpy.linalg模块中的函数来计算矩阵的逆和行列式。这只是Numpy.linalg提供的丰富功能中的冰山一角。随着本章节内容的深入,我们将探索更多高级的线性代数运算及其在并行计算中的应用。

# 2. 并行计算的基础知识

并行计算是高性能计算的一个重要分支,它通过同时利用多个计算资源来解决计算问题,以提高计算效率和解决更大规模的问题。本章节将详细介绍并行计算的基本概念、实现方式以及在Numpy中的应用。

### 2.1 并行计算的基本概念

#### 2.1.1 并行计算的定义

并行计算是指同时使用多个计算资源进行计算的一种计算方式。这些计算资源可以是多核CPU、多节点计算机集群、甚至是GPU等硬件设备。通过将计算任务分解成多个子任务,并在不同的计算资源上并行执行这些子任务,可以显著缩短问题的求解时间。

#### 2.1.2 并行计算的优势

并行计算的主要优势在于它能够处理大规模的数据集和复杂的问题,这些往往是单个处理器无法高效处理的。并行计算可以提供更好的性能,特别是在科学计算、图像处理、数据分析等领域,可以实现线性或接近线性的加速比。

### 2.2 并行计算的实现方式

#### 2.2.1 多线程和多进程

在软件层面,多线程和多进程是实现并行计算的两种主要方式。多线程允许程序同时执行多个线程,共享进程的内存空间,适用于多任务之间的频繁通信。多进程则每个进程拥有独立的内存空间,适合于计算密集型任务,但在进程间的通信开销较大。

#### 2.2.2 GPU加速技术

GPU加速技术是利用图形处理器(GPU)强大的并行处理能力来加速计算的一种方式。GPU拥有成百上千个核心,能够并行处理大量的数据。在深度学习、科学计算等领域,GPU加速已经成为一种主流的并行计算实现方式。

### 2.3 Numpy中的并行计算

#### 2.3.1 Numpy的内部机制

Numpy是Python中用于科学计算的核心库,其内部使用C语言和Fortran语言编写,因此可以充分利用这些语言的底层并行机制。例如,Numpy在进行矩阵运算时,可以自动利用多核CPU的计算能力进行并行计算,提高运算效率。

#### 2.3.2 利用Numpy进行并行计算

为了在Numpy中进行并行计算,开发者需要了解如何利用库函数来实现。例如,可以使用Numpy的`dot`函数来执行向量和矩阵的乘积运算,该函数在内部可能利用了多线程来加速计算过程。

```python

import numpy as np

# 创建两个大型矩阵

A = np.random.rand(1000, 1000)

B = np.random.rand(1000, 1000)

# 执行矩阵乘法

C = np.dot(A, B)

```

在上述代码中,`np.dot`函数在后台可能使用了多线程来加速矩阵乘法的计算。开发者可以通过设置环境变量或使用其他库来进一步优化这些计算。

### 总结

在本章节中,我们介绍了并行计算的基本概念、实现方式以及在Numpy中的应用。并行计算作为一种重要的技术,对于处理大规模数据集和复杂计算问题具有显著的优势。Numpy库通过其内部机制和函数,为开发者提供了利用并行计算的途径。理解并行计算的基础知识,对于提高Numpy程序的性能至关重要。

# 3. Numpy.linalg的矩阵运算

## 3.1 基本矩阵运算

### 3.1.1 矩阵加减乘除

在Numpy中,矩阵的加减乘除运算是非常基础的操作,它们通常用于简单的数学运算或者预处理数据。例如,在处理线性方程组时,矩阵加减乘除可以帮助我们组合或简化方程。

#### 代码示例:矩阵加减乘除

```python

import numpy as np

# 定义两个矩阵

A = np.array([[1, 2], [3, 4]])

B = np.array([[5, 6], [7, 8]])

# 矩阵加法

C = A + B

# 矩阵减法

D = A - B

# 矩阵乘法

E = np.dot(A, B)

# 矩阵除法

# 注意:矩阵除法在数学上通常表示为乘以逆矩阵,在Numpy中可以使用np.linalg.solve()或者np.linalg.inv()计算逆矩阵后乘以原矩阵

# 这里仅为演示,实际操作中应当使用solve或inv

F = A / B # 这不是标准的矩阵除法

print("矩阵加法结果:\n", C)

print("矩阵减法结果:\n", D)

print("矩阵乘法结果:\n", E)

print("矩阵除法结果:\n", F)

```

#### 参数说明与执行逻辑

在上述代码中,我们定义了两个2x2的矩阵A和B,并演示了如何使用Numpy进行矩阵的加减乘除运算。需要注意的是,矩阵除法通常指的是乘以逆矩阵的操作,在Numpy中,可以通过`np.linalg.solve()`或`np.linalg.inv()`来计算逆矩阵后进行乘法操作。这里展示的除法仅作为演示,实际应用中应当谨慎使用。

### 3.1.2 矩阵的乘积运算

矩阵的乘积运算是线性代数中最为重要的操作之一,它在线性方程组求解、图像处理、机器学习等领域有着广泛的应用。

#### 代码示例:矩阵乘积运算

```python

import numpy as np

# 定义两个矩阵

A = np.array([[1, 2], [3, 4]])

B = np.array([[5, 6], [7, 8]])

# 矩阵乘积

C = np.dot(A, B)

print("矩阵A与矩阵B的乘积结果:\n", C)

```

#### 参数说明与执行逻辑

在上述代码中,我们使用了`np.dot()`函数来计算两个矩阵的乘积。矩阵乘积的计算需要遵循线性代数中的规则,即A矩阵的列数必须与B矩阵的行数相等。在这个例子中,矩阵A是2x2的,矩阵B也是2x2的,因此它们可以相乘,结果是一个2x2的矩阵C。

## 3.2 高级矩阵运算

### 3.2.1 矩阵分解

矩阵分解是线性代数中的一个重要概念,它可以将一个复杂的矩阵转换为几个较为简单的矩阵的乘积。常见的矩阵分解方法包括LU分解、QR分解和奇异值分解(SVD)。

#### 代码示例:LU分解

0

0