【R语言项目实战】:解决实际问题的isnev包应用案例分析

发布时间: 2024-11-05 15:44:53 阅读量: 20 订阅数: 35

R语言数据分析实战:案例解析与技巧

# 1. R语言项目实战概览

## 1.1 数据科学与R语言的重要性

在数据科学领域,R语言凭借其强大的统计分析功能和图形展现能力,成为了数据分析师的宠儿。R语言的开源特性以及活跃的社区支持,为其在项目中的广泛应用提供了坚实的基础。掌握R语言的应用技巧,对提高工作效率,优化数据处理流程具有重要意义。

## 1.2 R语言项目实战的价值

R语言项目实战不仅有助于深化理论知识,还能够训练实践能力。在项目中,可以将R语言的各个包和函数灵活运用,解决实际问题。此外,项目实战的过程也是对个人逻辑思维和问题解决能力的一种锻炼,有助于提升个人在数据科学领域的竞争力。

## 1.3 本章学习目标

通过本章的学习,读者将对R语言的项目实战有全面的认识。我们将从实战的角度出发,介绍R语言在数据分析项目中的应用流程、关键技术和最佳实践案例。本章将为读者深入学习后续章节内容奠定坚实的基础。

# 2. isnev包的基础应用

## 2.1 isnev包简介

### 2.1.1 isnev包的安装和加载

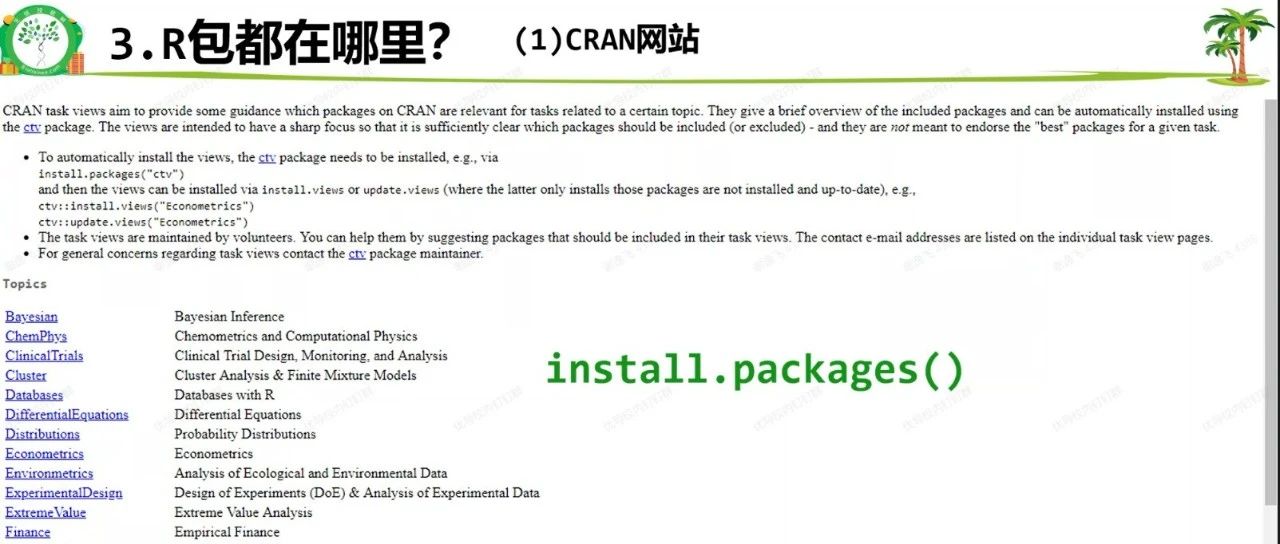

`isnev`包是R语言中的一个专门用于数据分析和统计的工具包。它提供了多种便捷的数据处理和分析功能,可以大幅简化数据分析工作。在介绍如何安装和加载`isnev`包之前,确保已经安装了R语言的最新版本,并且能够访问CRAN(Comprehensive R Archive Network)。

安装`isnev`包的基本步骤如下:

```R

install.packages("isnev")

```

安装完成后,需要将该包加载到当前的R会话中以便使用其功能:

```R

library(isnev)

```

在进行安装和加载时,可能需要根据您的系统配置和网络环境进行相应的参数调整。

### 2.1.2 isnev包核心功能介绍

`isnev`包的核心功能涵盖了数据分析的多个方面,主要包括以下几个模块:

1. **数据导入与预处理**:`isnev`包提供了一系列的函数来简化数据的导入和初步处理流程,例如从CSV文件、数据库或其他格式的数据源中导入数据。

2. **统计分析**:提供常规统计量计算,例如均值、中位数、方差等,并能进行假设检验等统计推断。

3. **数据可视化**:支持绘制各种统计图表,包括条形图、直方图、箱线图等,这有助于对数据分布有一个直观的认识。

4. **高级数据处理**:`isnev`包还提供了复杂的数据处理功能,比如数据的合并、分组运算、缺失值处理等。

## 2.2 数据处理与分析基础

### 2.2.1 数据导入与初步探索

在开始数据处理之前,首要步骤是将数据导入R环境。`isnev`包支持多种数据源的导入,但这里以最常见的CSV文件为例。以下是导入CSV文件的代码和对应解释:

```R

# 假设CSV文件名为 'data.csv' 位于当前工作目录中

data <- read.csv('data.csv', header = TRUE, sep = ",")

```

其中,`header` 参数指示文件的第一行是否包含列名,`sep` 参数定义了字段之间的分隔符。数据成功导入后,可以利用 `head()`、`tail()` 等函数查看数据的前几行和后几行,用 `str()` 函数来查看数据结构。

### 2.2.2 数据清洗与预处理技巧

数据清洗是确保数据质量的关键步骤。`isnev`包中的几个实用函数可以快速识别并处理异常值、缺失值和重复记录。

```R

# 检查数据中的缺失值

missing_values <- is.na(data)

# 删除包含缺失值的行

clean_data <- na.omit(data)

# 删除重复记录

unique_data <- unique(data)

```

在数据清洗的过程中,理解不同列的数据类型和结构是非常重要的。例如,日期列可能需要转换为日期格式以方便后续处理,而字符型数据可能需要进行因子转换以便于分组操作。

## 2.3 isnev包在数据分析中的应用

### 2.3.1 基本统计分析

`isnev`包中包含了一系列基本统计函数,这些函数可以方便地对数据进行描述性统计分析。以下是一些常用的统计函数示例:

```R

# 计算均值

mean_value <- mean(data$column_name)

# 计算中位数

median_value <- median(data$column_name)

# 计算标准差

sd_value <- sd(data$column_name)

```

这些基本统计分析为深入理解数据集提供了初步视角,可以帮助我们更好地了解数据集的中心趋势和离散程度。

### 2.3.2 高级数据处理功能

在复杂的数据分析任务中,可能需要对数据集进行更高级的处理,例如数据的分组和聚合。`isnev`包中的 `group_by()` 和 `summarize()` 函数能够有效地对数据进行分组聚合处理。

```R

# 对数据按照某一列进行分组,并计算每组的均值

grouped_data <- group_by(data, group_column)

summarized_data <- summarize(grouped_data, mean_value = mean(data_column))

```

高级数据处理功能是数据分析进阶阶段的重要工具,通过组合使用不同的函数,可以构建出复杂的数据处理流程。

在本章节中,我们介绍了`isnev`包的安装和加载流程、核心功能以及数据处理和分析的基础。通过实际操作和案例分析,我们学习了如何运用`isnev`包进行初步的数据探索和清洗。此外,还展示了如何应用基本统计分析和高级数据处理功能来深入理解数据集。这些知识点为后续章节更高级的应用打下了坚实的基础。

# 3. isnev包的高级应用与技巧

在第二章中,我们已经学习了`isnev`包的基础应用,包括数据的导入、初步探索、清洗、预处理,以及基本统计分析和一些高级数据处理功能。本章将继续深入探讨`isnev`包的高级应用与技巧,重点介绍复杂数据集处理、自定义函数与算法的实现,以及可视化与结果呈现。

## 3.1 复杂数据集处理

在面对复杂的数据集时,`isnev`包提供了强大的工具来应对多维数据集的操作和大数据集的优化处理。

### 3.1.1 多维数据集操作

多维数据集(例如,三维数据或时间序列数据)在数据分析中是常见的挑战之一。`isnev`包提供了一系列函数来简化这类数据的操作。以下是几个关键的函数:

- `stack()`:将多个数据框按列堆叠成一个新的数据框。

- `unstack()`:将数据框中的数据按行展开成多个数据框。

- `merge()`:合并两个或多个数据集。

- `reshape()`:重新塑造数据结构,使得数据更加适合进行分析。

这些函数能够帮助我们灵活地处理多维数据集,并在其中进行数据的重组、整合和变换。接下来我们通过实际代码操作来深入理解。

```r

# 假设我们有一个三维数据集,我们希望将它按某个维度堆叠。

# 首先创建示例数据

df1 <- data.frame(id=1:10, value1=rnorm(10))

df2 <- data.frame(id=1:10, value2=rnorm(10))

# 使用stack()函数堆叠数据框df1和df2

stacked_data <- stack(list(data1=df1, data2=df2))

# 查看结果

print(stacked_data)

```

```r

# 使用reshape()函数将堆

```

0

0