NAS贝叶斯优化新方法:利用概率建模优化神经架构

发布时间: 2024-08-22 02:17:34 阅读量: 11 订阅数: 11

# 1. 贝叶斯优化简介

贝叶斯优化是一种迭代式优化算法,它利用贝叶斯推理来指导搜索过程。它通过构建目标函数的后验概率分布来实现,该分布不断更新,以反映对目标函数的观察结果。贝叶斯优化适用于难以求解的优化问题,例如神经架构搜索。

# 2. 贝叶斯优化在神经架构搜索中的应用

### 2.1 神经架构搜索概述

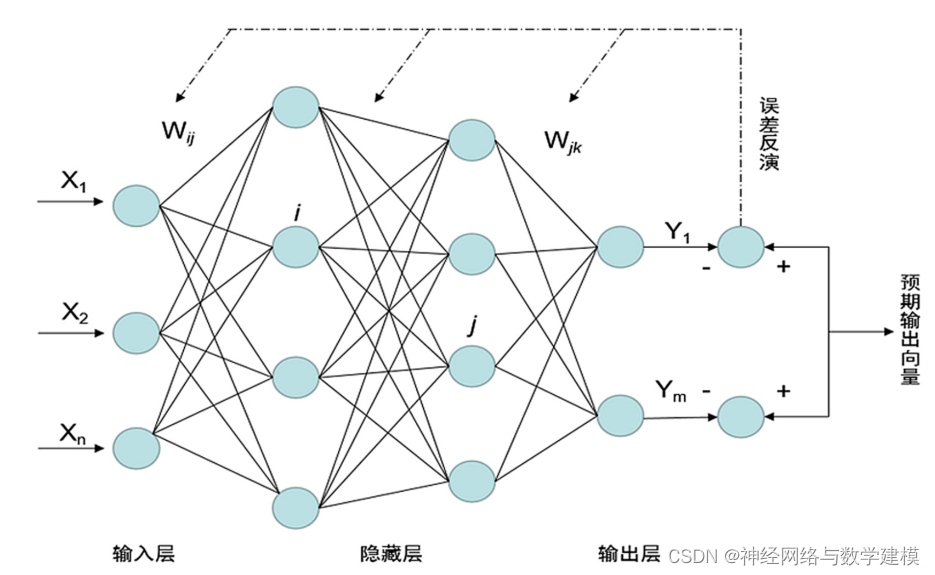

神经架构搜索(NAS)旨在自动设计神经网络架构,以满足特定的性能目标。传统的神经网络设计通常依赖于手动特征工程和试错,这既耗时又低效。NAS 通过使用优化算法自动探索和评估不同的神经网络架构,从而解决了这一挑战。

### 2.2 贝叶斯优化在神经架构搜索中的优势

贝叶斯优化是一种顺序优化算法,它通过构建目标函数的后验分布来指导搜索过程。与其他优化算法相比,贝叶斯优化在 NAS 中具有以下优势:

- **不依赖梯度信息:** NAS 中的神经网络架构通常是离散的,无法直接计算梯度。贝叶斯优化不需要梯度信息,因此适用于此类问题。

- **处理不确定性:** 贝叶斯优化通过后验分布捕获目标函数的不确定性。这有助于算法避免陷入局部最优,并探索更广泛的搜索空间。

- **并行化:** 贝叶斯优化可以并行化,从而加快搜索过程。这对于 NAS 尤其重要,因为评估神经网络架构通常是计算密集型的。

### 2.3 贝叶斯优化在 NAS 中的应用

在 NAS 中,贝叶斯优化用于优化神经网络架构的超参数,例如:

- **层数:** 网络中包含的层数。

- **卷积核大小:** 卷积层中使用的卷积核大小。

- **池化大小:** 池化层中使用的池化大小。

- **激活函数:** 网络中使用的激活函数类型。

### 代码示例

以下代码块展示了如何使用贝叶斯优化来优化 NAS 中的神经网络架构:

```python

import numpy as np

from bayes_opt import BayesianOptimization

# 定义目标函数(评估神经网络架构的性能)

def objective(params):

# 构建神经网络架构

model = build_model(params)

# 训练和评估模型

accuracy = evaluate_model(model)

return accuracy

# 定义搜索空间

bounds = {

'num_layers': (2, 10),

'kernel_size': (3, 7),

'pool_size': (2, 4),

'activation': ('relu', 'sigmoid')

}

# 初始化贝叶斯优化器

optimizer = BayesianOptimization(

f=objective,

pbounds=bounds,

random_state=123

)

# 运行优化

optimizer.maximize(n_iter=100)

# 获取最佳超参数

best_params = optimizer.max['params']

```

### 代码逻辑分析

- `objective` 函数定义了目标函数,它构建神经网络架构,训练和评估模型,然后返回准确度。

- `bounds` 字典定义了搜索空间的边界,其中超参数的范围和类型被指定。

- `BayesianOptimization` 类初始化贝叶斯优化器,指定目标函数、搜索空间和随机状态。

- `maximize` 方法运行优化,在给定的迭代次数内最大化目标函数。

- `max['params']` 访问优化器中最佳超参数的字典。

# 3. NAS贝叶斯优化新方法

### 3.1 概率建模

在NAS贝叶斯优化中,概率建模是至关重要的,因为它提供了对搜索空间中神经架构性能的估计。常用的概率模型包括:

0

0