MapReduce内存管理秘籍:避免OOM的最佳实践

发布时间: 2024-11-01 09:25:41 阅读量: 39 订阅数: 32

大数据实验5实验报告:MapReduce 初级编程实践

# 1. MapReduce内存管理概述

MapReduce作为Hadoop生态系统中处理大数据的核心组件,其内存管理机制对作业性能有着直接的影响。合理的内存配置能够显著提升任务执行效率,而内存不足则可能导致任务执行失败甚至集群性能下降。因此,深入理解MapReduce内存管理不仅有助于避免常见的内存溢出问题,还能帮助我们在资源有限的环境中优化作业性能。在本章中,我们将首先对MapReduce内存管理的概念进行简单的介绍,并概述其在实际工作中的重要性,为进一步深入探讨内存模型和优化技巧打下基础。

# 2. MapReduce内存模型的理论基础

### 2.1 MapReduce工作原理简介

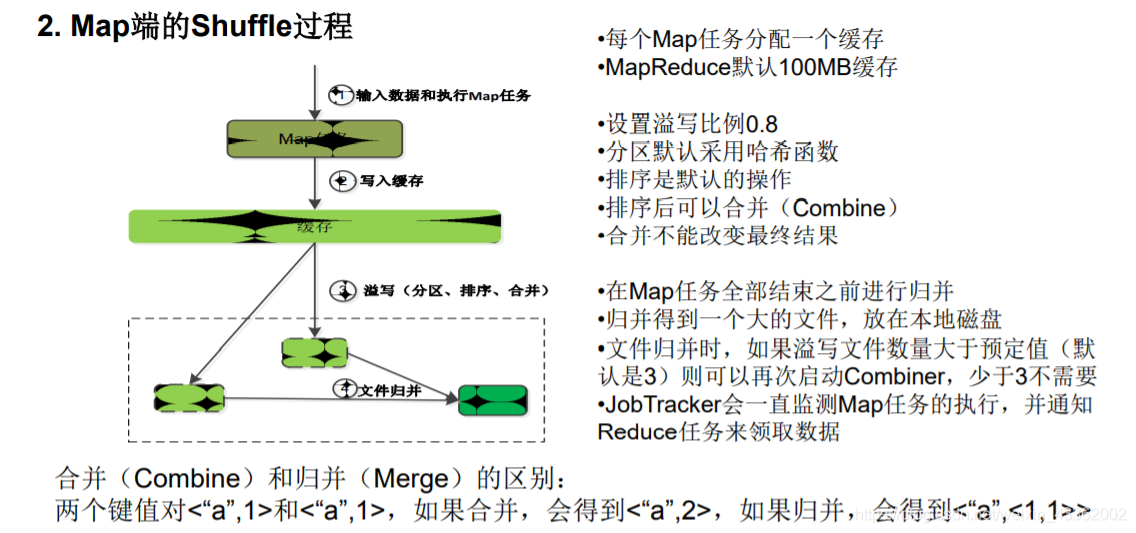

MapReduce是一种编程模型,用于处理和生成大数据集。它的运行分为几个阶段,包括Map阶段、Shuffle阶段和Reduce阶段。理解这些阶段对掌握内存管理至关重要,因为内存使用贯穿于整个作业的生命周期。

#### 2.1.1 MapReduce作业的生命周期

在MapReduce作业的生命周期中,Map阶段处理输入数据,并将中间键值对输出。Shuffle阶段负责将这些键值对根据键排序并分发给对应的Reduce任务。在Reduce阶段,这些键值对被合并处理,最终生成输出结果。这个过程中,内存是存储中间数据和缓存输出结果的重要资源。

```mermaid

flowchart LR

A[开始作业] --> B[Map阶段]

B --> C[Shuffle阶段]

C --> D[Reduce阶段]

D --> E[输出结果]

```

#### 2.1.2 Map和Reduce任务的内存使用概述

在Map阶段,每个Map任务都需要内存来存储输入数据的缓冲区、中间键值对,以及处理过程中的用户代码。Reduce阶段也类似,但还需要额外的内存来处理Shuffle过程中接收的键值对。

在实际应用中,如果内存使用不当,很容易导致内存溢出(OOM)。为了预防这种情况,需要合理分配内存资源,并监控内存使用情况。

### 2.2 内存管理的关键参数解析

#### 2.2.1 堆大小和配置参数

在Java虚拟机(JVM)中,可以通过设置堆大小来控制MapReduce作业可用的内存资源。堆大小的配置主要通过-Xms(初始堆大小)和-Xmx(最大堆大小)参数进行调整。

```java

java -Xms512m -Xmx1024m YourMapReduceJob

```

上述命令将初始堆大小设置为512MB,最大堆大小设置为1024MB。合理地配置这些参数可以有效减少OOM的风险,提高作业的稳定性。

#### 2.2.2 垃圾回收机制对性能的影响

垃圾回收(GC)是JVM内存管理的一个重要方面,它负责回收不再使用的对象占用的内存。不同的GC算法会对MapReduce作业的性能产生影响。例如,G1 GC是为适应大堆内存设计的,它在减少长时间暂停方面比传统的Parallel GC更有效。

```mermaid

graph TD

A[开始GC] --> B[标记阶段]

B --> C[清除阶段]

C --> D[压缩阶段]

D --> E[结束GC]

```

在配置GC时,需要考虑内存大小和作业的特性,以找到最佳的GC策略。

#### 2.2.3 内存溢出(OOM)的原因和影响

OOM是由于内存资源不足导致的错误,它可能是由于内存泄漏、内存配置不当或内存分配失败等原因造成的。OOM会影响MapReduce作业的执行,并可能需要重启作业,导致时间浪费和资源消耗。

解决OOM问题通常涉及代码优化、合理分配内存资源、调整GC策略等。在MapReduce中,了解和预防OOM对于高效处理大数据集至关重要。

# 3. 避免OOM的实战技巧

内存溢出(OOM, Out of Memory)问题是MapReduce编程中经常遇到的性能瓶颈之一。避免内存溢出不仅可以提高作业执行效率,还可以减少因内存不足而造成的失败和重试。本章将探讨如何通过作业设计优化、JVM参数调优和内存监控诊断来避免OOM的发生。

## 3.1 优化MapReduce作业设计

### 3.1.1 输入数据的预处理

在MapReduce作业开始之前,对输入数据进行预处理是一个有效的避免OOM的手段。预处理阶段的目的是减少Map任务处理的数据量,从而降低内存的使用。

```java

// 示例代码:数据预处理逻辑

public void preprocessInputData(Path inputPath, Path outputPath) throws IOException {

Configuration conf = getConf();

FileSystem fs = FileSystem.get(conf);

Path[] inputFiles = FileUtil.stat2Paths(fs.listStatus(inputPath));

// 过滤和转换逻辑

for (Path input*** {

// 读取原始数据

BufferedReader reader = new BufferedReader(new InputStreamReader(fs.open(inputFile)));

// 写入预处理后的数据

BufferedWriter writer = new BufferedWriter(new OutputStreamWriter(fs.create(new Path(outputPath, inputFile.getName()))));

String line;

while ((line = reader.readLine()) != null) {

String processedLine = preprocessLine(line);

writer.write(processedLine);

}

reader.close();

writer.close();

}

}

```

代码逻辑解释:上述代码展示了预处理输入数据的基本逻辑。它读取原始输入文件,进行过滤或转换,并将处理后的数据写入新路径。这里的`preprocessLine`方法代表对单行数据的处理逻辑,开发者需要根据实际业务需求来实现。

### 3.1.2 合理设置Map和Reduce任务数

Map和Reduce任务的数量直接影响到内存使用。设置过多的Map任务会增加内存压力,设置过少则会导致资源浪费和作业执行时间变长。

```xml

<!-- 在mapred-site.xml中设置map和reduce任务的数量 -->

<configuration>

<property>

<name>mapreduce.job.maps</name>

<value>100</value>

</property>

<property>

<name>mapreduce.job.reduces</name>

<value>10</value>

</property>

</configuration>

```

在设置Map和Reduce任务数时,需要权衡内存容量和集群资源。具体数值依赖于集群的硬件配置和作业的复杂度。通常建议在生产环境中通过测试不同配置,找到最适合当前环境的设置。

## 3.2 调优JVM参数

### 3.2.1 合理配置JVM内存参数

JVM内存配置对MapReduce作业性能有直接影响。调整JVM堆大小和垃圾回收策略,可以有效避免内存溢出。

```bash

# 示例:设置JVM内存参数

java -Xmx4g -Xms4g -XX:+UseG1GC -jar my-mapreduce-job.jar

```

参数说明:`-Xmx`和`-Xms`分别设置堆的最大值和初始值。`-XX:+UseG1GC`启用G1垃圾回收器,它适合于内存占用较大的应用。

### 3.2.2 应对内存溢出的紧急措施

在遇到内存溢出时,应立即采取措施限制作业资源的消耗,或者将作业调度到资源充足的集群上执行。

```bash

# 停止正在运行的MapReduce作业

hadoop job -kill job_***_0001

```

## 3.3 实践中的内存监控和问题诊断

### 3.3.1 实时监控内存使用情况

监控内存使用情况可以帮助开发者及时发现潜在的内存问题,从而采取预防措施。

```java

// 示例代码:监控内存使用情况

public void monitorMemoryUsage() {

Runtime runtime = Runtime.getRuntime();

long totalMemory = runtime.totalMemory(); // 已配置堆内存大小

long freeMemory = runtime.freeMemory(); // 当前空闲内存大小

long usedMemory = totalMemory - freeMemory; // 已使用内存大小

// 输出内存使用信息

System.out.println("Total Memory: " + totalMemory);

System.out.println("Free Memory: " + freeMemory);

System.out.println("Used Memory: " + usedMemory);

}

```

### 3.3.2 内存泄漏的发现与处理

内存泄漏是指程序中已分配的内存由于某些原因无法释放。可以通过分析垃圾回收日志来发现和处理内存泄漏问题。

```bash

# 示例:查看垃圾回收日志

tail -f gc.log

```

## 总结

避免MapReduce作业中的OOM问题,需要从多个角度入手,包括优化作业设计、调优JVM参数以及加强内存监控和问题诊断。上述内容为避免OOM的实战技巧提供了详细指导。对于内存的深入理解和调优,下一章节将进行更深入的探讨。

# 4. 深入探讨内存管理机制

在前一章节中,我们已经探讨了MapReduce内存模型的理论基础和避免OOM的实战技巧。接下来,我们将深入了解MapReduce的内存管理机制,这包括JVM内存区域的交互、内存优化技术,以及高级内存管理技术的应用。

## 4.1 JVM内存区域与MapReduce的交互

MapReduce与JVM内存区域之间的交互是性能优化的关键。理解这些交互可以帮助我们更好地管理内存,并提升MapReduce作业的执行效率。

### 4.1.1 堆内存的分配和使用

JVM堆内存是Java对象存储的地方,它直接影响到MapReduce任务的性能。在MapReduce作业中,我们需要合理地分配和使用堆内存,以避免内存溢出和优化性能。

**代码块示例**:

```java

// 示例代码展示如何设置JVM堆内存大小

public class HeapMemoryExample {

public static void main(String[] args) {

// 设置JVM堆内存最大为2GB

long maxHeapSize = 2L * 1024 * 1024 * 1024;

System.setProperty("java.maxmemory", Long.toString(maxHeapSize));

// 之后的代码将使用设置的堆内存进行对象分配等操作...

}

}

```

在上面的示例代码中,我们通过系统属性设置了JVM堆内存的大小。在MapReduce作业中,我们可以根据需要动态地设置这个值。调整堆内存大小需要根据具体作业的需求进行,同时也要考虑到操作系统的内存限制。

**参数解释**:

- `-Xmx`: 设置堆的最大内存,例如 `-Xmx2G` 设置为2GB。

- `-Xms`: 设置堆的初始内存,通常建议将其设置为与`-Xmx`相同的值以避免堆大小的动态扩展。

### 4.1.2 非堆内存的作用与调优

非堆内存主要包含方法区和直接内存等。非堆内存通常用于存储类信息、常量池、以及对象的元数据等。

**代码块示例**:

```java

// 示例代码展示如何配置JVM的元空间

public class NonHeapMemoryExample {

public static void main(String[] args) {

// 设置JVM元空间大小为512MB

System.setProperty("java.maxmetaspace", "512M");

// 之后的代码将使用设置的元空间大小...

}

}

```

在上面的示例代码中,我们通过设置`java.maxmetaspace`属性来控制JVM元空间的大小,这是Java 8引入的一个参数,用于取代之前版本的永久代(PermGen)。

**参数解释**:

- `-XX:MaxMetaspaceSize`: 设置元空间的最大容量。

- `-XX:MetaspaceSize`: 设置元空间的初始容量。

调优非堆内存需要考虑类加载器的数量和大小,以及JIT编译器产生的本地代码等。对于MapReduce作业而言,需要关注可能引起内存占用突增的操作,并及时进行调整。

## 4.2 MapReduce的内存优化技术

在MapReduce作业中,进行内存优化可以显著提升作业的性能。我们将探讨几种关键的内存优化技术。

### 4.2.1 记忆集(Combiner)的使用

在MapReduce作业中,Combiner是一种特殊类型的Reducer,它在Map阶段对数据进行部分聚合,可以减少传输到Reducer的数据量,从而节省内存和网络资源。

**代码块示例**:

```java

// 示例代码展示如何在MapReduce作业中使用Combiner

public class CombinerExample {

public static class MyCombiner extends Reducer<Text, IntWritable, Text, IntWritable> {

@Override

protected void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

context.write(key, new IntWritable(sum));

}

}

// 其他Map和Reduce类代码...

}

```

在上面的示例中,`MyCombiner`类继承自`Reducer`,它将Map阶段的输出进行部分聚合。使用Combiner可以使***uce作业更高效地使用内存。

### 4.2.2 序列化优化和压缩技术

序列化是MapReduce作业中数据传输和存储的重要组成部分。选择合适的序列化框架和压缩技术,可以有效减少内存的使用。

**代码块示例**:

```java

// 使用Kryo序列化框架来序列化对象

Serializer serializer = new KryoSerializer();

serializer.serialize(obj);

```

在上面的示例中,我们使用了Kryo序列化框架,它比Java默认的序列化框架更高效、更快,并且生成的序列化数据更小。

### 4.2.3 延迟计算策略与内存回收

延迟计算是一种优化策略,它通过推迟一些计算直到真正需要计算结果时才进行,从而节省内存资源。

**代码块示例**:

```java

// Java 8示例,使用Stream API的懒加载特性

Stream.of("a", "b", "c")

.map(str -> str.toUpperCase()) // 这个转换操作是延迟的

.filter(str -> str.startsWith("A")) // 这个过滤操作也是延迟的

.collect(Collectors.toList());

```

在上面的代码中,我们使用了Stream API的延迟加载特性,它直到调用`collect`方法时才会开始进行`map`和`filter`操作。

## 4.3 高级内存管理技术

随着大数据技术的发展,内存管理技术也在不断进步。现在让我们来探讨一些高级内存管理技术。

### 4.3.1 Off-Heap内存管理

Off-Heap内存指的是不由JVM直接管理的内存,它位于操作系统层面。使用Off-Heap内存可以绕过垃圾回收的开销,对于一些特定类型的应用程序来说,这是一种有效的性能优化方式。

**代码块示例**:

```java

// 使用Netty中的ByteBuf进行Off-Heap内存分配

ByteBuf buffer = Unpooled.directBuffer(1024);

try {

// 使用ByteBuf...

} finally {

buffer.release(); // 手动释放Off-Heap内存

}

```

在上面的示例中,我们使用了Netty框架来操作Off-Heap内存,这需要手动释放内存。

### 4.3.2 自适应内存管理机制

自适应内存管理是一种智能机制,它能够根据运行时的内存使用情况动态地调整内存配置。这种机制通常需要依赖特定的内存管理库来实现。

**代码块示例**:

```java

// 伪代码示例,展示自适应内存管理逻辑

public class AdaptiveMemoryManager {

private int memoryLimit;

public AdaptiveMemoryManager(int limit) {

this.memoryLimit = limit;

}

public void allocateMemory(int needed) {

if (remainingMemory() < needed) {

reallocateMemory();

}

// 分配内存逻辑...

}

private void reallocateMemory() {

// 增加内存限制的逻辑...

}

private int remainingMemory() {

// 获取剩余内存的逻辑...

return memoryLimit - usedMemory;

}

}

```

在上面的示例中,我们创建了一个自适应内存管理器,它会在需要时动态调整内存限制。

通过本章节的介绍,我们可以看到MapReduce内存管理机制的多样性和复杂性。在下一章节中,我们将深入探讨MapReduce内存管理的高级应用,包括大数据量处理的内存策略,以及集群的内存扩展。

# 5. MapReduce内存管理的高级应用

## 5.1 大数据量处理的内存策略

在处理大数据集时,内存管理策略变得尤为重要。适当的内存策略不仅可以优化MapReduce作业的性能,还能有效防止内存溢出。大数据量处理涉及以下几个关键点:

### 5.1.1 分区策略与内存优化

分区策略在MapReduce中通过合理地分割数据来均衡负载,减少单个任务处理的数据量。良好的分区策略能够确保数据在Map和Reduce阶段均匀分配,避免某个任务因为数据过多而耗尽内存。

#### 实操步骤

1. 通过自定义分区函数,可以控制数据的分割方式。例如,通过自定义`HashPartitioner`来确保数据均匀分配到不同的Reducer上。

```java

public class CustomPartitioner extends HashPartitioner {

@Override

public int getPartition(K key, V value, int numPartitions) {

// 自定义键值对的哈希逻辑,保证数据均衡

return Math.abs(key.hashCode() % numPartitions);

}

}

```

2. 在Job配置中使用自定义分区器。

```java

job.setPartitionerClass(CustomPartitioner.class);

```

### 5.1.2 处理跨作业内存共享

在复杂的MapReduce作业流程中,跨作业的数据共享可以显著提高效率。这种情况下,合理的内存共享机制能够减少重复计算和数据序列化开销。

#### 实操步骤

1. 使用Hadoop提供的`MultipleOutputs`或`Map-Reduce-Merge`框架来设计跨作业的数据共享流程。

```java

MultipleOutputs mos = new MultipleOutputs(context);

// 在Reducer中写入跨作业的数据

mos.write(key, value, outputName);

mos.close();

```

2. 确保输出的MapReduce作业配置了相应的输入格式来读取共享数据。

## 5.2 MapReduce集群的内存扩展

MapReduce集群的内存扩展能力对于处理大规模数据至关重要。通过集群配置与内存资源分配,可以提升整个集群的处理能力。

### 5.2.1 集群配置与内存资源分配

集群的资源分配要根据实际的作业需求和硬件配置进行调整。合理地分配CPU、内存、磁盘资源能够最大限度地利用现有硬件。

#### 实操步骤

1. 根据作业的内存需求动态调整YARN中的资源管理参数,例如:

```bash

yarn.nodemanager.resource.memory-mb

yarn.scheduler.maximum-allocation-mb

```

2. 使用YARN的资源管理功能,为不同的作业指定资源需求。

### 5.2.2 动态内存分配和负载均衡

动态内存分配允许集群在作业运行时动态调整资源,而负载均衡确保集群中的资源得到合理利用。

#### 实操步骤

1. 使用YARN的动态资源分配机制,例如:

```bash

yarn.nodemanager.vmem-pmem-ratio

```

2. 在作业执行期间监控资源使用情况,并根据需要调整资源分配。

## 5.3 性能分析与调优案例研究

性能调优是一个持续的过程,通过对具体案例的分析,可以提炼出优化策略并应用到其他类似场景中。

### 5.3.1 典型性能瓶颈案例分析

在处理大规模数据时,MapReduce作业的性能瓶颈可能来自于多个方面,如网络IO、磁盘IO、CPU处理能力等。

#### 实操步骤

1. 收集作业的性能数据,例如CPU使用率、内存占用、磁盘IO速率等。

2. 分析数据,找出性能瓶颈。比如通过Hadoop的Resource Manager界面查看各个节点的资源使用情况。

### 5.3.2 调优前后对比与总结

通过调优前后的对比,可以清晰地看到性能改进的效果,这有助于验证优化策略的有效性。

#### 实操步骤

1. 在调优前记录所有关键性能指标。

2. 应用调优策略后,再次收集相同指标的数据进行对比。

3. 通过对比分析确定哪些调优措施是有效的,并总结经验。

本文通过阐述MapReduce内存管理的高级应用,包括大数据量处理策略、集群内存扩展以及性能分析与调优案例研究,展示了如何应对实际工作中的内存管理挑战。通过这些策略的应用,开发者能够更有效地利用集群资源,提高MapReduce作业的性能和稳定性。

0

0