【实战!MapReduce Shuffle调优】:从原理到实践的深度解析,提升大数据处理速度

发布时间: 2024-10-30 21:05:23 阅读量: 4 订阅数: 8

# 1. MapReduce Shuffle的原理和重要性

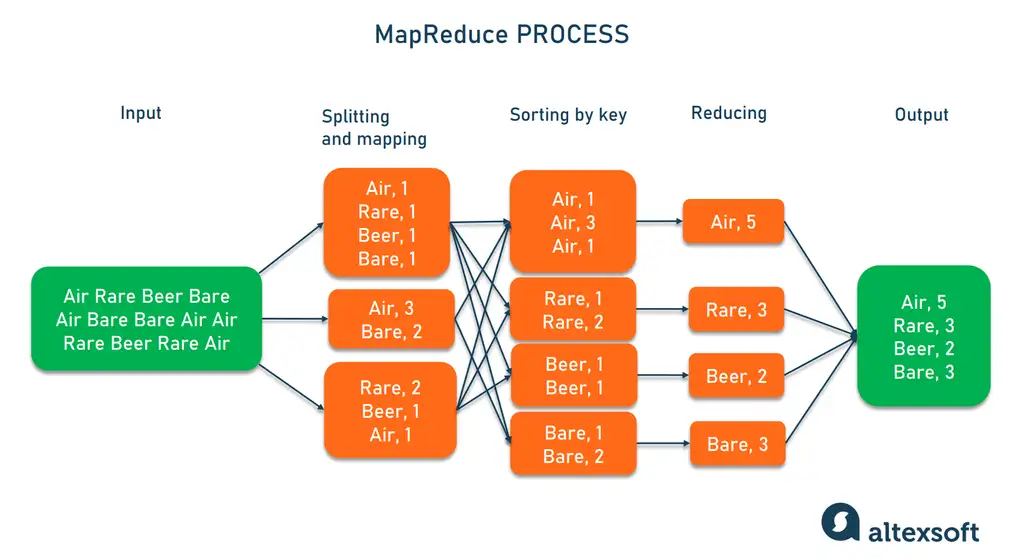

MapReduce是一种用于大数据处理的编程模型,它简化了分布式计算过程,使之能够在普通的计算机集群上运行。Shuffle是MapReduce的核心过程之一,负责将Map任务输出的结果进行排序、合并,并分发到Reduce任务进行处理。这一过程的重要性不言而喻,Shuffle的效率直接影响到整个作业的执行时间和资源消耗。

在MapReduce模型中,Shuffle扮演着“数据搬运工”的角色。具体来说,Map阶段处理完毕后,Shuffle会开始工作,它首先对数据进行排序,将具有相同键值的数据分配到同一Reducer中,然后将这些数据通过网络传输到Reduce节点。Shuffle的效率取决于数据的量级、传输的带宽以及处理节点的磁盘和内存性能。一个高效的Shuffle机制可以显著减少数据传输时间,从而提高整体计算效率。

# 2. MapReduce Shuffle的优化理论

## 2.1 MapReduce Shuffle的工作流程

### 2.1.1 Map阶段的数据处理

Map阶段是MapReduce计算模型的初步处理阶段,其主要任务是处理输入的数据,进行映射操作,并输出中间键值对。数据在Map阶段的处理流程可以被概括为以下几个步骤:

1. **数据读取**:首先,Map任务会从HDFS或其他存储系统中读取数据。数据被分割成一系列的输入分片(splits),每个分片代表一块连续的数据块。

2. **数据解析**:Map函数被应用到每个输入分片上。在这个阶段,输入数据被解析成键值对的形式(key-value pairs),这些键值对将被用于后续的Shuffle和Reduce操作。

3. **映射操作**:Map函数执行用户自定义的逻辑,对每个键值对进行处理,最终输出新的键值对。Map阶段的输出并不是直接写入到磁盘中,而是暂存在内存中的缓冲区中。

关键代码示例:

```java

public class MapClass extends Mapper<LongWritable, Text, Text, IntWritable> {

public void map(LongWritable key, Text value, Context context)

throws IOException, InterruptedException {

// 自定义的map逻辑

}

}

```

在Java代码中,一个典型的Mapper类继承自Mapper基类,并重写`map`方法来定义用户自定义的映射逻辑。Map函数输出的结果一般需要实现`WritableComparable`接口,以便于排序和后续的Shuffle阶段处理。

### 2.1.2 Shuffle阶段的原理

Shuffle阶段是MapReduce中的数据分发阶段,它的主要目的是将Map阶段产生的中间数据进行排序、分区,并传输到正确的Reduce任务。Shuffle过程包括几个关键步骤:

1. **排序**:Map输出的键值对首先根据键进行排序。这个过程是在内存中完成的,数据被组织成一个有序的数据结构(例如,树或平衡树结构)。

2. **分区**:排序后的数据根据键值被划分为不同的区域(partitions),每个分区对应到一个Reduce任务。分区函数确保所有相同的键都会发送到同一个Reduce任务。

3. **溢写(Spill)**:由于内存的限制,排序后的数据需要定期写入磁盘。这个过程称为Spill,它减少了内存的压力,同时保证了中间数据的稳定存储。

4. **合并(Merge)**:对写入磁盘的多个分区文件进行合并排序,以优化网络传输和减少Reduce阶段的处理压力。

5. **传输**:完成排序和合并的中间数据被传输到对应的Reduce任务。由于Shuffle涉及到大量的网络传输,优化网络使用可以显著提高MapReduce作业的性能。

在Shuffle过程中,数据最终被发送到Reduce任务,并且需要被反序列化,从而在Reduce阶段进行最终的汇总和处理。

## 2.2 Shuffle性能影响因素分析

### 2.2.1 磁盘I/O的瓶颈

MapReduce Shuffle过程中,磁盘I/O是影响性能的关键因素之一。因为Shuffle涉及到大量的磁盘读写操作,所以优化磁盘I/O可以显著提升整体的处理速度。

1. **缓冲区大小**:默认情况下,Map和Reduce任务的缓冲区大小可能是固定的。通过调整缓冲区大小,可以减少溢写到磁盘的次数,但过大的缓冲区也可能导致内存溢出。

2. **合并策略**:合并小文件可以减少处理时的磁盘I/O次数。小文件的增多会导致磁盘寻道时间增长,从而降低I/O效率。

3. **使用SSD**:固态硬盘(SSD)相比机械硬盘(HDD)有着更快的读写速度。使用SSD可以大幅度提高Shuffle过程中磁盘的读写效率。

### 2.2.2 网络带宽的限制

网络带宽在分布式计算中是一个重要的资源。在Shuffle过程中,数据需要通过网络从Map节点传输到Reduce节点,因此网络带宽的限制将直接影响到数据传输的速率。

1. **网络拥塞**:网络拥塞会导致数据传输延迟,降低Shuffle的效率。

2. **带宽与数据量匹配**:数据传输量应和网络带宽相匹配。如果Map任务产生的数据过多,可能导致网络带宽成为瓶颈。

3. **压缩技术**:使用数据压缩技术可以减少传输的数据量,从而减少网络带宽的压力。在Hadoop中,可以配置Map和Reduce任务的输出进行压缩。

### 2.2.3 JVM性能的影响

JVM(Java虚拟机)在执行MapReduce任务中扮演了重要角色。JVM垃圾回收(GC)机制对性能有极大的影响,尤其是当GC发生在Shuffle阶段,会对任务的响应时间和吞吐量产生负面影响。

1. **内存使用效率**:JVM参数的配置需要平衡内存使用和垃圾回收的效率。例如,合理设置堆内存大小(-Xmx和-Xms参数)可以优化内存使用。

2. **垃圾回收策略**:选择合适的垃圾回收器(如G1、CMS等)和相关参数配置,可以减少GC带来的停顿时间,从而提高Shuffle效率。

3. **线程池优化**:合理管理线程池可以优化JVM对资源的使用。在MapReduce中,可以通过调整mapreduce.job丹麦人的任务数来控制任务并行度。

## 2.3 Shuffle优化策略理论

### 2.3.1 调整Map和Reduce任务比例

调整Map和Reduce任务数量的比例可以优化Shuffle性能。过多的Map任务可能会导致数据倾斜,而过多的Reduce任务可能导致资源浪费。

1. **数据分布均匀性**:评估数据分布,根据数据量和处理时间预估Map和Reduce的数量,尽量保证每个任务处理的时间相近。

2. **任务预估与监控**:在MapReduce作业执行之前,进行数据预估和监控,实时调整Map和Reduce任务数量。

3. **负载均衡**:通过调整任务比例,确保所有节点负载均衡,避免出现部分节点空闲而另一些节点负载过重的情况。

### 2.3.2 数据倾斜问题的解决方案

数据倾斜是MapReduce中常见的性能问题,其本质是数据在Map或Reduce阶段分布不均匀。

1. **预处理阶段**:在输入数据阶段进行预处理,通过采样分析数据,预先解决数据倾斜问题。

2. **自定义分区**:通过自定义分区器(Partitioner)来控制数据在Reduce阶段的分配。

3. **增加Map任务**:对于倾斜严重的数据,可以考虑增加Map任务数量,以减少单个任务的处理量。

### 2.3.3 优化内存使用和GC策略

内存使用和GC策略的优化对于提升Shuffle阶段的性能至关重要。

1. **内存优化**:调整JVM内存设置,合

0

0