【缓冲区大小调整】:MapReduce Shuffle机制中的性能调优技巧

发布时间: 2024-10-30 21:50:00 阅读量: 4 订阅数: 8

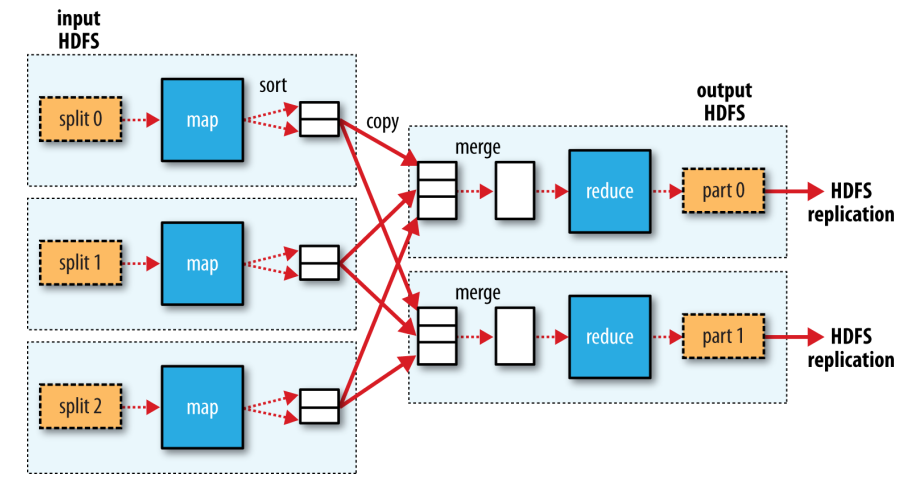

# 1. MapReduce Shuffle机制概述

在分布式计算领域,MapReduce框架的核心组件之一是Shuffle机制。它负责在Map和Reduce任务之间传输数据,确保数据能够被正确排序、分组并传递给相应的Reduce任务处理。Shuffle过程包括数据的分区、排序、合并和溢写等关键步骤,是决定整体计算效率的关键环节。理解Shuffle机制的内部运作,对于优化大规模数据处理过程至关重要。本章将从Shuffle的工作流程入手,探究其在数据处理中的重要性,并为进一步分析缓冲区大小对性能的影响奠定基础。

# 2. 缓冲区大小对性能的影响

在数据处理框架如Apache Hadoop的MapReduce模型中,缓冲区大小是决定数据处理性能的关键因素之一。理解其工作原理、对内存和磁盘I/O的影响,可以帮助我们优化系统性能。

## 2.1 缓冲区大小的理论基础

### 2.1.1 缓冲区的作用与工作原理

缓冲区在数据处理中充当临时存储的角色,它们能够存储数据在从一个进程传输到另一个进程过程中的临时存储。这种机制增加了系统的灵活性,可以平滑数据流。在MapReduce中,缓冲区管理着Shuffle过程中的中间数据。在Map阶段,缓冲区将Map任务产生的中间数据暂存起来,以减少写入磁盘的次数;在Reduce阶段,缓冲区负责从多个Map任务拉取数据,供Reduce任务使用。

```java

// 示例代码:缓冲区存储和读取数据的抽象概念

import java.nio.ByteBuffer;

public class BufferExample {

public static void main(String[] args) {

// 分配缓冲区大小

ByteBuffer buffer = ByteBuffer.allocate(1024);

// 存储数据到缓冲区

String data = "This is some data";

buffer.put(data.getBytes());

// 重置缓冲区,以便读取数据

buffer.flip();

// 读取数据

byte[] output = new byte[buffer.limit()];

buffer.get(output);

System.out.println("Read from buffer: " + new String(output));

}

}

```

代码逻辑解读:上述代码演示了使用Java NIO包中的ByteBuffer类创建一个缓冲区,存储数据,并读取出来。缓冲区首先被分配了一个固定大小(1024字节),然后将数据存入缓冲区,接着通过flip()方法重置缓冲区,使它准备好被读取。

### 2.1.2 缓冲区大小设置的基本原则

缓冲区大小的设置原则是平衡内存使用和磁盘I/O操作的需要。如果缓冲区太小,会频繁触发磁盘I/O操作,增加延迟;如果缓冲区太大,则可能造成内存溢出,影响整个系统的稳定性。因此,合理设置缓冲区的大小,需要考虑可用内存容量、数据处理需求以及具体的硬件环境。

## 2.2 缓冲区大小与内存管理

### 2.2.1 内存使用效率分析

内存使用效率是指系统在进行数据处理时,如何高效地利用可用内存资源。合理的缓冲区大小能够提高内存使用效率,避免不必要的磁盘I/O操作,从而加速数据处理速度。

```java

// 示例代码:模拟内存使用情况

import java.util.concurrent.TimeUnit;

public class MemoryUsageExample {

public static void main(String[] args) throws InterruptedException {

// 模拟内存使用过程

int bufferSize = 100 * 1024 * 1024; // 100MB

byte[] largeArray = new byte[bufferSize];

// 填充数组并计时

long startTime = System.nanoTime();

for (int i = 0; i < largeArray.length; i++) {

largeArray[i] = (byte) (i % 256);

}

// 模拟内存占用一段时间

TimeUnit.SECONDS.sleep(5);

// 清理内存

largeArray = null;

System.gc();

long endTime = System.nanoTime();

System.out.println("Memory usage simulation time: " + (endTime - startTime) / 1e9 + " seconds");

}

}

```

代码逻辑解读:该代码创建了一个100MB大小的字节数组来模拟内存占用,并通过计时器记录数组操作所花费的时间。此操作能够帮助我们理解大块内存使用对性能的影响。

### 2.2.2 缓冲区大小对内存的影响

缓冲区的大小直接影响内存的使用情况。一个较小的缓冲区意味着更多的内存释放和更多的磁盘I

0

0