【内存溢出问题】:MapReduce Shuffle机制中的分析与解决之道

发布时间: 2024-10-30 21:47:00 阅读量: 39 订阅数: 32

【MapReduce篇05】MapReduce之Shuffle机制1

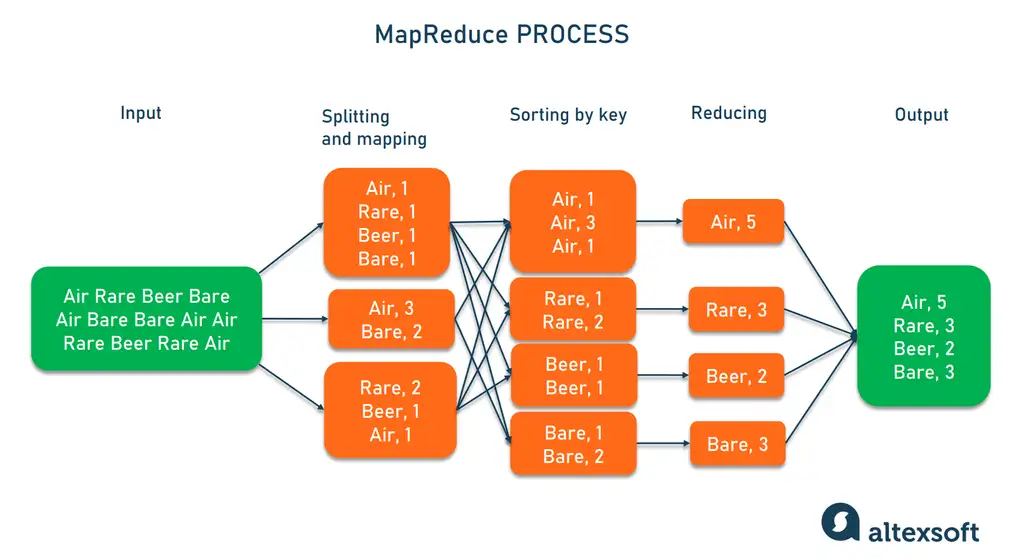

# 1. MapReduce Shuffle机制概述

MapReduce Shuffle机制是Hadoop框架中非常关键的一部分,它负责处理Map任务的输出数据,并将其传送到Reduce任务中。这个过程可以视为数据从Map端到Reduce端的流动。Shuffle的效率直接影响着整个MapReduce作业的性能。为了深入理解Shuffle机制,我们需要了解它的工作原理,以及在不同的工作阶段是如何处理数据的。通过本章的学习,读者将对MapReduce Shuffle机制有一个全面的认识,为进一步的内存溢出问题分析打下坚实的基础。接下来,我们将详细解析Shuffle机制中Map阶段的输出处理和Reduce阶段的输入处理,为后续章节探讨内存溢出问题做好铺垫。

# 2. ```

# 第二章:内存溢出问题的理论基础

内存溢出是MapReduce中常见的性能瓶颈之一,理解其理论基础对于解决实际问题至关重要。本章将解析MapReduce Shuffle流程,讨论内存管理与溢出机制,为后续章节的实践分析和解决策略打下基础。

## 2.1 MapReduce Shuffle流程解析

### 2.1.1 Map阶段的输出处理

Map阶段处理输入数据,并将其转换为键值对输出。这个阶段的输出直接关系到Shuffle过程的效率。Map函数的输出首先存储在内存缓冲区中,并定期写入磁盘。以下是Map阶段输出处理的关键步骤:

1. **内存存储:**Map任务将输出键值对存储在内存缓冲区中。当缓冲区达到一定阈值时,它会触发溢写操作。

2. **溢写操作:**Map任务将内存中的键值对排序,然后写入磁盘。排序是为了确保相同键的数据被写入到同一个分区,以便于后续的合并和Shuffle。

3. **分区处理:**在写入磁盘之前,每个键值对会根据其键通过分区函数被分配到相应的分区。

```java

// 示例代码:Map阶段的简化键值对输出处理逻辑

public class MapOutput {

// 假设这是Map任务的输出缓冲区

LinkedList<Pair<KeyType, ValueType>> buffer = new LinkedList<>();

public void emit(KeyType key, ValueType value) {

buffer.add(new Pair<>(key, value));

if (buffer.size() > BUFFER_THRESHOLD) {

spillToDisk();

}

}

private void spillToDisk() {

// 对buffer中的键值对进行排序

Collections.sort(buffer, ***paring(Pair::getKey));

// 写入到磁盘,为了简化省略了磁盘I/O操作

磁盘写入(buffer);

// 清空缓冲区

buffer.clear();

}

}

```

### 2.1.2 Reduce阶段的输入处理

Reduce阶段负责从所有Map任务的输出中拉取数据,然后对相同键的数据进行合并和处理。这个过程同样涉及到内存和磁盘I/O的交互:

1. **拉取数据:**Reduce任务通过网络从Map任务拉取数据。拉取的数据首先存储在内存中,这个过程通常伴随着网络延迟和带宽限制。

2. **内存溢出:**如果拉取的数据量超过了Reduce任务的内存容量,就会触发溢出写入磁盘的操作。

3. **合并和排序:**溢出到磁盘的数据会被合并和排序,然后加载到内存中供最终处理。

```java

// 示例代码:Reduce阶段的简化数据拉取和内存处理逻辑

public class ReduceInput {

// 假设这是Reduce任务的内存缓冲区

LinkedList<Pair<KeyType, ValueType>> buffer = new LinkedList<>();

public void fetchAndStore(Pair<KeyType, ValueType> data) {

buffer.add(data);

if (buffer.size() > BUFFER_THRESHOLD) {

spillToDisk();

}

}

private void spillToDisk() {

// 在这里对buffer中的数据进行合并和排序

mergeAndSort(buffer);

// 写入到磁盘,省略磁盘I/O操作

磁盘写入(buffer);

// 清空缓冲区

buffer.clear();

}

// 合并和排序磁盘上的数据,省略具体实现细节

private void mergeAndSort(List<Pair<KeyType, ValueType>> data) {

// 实现合并和排序逻辑

}

}

```

## 2.2 内存管理与溢出机制

### 2.2.1 内存溢出的原因分析

内存溢出通常是由于资源管理不当导致的。以下是几种常见的内存溢出原因:

1. **内存分配不足:**MapReduce作业未正确配置内存大小,无法适应处理的数据量。

2. **内存泄漏:**代码中存在内存泄漏,未被释放的内存不断累积。

3. **数据倾斜:**某些Map或Reduce任务处理的数据量远超过其他任务,导致内存溢出。

### 2.2.2 内存溢出的监控与诊断

内存溢出问题的诊断和监控是至关重要的。可以通过以下方法进行诊断:

1. **日志分析:**分析MapReduce作业的日志文件,查找内存溢出相关的错误信息。

2. **性能分析工具:**使用JVM提供的性能分析工具,例如jstack和jmap,可以查看线程状态和内存使用情况。

```java

// 示例代码:使用JVM工具进行性能分析的简化逻辑

public void performJVMAnalysis() {

// 执行JVM内存分析,如生成堆转储文件

堆转储生成();

// 分析堆转储文件,寻找内存泄漏和大对象

堆转储分析();

}

```

通过上述分析,我们可以发现内存溢出的根本原因,并采取相应的解决策略。下一章将深入探讨内存溢出问题的实践分析和解决策略。

```

# 3. 内存溢出问题的实践分析

内存溢出问题是在大规模数据处理过程中经常遇到的障碍之一。随着数据量的不断增加和处理任务的日益复杂,如何有效地诊断和解决内存溢出问题,对于保证MapReduce作业的稳定运行至关重要。

## 3.1 常见内存溢出场景

内存溢出(Out Of Memory, OOM)问题的出现,往往与数据集的大小和处理任务的内存需求密切相关。以下是两个常见的内存溢出场景。

### 3.1.1 大数据集处理

在处理大规模数据集时,如果Map和Reduce任务分配的内存不足以支撑整个数据处理过程,就很可能出现内存溢出。这种情况下的OOM通常表现为任务执行到一定阶段时,JVM抛出内存不足异常。

分析大数据集处理过程中的内存溢出问题,需要关注数据的加载、处理以及中间结果的存储等环节。如果Map阶段读取的数据量过大,可能会导致内存不足,而Reduce阶段则可能因为需要处理的数据量过大而耗尽内存。

在实际操作中,可以通过逐步增加MapReduce作业的内存分配,观察内存溢出问题是否得到缓解,从而判断是否为内存不足导致的OOM。以下是增加内存分配的示例代码:

```java

Configuration conf = new Configuration();

conf.set("mapreduce.job.maps", "50"); // 增加Map任务数量

conf.set("mapreduce.job.reduces", "15"); //

```

0

0