【Java内存管理与MapReduce】:专家分享OOM预防与解决之道

发布时间: 2024-11-01 09:55:09 阅读量: 4 订阅数: 5

# 1. Java内存管理的理论基础

Java内存管理是Java开发者必须深刻理解的主题之一,它不仅涉及到基础的内存分配和回收机制,而且也与软件性能优化和故障诊断密切相关。内存管理的核心是通过自动化的垃圾回收机制来优化内存资源的使用,从而为开发者提供一种无需手动分配和释放内存的编程模型。本章将概述Java内存管理的基础知识,为接下来深入探讨内存模型和垃圾收集算法打下坚实的基础。我们将从以下几个方面进行讨论:

## 1.1 Java内存区域

Java虚拟机(JVM)在运行Java程序时,会将内存划分为不同的区域,主要包括堆内存、栈内存、方法区、程序计数器和本地方法栈。其中,堆内存是垃圾回收的主要区域,而栈内存则是存储局部变量和方法调用的场所。

## 1.2 自动内存管理机制

Java的内存管理机制被称为"垃圾回收",其核心在于自动识别并回收不再使用的对象。JVM通过不同的垃圾回收器,提供不同场景下的最优内存回收策略。

## 1.3 内存分配与回收策略

理解JVM内存分配和回收策略对于优化应用性能至关重要。我们将探讨对象的创建、内存分配流程以及垃圾回收时采用的标记-清除、复制、标记-整理、分代收集等策略。

通过对本章内容的学习,读者应能对Java内存管理有一个全面的认识,为进一步深入学习内存模型和垃圾收集机制做好准备。

# 2. Java内存模型深入剖析

### 2.1 Java堆内存结构

#### 2.1.1 堆内存的构成与作用

在Java中,堆内存(Heap)是JVM所管理的内存中最大的一块,也是垃圾收集的主要区域。Java堆用于存储对象实例以及数组,几乎所有通过`new`关键字创建的对象实例和数组都会在堆内存中分配空间。堆内存的特点如下:

- **分配速度**:堆内存相对于栈内存,分配效率较低,但其空间较大,能够存储大量数据。

- **生命周期**:对象在JVM中主要存放在堆内存中,生命周期从创建开始到垃圾回收。

- **垃圾回收**:堆内存中的对象是垃圾回收的主要目标区域。

堆内存可以进一步细分为以下几个区域:

- **新生代(Young Generation)**:大部分对象在被创建时,首先存放在新生代的Eden区。当Eden区满时,进行垃圾回收,存活的对象被移动到名为“Survivor”的两个区域之一。

- **老年代(Old Generation)**:在新生代中经历多次垃圾回收后仍然存活的对象,会被放入老年代,老年代的空间通常比新生代更大,以存放生命周期更长的对象。

- **持久代(PermGen)/元空间(Metaspace)**(Java 8之后,PermGen已移除,元空间被引入):用于存储Java类的元数据信息,如类的方法信息、常量池、静态变量等。

#### 2.1.2 新生代与老年代的区别和联系

新生代和老年代在堆内存中的作用不同,但它们通过垃圾收集机制紧密相连。新创建的对象首先在新生代的Eden区分配内存,当Eden区满时,触发Minor GC(小垃圾回收),存活的对象被复制到Survivor区,然后Eden区被清空。经过一定次数的Minor GC后,仍然存活的对象将被移动到老年代。

新生代与老年代的联系主要体现在对象的生命周期管理上。新生代中的对象如果经历了多次GC仍然存活,就会被提升到老年代。当老年代中的对象越来越多,达到一定阈值时,会触发Major GC(大垃圾回收),即Full GC,这个过程中会停止所有应用线程,进行包括新生代和老年代在内的整个堆内存的垃圾回收。

**堆内存的大小调整:**

堆内存的大小是可配置的,通过JVM启动参数`-Xmx`和`-Xms`来设定最大堆内存和初始堆内存大小。堆内存的大小直接影响到应用的性能和稳定性。

### 2.2 Java垃圾收集机制

#### 2.2.1 垃圾收集算法原理

Java垃圾收集(Garbage Collection,GC)机制是指JVM自动管理内存的机制,它能够自动识别并回收堆内存中不再使用的对象。垃圾收集算法主要有以下几种:

- **标记-清除(Mark-Sweep)算法**:首先标记出所有需要回收的对象,在标记完成后统一回收所有被标记的对象。这种方法效率不高,且会产生大量内存碎片。

- **复制(Copying)算法**:将内存分为两块,每次只使用其中一块。当这一块内存使用完后,就将还存活的对象复制到另一块内存上,然后清空使用过的内存区域。这种算法解决了内存碎片问题,但可用内存减少了一半。

- **标记-整理(Mark-Compact)算法**:结合了标记-清除和复制两种算法的优点,标记过程与标记-清除相同,但后续不是直接对可回收对象进行清除,而是将存活对象向一端移动,然后直接清除掉端边界以外的内存。

- **分代收集(Generational Collection)算法**:将堆内存划分为新生代和老年代,根据对象的存活周期的不同采用不同的垃圾收集算法。

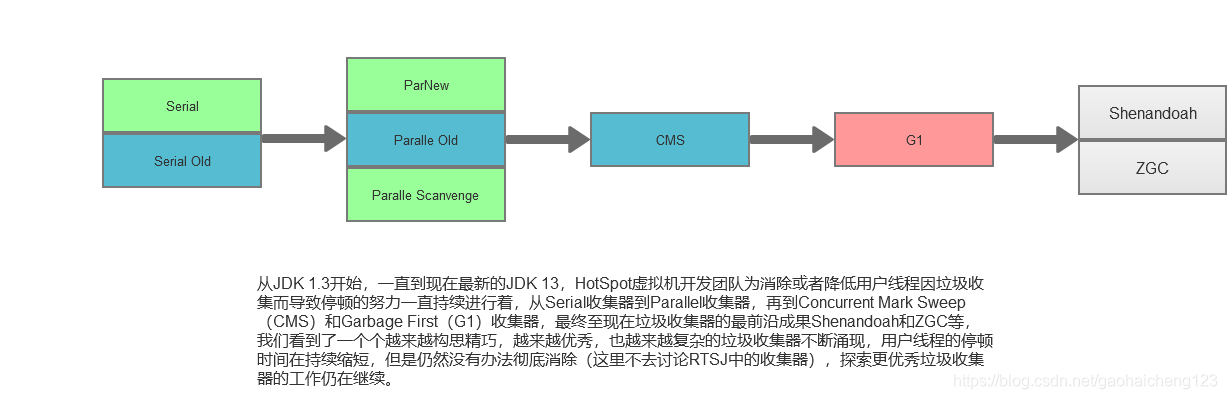

#### 2.2.2 常见垃圾收集器的工作方式

在JVM中,存在多种垃圾收集器,它们各有特点,适用于不同的场景:

- **Serial收集器**:最基础的单线程收集器,它进行垃圾收集时会暂停其他所有工作线程(Stop The World),适用于单核处理器。

- **Parallel Scavenge收集器**:是Serial收集器的多线程版本,目标是达到一个可控制的吞吐量,适用于后台计算且不需要太多交互的任务。

- **CMS(Concurrent Mark Sweep)收集器**:以获取最短回收停顿时间为目标的收集器,适用于重视服务响应时间的应用。

- **G1(Garbage First)收集器**:主要面向服务端应用,将堆内存划分为多个独立区域,实现并行收集,同时具备可预测停顿的能力。

- **ZGC(Z Garbage Collector)和Shenandoah收集器**:JDK 11引入,目标是低停顿时间,适用于超大型堆内存的应用。

每种垃圾收集器都有其适用的场景,选择合适的垃圾收集器需要根据应用的特点和需求来定。在实际应用中,JVM提供了丰富的参数来配置垃圾收集器的行为,以达到优化性能的目的。

### 2.3 内存泄漏与内存溢出

#### 2.3.1 内存泄漏的识别和分析

内存泄漏是指程序在申请内存后,无法释放已分配的内存空间,导致可用内存逐渐减少的现象。内存泄漏的原因通常是因为程序存在错误的引用关系,导致某些对象无法被垃圾回收器回收。

识别和分析内存泄漏的常见方法:

1. **代码审查**:人工审查代码,找到可能导致内存泄漏的不正确引用和资源使用。

2. **使用工具**:借助于各种性能分析工具,比如JProfiler, VisualVM等,这些工具能够监控JVM的内存使用情况,找到内存的异常占用和泄漏点。

3. **内存转储分析**:在应用出现性能问题时,可以进行内存转储(Heap Dump),然后利用分析工具对堆内存进行分析,查看对象的实例、对象间的引用关系等。

**代码段示例**:

```java

// 示例代码,存在内存泄漏风险

import java.util.HashMap;

import java.util.Map;

public class MemoryLeakExample {

public static void main(String[] args) {

Map<String, Object> cache = new HashMap<>();

for (int i = 0; i < 100; i++) {

cache.put("key" + i, new byte[1024 * 1024]); // 模拟使用大量内存

}

// 由于cache对象一直被当前方法的static引用

```

0

0