【MATLAB算法复杂度可视化】:图表与图形深入理解算法运作

发布时间: 2024-08-31 06:11:43 阅读量: 90 订阅数: 32

# 1. MATLAB算法复杂度可视化基础

算法复杂度是衡量算法性能的重要指标,它描述了算法随着输入规模的增加所需的资源(时间或空间)的增长情况。在MATLAB中,通过算法复杂度的可视化,开发者和研究人员可以直观地理解算法的效率,进而指导优化工作。本章将从MATLAB中算法复杂度可视化的基础概念和方法入手,为读者打下坚实的理论基础,并为后续的章节内容做好铺垫。

## 1.1 算法复杂度可视化的目的

可视化算法复杂度的目的是为了帮助开发者更加直观地理解算法的性能特点,特别是在不同输入规模下的资源消耗情况。通过图形展示,复杂度的评估变得更加易于理解,从而促进了算法的选择和优化工作。

## 1.2 MATLAB在复杂度可视化中的优势

MATLAB作为一种高性能的数值计算和可视化环境,提供了强大的函数和图形库,能够方便地创建图表和动画。利用MATLAB进行复杂度可视化,不仅可以快速实现,而且可以很轻松地对数据进行解释和分享。

## 1.3 算法复杂度可视化的应用场景

复杂度可视化在软件开发、教学、科研等多个领域都具有广泛的应用。例如,在教育中,它可以作为教学工具帮助学生理解抽象的算法理论;在科研中,复杂度可视化有助于发现算法性能瓶颈,为算法优化提供依据。

# 2. 算法复杂度的理论基础

### 2.1 时间复杂度和空间复杂度概念

#### 2.1.1 渐进表示法简介

渐进表示法是分析算法性能时使用的数学工具,它帮助我们描述算法的运行时间或占用空间随着输入规模增加的变化趋势。在渐进分析中,我们通常关注算法的最坏情况性能,这给出了算法性能的上界,确保在最不利情况下算法依然能够满足性能要求。

渐进表示法主要包括三种形式:

- **大O表示法**(Big O):定义了函数的上界,描述了算法性能增长的上极限。

- **大Ω表示法**(Big Omega):定义了函数的下界,描述了算法性能增长的下极限。

- **大Θ表示法**(Big Theta):定义了函数的上下界,精确地描述了算法性能的平均增长趋势。

例如,如果一个算法的时间复杂度为O(n),这意味着随着输入规模n的增加,算法的执行时间将最多增加n的倍数。

```mathematica

f(n) = O(g(n))

```

表示存在正常数c和n₀,使得对所有n≥n₀时,|f(n)| ≤ c|g(n)|。

```mathematica

f(n) = Ω(g(n))

```

表示存在正常数c和n₀,使得对所有n≥n₀时,|f(n)| ≥ c|g(n)|。

```mathematica

f(n) = Θ(g(n))

```

表示同时存在正常数c₁、c₂和n₀,使得对所有n≥n₀时,c₁|g(n)| ≤ |f(n)| ≤ c₂|g(n)|。

#### 2.1.2 常见算法复杂度分类

根据渐进表示法,算法可以分类为不同的复杂度类别。例如:

- **O(1) - 常数时间**:算法执行时间不依赖于输入规模,如访问数组中的元素。

- **O(log n) - 对数时间**:例如二分查找算法。

- **O(n) - 线性时间**:处理每个输入元素一次,如遍历数组。

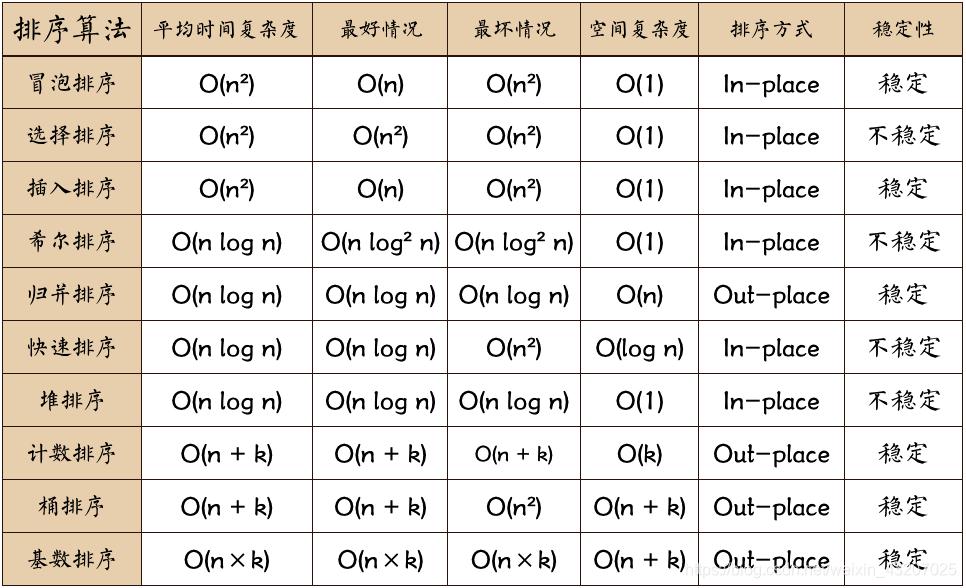

- **O(n log n)**:许多高效的排序算法(如快速排序)在平均情况下的时间复杂度。

- **O(n²)**:嵌套循环的简单算法,如冒泡排序。

- **O(2ⁿ) - 指数时间**:递归实现的分治算法,如斐波那契数列的直接实现。

- **O(n!) - 阶乘时间**:涉及所有可能排列的问题,如旅行商问题的穷举解法。

在设计算法时,目标通常是减少时间复杂度,使其尽可能接近O(1)或O(log n)。

### 2.2 理解复杂度分析的重要性

#### 2.2.1 算法效率与资源消耗

算法效率主要指算法在解决一个问题时所需的计算资源,包括时间和空间。时间复杂度关注算法执行所需的步数,而空间复杂度关注算法执行时所需的存储空间。

资源消耗是衡量算法性能的核心标准。时间效率直接关联到用户体验,而空间效率往往决定了算法是否能够在资源有限的设备上运行。理解算法复杂度有助于评估算法在不同应用场景下的可行性。

#### 2.2.2 大O、大Ω和大Θ表示法

大O、大Ω和大Θ表示法是理解算法性能的关键工具,它们分别提供了算法性能的上界、下界和紧密界限。在评估和比较不同算法时,这些工具允许我们从理论上预测算法在大数据集上的表现。

大O表示法是最常用的,因为它提供了最坏情况下的性能保证,而在软件开发中,最坏情况分析是确保系统稳定性的关键。

### 2.3 复杂度的高级分析技巧

#### 2.3.1 平均情况与最坏情况分析

最坏情况分析保证了在任何情况下算法都不会超过其性能的界限。然而,有时平均情况分析能提供更准确的性能预测,特别是在随机输入或期望输入具有某种统计分布时。

例如,在排序算法中,对于部分已经排序的数组,插入排序的平均情况性能远比最坏情况下的O(n²)要好。

#### 2.3.2 平摊分析与概率分析

平摊分析是分析一系列操作的平均性能。在某些情况下,单个操作可能会执行得非常慢,但如果在更长的序列中观察,其性能可能仍然可接受。

概率分析则引入了随机性和概率论,对于分析如快速排序等算法的平均情况性能非常有用,因为它们在操作中包含随机选择元素作为“枢轴”的步骤。

# 3. MATLAB中的复杂度可视化实践

## 3.1 利用MATLAB绘制基本图表

### 3.1.1 使用plot函数进行线性图表绘制

在MATLAB中,`plot` 函数是一个基本且强大的工具,用于创建二维线性图表,它可以帮助我们直观地展示算法性能随输入规模变化的趋势。为了更好地理解`plot` 函数的使用方法,我们首先从绘制一个简单的线性增长函数开始。

```matlab

% 定义输入规模n的范围

n = 1:20;

% 计算对应的算法运行时间

time = 0.5*n; % 假设运行时间为线性关系,即每个输入增加0.5秒

% 绘制线性图表

figure; % 打开一个新图形窗口

plot(n, time, '-o'); % 使用-o选项,绘制带有圆形标记的线条

title('线性增长的算法性能');

xlabel('输入规模 n');

ylabel('运行时间(秒)');

grid on; % 添加网格线以便观察

```

在上面的代码段中,我们定义了一个输入规模`n`,并计算了对应的算法运行时间`time`。通过调用`plot`函数并使用`-o`选项,我们得到一个带有圆形标记的线条,清晰地展示了算法性能随着输入规模的增加而线性增长的趋势。`title`、`xlabel`、`ylabel`和`grid on`分别用于设置图表的标题、x轴和y轴标签以及启用网格。

### 3.1.2 bar函数和histogram函数的应用

除了线性图表,MATLAB还提供了多种图表类型,以适应不同类型数据的可视化需求。`bar`函数用于绘制条形图,而`histogram`函数用于绘制数据分布的直方图。这些图表类型在复杂度可视化中也非常有用。

以`bar`函数为例,下面展示了如何使用它来可视化不同算法在相同输入规模下的性能比较:

```matlab

% 假设有两种算法A和B的性能数据

n = 1:10; % 输入规模

timeA = n.^2; % 算法A的时间复杂度为O(n^2)

timeB = n.*log(n); % 算法B的时间复杂度为O(n*log(n))

% 绘制条形图

figure;

bar([timeA, timeB]); % 传入两个算法的性能数据

title('不同算法性能比较');

xlabel('输入规模 n');

ylabel('运行时间(相对值)');

legend('算法A', '算法B');

grid on;

```

在这个例子中,我们使用`bar`函数绘制了一个条形图,将算法A和B的性能直观地进行了对比。通过`legend`函数添加了图例,帮助区分不同算法的性能曲线。

## 3.2 构建复杂度可视化模型

### 3.2.1 时间复杂度的可视化实例

在3.1.1节中,我们绘制了简单算法性能的线性增长图表。现在,我们将深入一步,使用MATLAB来构建一个时间复杂度的可视化实例。假设我们正在分析一个时间复杂度为O(n^2)的排序算法。

首先,我们需要生成数据,并记录不同输入规模下算法的执行时间。然后,使用得到的数据绘制图表:

```matlab

% 定义输入规模n

n = 10:10:100; % 从10到100,步长为10

% 初始化时间数组

time = zeros(1, length(n));

% 对每个输入规模,运行算法并记录时间

for i = 1:length(n)

% 假设generateData是一个创建随机输入数据的函数

data = generateData(n(i));

% 假设sortData是一个排序算法函数

tic; % 开始计时

sortedData = sortData(data);

toc; % 结束计时,并自动记录时间到time(i)

end

% 绘制时间复杂度图表

figure;

semilogy(n, time, '-o'); % 使用半对数坐标系强调指数增长趋势

title('时间复杂度 O(n^2) 排序算法性能');

xlabel('输入规模 n');

ylabel('运行时间(秒)');

grid on;

```

在上述代码中,我们使用了`semilogy`函数而不是`plot`。这是因为时间复杂度的可视化通常涉及指数增长,`semilogy`函数会更适合强调这种增长趋势,使得图表的视觉效果更加直观。

### 3.2.2 空间复杂度的可视化技术

空间复杂度是算法分析中的另一个重要方面,它衡量算法执行过程中所需的存储空间随输入规模的增长速度。MATLAB同样支持空间复杂度的可视化。

以下是一个简单的空间复杂度可视化例子,我们将演示如何使用MATLAB绘制空间复杂度为O(n)的算法所占用内存空间随输入规模增长的图表:

```matlab

% 定义输入规模n

n = 1000:1000:10000; % 从1000到10000,步长为1000

% 初始化内存使用数组

memoryUse = zeros(1, length(n));

% 对每个输入规模,运行算法并记录内存使用

for i = 1:length(n)

% 假设generateData是一个创建随机输入数据的函数

data = generateD

```

0

0